Otomasi Web Scraping: Cara Menjalankan Scraper Sesuai Jadwal

Di sini, kami akan mengulas kekhususan teknis dari otomasi web scraping, sebuah proses yang banyak bisnis andalkan untuk mendapatkan data berkualitas tinggi, baik itu riset pasar, informasi SEO/SERP, atau sentimen pelanggan. Bagian penting dari prosesnya adalah bahwa sebagian besar layanan dengan cepat menandai dan membatasi banyak permintaan dalam periode waktu singkat, yang tidak dapat dihindari selama scraping otomatis, jadi penting untuk mendistribusikan beban permintaan di antara beberapa IP menggunakan proxy berputar.

Apa itu otomasi web scraping

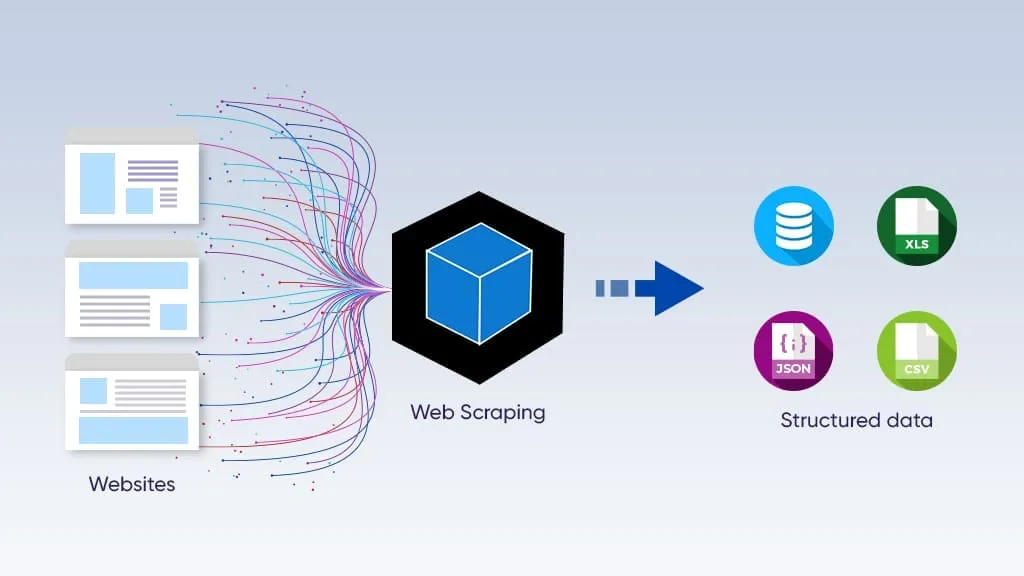

Otomasi web scraping adalah proses yang dapat diprogram untuk terhubung ke server web dan mengekstrak data darinya tanpa pekerjaan manual. Yang diperlukan hanyalah menyiapkan web scraper dan membuat instruksi untuknya. Setelah itu, ia menyelesaikan semua pekerjaan dengan sendirinya. Biasanya, file yang dihasilkan adalah tabel dalam format .csv atau .json, atau file database yang dapat diproses dengan kueri SQL.

Sangat penting untuk diingat bahwa platform membatasi aliran permintaan massal dan otomatis yang khas untuk web scraping. Itulah mengapa proxy sangat penting untuk itu. Baca lebih lanjut tentang layanan rotasi IP dan cara menggunakannya untuk menghindari larangan dan pembatasan

Pendekatan untuk mengotomatisasi web scraping

Ada dua pendekatan utama untuk otomasi web scraping: menggunakan platform low-code untuk menyiapkannya, atau menulis skrip Python dengan perpustakaan dan kerangka kerja khusus.

Alat no-code/low-code

Instrumen ini menawarkan antarmuka point-and-click, sering kali visual, yang dapat digunakan tanpa pengetahuan coding. Ini mungkin membantu, karena beberapa platform ini memungkinkan kustomisasi melalui pemrograman, tetapi tidak diperlukan. Pengguna menentukan aturan scraping dengan mengklik elemen halaman, menyiapkan logika paginasi, dan mengonfigurasi format output seperti CSV atau JSON, semuanya melalui GUI.

Mereka mudah diatur, tetapi juga memiliki banyak keterbatasan:

Scraper no-code mudah rusak ketika situs web target mengubah tata letaknya.

Mereka kesulitan dengan halaman dinamis yang berat JavaScript atau logika bisnis khusus.

Mereka menjadi mahal dalam skala besar, dan sulit untuk menyesuaikannya.

Alat-alat ini terutama digunakan oleh pemasar, analis bisnis, manajer e-commerce, dan pengusaha. Namun, solusi berbasis pemrograman lebih baik untuk scraping skala besar.

Solusi berbasis pemrograman

Alat-alat ini adalah perpustakaan dan kerangka kerja, sebagian besar untuk Python, bahasa pemrograman yang paling banyak digunakan. Scraping berbasis pemrograman memberikan pengembang kontrol penuh dan granular atas setiap aspek proses ekstraksi, dari cara permintaan HTTP dikirim hingga cara data diuraikan, disimpan, dan dijadwalkan.

Keterbatasan utamanya adalah hambatan teknis: membangun, memelihara, dan menjadwalkan scraper tingkat produksi memerlukan keterampilan coding, waktu debugging, dan keputusan infrastruktur. Pendekatan ini digunakan oleh insinyur data, pengembang backend, ilmuwan data, dan growth hacker yang membutuhkan keandalan, kustomisasi, dan kemampuan pemrograman.

Proxy otomasi web dan mengapa mereka diperlukan

Sebagian besar situs web, kecuali database terbuka besar (yang biasanya dirancang untuk scraping), membatasi jumlah permintaan yang diizinkan dari satu IP. Ketika pengguna melampaui batas ini, platform membatasi permintaan, menantang pengguna dengan CAPTCHA atau memblokir mereka. Selain itu, platform memantau semua permintaan, IP mereka, dan jejak lainnya (seperti data browser) untuk menemukan ketidakkonsistenan dan perilaku seperti bot, dan menandai alamat mencurigakan bahkan jika mereka tidak melampaui batas. Itulah mengapa kumpulan IP proxy dan browsing antideteksi diperlukan di sini: mereka mengurangi masalah ini.

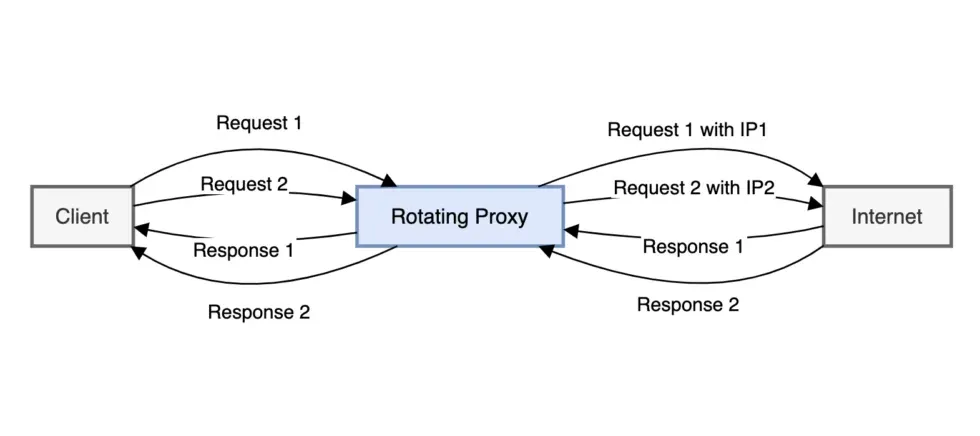

Rotasi proxy berarti setiap permintaan (atau kelompok permintaan) dikirim dari alamat IP yang berbeda. Sebagian besar, ada dua jenis:

Proxy mobile menggunakan alamat IP dari penyedia Internet mobile (LTE/5G) dan memiliki tingkat kepercayaan tertinggi, karena platform tidak membedakan mereka dari pengguna Internet mobile. Mereka paling cocok untuk scraping data media sosial.

Proxy residential berputar menggunakan kumpulan alamat IP residential dan berputar di antara mereka sesuai dengan algoritma yang telah ditentukan. Tingkat kepercayaan mereka lebih rendah tetapi masih baik untuk sebagian besar platform, dan merupakan pilihan yang baik untuk sebagian besar tugas web scraping.

Sebelum menggunakan alamat IP apa pun, kualitasnya harus dievaluasi menggunakan IP CheckerCyberYozh, yang menampilkan Fraud Score-nya.

Browser antideteksi lebih meningkatkan keamanan dengan menyediakan serangkaian jejak digital terpisah untuk setiap sesi. Dikombinasikan dengan IP yang bersih, setiap sesi sekarang tampak seperti identitas digital yang asli, dan kemungkinan larangan dan tantangan CAPTCHA berkurang secara signifikan.

Baca lebih lanjut tentang antideteksi dan cara kerjanya.

Apa layanan web scraping dan otomasi paling andal

Mengotomatisasi web scraping melibatkan penggunaan berbagai alat dan teknik untuk menjadwalkan dan menjalankan tugas ekstraksi tanpa intervensi manual. Metode terbaik tergantung pada pengetahuan coding Anda, kompleksitas situs web target, dan skala operasi yang diinginkan. Terlepas dari metodenya, penting untuk menggabungkan scraper Anda dengan proxy berputar untuk memastikan sesi Anda tidak akan dilarang.

Platform no-code khusus

Platform scraping yang dirancang khusus menggabungkan pembuat scraper visual dengan infrastruktur cloud, penjadwalan bawaan, rotasi proxy, dan penanganan CAPTCHA tanpa coding yang diperlukan.

Octoparse adalah pembuat scraper point-and-click dengan eksekusi cloud, deteksi otomatis template, dan jalankan terjadwal untuk e-commerce dan data prospek.

Apify menawarkan pasar 1.500+ scraping siap pakai «Actors» untuk situs populer, dengan hosting cloud dan output API.

Browse.ai mengkhususkan diri dalam pemantauan situs web; mendeteksi perubahan dan memicu peringatan tanpa rekonfigurasi manual.

Web Scraper ekstensi adalah scraper berbasis browser yang ramah pemula dengan penjadwalan cloud untuk ekstraksi data terstruktur sederhana.

Paling cocok untuk pemasar, analis, dan tim bisnis yang membutuhkan pengumpulan data berulang tanpa sumber daya pengembang.

Platform otomasi

Alat otomasi tujuan umum menghubungkan langkah-langkah web scraping ke alur kerja bisnis yang lebih luas, merutekan data yang diekstrak ke CRM, spreadsheet, atau alat pesan.

Zapier menghubungkan pemicu scraping ke 6.000+ aplikasi; ideal untuk penyerahan data ringan seperti daftar baru → Slack atau Google Sheets.

n8n adalah pembuat alur kerja open-source yang di-host sendiri dengan node permintaan HTTP, menawarkan kontrol lebih dan logika kustom daripada Zapier.

Platform ini cocok untuk tim operasi dan pertumbuhan yang ingin bertindak berdasarkan data yang di-scrape segera: mengotomatisasi notifikasi, perutean prospek, atau pipa pelaporan, bukan hanya menyimpannya.

Perpustakaan Python

Perpustakaan Python memberi pengembang kontrol programatik penuh atas logika scraping, penjadwalan, dan penanganan data, dari penguraian HTML sederhana hingga otomasi browser penuh.

Scrapy adalah kerangka kerja crawling tingkat produksi dengan pipeline bawaan, middleware, dan penjadwalan untuk ekstraksi data volume tinggi. Instal menggunakan pip dengan perintah pip install scrapy

BeautifulSoup + Requests adalah kombinasi ringan untuk mengurai halaman HTML statis; cepat untuk membuat prototipe tetapi terbatas untuk situs dinamis.

Playwright/Puppeteer/Selenium semuanya adalah alat otomasi browser headless yang menangani rendering JavaScript, interaksi pengguna, dan alur login kompleks.

Pilihan utama untuk pengembang dan insinyur data yang membangun pipa kustom dan dapat diskalakan yang memerlukan kontrol presisi atas proxy, penanganan kesalahan, dan pemrosesan data hilir.

Menjalankan penjadwal untuk manajemen scraper otomatis

Setelah alat scraping diatur, aktivitasnya juga harus diotomatisasi. Scraper mengotomatisasi ekstraksi data web, tetapi alat lain, yang disebut penjadwal, mengotomatisasi kapan scraper harus berjalan dan kapan harus idle. Juga dimungkinkan untuk menghidupkan dan mematikannya secara manual, tetapi penjadwal memungkinkan kontrol dan presisi yang lebih besar, yang, seperti yang telah kami lihat, sangat penting. Biasanya, dua jenis penjadwal digunakan: tingkat sistem dan berbasis cloud.

Baca lebih lanjut tentang strategi rotasi IP untuk memilih yang Anda butuhkan.

Penjadwal tingkat sistem

Mari kita mulai dengan tipe pertama. Contoh khas adalah program penjadwalan standar untuk sistem operasi Unix (termasuk macOS) dan Windows.

Cron Jobs: Penjadwal pekerjaan berbasis waktu standar untuk sistem operasi mirip Unix, ideal untuk menjalankan skrip Python sesuai jadwal.

Windows Task Scheduler: Setara Windows bawaan untuk menjadwalkan program atau skrip agar berjalan pada waktu tertentu.

Kedua program memiliki antarmuka yang sangat sederhana yang memungkinkan pengguna untuk meluncurkan dan menghentikan program lain dalam waktu tertentu.

Solusi berbasis cloud

Platform penjadwalan berbasis cloud menerapkan dan menjalankan skrip scraping di lingkungan digital mereka. Contoh khas adalah GitHub Actions, AWS Lambda, dan Apache Airflow.

GitHub Actions adalah platform CI/CD gratis yang dapat menjalankan skrip scraping Anda di server GitHub, memastikan mereka dieksekusi bahkan ketika mesin lokal Anda mati.

AWS Lambda adalah opsi yang sangat scalable dan cost-effective untuk menjalankan scraper di cloud, hanya dengan memposting kode ke lingkungan runtime-nya dan meluncurkannya.

Apache Airflow adalah platform open-source untuk membuat, menjadwalkan, dan memantau workflow secara terprogram, cocok untuk data pipeline yang kompleks.

Platform-platform ini sangat cocok untuk akses bersama dan kerja tim, ketika beberapa developer bekerja pada satu proyek menggunakan salah satu dari tools ini.

Tabel ringkasan platform web scraping dan scheduling

Mari kita ringkas platform scraping dan scheduling ini berdasarkan prinsip penggunaan, contoh, dan apa yang paling baik untuk mereka.

Jenis Platform | Contoh | Paling Baik Untuk | Coding |

Alat parsing no-code | Octoparse, Browse AI, Apify | Non-developer, monitoring | Tidak |

Perpustakaan Python | Scrapy, Playwright, BS4 | Kontrol penuh, logika custom | Ya |

Platform otomasi | n8n, Zapier, Airflow | Integrasi workflow | Rendah/opsional |

Cloud scheduler | GitHub Actions, AWS Lambda | Serverless, always-on runs | Sedang |

OS scheduler | Cron (Unix), Task Scheduler (Windows) | Penjadwalan skrip lokal | Minimal |

Menyiapkan web scraper otomatis: Best practices

Sekarang, mari kita jelajahi best practices untuk menjalankan web scraping tool.

Periksa robots.txt

Website biasanya memiliki file khusus yang disebut robots.txt yang menentukan konten mana yang dapat dan tidak dapat di-crawl. Biasanya, website melindungi halaman login, dashboard pengguna, dan halaman lain dengan informasi sensitif. Untuk mengaksesnya, cukup tambahkan namanya ke root website (yaitu, app.cyberyozh.com/robots.txt), dan di sini Anda akan melihat aturan scraping website. Jangan scrape data yang tidak diizinkan darinya.

Rotasi IP Anda dengan proxy

Rotasi alamat IP menggunakan layanan proxy untuk menghindari rate limiting dan IP ban saat scraping dalam skala besar. Pastikan untuk memeriksa kualitas IP sebelum melakukan rotasi. Dengan checker CyberYozh, ini dapat diotomatisasi menggunakan CyberYozh API, sehingga rotasi hanya akan terjadi jika IP target memiliki Fraud Score yang rendah.

Implementasikan penundaan acak

Tambahkan penundaan acak antara permintaan untuk menghindari membebani server target atau mendapatkan alamat IP Anda diblokir. Pastikan Anda tidak melanggar Terms of Service website dengan membuat terlalu banyak permintaan, karena ini dapat mengganggu operasi website dan menyebabkan konflik dengan platform.

Baca lebih lanjut tentang kesehatan alamat IP dalam artikel proxy management cycle dari CyberYozh.

Tangani kesalahan secara otomatis

Implementasikan blok try-catch atau mekanisme penanganan kesalahan serupa untuk menangani masalah potensial seperti kesalahan jaringan atau perubahan struktur website. Ini akan memastikan bahwa kesalahan potensial dihitung dan dilaporkan sebelum scraping dimulai, sehingga Anda dapat merespons dengan tepat, menghemat traffic Anda, dan mencegah masalah.

Gunakan headless browsing

Untuk menghemat traffic, yang sangat penting dalam web scraping, Anda dapat menggunakan metode headless browsing, ketika scraper Anda mengakses hanya data yang Anda butuhkan (harga, biaya, hasil pencarian, listing, komentar pengguna, dan sebagainya) tanpa UI. Karena rotating proxy biasanya mengenakan biaya berdasarkan jumlah traffic, ini juga akan hemat biaya.

Praktik web scraping terbaik: Ringkasan

Otomasi web scraping menggabungkan alat scraping yang tepat, scheduler yang andal, dan rotating proxy menjadi satu pipeline data tanpa tangan. Baik Anda seorang marketer menggunakan Octoparse atau developer membangun pipeline Scrapy, fundamentalnya tetap sama: distribusikan permintaan Anda di seluruh IP yang bersih, hormati aturan platform, dan tangani kesalahan secara proaktif. Proxy residensial dan mobile CyberYozh, dikombinasikan dengan IP Checker API-nya, memberikan infrastruktur untuk menjalankan scraper dalam skala besar tanpa ban atau gangguan.

FAQ tentang otomasi web scraping

Apa itu otomasi web scraping?

Proses yang dapat diprogram yang mengekstrak data web secara otomatis sesuai jadwal, tanpa pekerjaan manual, menampilkan hasil ke CSV, JSON, atau database.

Apakah saya memerlukan keterampilan coding untuk mengotomatisasi web scraping?

Platform tanpa kode seperti Octoparse dan Browse.ai menangani semuanya secara visual. Coding membuka lebih banyak kekuatan dan fleksibilitas dalam skala besar.

Mengapa scraper diblokir?

Website mendeteksi permintaan berulang dari satu IP dan menandai perilaku seperti bot. Rate limits, CAPTCHA, dan IP ban menyusul.

Apa itu rotasi IP dan mengapa itu penting?

Rotasi IP mengirimkan setiap permintaan dari alamat IP yang berbeda, mencegah rate limiting dan membuat sesi scraping terlihat seperti pengguna nyata.

Apa perbedaan antara residential dan mobile proxy untuk scraping?

Mobile proxy membawa tingkat kepercayaan tertinggi dan jarang diblokir; residential proxy menawarkan pool yang lebih besar dan cocok untuk sebagian besar tugas scraping umum.

Apa itu cron job dalam web scraping?

Scheduler sistem berbasis Unix yang memicu skrip scraping secara otomatis pada interval waktu yang ditentukan, seperti harian atau per jam.

Bisakah saya menjalankan scraper di cloud secara gratis?

Ya. GitHub Actions menawarkan eksekusi cloud gratis dari skrip scraping sesuai jadwal, bahkan ketika mesin lokal Anda mati.

Apa itu robots.txt dan haruskah saya mengikutinya?

File yang mendeklarasikan halaman mana yang diizinkan situs untuk di-crawl. Menghormatinya membuat scraper Anda etis dan mengurangi risiko hukum.

Apa itu headless browser dan kapan saya harus menggunakannya?

Browser yang berjalan tanpa UI, digunakan untuk scrape halaman yang dirender JavaScript secara efisien sambil mengonsumsi lebih sedikit bandwidth dan traffic proxy.

Bagaimana cara saya memeriksa apakah IP proxy saya bersih sebelum menggunakannya?

Gunakan IP Checker dari CyberYozh untuk mendapatkan Fraud Score untuk IP apa pun; ini dapat diotomatisasi melalui API CyberYozh.

Bermanfaat?

Bagikan artikel