Apa Arti Parsing Data: Scrapers, Parsers, dan Proxies

Ketika pengguna bertanya apa artinya mem-parse data, mereka menanyakan tentang penerjemahan sistematis dari kode web mentah menjadi data terstruktur. Di sini, kita akan mengeksplorasi proses ini, dan seperti biasa, saya akan menyiapkan jawaban sejelas dan seteliti mungkin, didukung oleh ulasan pengguna dan komentar spesialis.

TL;DR

Parsing data adalah proses mengonversi HTML mentah yang di-scrape menjadi data bersih dan terstruktur, dan melakukannya secara andal memerlukan scraper, parser, dan strategi rotasi proxy yang tepat bekerja bersama.

Scraper mengumpulkan konten halaman mentah; parser mengekstrak hanya field yang Anda butuhkan (harga, nama, ulasan) ke dalam JSON atau CSV

Proxy dan rotasi IP mencegah pemblokiran, tetapi Anda harus memilih strategi yang tepat: per-request untuk pekerjaan massal, sticky session untuk login, berbasis waktu untuk pemantauan terjadwal

Pilihan framework penting: Scrapy untuk skala statis, Playwright untuk situs yang banyak menggunakan JavaScript, BeautifulSoup untuk parsing ringan

Kasus penggunaan utama meliputi pemantauan harga, pembangunan dataset AI, agregasi perjalanan, pelacakan ulasan, dan generasi prospek

Open Scraper dari CyberYozh (gratis, berbasis Playwright), ditambah pool IP residensial 50M+ dan IP Checker untuk memastikan kualitas, mencakup seluruh pipeline dari crawl hingga data bersih

Makna parsing data: Definisi inti

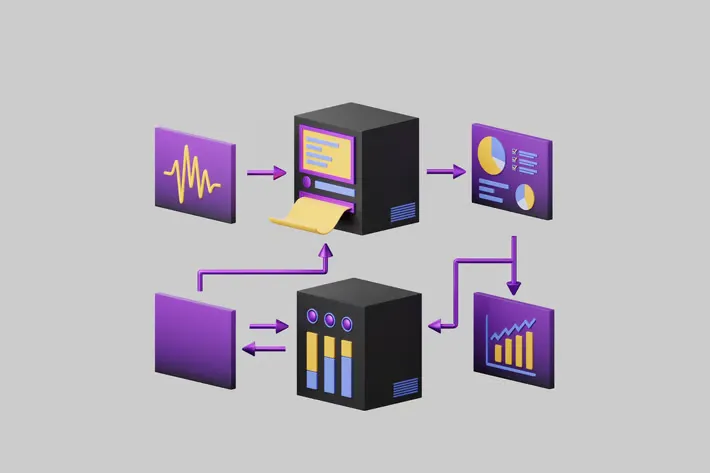

Makna parsing data pada dasarnya: ini adalah proses mengorganisir informasi mentah dan tidak terstruktur (biasanya HTML yang di-scrape) dan mengekstrak makna darinya dengan mengonversinya ke dalam format bersih dan dapat di-query seperti JSON atau CSV. Jika Anda bertanya-tanya apa arti parsing data dalam praktik, bayangkan sebagai operasi tiga lapis:

Scraper mengumpulkan konten halaman mentah dari situs web target

Parser membaca halaman-halaman tersebut, menerapkan logika, dan mengisolasi nilai yang benar-benar Anda butuhkan

Proxy memastikan seluruh proses tidak diblokir di tengah jalan oleh server target.

Tanpa memahami alur kerja data-parsing secara penuh, pengumpulan data otomatis hampir selalu menghasilkan hasil yang tidak lengkap atau dimatikan oleh pertahanan anti-bot. Makna data yang di-parse dalam konteks bisnis adalah output bersih dan terstruktur yang dapat Anda masukkan ke dalam spreadsheet, database, atau model AI. Mari kita jelajahi alat-alat spesifik untuk itu

Apa itu data scraper

Data scraper adalah program otomatis yang menavigasi halaman web dan mengunduh konten mentahnya, biasanya dalam bentuk kode sumber HTML, respons JSON, atau payload API. Scraper dapat berkisar dari skrip Python yang menggunakan library requests untuk mengambil halaman statis hingga browser Chromium headless yang mensimulasikan gerakan mouse, scrolling, dan pengiriman formulir untuk membuka konten yang di-render secara dinamis.

Baca lebih lanjut tentang web scraping di glosarium CyberYozh.

Cakupan apa yang dapat dikumpulkan scraper sangat luas:

daftar produk

lowongan pekerjaan

judul berita

konten media sosial

harga properti

jadwal perjalanan

Apa pun yang terlihat publik di browser pada prinsipnya dapat di-scrape. Keterbatasan utama mereka adalah mengembalikan seluruh halaman apa adanya, termasuk semua boilerplate, menu navigasi, iklan, dan noise. Itulah mengapa parsing adalah langkah kritis yang mengikutinya.

Contoh kasus penggunaan: Sebuah startup analitik e-commerce menjalankan scraper berbasis Scrapy untuk merayapi 50 toko kompetitor setiap 6 jam. Scraper mengunduh halaman produk lengkap secara massal, menyimpan HTML mentah secara lokal, dan menyerahkan dataset tersebut ke pipeline parsing. Tanpa parser di hilir, HTML mentah tersebut tidak memiliki nilai komersial.

Apa itu data parser

Arti data parser adalah program yang mengambil HTML mentah yang dikumpulkan oleh scraper dan mengekstrak hanya data poin yang relevan serta mengorganisirnya ke dalam format terstruktur:

nama produk

harga produk

jumlah ulasan

status ketersediaan

postingan sosial tertentu

Parser bekerja dengan menerapkan aturan seleksi: selektor CSS (misalnya, div.price) atau ekspresi XPath yang menunjuk tepat di mana dalam DOM sebuah nilai berada. Output akhir dari parser adalah apa yang sebenarnya dimaksud dengan parsed data dalam produksi: dataset yang bersih, bertipe, dan terdeduplikasi yang dapat dimasukkan ke dalam tabel PostgreSQL, didorong ke API, atau digunakan untuk melatih model machine learning.

Baca lebih lanjut tentang apa itu checker dan parser!

Contoh kasus penggunaan: Sebuah agregator perjalanan men-scrape halaman daftar hotel mentah dari 12 platform pemesanan dan meneruskannya ke parser yang mengekstrak harga check-in, rating, tipe kamar, dan kebijakan pembatalan. Parser menormalkan mata uang dan format tanggal, kemudian menulis hasilnya ke database terpadu yang mendukung perbandingan harga real-time.

Data web mentah, dengan sendirinya, tidak dapat di-query, divisualisasikan, atau dimasukkan ke dalam algoritma: data tersebut memerlukan struktur terlebih dahulu. Bisnis mengandalkan data parsing untuk berbagai penggunaan, yang akan saya ulas sedikit lebih lanjut. Dalam setiap kasus ini, parsing adalah langkah yang mengonversi file HTML menjadi insight.

Proxy parsing data dan rotasi IP

Menjalankan scraper tanpa proxy adalah eksperimen yang berumur pendek. Website melacak permintaan berulang dari satu alamat IP dan merespons dengan pembatasan rate, CAPTCHA, error HTTP 429, atau larangan langsung.

👉 Pelajari lebih lanjut tentang

Rotasi IP adalah praktik mendistribusikan permintaan ke beberapa alamat IP sehingga pertahanan platform melihat lalu lintas terdistribusi yang terlihat alami alih-alih satu sumber otomatis.

Lihat panduan rotasi IPCyberYozh, yang mengidentifikasi empat strategi inti berdasarkan tugas yang ada:

Rotasi acak: IP beralih secara acak dari kumpulan IP setelah interval yang bervariasi (misalnya, 5–40 menit), menyatu dengan pola lalu lintas pengguna nyata. Terbaik untuk scraping frekuensi menengah di mana emulasi perilaku alami penting.

Rotasi per permintaan: Setiap permintaan HTTP menggunakan IP baru dari kumpulan IP. Ini adalah strategi utama untuk scraping volume tinggi pada mesin pencari, katalog produk, dan basis data besar di mana kecepatan adalah yang terpenting.

Rotasi berbasis waktu (terprogram): IP berubah sekali per periode waktu yang ditetapkan, terlepas dari jumlah permintaan. Ideal untuk pekerjaan pemantauan harga yang berjalan sesuai jadwal dan memerlukan perilaku yang dapat diprediksi dengan jejak rendah.

Sesi tetap: IP yang sama dipertahankan untuk seluruh sesi, kemudian dirotasi saat sesi ditutup. Penting untuk alur kerja yang melibatkan login ke akun, karena perubahan IP di tengah sesi memicu tanda penipuan dan pembatalan sesi.

Banyak pengaturan gagal karena mencampur pendekatan ini — merotasi terlalu cepat, atau mengandalkan IP berkualitas rendah yang sudah membawa sinyal risiko.

—Panduan Rotasi IP CyberYozh

Memilih strategi rotasi yang salah adalah salah satu penyebab paling umum kegagalan scraping yang sebenarnya tidak terkait dengan kode scraper itu sendiri. Mari kita jelajahi cara menerapkannya untuk tugas-tugas dunia nyata yang spesifik.

Strategi parsing data dan kasus penggunaan

Tugas

Memantau harga produk kompetitor di 20 platform e-commerce secara real time, di berbagai wilayah.

Strategi parsing data

Gunakan Scrapy untuk crawling volume tinggi dengan langkah parsing BeautifulSoup untuk menormalkan harga dan mata uang. Terapkan rotasi IP per permintaan dengan proksi residensial CyberYozh, dengan penargetan geografis yang disetel ke pasar target penjual. Keluaran ke basis data dengan peringatan deteksi perubahan harian.

Tugas

Mengumpulkan data harga penerbangan dan hotel dari puluhan platform pemesanan perjalanan untuk layanan perbandingan harga.

Strategi parsing data

Gunakan Playwright untuk merender halaman pemesanan yang berat JavaScript dan mengekstrak harga dinamis. Terapkan rotasi berbasis waktu dengan IP residensial di negara target, meniru sesi browsing pengguna nyata. Parse bidang harga terstruktur dan dorong ke mesin perbandingan.

Tugas

Membangun dataset teks multibahasa untuk melatih model bahasa besar dari artikel berita, forum, dan blog di 30 negara.

Strategi parsing data

Gunakan Scrapy untuk crawling dengan rotasi per permintaan di seluruh kumpulan IP residensial yang luas mencakup bahasa dan wilayah target. Parse artikel dengan selektor CSS untuk mengekstrak judul, isi, tanggal, dan tag bahasa. Simpan dalam basis data korpus terstruktur yang siap untuk tokenisasi.

Tugas

Mengumpulkan dan menganalisis ulasan pelanggan tentang merek Anda dan kompetitor dari Amazon, Trustpilot, App Store, dan G2 di 15 negara.

Strategi parsing data

Gunakan Python Requests + BeautifulSoup untuk halaman ulasan statis; beralih ke Playwright untuk widget ulasan yang di-render dengan JavaScript. Terapkan rotasi acak dengan IP residensial dari setiap negara target untuk mengakses versi ulasan spesifik wilayah. Masukkan data sentimen yang telah di-parse ke pipeline NLP.

Tugas

Otomatiskan generasi prospek dengan mengekstrak detail kontak bisnis dari direktori industri dan jaringan profesional.

Strategi parsing data

Gunakan Playwright untuk navigasi multi-langkah dan interaksi formulir. Terapkan sesi tetap per profil target untuk mempertahankan perilaku sesi yang konsisten. Parse bidang nama, jabatan, email, dan perusahaan ke dalam format CSV yang siap untuk CRM.

Framework parsing data: Scrapy, Playwright, dan lainnya

Memilih framework yang salah dapat menghabiskan waktu berminggu-minggu dalam proyek scraping baru. Setiap alat utama di tahun 2026 memiliki peran yang berbeda dalam pipeline, dan pengaturan terbaik jarang mengandalkan satu alat saja.

Cara memilih framework parsing terbaik

Pertanyaan intinya adalah: apakah situs target Anda me-render konten dengan JavaScript, atau data tersedia dalam HTML statis? Situs statis memerlukan alat yang ringan dan cepat; SPA dinamis memerlukan mesin browser asli. Berikut adalah rincian framework utama:

Scrapy: Framework crawling Python tingkat produksi dengan pipeline bawaan, middleware, antrian permintaan, dan penjadwalan. Terbaik untuk crawling statis atau semi-statis skala besar di mana throughput adalah prioritas. Bukan browser; tidak mengeksekusi JavaScript secara native.

Playwright: Pustaka otomasi browser modern oleh Microsoft yang mendukung Chromium, Firefox, dan WebKit di Python, Node.js, Java, dan C#. Fitur termasuk auto-waiting bawaan, intersepsi jaringan, emulasi perangkat, dan manajemen multi-tab. Pilihan utama untuk situs dinamis yang banyak menggunakan JavaScript di tahun 2026.

Selenium: Framework otomasi browser veteran dengan dukungan bahasa dan browser terluas (Java, Python, C#, Ruby, dan lainnya). Lebih berat dan lambat dibanding Playwright, tetapi tak tertandingi dalam lingkungan legacy dan tim engineering polyglot dengan infrastruktur Selenium Grid yang sudah ada.

Puppeteer: Pustaka Node.js yang dikembangkan Google untuk mengontrol Chromium melalui Chrome DevTools Protocol. Sangat baik untuk tugas spesifik Chrome, analisis performa, dan pembuatan PDF. Kalah performa dibanding Playwright pada proyek multi-browser dan multi-bahasa.

BeautifulSoup + Requests: Cara tercepat untuk membuat prototipe parser untuk HTML statis. Ini adalah pustaka Python yang hanya mem-parse HTML yang telah diunduh. Ideal untuk tugas parsing ringan dan sebagai lapisan parsing dalam pipeline Scrapy.

Tabel perbandingan framework:

Framework | Fitur utama | Kasus penggunaan umum |

Scrapy | Pipeline bawaan, middleware, crawling async, penjadwalan | Crawling situs statis volume tinggi, pengumpulan dataset besar |

Selenium | Multi-bahasa, Selenium Grid, dukungan browser yang luas | Sistem lama, tim skala besar, scraping terdistribusi |

Playwright | Auto-wait, multi-browser, intersepsi jaringan, emulasi perangkat | Penilaian layanan dinamis, situs berat JS, alur login, scroll tak terbatas |

Puppeteer | Chrome DevTools Protocol, kontrol Chrome yang terperinci | Scraping khusus Chrome, rendering PDF, pemantauan performa |

BeautifulSoup | Parsing HTML/XML sederhana, selektor CSS, XPath | Parsing halaman statis, proyek ringan, prototyping cepat |

Framework-framework ini tidak saling eksklusif dan sering dikombinasikan. Pengaturan performa tinggi yang umum menggabungkan Scrapy sebagai orkestrator crawl dengan Playwright menangani permintaan berat JavaScript melalui middleware scrapy-playwright.

Praktik terbaik untuk mem-parse data

Pisahkan logika scraping dan parsing Anda. Simpan HTML mentah sebelum mem-parse-nya. Ini memungkinkan Anda menjalankan ulang parser dengan selektor yang diperbarui tanpa harus meng-crawl ulang seluruh situs: penghematan waktu yang besar ketika tata letak target berubah secara tak terduga.

Sesuaikan strategi rotasi Anda dengan tugas. Gunakan rotasi per-permintaan untuk scraping massal, sesi sticky untuk alur kerja berbasis akun, dan rotasi berbasis waktu untuk pekerjaan pemantauan terjadwal. Rotasi yang terlalu agresif merusak sesi; rotasi yang terlalu lambat menandai IP.

Selalu periksa reputasi IP sebelum deploy. IP berkualitas rendah atau yang sebelumnya disalahgunakan menjamin hasil yang buruk terlepas dari logika rotasi Anda. Gunakan IP Checker CyberYozh untuk menilai IP Anda sebelum menambahkannya ke alur kerja aktif mana pun.

Acak pola permintaan Anda. Gunakan penundaan variabel, user agent yang diacak, dan header browser yang realistis untuk menghindari pemicu sistem deteksi perilaku. Penundaan 1 detik seragam di antara setiap permintaan sama mencurigakannya dengan tanpa penundaan sama sekali.

Gunakan browser headless hanya jika diperlukan. Playwright dan Selenium membutuhkan banyak sumber daya. Gunakan BeautifulSoup + Requests untuk halaman statis dan cadangkan otomasi browser untuk halaman yang benar-benar memerlukan rendering JavaScript.

Open Scraper CyberYozh: Alat scraping data gratis untuk semua orang

CyberYozh memelihara Open Scraper, toolkit scraping gratis dan open-source yang dibangun di atas Playwright, dirancang untuk menurunkan hambatan masuk bagi pengembang yang menginginkan ekstraksi data tingkat profesional tanpa membangun infrastruktur dari awal. Ini menangani bagian paling menuntut dari alur kerja scraping secara otomatis:

Instalasi mudah: Instal Open Scraper dengan Docker dalam 15-20 menit dan gunakan dengan pengetahuan coding minimal

Antrean pekerjaan asinkron: Jalankan beberapa pekerjaan scraping secara paralel dari aplikasi Open Scraper lokal Anda

Scraping batch: proses daftar URL besar dalam batch terstruktur

Integrasi proxy native: Terhubung langsung ke jaringan proxy CyberYozh untuk rotasi yang mulus

Sebagai platform, CyberYozh memperluas kemampuan Open Scraper dengan infrastruktur proxy lengkapnya. Pengguna mendapatkan akses ke pool IP residensial 50 juta+ yang mencakup 100+ negara, dengan latensi global yang konsisten rendah yang cocok untuk pekerjaan scraping dan monitoring yang sensitif terhadap waktu. IP Checker bawaan memungkinkan Anda memverifikasi skor kepercayaan IP dan sinyal risiko penipuan sebelum menerapkannya ke alur kerja produksi mana pun, dan CyberYozh API memudahkan untuk mengotomatiskan penjadwalan rotasi IP dan pemeriksaan reputasi secara terprogram, terintegrasi dengan baik dengan Scrapy, Playwright, Selenium, Puppeteer, dan Postman.

Siapkan infrastruktur proxy Anda. Daftar ke CyberYozh, dan mulai sekarang!

Pengingat akhir tentang parsing data

Parsing data adalah jembatan antara konten web mentah dan intelijen yang dapat ditindaklanjuti. Alur kerjanya selalu sama: scrape dengan framework yang tepat, parse data yang Anda butuhkan, dan lindungi pipeline dengan proxy berkualitas dan strategi rotasi yang cerdas. Kuasai ketiga lapisan ini, dan Anda dapat mengekstrak wawasan terstruktur dari hampir semua sumber data publik.

Periksa katalog proxy CyberYozh dan pilih opsi yang paling Anda butuhkan.