Як парсити дані Google Trends: Повне практичне керівництво (2026)

Чому хтось захотів би парсити Google Trends у 2026 році — перш ніж написати перший рядок коду, варто приділити хвилину «чому».

Google Trends — це щось справді рідкісне в інтернеті:

вікно в реальному часі з публічним доступом до того, про що активно думають, що шукають і чому приділяють увагу мільйони людей.

Не опитування.

Не самозвітна поведінка.

Фактичні пошукові запити, агреговані та проіндексовані як сигнали відносного інтересу, оновлюються безперервно.

Це надзвичайне джерело даних. Проблема — в інтерфейсі.

Вебсайт Google Trends створений для невимушеного дослідження. Ви можете ввести ключове слово, подивитися на графік і сформувати приблизне уявлення про те, як змінювався інтерес.

Чого ви не можете зробити через вебсайт — це одночасно витягнути тижневі дані про інтерес по 200 ключових словах, відстежувати, коли нові теми починають зростати, порівнювати географічний попит у 40 ринках або інтегрувати сигнали Trends в автоматизований контентний чи бізнес-аналітичний конвеєр.

Парсинг вирішує саме цей розрив. Він перетворює інструмент, створений для індивідуальної цікавості, на масштабовану інфраструктуру даних.

Коротко:

Найнадійніший спосіб парсити дані Google Trends у 2026 році — це pytrends, неофіційна бібліотека Python, яка взаємодіє з внутрішнім API Trends від Google, без потреби в API-ключі.

Для парсингу більших обсягів або складніших вимог автоматизація браузера через Playwright пропонує більше гнучкості.

Обидва методи вимагають ротації резидентських проксі у значному масштабі, щоб уникнути обмеження швидкості на основі IP.

Дані Google Trends є публічно доступними, легально доступними для аналізу та щодня використовуються SEO-фахівцями, контент-маркетологами, дослідниками та фінансовими аналітиками по всьому світу.

Хто насправді використовує це у масштабі:

Власник Shopify -магазину помітила через Google Trends, що інтерес до «Stanley cup tumbler» почав різко зростати в жовтні 2022 року, приблизно за шість тижнів до того, як це стало культурним феноменом.

Вона потроїла свій асортимент аксесуарів за собівартістю. Її конкуренти, які відстежували той самий тренд вручну, відреагували через шість тижнів після того, як пік пошукового сплеску вже минув. Вона захопила сплеск попиту; вони гналися за ним.

Ось що насправді дає програмний доступ до Google Trends реальним людям. Та сама логіка застосовується до SEO -пріоритизації ключових слів, редакційних контент-календарів, аналізу фінансових настроїв, академічних досліджень та конкурентної розвідки.

Дані є. Питання в тому, чи отримуєте ви до них доступ систематично чи випадково.

Чи законно парсити Google Trends

Пряма відповідь: Парсинг Google Trends не є незаконним за законодавством Сполучених Штатів, Європейського Союзу, Великої Британії чи більшості інших великих юрисдикцій. Це може суперечити Умовам використання Google, які широко забороняють автоматизований доступ, але це договірне питання, а не кримінальне, і правозастосування проти окремих дослідників чи аналітиків фактично відсутнє.

Давайте розглянемо це в контексті, а не залишимо розпливчастим:

Computer Fraud and Abuse Act у США, Computer Misuse Act у Великій Британії та GDPR в ЄС — усі вони стосуються несанкціонованого доступу до систем та захисту персональних даних.

Парсинг публічно доступних, анонімізованих агрегованих даних з Google Trends суттєво не стосується жодної з цих правових рамок.

Рішення Дев'ятого окружного суду США 2022 року у справі HiQ Labs проти LinkedIn встановило, що парсинг публічно доступних даних — даних, які не вимагають входу чи автентифікації для перегляду — не є порушенням CFAA.

Умови використання Google — це окреме питання. Це договір між вами та Google, а не закон. Їх порушення може призвести до блокування IP або припинення обслуговування — технічних наслідків, а не юридичних.

Прагматична структура, яку використовують професіонали:

Обмежуйте запити. Не надсилайте сотні запитів за хвилину. Розумний автоматизований доступ імітує людську поведінку.

Збирайте те, що потрібно для аналізу. Не архівуйте весь набір даних без мети.

Не поширюйте необроблені зібрані дані комерційно. Саме тут питання ліцензування стають реальними.

Використовуйте дані для отримання інсайтів. Контент-стратегія, дослідження та бізнес-аналітика — це цілі, для яких Google Trends був розроблений, щоб інформувати.

Переважна більшість SEO-фахівців, журналістів, науковців та аналітиків даних, які збирають дані з Google Trends, роблять це щодня без інцидентів. Ризик реальний теоретично, але незначний на практиці для легітимних випадків використання.

Розуміння того, що таке дані Google Trends

Перед написанням коду важливо розуміти, що ви витягуєте, оскільки дані Google Trends мають особливість, яка бентежить початківців і розчаровує користувачів середнього рівня.

Google Trends не показує абсолютні обсяги пошуку:

Він показує відносний інтерес, оцінку від 0 до 100, де 100 представляє піковий інтерес у вибраному вами часовому проміжку та географії.

50 означає половину піку.

0 означає недостатньо даних для відображення.

Це навмисно нормалізовані дані.

Google не публікує необроблені підрахунки обсягу пошуку через Trends.

Що це означає практично:

Якщо ви витягуєте дані для «електромобілі» за 5 років, оцінка пікового тижня становить 100.

Кожен інший тиждень оцінюється відносно цього піку.

Якщо потім ви витягнете окремий запит для «сонячні панелі» за той самий період, його пік також оцінюється як 100, навіть якщо абсолютний обсяг пошуку для «сонячні панелі» становив лише десяту частину від «електромобілі».

Це проблема нормалізації. Вона робить порівняння запитів у межах одного витягування даних значущим, але ненадійним для окремих витягувань даних.

Рішення: Завжди порівнюйте ключові слова в межах одного виклику pytrends build_payload(). Включення послідовного «якірного» ключового слова (з стабільним, добре зрозумілим обсягом пошуку) у кожну партію дозволяє нормалізувати дані в декількох витягуваннях.

Наприклад, включення «погода», ключового слова з послідовним, передбачуваним обсягом пошуку, як якоря в кожній партії дозволяє калібрувати відносний інтерес порівняно в різних запитах.

Порівняння методів: Який підхід до збору даних підходить вам

Перед тим як заглибитися в кожен метод, ось таблиця рішень:

Метод | Складність | Надійність | Швидкість | Найкращий випадок використання | Основне обмеження |

pytrends (бібліотека Python) | Початківець | Висока | Швидко | Більшість стандартних випадків використання | Обмеження швидкості при великих обсягах |

Прямі HTTP-запити | Середній | Середня– Висока | Швидко | Налаштовувані параметри, пакетна обробка | Потрібне керування заголовками/cookies |

Автоматизація браузера (Playwright) | Просунутий | Дуже висока | Повільно | Складні сторінки, уникнення CAPTCHA | Ресурсо- ємний |

No-code платформи (Apify тощо) | Початковий | Середня | Змінна | Не-розробники, швидкий експорт | Постійна вартість підписки |

Ручний експорт CSV | Жодної | Ідеальна | Дуже повільно | Одноразовий малий набір даних | Не масштабується |

Почніть з pytrends. Переходьте до автоматизації браузера лише тоді, коли pytrends постійно не справляється з вашим конкретним випадком використання.

Метод 1: Pytrends

Пряма відповідь: pytrends — це неофіційна бібліотека Python , яка взаємодіє з внутрішнім APIданих Google Trends. Вона не потребує API-ключа, встановлюється за лічені секунди та виконує найпоширеніші завдання з витягування даних з мінімальним кодом. Це правильна відправна точка практично для всіх.

Що таке Pytrends

pytrends (спочатку створена користувачем GeneralMills, зараз підтримується спільнотою з відкритим кодом) доступна як на GitHub, так і на PyPI.

Він абстрагує внутрішні кінцеві точки Google Trends у чисті виклики функцій Python, автоматично обробляючи файли cookie автентифікації, форматування запитів та розбір відповідей.

Це не офіційний продукт Google. Google його не підтримує.

Але він надійно працює для переважної більшості стандартних випадків використання і активно використовується з 2015 року, з постійною підтримкою спільноти до 2026 року.

Встановлення pytrends: bash

pip install pytrends

Потрібен Python 3.7 або новіший. Це все, що потрібно для встановлення.

Ваше перше отримання даних

Цей скрипт отримує тижневі дані про інтерес для одного ключового слова за останні 12 місяців:

from pytrends.request import TrendReq

# Initialize — hl sets the language, tz sets the timezone offset

pytrends = TrendReq(hl='en-US', tz=360)

# Build the payload — specify up to 5 keywords here

pytrends.build_payload(

kw_list=['artificial intelligence'],

timeframe='today 12-m',

geo='' # Empty string = worldwide

)

# Pull interest over time

data = pytrends.interest_over_time()

print(data.head(10))Запустіть це, і ви отримаєте pandas DataFrame — таблицю з датами як індексом рядків і тижневими показниками інтересу (0–100) як значеннями. Колонка isPartial вказує на тижні, які ще не повністю проіндексовані; відфільтруйте її для чистого аналізу:

data = data[data['isPartial'] == False]Порівняння кількох ключових слів

Одна з найпотужніших функцій pytrends — пряме порівняння ключових слів, до п'яти ключових слів одночасно, нормалізованих до однієї 100-бальної шкали:

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

kw_list=['ChatGPT', 'Gemini', 'Claude AI', 'Copilot'],

timeframe='today 12-m',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Which platform has the highest average interest?

print(data[['ChatGPT', 'Gemini', 'Claude AI', 'Copilot']].mean())Ці порівняльні дані справді стратегічні. Якщо ви створюєте контент у сфері AI-інструментів, знання того, інтерес до якої платформи зростає, а до якої стабілізується, показує вам, куди активно переміщується увага аудиторії, ще до того, як цей зсув стане помітним в будь-якому іншому джерелі даних.

Географічні дані про інтерес

Де у світі зосереджений інтерес? Це отримує дані на рівні країн:

pytrends.build_payload(

kw_list=['electric vehicles'],

timeframe='today 12-m'

)

# Country-level interest

by_country = pytrends.interest_by_region(resolution='COUNTRY', inc_low_vol=True)

# Sort by interest descending

print(by_country.sort_values('electric vehicles', ascending=False).head(20))

Для регіональної деталізації в межах однієї країни (штати США, регіони Великобританії) налаштуйте параметр resolution:

by_state = pytrends.interest_by_region(resolution='REGION', geo='US')Це неоціненно для бізнесів, які приймають рішення про географічну експансію, або рекламодавців, які розподіляють регіональні бюджети.

Зростаючі пов'язані запити: найменш використовувана функція

Ось де Google Trends стає справжнім інструментом контент-аналітики:

python

pytrends.build_payload(

kw_list=['remote work tools'],

timeframe='today 3-m'

)

related = pytrends.related_queries()

# Rising queries — growing fastest relative to their usual volume

print(related['remote work tools']['rising'])

# Top queries — highest absolute interest

print(related['remote work tools']['top'])Зростаючі пов'язані запити показують, що люди шукають поряд з вашим ключовим словом, що найшвидше зростає за обсягом. Для контент-маркетологів це від трьох до шести тижнів випереджувальної інформації про ключові слова. Опублікуйте матеріал про зростаючий пов'язаний запит до того, як він досягне піку інтересу, і ваш контент буде позиціонований під криву попиту, а не гнатиметься за нею.

Трендові пошуки в реальному часі

Для моніторингу того, що зараз у тренді:

trending_today = pytrends.trending_searches(pn='united_states')

print(trending_today.head(20))Це повертає топ-20 трендових пошуків у зазначеній країні на момент запиту. Корисно для моніторингу новин, стратегій реактивного контенту та визначення трендів у соціальних мережах.

Метод 2: Прямі HTTP-запити

Пряма відповідь: Прямі HTTP-запити дають вам детальний контроль над параметрами запиту, заголовками та управлінням сесіями, які pytrends абстрагує. Це підходить для досвідчених користувачів, яким потрібні власні формати часових рамок, точна фільтрація категорій або управління пакетними запитами великого обсягу.

Під капотом pytrends робить GET-запити до внутрішніх кінцевих точок Google Trends, переважно:

https://trends.google.com/trends/api/widgetdata/multiline

https://trends.google.com/trends/api/explore

Ці кінцеві точки повертають JSON-дані з префіксом захисту ()]}'), який потрібно видалити перед розбором.

Вони також вимагають певних файлів cookie сесії та заголовків, які сервер Google перевіряє.

Ось робочий шаблон із використанням бібліотеки requests:

import requests

import json

session = requests.Session()

# First, establish a session by visiting the main Trends page

session.get('https://trends.google.com/')

# The explore endpoint generates widget tokens for data requests

params = {

'hl': 'en-US',

'tz': '-360',

'req': json.dumps({

"comparisonItem": [

{"keyword": "python programming", "geo": "", "time": "today 12-m"}

],

"category": 0,

"property": ""

}),

'token': '',

'user_type': ''

}

response = session.get(

'https://trends.google.com/trends/api/explore',

params=params

)

# Strip the protection prefix before parsing

clean_response = response.text.lstrip(")}']\n")

data = json.loads(clean_response)Це складніше, ніж PyTrends, але дає вам точний контроль над кожним аспектом запиту. Більшості користувачів не потрібен такий рівень контролю, але для продакшн-пайплайнів зі специфічними вимогами до пакетної обробки або нестандартними форматами часових діапазонів це правильний підхід.

Метод 3: Автоматизація браузера за допомогою Playwright

Пряма відповідь: Playwright автоматизує справжній браузер, роблячи вашу поведінку скрейпінгу практично невідрізнимою від справжнього людського перегляду. Це найнадійніший метод уникнути обмежень швидкості та CAPTCHA, але він значно повільніший і більш ресурсномісткий, ніж підходи на основі API.

Коли використовувати Playwright замість pytrends:

pytrends повертає постійні помилки 429, навіть із проксі та затримками

Вам потрібно захопити візуальні або інтерактивні елементи сторінки, які не доступні через API

Вам потрібно обробляти виклики CAPTCHA (з відповідними сторонніми розв'язувачами)

Ви скрейпите нішеві сторінки Trends зі складними шаблонами навігації

Надійне налаштування Playwright:

from playwright.sync_api import sync_playwright

import time

with sync_playwright() as p:

# Launch browser — headless=False for debugging, True for production

browser = p.chromium.launch(headless=True)

# Create a context with realistic browser settings

context = browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36',

viewport={'width': 1280, 'height': 800}

)

page = context.new_page()

# Navigate to Trends

page.goto('https://trends.google.com/trends/explore?q=python+programming&date=today+12-m&geo=US')

# Wait for the data chart to render

page fully

.wait_for_selector('[class*="widget"]', timeout=10000)

# Add human-like delay

time.sleep(3)

# Extract page content for parsing

content = page.content()

# Alternatively, intercept the API response directly

# This is more reliable than parsing HTML

browser.close()

print("Data extracted successfully")Більш витончений підхід перехоплює мережеві запити, які Playwright робить під час завантаження сторінки, захоплюючи відповідь API безпосередньо, а не парсячи відрендерений HTML. Це поєднує переваги прихованості автоматизації браузера з чистішим форматом даних відповідей API. [Читайте про документацію playwright Python]

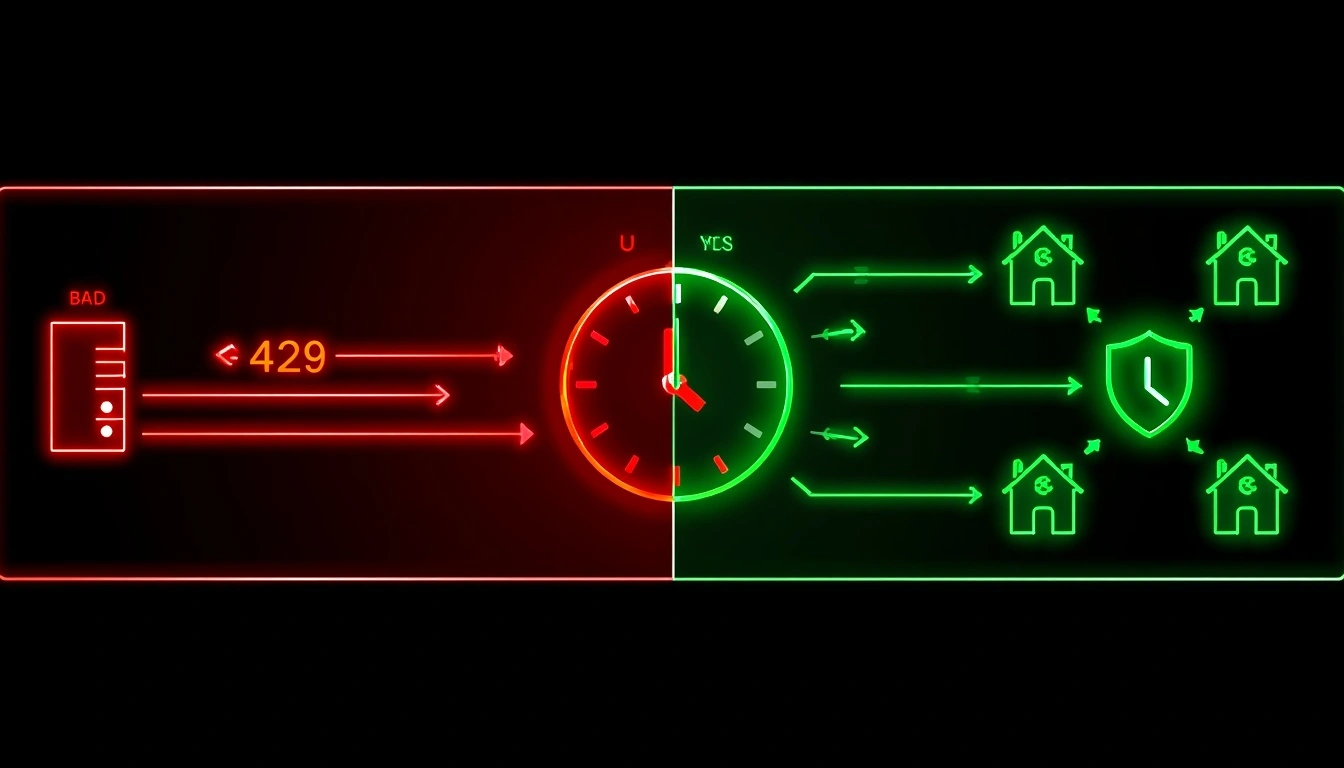

Чому виникають обмеження швидкості та як з ними впоратися

Це розділ, який пропускає більшість туторіалів, і саме тому новачки застрягають після перших кількох успішних запитів.

Google Trends має обмеження швидкості на основі IP. Надішліть забагато запитів за короткий проміжок часу з однієї IP-адреси, і ви почнете отримувати помилки 429 (Забагато запитів). На деяких конфігураціях ви отримаєте виклик CAPTCHA замість цього. Жодне з цього не означає, що ваш код зламаний; це означає, що ви активували автоматизоване керування трафіком Google.

Рішення 1: Додайте затримки запитів

Найпростіше виправлення. Виклик time.sleep() між запитами дозволяє системам Google скинути їхній лічильник на IP:

import time

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

keywords = [

'content marketing', 'SEO strategy', 'link building',

'technical SEO', 'keyword research', 'on-page SEO'

]

results = {}

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m')

results[keyword] = pytrends.interest_over_time()

print(f"✓ {keyword}")

time.sleep(15) # 15 seconds between requests

print("All keywords retrieved.")Для пакетних завдань до 50 ключових слів на сесію зазвичай достатньо затримок 10–15 секунд. Для більших пакетів збільште до 30–60 секунд і розділіть на кілька сесій.

Рішення 2: Ротаційні резидентські проксі

Для автоматизації великих обсягів ротація IP є правильним архітектурним рішенням. Кожен запит проходить через іншу IP-адресу, тому жодна окрема IP-адреса не накопичує достатньо запитів, щоб викликати обмеження швидкості.

Не всі проксі однакові для цього випадку використання.

Google підтримує великі списки діапазонів IP датацентрів: AWS, Google Cloud, DigitalOcean, Vultr, і обмежує трафік з цих джерел набагато агресивніше, ніж трафік з резидентських адрес.

Використання проксі датацентру для скрейпінгу Google часто взагалі не надає жодного значущого захисту.

Резидентські проксі спрямовують трафік через IP-адреси, призначені реальним клієнтам провайдерів, домашнім інтернет-з'єднанням і мобільним пристроям.

Для систем Google цей трафік невідрізнимий від справжніх користувачів.

Використання проксі CyberYozh для стабільного скрейпінгу Google Trends

Пряма відповідь: Резидентські проксі запобігають обмеженню швидкості Google Trends, розподіляючи запити між тисячами різних резидентських IP-адрес. CyberYozh пропонує ротаційні резидентські та мобільні проксі з можливостями геотаргетингу, особливо добре підходять для автоматизації Google Trends.

Інтеграція проксі CyberYozh у робочий процес pytrends:

from pytrends.request import TrendReq

import time

import random

# CyberYozh proxy configuration

proxy_config = {

'https': 'https://USERNAME:PASSWORD@gate.cyberyozh.com:PORT'

}

# Initialize pytrends with proxy support

pytrends = TrendReq(

hl='en-US',

tz=360,

requests_args={

'proxies': proxy_config,

'verify': True

}

)

keywords = ['machine learning', 'deep learning', 'neural networks',

'computer vision', 'natural language processing']

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m', geo='US')

data = pytrends.interest_over_time()

print(f"Retrieved: {keyword} — {len(data)} weeks of data")

time.sleep(random.uniform(8, 20)) # Randomize delays to mimic human behaviorrandom .uniform(8, 20) рандомізація затримки є важливою; передбачувано однакові інтервали (рівно 10 секунд щоразу) самі по собі можуть бути ідентифіковані як автоматизована поведінка складним аналізом трафіку.

Географічне таргетування для даних Trends:

Одне з часто упущених застосувань географічного таргетування проксі — отримання даних Trends, що відображають справжню локальну поведінку пошуку.

Google Trends калібрує відносний інтерес на основі географії запиту в деяких конфігураціях.

Резидентська IP-адреса США, що запитує дані для географічного параметра США, дає більш послідовні результати, ніж IP-адреса поза США.

Таргетування IP на рівні країни від CyberYozh підтримує цей випадок використання нативно, що корисно для агентств, які проводять аналіз Trends для кількох ринків, або дослідників, яким потрібні географічно репрезентативні дані.

Перегляньте каталог проксі CyberYozh для найдоступніших і найнадійніших IP-адрес у всьому світі.

Для скрейпінгу на основі Playwright конфігурація проксі дещо відрізняється:

python

from playwright.sync_api import sync_playwright

with sync_playwright() as p:

browser = p.chromium.launch(

headless=True,

proxy={

"server": "https://gate.cyberyozh.com:PORT",

"username": "USERNAME",

"password": "PASSWORD"

}

)

# ... rest of automation codeПроблема нормалізації: як порівнювати дані з кількох запитів

Це питання, яке найбільше спантеличує користувачів середнього рівня, і воно рідко пояснюється в посібниках конкурентів.

Google Trends нормалізує дані в межах кожного запиту.

Точка найвищого інтересу у вказаному вами часовому проміжку завжди дорівнює 100.

Це має сенс для візуалізації траєкторії одного ключового слова.

Це створює проблему, коли ви хочете порівняти два ключові слова, які були отримані в окремих запитах.

Сценарій: Ви отримуєте дані для «ключового слова A» і бачите пік 100 у березні. Потім ви окремо отримуєте дані для «ключового слова B» і також бачите пік 100 у березні. Чи означає це, що вони мали однаковий обсяг пошуку? Майже напевно ні. Вони просто випадково досягли своїх відповідних піків.

Техніка нормалізації опорного ключового слова:

Включайте стабільне еталонне ключове слово в кожну партію — таке, що має зрозумілий, стабільний обсяг пошуку. Зазвичай використовуються такі опорні слова, як «Facebook», «YouTube» або «weather» — ключові слова, які підтримують відносно стабільний інтерес пошуку місяць за місяцем.

from pytrends.request import TrendReq

import pandas as pd

import time

pytrends = TrendReq(hl='en-US', tz=360)

# Batch 1: Compare keyword sets against anchor

batch_1 = ['Facebook', 'content marketing', 'email marketing', 'social media marketing']

batch_2 = ['Facebook', 'SEO', 'PPC advertising', 'influencer marketing']

pytrends.build_payload(batch_1, timeframe='today 12-m', geo='US')

data_1 = pytrends.interest_over_time()[batch_1]

time.sleep(15)

pytrends.build_payload(batch_2, timeframe='today 12-m', geo='US')

data_2 = pytrends.interest_over_time()[batch_2]

# Now normalize both datasets against the anchor (facebook)

# The anchor's values are comparable across batches because they were in both

anchor = 'facebook'

data_1_normalized = data_1.div(data_1[anchor], axis=0)

data_2_normalized = data_2.div(data_2[anchor], axis=0)

# Now you can meaningfully compare any keyword from batch 1 with any from batch 2

print("Normalized comparison:")

print(pd.concat([

data_1_normalized.drop(columns=[anchor]),

data_2_normalized.drop(columns=[anchor])

], axis=1).mean())

Професійні аналітики даних використовують цю техніку, і вона рідко документується у вступних посібниках. Вона дає можливість порівнювати десятки ключових слів у кількох пакетних запитах із значущими, порівнянними результатами.

Реальні випадки використання: що ви насправді робите з цими даними

Дані без застосування — це просто цікава таблиця. Ось як виглядає змістовний аналіз Google Trends на практиці:

Оптимізація контент-календаря

Щотижня отримуйте зростаючі пов'язані запити для ваших основних тематичних кластерів.

Коли пов'язане ключове слово перевищує 40+ за шкалою 0–100 і продовжує зростати, негайно опублікуйте сфокусований матеріал на цю тему.

Орієнтуйтеся на криву зростання, а не на пік.

Планування сезонних запасів і витрат на рекламу

П'ять років щотижневих даних про інтерес виявляють сезонні закономірності з вражаючою надійністю.

Роздрібний продавець садових меблів може точно побачити, коли весняний інтерес починає зростати на їхніх цільових ринках, зазвичай за 4–6 тижнів до піку купівельної поведінки, і відповідно планувати свої платні кампанії.

Пріоритизація SEO-ключових слів

Перш ніж інвестувати в контент-кампанію для цільового ключового слова, перевірте його траєкторію.

Ключове слово з 30 000 щомісячних пошуків і зростаючою траєкторією Trends є кращою інвестицією, ніж слово з 50 000 пошуків і спадною траєкторією.

Ви інвестуєте в зростаючий ринок, а не в той, що скорочується.

Конкурентна брендова аналітика

Відстежуйте інтерес до брендованих пошукових запитів ваших конкурентів з плином часу.

Стабільне зростання брендованих пошуків конкурента — це сигнал раннього попередження, більш інформативний, ніж їхні опубліковані показники, і доступний у реальному часі.

Індикатори фінансових настроїв

Пошуковий інтерес до категорій на кшталт «рефінансування іпотеки», «рецесія», «звільнення» та «підробіток» слугує випереджальним індикатором споживчих настроїв.

Великі хедж-фонди та інститути економічних досліджень використовують Google Trends як один із вхідних параметрів у ширших моделях економічного прогнозування.

Академічні та журналістські дослідження

Кількісна оцінка суспільної уваги до новинних подій, політичних змін, публічних осіб та культурних моментів з плином часу надає перевірені, цитовані докази патернів колективного інтересу, які є більш об'єктивними, ніж редакційне судження.

Експорт та візуалізація даних Google Trends

Після отримання даних найпоширенішими наступними кроками є експорт та візуалізація:

from pytrends.request import TrendReq

import matplotlib.pyplot as plt

import pandas as pd

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

['AI tools', 'automation software'],

timeframe='today 5-y',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Export to CSV for spreadsheet analysis

data.to_csv('google_trends_export.csv')

print("CSV exported successfully.")

# Create a clean visualization

fig, ax = plt.subplots(figsize=(14, 6))

data['AI tools'].plot(ax=ax, label='AI Tools', color='#2563EB', linewidth=2)

data['automation software'].plot(ax=ax, label='Automation Software', color='#7C3AED', linewidth=2)

ax.set_title('Search Interest Comparison: AI Tools vs Automation Software (5 Years, US)',

fontsize=14, fontweight='bold', pad=20)

ax.set_ylabel('Interest Score (0–100)', fontsize=11)

ax.set_xlabel('')

ax.legend(fontsize=11)

ax.grid(True, alpha=0.3)

ax.set_ylim(0, 110)

plt.tight_layout()

plt.savefig('trends_comparison.png', dpi=150, bbox_inches='tight')

plt.show()Для команд, які надають перевагу електронним таблицям перед Python, експорт CSV повністю сумісний з Excel та Google Sheets. Структура pandas DataFrame чітко відображається у табличних форматах, з датами у стовпці A та значеннями інтересу до ключових слів у наступних стовпцях.

Усунення найпоширеніших помилок та способи їх виправлення

Помилка: 429 Too Many Requests Ви перевищили ліміт запитів Google на IP-адресу. Додайте або збільште затримки time.sleep() між запитами (почніть з 15–30 секунд). Для стійких помилок 429 на будь-якому рівні затримки впровадьте ротаційні резидентські проксі.

Помилка: ResponseError 500. Зазвичай це тимчасова проблема сервера на стороні Google. Зачекайте 5–10 хвилин та повторіть спробу. Іноді викликається неправильно сформованими параметрами payload, перевірте формат рядка часового діапазону ('today 12-m', 'today 3-m', '2022-01-01 2023-12-31').

Повернуто порожній DataFrame. Ваше ключове слово має недостатній обсяг пошуку для вказаної географії чи часового діапазону. Спробуйте розширити параметр geo, встановивши його на (порожній рядок для всього світу) або продовжте часовий діапазон. Деякі дуже специфічні довгі ключові слова просто не мають достатньо даних для повернення результатів.

Запущено виклик CAPTCHA, Google підозрює автоматизований доступ. Перейдіть на резидентські проксі, істотно збільште затримки та зменшіть обсяг запитів на сесію. Автоматизація браузера з Playwright більш стійка до викликів CAPTCHA, ніж прямі API-запити.

Не вдається встановити pytrends. Переконайтеся, що встановлено Python 3.7+: python --version. Спробуйте спочатку оновити pip: pip install --upgrade pip, потім pip install pytrends.

Лише часткові дані (isPartial = True для більшості рядків). Останні 2–3 дні даних Trends завжди часткові; Google ще не повністю проіндексував їх. Відфільтруйте ці рядки: data = data[data['isPartial'] == False].

Крос-батч нормалізація дає непослідовні результати. Дивіться розділ про нормалізацію опорних ключових слів вище. Завжди включайте стабільне опорне ключове слово в кожну партію, щоб забезпечити змістовне порівняння між партіями. [Читайте більше про помилку 499 та помилку 520]

Відібрані ресурси на GitHub

Замість того, щоб «шукати на GitHub і ви знайдете щось корисне», ось конкретні ресурси, які варто додати до закладок:

Офіційний репозиторій pytrends: Канонічний довідник для документації методів, відомих проблем та журналу змін. Вкладка Issues містить рішення для переважної більшості помилок у крайніх випадках.

Проєкти панелей управління трендовими пошуками: кілька репозиторіїв, що підтримуються спільнотою, будуються на pytrends для створення панелей управління трендовими ключовими словами в реальному часі. Шукайте «pytrends dashboard» на GitHub для найбільш актуальних варіантів.

Утиліти нормалізації даних трендів: репозиторії, спеціально присвячені проблемі крос-батч нормалізації, обговореній вище. Шукайте «Google Trends normalization Python», щоб знайти варіанти з найбільшою кількістю зірок.

Скрейпер Google Trends від Apify: Для не-розробників, яким потрібні дані Google Trends без написання коду, підтримуваний актор Google Trends від Apify надає інтерфейс без коду з запланованими запусками та експортом даних. Вартість варіюється залежно від обсягу використання.

Побудуйте конвеєр один раз, використовуйте його назавжди

Google Trends — одне з небагатьох справді безкоштовних, справді потужних джерел даних, які більшість людей використовують лише на 10% від його потенціалу. Одноразова інвестиція в налаштування конвеєра pytrends, навіть базового, що запускається щотижня за розкладом, дає вам безперервну систему раннього попередження про зростаючі теми, зміни інтересів аудиторії та динаміку конкуренції, що виникає.

Налаштуйте основи сьогодні. Додавайте інфраструктуру проксі в міру зростання вашого обсягу. І почніть ставитися до публічної пошукової поведінки як до стратегічного розвідувального активу, яким вона насправді є, а не як до чогось, що ви перевіряєте вручну, коли згадуєте про це.

Дані оновлюються безперервно. Чи звертаєте ви на них увагу — єдина змінна, яку ви контролюєте.