Автоматизація веб-скрейпінгу: Як запускати скрейпери за розкладом

Розглянемо технічні особливості автоматизації веб-скрейпінгу, процесу, на який покладаються багато компаній для отримання високоякісних даних, будь то дослідження ринку, інформація про SEO/SERP або думки клієнтів. Важливий елемент цього процесу полягає в тому, що більшість сервісів швидко блокують і обмежують множинні запити в короткі періоди часу, що неминуче при автоматизованому скрейпінгу. Тому необхідно розподіляти навантаження запитів між кількома IP-адресами, використовуючи ротуючі проксі.

Що таке автоматизація веб-скрейпінгу

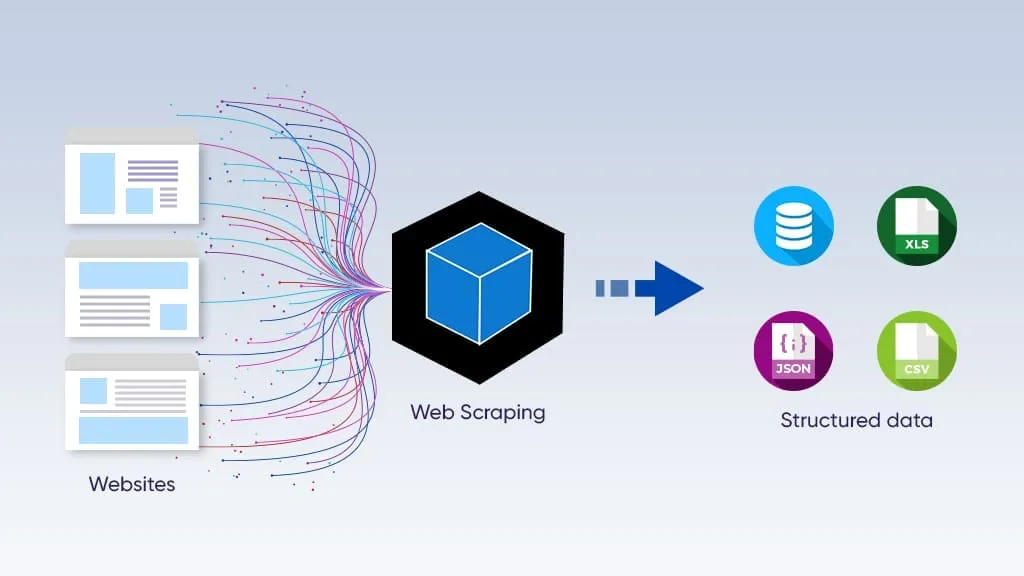

Автоматизація веб-скрейпінгу — це програмований процес підключення до веб-серверів і вилучення даних з них без ручної роботи. Все, що необхідно — налаштувати веб-скрейпер і вказати інструкції для нього. Після цього він виконує всю роботу самостійно. Зазвичай результуючі файли даних — це таблиці у форматі .csv або .json, або файли баз даних, які можна обробляти за допомогою SQL-запитів.

Критично важливо пам'ятати, що платформи часто обмежують масові автоматизовані потоки запитів, типові для веб-скрейпінгу. Ось чому проксі так необхідні для цього процесу. Дізнайтеся більше про сервіси ротації IP і про те, як їх використовувати, щоб уникнути блокувань та обмежень.

Підходи до автоматизації веб-скрейпінгу

Існує два основних підходи до автоматизації веб-скрейпінгу: використання No-code платформ для його налаштування або написання скриптів Python зі спеціалізованими бібліотеками та фреймворками.

Інструменти без коду/з низьким кодом

Ці інструменти пропонують візуальні інтерфейси, які можна використовувати без знання програмування. Воно, тим не менше, може допомогти, оскільки деякі з цих платформ дозволяють налаштування через програмування. Користувачі визначають правила скрейпінгу, клацаючи на елементи сторінки, встановлюючи логіку паґінації та налаштовуючи формати виводу, такі як CSV або JSON, через графічний інтерфейс.

Вони легко налаштовуються, але мають багато обмежень:

Скрейпери без коду легко перестають працювати, коли цільовий веб-сайт змінює свою структуру.

Вони відчувають труднощі з динамічними сторінками, насиченими JavaScript, або користувацькою бізнес-логікою.

Вони стають дорогими при масштабуванні, і їх складно налаштовувати.

Ці інструменти в основному використовуються маркетологами, бізнес-аналітиками, менеджерами електронних магазинів і підприємцями. Однак програмні рішення краще підходять для крупномасштабного скрейпінгу.

Програмні рішення

Ці інструменти — бібліотеки та фреймворки, в основному для Python, найширше використовуваної мови програмування. Програмний скрейпінг дає розробникам повний, детальний контроль над кожним аспектом процесу вилучення, від того, як відправляються HTTP-запити, до того, як дані аналізуються, зберігаються і плануються.

Основне обмеження — технічний бар'єр: створення, підтримка та планування скрейперів виробничого рівня вимагає навичок програмування, часу на налагодження та рішень щодо інфраструктури. Цей підхід використовується інженерами даних, розробниками бекенду, фахівцями з науки про дані та growth-хакерами, яким потрібні надійність, налаштування та програмованість.

Веб-автоматизаційні проксі та чому вони необхідні

Більшість веб-сайтів, виключаючи великі відкриті бази даних (які зазвичай розроблені саме для скрейпінгу), обмежують кількість запитів з однієї IP-адреси. Коли користувач перевищує ліміт, платформа починає показувати CAPTCHA або тимчасово блокує користувача при частих порушеннях. Крім того, платформи відстежують запити, їхні IP-адреси та інші відбитки (такі як дані браузера), щоб знайти невідповідності та помічають підозрілі адреси навіть якщо вони не перевищують ліміт. Тому чистий пул IP-адрес проксі та антидетект-браузинг так необхідні тут.

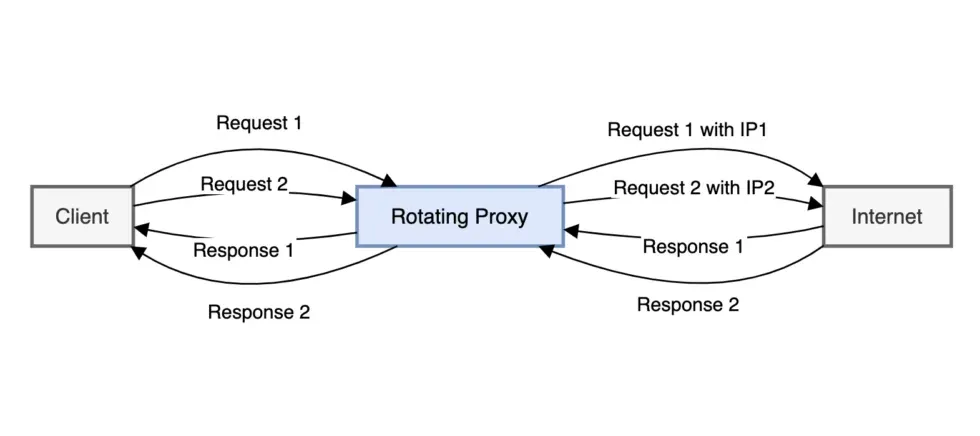

Ротація проксі означає, що кожен запит (або група запитів) відправляється з різних IP-адрес з одного пулу. В основному існує два типи ротуючих проксі:

Мобільні проксі використовують IP-адреси від постачальників мобільного інтернету (LTE/5G) і мають найвищий рівень довіри, оскільки платформи не розрізняють їх від користувачів мобільного інтернету. Вони найкраще підходять для скрейпінгу даних соціальних мереж.

Резидентські ротуючі проксі використовують пул резидентських IP-адрес і ротують між ними відповідно до попередньо встановленого алгоритму. Їхній рівень довіри нижчий, але все ще хороший для більшості платформ, і вони є хорошим варіантом для більшості завдань веб-скрейпінгу.

Перед використанням будь-якої IP-адреси її якість повинна бути оцінена за допомогою IP Checker від CyberYozh, який відображає її Fraud Score.

Антидетектні браузери додатково підвищують безпеку, надаючи окремий набір цифрових відбитків для кожної сесії. У поєднанні з чистою IP-адресою кожна сесія виглядає як справжня цифрова особистість, і ймовірність блокувань і викликів CAPTCHA значно зменшується.

Дізнайтеся більше про антидетекцію і про те, як вона працює.

Які найбільш надійні сервіси веб-скрейпінгу та автоматизації

Автоматизація веб-скрейпінгу включає використання різних інструментів і методів для планування та запуску завдань вилучення без ручного втручання. Найкращий метод залежить від ваших знань програмування, складності цільового веб-сайту та бажаного масштабу операції. Незалежно від методу, необхідно комбінувати ваш скрейпер з ротуючими проксі, щоб переконатися, що ваші сесії не будуть заблоковані.

Спеціалізовані платформи без коду

Спеціально розроблені платформи скрейпінгу об'єднують візуальні конструктори скрейперів з хмарною інфраструктурою, вбудованим плануванням, ротацією проксі та обробкою CAPTCHA без необхідності програмування.

Octoparse це конструктор скрейперів з точкою й клацанням, хмарним виконанням, автоматичним виявленням шаблонів і запланованими запусками для електронної комерції та даних про потенційних клієнтів.

Apify пропонує маркетплейс з 1500+ готових скрейперів «Actors» для популярних сайтів з хмарним хостингом і виводом API.

Browse.ai спеціалізується на моніторингу веб-сайтів; він виявляє зміни та запускає сповіщення без ручної переконфігурації.

Web Scraper розширення — це браузерний скрейпер, зручний для початківців, з хмарним плануванням для простого вилучення структурованих даних.

Найкраще підходить для маркетологів, аналітиків і бізнес-команд, яким потрібен повторюваний збір даних без ресурсів розробників.

Платформи автоматизації

Інструменти автоматизації загального призначення підключають етапи веб-скрейпінгу до ширших бізнес-процесів, спрямовуючи вилучені дані в CRM, електронні таблиці або інструменти обміну повідомленнями.

Zapier підключає тригери скрейпінгу до 6000+ додатків; ідеальний для легких передач даних, таких як нові оголошення → Slack або Google Sheets.

n8n це конструктор робочих процесів з відкритим вихідним кодом і самостійним хостингом з вузлами HTTP-запитів, пропонуючи більше контролю та користувацької логіки, ніж Zapier.

Ці платформи підходять для операційних команд, які хочуть негайно діяти на основі завантажених даних: автоматизувати сповіщення, маршрутизацію потенційних клієнтів або конвеєри звітності, а не просто зберігати їх.

Бібліотеки Python

Бібліотеки Python дають розробникам повний програмний контроль над логікою скрейпінгу, плануванням та обробкою даних, від простого аналізу HTML до повної автоматизації браузера.

Scrapy це виробничий фреймворк для краулінгу зі вбудованими конвеєрами, проміжними шарами та плануванням для вилучення даних великого обсягу. Встановіть його за допомогою pip командою pip install scrapy

BeautifulSoup + Requests це легка комбінація для аналізу статичних HTML-сторінок; вона швидка в прототипуванні, але обмежена для динамічних сайтів.

Playwright/Puppeteer/Selenium — це все інструменти автоматизації браузера без інтерфейсу, які обробляють рендеринг JavaScript, взаємодію користувача та складні потоки входу.

Переважний вибір для розробників і інженерів даних, які створюють користувацькі масштабовані конвеєри, що вимагають точного контролю над проксі, обробкою помилок та подальшою обробкою даних.

Запуск планувальника для автоматичного управління скрейперами

Після налаштування інструменту скрейпінгу його діяльність також повинна бути автоматизована. Скрейпер автоматизує вилучення веб-даних, але інший інструмент, який називається планувальником, автоматизує, коли скрейпер повинен працювати і коли він повинен бути неактивним. Також можливо включати й вимикати його вручну, але планувальники забезпечують більший контроль і точність, що, як ми вже бачили, має вирішальне значення. Зазвичай використовуються два типи планувальників: системні та хмарні.

Дізнайтеся більше про стратегії ротації IP щоб вибрати потрібну вам.

Системні планувальники

Почнемо з першого типу. Типові приклади — стандартні програми планування для операційних систем Unix (включаючи macOS) і Windows.

Cron Jobs: стандартний планувальник завдань на основі часу для операційних систем, подібних Unix, ідеальний для запуску скриптів Python за розкладом.

Windows Task Scheduler: вбудований еквівалент Windows для планування програм або скриптів для запуску в певний час.

Обидві програми мають дуже простий інтерфейс, який дозволяє користувачам запускати та зупиняти інші програми в певний час.

Хмарні рішення

Хмарні платформи планування розгортають і запускають скрипти скрейпингу в своїх цифрових середовищах. Типові приклади — GitHub Actions, AWS Lambda та Apache Airflow.

GitHub Actions — це безплатна платформа CI/CD, яка може запускати ваші скрипти скрейпингу на серверах GitHub, забезпечуючи їх виконання навіть коли ваш локальний комп'ютер вимкнений.

AWS Lambda — це зручний і економічний варіант для запуску скрейперів у хмарі, де необхідно просто завантажити код у середовище виконання та запустити його.

Apache Airflow — це відкрита платформа для програмного створення, планування та моніторингу робочих процесів, придатна для складних конвеєрів даних.

Ці платформи особливо добре підходять для спільного доступу та командної роботи, коли кілька розробників працюють над одним проектом, використовуючи будь-який з цих інструментів.

Зведена таблиця платформ веб-скрейпингу та планування

Давайте підведемо підсумки цих платформ скрейпингу та планування на основі їх принципів використання, прикладів та їх призначення.

Тип платформи | Приклади | Найкраще підходить для | Знання програмування |

Інструменти парсингу без коду | Octoparse, Browse AI, Apify | Не розробники, моніторинг | Ні |

Бібліотеки Python | Scrapy, Playwright, BS4 | Повний контроль, користувацька логіка | Так |

Платформи автоматизації | n8n, Zapier, Airflow | Інтеграція робочих процесів | Низьке/опціонально |

Хмарні планувальники | GitHub Actions, AWS Lambda | Безсерверні, постійні запуски | Середнє |

Системні планувальники | Cron (Unix), Task Scheduler (Windows) | Локальне планування скриптів | Мінімальне |

Налаштування автоматизованого веб-скрейпера: найкращі практики

Тепер давайте розглянемо найкращі практики запуску інструменту веб-скрейпингу.

Перевірте robots.txt

На веб-сайтах зазвичай є спеціальний файл під назвою robots.txt який вказує, який контент може і не може бути сканований. Зазвичай веб-сайти захищають свої сторінки входу, панель управління користувача та інші сторінки з конфіденційною інформацією. Щоб отримати доступ до нього, просто додайте його ім'я в корінь веб-сайту (наприклад, app.cyberyozh.com/robots.txt), і тут ви побачите правила скрейпінгу веб-сайту. Не скрейпіть дані, які позначені як Disallow.

Ротуйте свою IP за допомогою проксі

Ротуйте IP-адреси, використовуючи проксі-сервіси, щоб уникнути обмеження частоти запитів і блокування IP при скрейпінгу в великому масштабі. Переконайтеся, що ви перевірили якість IP перед ротацією. За допомогою перевірки CyberYozh це можна автоматизувати, використовуючи CyberYozh API, щоб ротація відбувалась лише якщо цільовий IP має низький Fraud Score.

Реалізуйте випадкові затримки

Додайте випадкові затримки між запитами, щоб уникнути перевантаження цільового сервера або блокування вашої IP-адреси. Переконайтеся, що ви не порушуєте Умови обслуговування веб-сайту, відправляючи занадто багато запитів, оскільки це може порушити роботу веб-сайту і привести до конфлікту з платформою.

Прочитайте більше про здоров'я IP-адреси в статті цикл управління проксі від CyberYozh.

Обробляйте помилки автоматично

Реалізуйте try-catch блоки або аналогічні механізми обробки помилок для обробки потенційних проблем, таких як помилки мережі або зміни структури веб-сайту. Це забезпечить підрахунок і повідомлення про потенційні помилки перед початком скрейпінгу, щоб ви могли відповісти належним чином, зберегти ваш трафік і запобігти проблемам.

Використовуйте безголовий браузер

Щоб зекономити трафік, що критично при веб-скрейпінгу, ви можете використовувати метод безголового браузера, коли ваш скрейпер отримує доступ лише до потрібних вам даних (ціни, вартість, результати пошуку, оголошення, коментарі користувачів тощо) без UI. Оскільки ротуючі проксі зазвичай стягують плату за обсяг трафіку, це також буде економічно ефективно.

Автоматизація веб-скрейпінгу: Резюме

Автоматизація веб-скрейпінгу поєднує правильний інструмент скрейпінгу, надійний планувальник і ротуючі проксі в єдиний, автоматичний конвеєр даних. Незалежно від того, чи ви маркетолог, який використовує Octoparse, чи розробник, який створює конвеєри Scrapy, основи залишаються незмінними: розподіляйте ваші запити по чистих IP, дотримуйтеся правил платформи і проактивно обробляйте помилки. Резидентські та мобільні проксі CyberYozh, у поєднанні з його API для підключення до проксі та перевірки IP, надають вам інфраструктуру для запуску скрейперів у великому масштабі без блокувань і збоїв.

Часто задавані питання про автоматизацію веб-скрейпінгу

Що таке автоматизація веб-скрейпінгу?

Програмований процес, який автоматично витягує дані з веб-сайту за розписанням без ручної роботи, виводячи результати в CSV, JSON або базу даних.

Чи потрібні мені навички програмування для автоматизації веб-скрейпінгу?

Платформи без коду, такі як Octoparse і Browse.ai, обробляють все візуально. Програмування дає більше потужності та гнучкості у великому масштабі.

Чому скрейпери блокуються?

Веб-сайти виявляють повторювані запити з однієї IP і позначають поведінку, схожу на бота. Слідують обмеження частоти, CAPTCHA і блокування IP.

Що таке ротація IP і чому це важливо?

Ротація IP відправляє кожен запит з іншої IP-адреси, запобігаючи обмеженню частоти і змушуючи сеанси скрейпінгу виглядати як реальні користувачі.

Яка різниця між резидентськими та мобільними проксі для скрейпінгу?

Мобільні проксі мають найвищий рівень довіри і рідко блокуються; Резидентські проксі пропонують більший пул і підходять для більшості загальних завдань скрейпінгу.

Що таке cron job при веб-скрейпінгу?

Планувальник на основі Unix, який автоматично запускає скрипт скрейпінгу в певні інтервали часу, наприклад щодня або щогодини.

Чи можу я запустити скрейпери в хмарі безплатно?

Так. GitHub Actions пропонує безплатне хмарне виконання скриптів скрейпінгу за розписанням, навіть коли ваш локальний комп'ютер вимкнено.

Що таке robots.txt і чи повинен я його дотримуватися?

Файл, що оголошує, які сторінки сайту дозволені для сканування. Його дотримання робить ваш скрейпер етичним і знижує юридичний ризик.

Що таке безголовий браузер і коли його використовувати?

Браузер, що працює без UI, використовується для ефективного скрейпингу сторінок, відрендерених JavaScript, при цьому споживаючи менше пропускної здатності та трафіку прокси.

Як перевірити, чистий ли мій IP перед його використанням?

Використовуйте IP Checker від CyberYozh для отримання Fraud Score для будь-якої IP-адреси; це можна автоматизувати через API CyberYozh.

Корисно?

Поділитися статтею