Автоматизація веб-скрейпінгу: Як запускати скрейпери за розкладом

Тут ми розглянемо технічні особливості автоматизації веб-скрейпінгу— процесу, на який покладаються багато бізнесів для отримання якісних даних, чи то дослідження ринку, SEO/SERP інформація, або думки клієнтів. Важливою частиною процесу є те, що більшість сервісів швидко позначають і обмежують численні запити протягом коротких проміжків часу, які неминучі під час автоматизованого скрейпінгу, тому важливо розподіляти навантаження запитів між кількома IP-адресами, використовуючи ротаційні проксі.

Що таке автоматизація веб-скрейпінгу

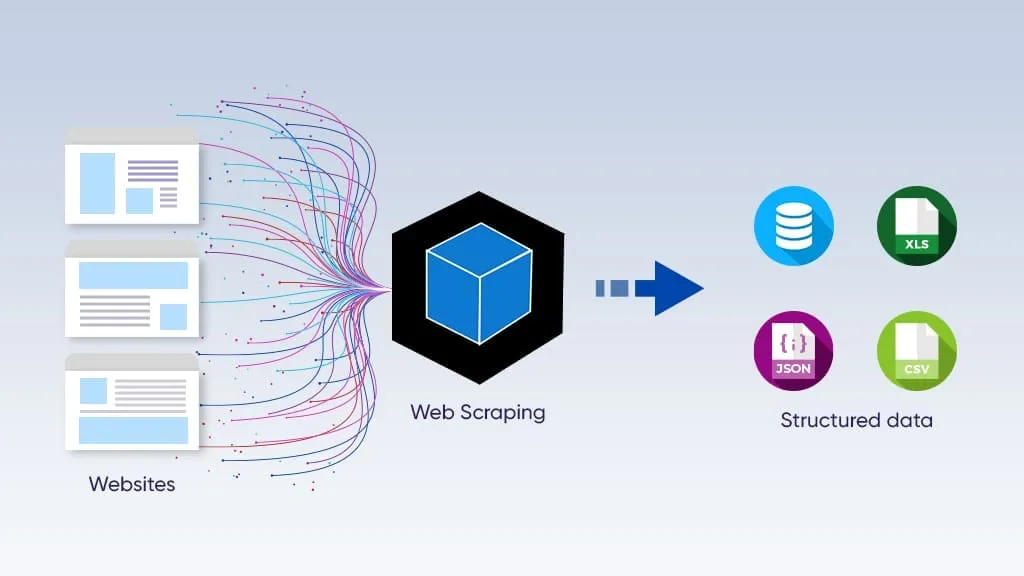

Автоматизація веб-скрейпінгу — це програмований процес підключення до веб-серверів і вилучення даних з них без ручної роботи. Все, що потрібно — це налаштувати веб-скрейпер і створити для нього інструкції. Після цього він виконує всю роботу самостійно. Зазвичай результуючі файли — це таблиці у форматах .csv або .json, або файли баз даних, які можна обробляти за допомогою SQL-запитів.

Важливо пам'ятати, що платформи обмежують масові, автоматизовані потоки запитів, типові для веб-скрейпінгу. Ось чому проксі є необхідними для цього. Читайте більше про сервіси ротації IP і як їх використовувати, щоб уникнути банів та обмежень

Підходи до автоматизації веб-скрейпінгу

Існує два основні підходи до автоматизації веб-скрейпінгу: використання low-code платформ для його налаштування або написання Python-скриптів зі спеціалізованими бібліотеками та фреймворками.

No-code/low-code інструменти

Ці інструменти пропонують інтерфейси «наведи і клацни», часто візуальні, які можна використовувати без знань програмування. Це може допомогти, оскільки деякі з цих платформ дозволяють налаштування через програмування, але це не обов'язково. Користувачі визначають правила скрейпінгу, клацаючи на елементи сторінки, налаштовуючи логіку пагінації та конфігуруючи формати виводу, як-от CSV або JSON, все через графічний інтерфейс користувача.

Їх легко налаштувати, але вони також мають багато обмежень:

No-code скрейпери легко ламаються, коли цільовий вебсайт змінює свою структуру.

Вони погано справляються з динамічними, насиченими JavaScript сторінками або спеціальною бізнес-логікою.

Вони стають дорогими у масштабі, і їх важко налаштовувати.

Ці інструменти в основному використовуються маркетологами, бізнес-аналітиками, менеджерами електронної комерції та підприємцями. Проте програмні рішення краще підходять для великомасштабного скрейпінгу.

Програмні рішення

Ці інструменти — це бібліотеки та фреймворки, переважно для Python, найпоширенішої мови програмування. Програмний скрейпінг надає розробникам повний, детальний контроль над кожним аспектом процесу вилучення даних, від того, як надсилаються HTTP-запити, до того, як дані парсяться, зберігаються та плануються.

Ключовим обмеженням є технічний бар'єр: побудова, підтримка та планування виробничих скрейперів вимагає навичок кодування, часу на налагодження та рішень щодо інфраструктури. Цей підхід використовується інженерами даних, backend-розробниками, дата-сайєнтистами та growth-хакерами, яким потрібна надійність, налаштування та програмованість.

Проксі для веб-автоматизації та чому вони необхідні

Більшість вебсайтів, за винятком великих відкритих баз даних (які зазвичай призначені для скрейпінгу), обмежують кількість запитів, дозволених з однієї IP-адреси. Коли користувач перевищує це обмеження, платформа обмежує запити, викликаючи користувача CAPTCHA або блокуючи його. Крім того, платформи відстежують усі запити, їхні IP-адреси та інші сліди (наприклад, дані браузера), щоб знайти невідповідності та поведінку, схожу на ботів, і позначають підозрілі адреси, навіть якщо вони не перевищують ліміт. Ось чому пул проксі-IP та антидетект-браузинг потрібні тут: вони пом'якшують ці проблеми.

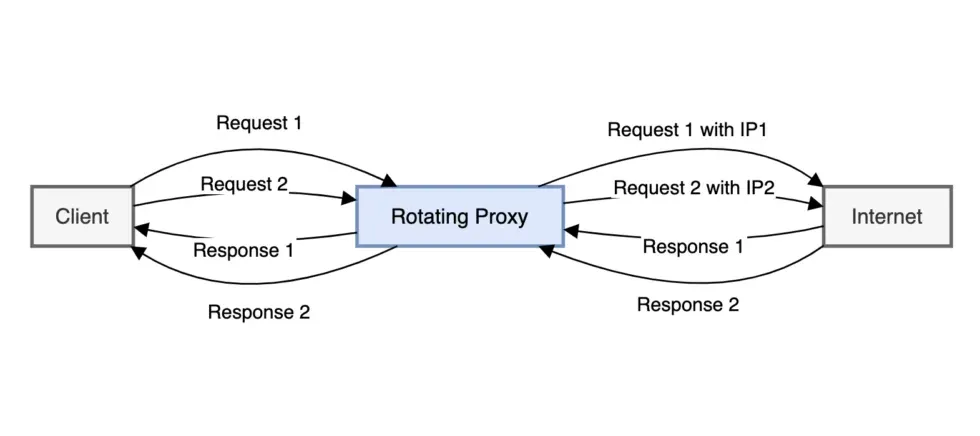

Ротація проксі означає, що кожен запит (або група запитів) надсилається з різних IP-адрес. Переважно існує два типи:

Мобільні проксі використовують IP-адреси від мобільних інтернет-провайдерів (LTE/5G) і мають найвищий рівень довіри, оскільки платформи не відрізняють їх від користувачів мобільного інтернету. Вони найкраще підходять для скрейпінгу соціальних даних.

Резидентські ротаційні проксі використовують пул резидентських IP-адрес і ротують між ними згідно з попередньо встановленим алгоритмом. Їхній рівень довіри нижчий, але все ще добрий для більшості платформ, і вони є хорошим варіантом для більшості завдань веб-скрейпінгу.

Перед використанням будь-якої IP-адреси її якість слід оцінити за допомогою IP Checkerвід CyberYozh, який відображає її Fraud Score.

Антидетект-браузери додатково підвищують безпеку, надаючи окремий набір цифрових відбитків для кожної сесії. У поєднанні з чистою IP-адресою кожна сесія тепер виглядає як автентична цифрова ідентичність, і ймовірність банів і викликів CAPTCHA значно зменшується.

Читайте більше про антидетект і як це працює.

Які найнадійніші сервіси веб-скрейпінгу та автоматизації

Автоматизація веб-скрейпінгу передбачає використання різних інструментів і методів для планування та виконання завдань вилучення даних без ручного втручання. Найкращий метод залежить від ваших знань програмування, складності цільового вебсайту та бажаного масштабу операції. Незалежно від методу, важливо поєднувати ваш скрейпер з ротаційними проксі, щоб забезпечити, що ваші сесії не будуть заблоковані.

Спеціалізовані no-code платформи

Спеціально створені платформи для скрейпінгу поєднують візуальні конструктори скрейперів з хмарною інфраструктурою, вбудованим плануванням, ротацією проксі та обробкою CAPTCHA без необхідності програмування.

Scrapeless пропонує спеціалізовані scraping-актори для платформ e-commerce (Amazon, Shopee), конкурентного моніторингу та відстеження AI-видимості (ChatGPT, Gemini тощо). Серед інструментів платформи — хмарний Scraping Browser, Universal Scraping API та AI-native Agent Browser з інтеграціями MCP/CLI. Нові користувачі отримують $10 пробних кредитів. Оптимальне рішення для технічних команд та AI-розробників, які створюють масштабовані пайплайни даних із безперешкодною інтеграцією в агентні воркфлоу.

Octoparse — це конструктор скреперів із функцією «вкажи та клацни», хмарним виконанням, автоматичним виявленням шаблонів і запланованими запусками для даних електронної комерції та лідів.

Apify пропонує маркетплейс із понад 1500 готових скрейпінгових «Акторів» для популярних сайтів, із хмарним хостингом і виведенням через API.

Browse.ai спеціалізується на моніторингу вебсайтів; виявляє зміни та надсилає сповіщення без ручного переналаштування.

Web Scraper — це браузерне розширення, зручний для початківців скрепер із хмарним плануванням для простого витягування структурованих даних.

Найкраще підходить для маркетологів, аналітиків і бізнес-команд, яким потрібен регулярний збір даних без залучення розробників.

Платформи автоматизації

Універсальні інструменти автоматизації поєднують кроки вебскрейпінгу з ширшими бізнес-процесами, направляючи витягнуті дані в CRM, таблиці або месенджери.

Zapier з'єднує тригери скрейпінгу з понад 6000 додатків; ідеальний для легкої передачі даних, наприклад нові оголошення → Slack або Google Sheets.

n8n — це відкритий, самостійно розгорнутий конструктор робочих процесів із вузлами HTTP-запитів, що пропонує більше контролю та власної логіки, ніж Zapier.

Ці платформи підходять операційним і growth-командам, які хочуть негайно діяти на основі зібраних даних: автоматизувати сповіщення, маршрутизацію лідів або звітні конвеєри, а не просто зберігати їх.

Бібліотеки Python

Бібліотеки Python надають розробникам повний програмний контроль над логікою скрейпінгу, плануванням і обробкою даних — від простого парсингу HTML до повної автоматизації браузера.

Scrapy — це промисловий фреймворк для краулінгу з вбудованими конвеєрами, проміжним програмним забезпеченням і плануванням для високообсягового витягування даних. Встановіть його за допомогою pip командою pip install scrapy

BeautifulSoup + Requests — це легка комбінація для парсингу статичних HTML-сторінок; швидка для прототипування, але обмежена для динамічних сайтів.

Playwright/Puppeteer/Selenium — це інструменти автоматизації безголових браузерів, які обробляють рендеринг JavaScript, взаємодію з користувачем та складні потоки входу.

Вибір для розробників і дата-інженерів, які будують власні масштабовані конвеєри, що вимагають точного контролю над проксі, обробкою помилок і подальшою обробкою даних.

Запуск планувальника для автоматичного керування скрепером

Після налаштування інструменту скрейпінгу його діяльність також слід автоматизувати. Скрепер автоматизує витягування вебданих, але інший інструмент, званий планувальником, автоматизує, коли скрепер має працювати, а коли бути неактивним. Також можна вмикати та вимикати його вручну, але планувальники дозволяють більше контролю та точності, що, як ми вже бачили, є критично важливим. Зазвичай використовуються два типи планувальників: системного рівня та хмарні.

Читайте більше про стратегії ротації IP , щоб обрати потрібну.

Планувальники системного рівня

Почнемо з першого типу. Типові приклади — стандартні програми планування для Unix-подібних операційних систем (включно з macOS) і Windows.

Cron Jobs: Стандартний планувальник завдань на основі часу для Unix-подібних операційних систем, ідеальний для запуску Python-скриптів за розкладом.

Windows Task Scheduler: Вбудований Windows-еквівалент для планування запуску програм або скриптів у певний час.

Обидві програми мають дуже простий інтерфейс, що дозволяє користувачам запускати та зупиняти інші програми в межах певного часу.

Хмарні рішення

Хмарні платформи планування розгортають і запускають скрейпінгові скрипти у своїх цифрових середовищах. Типові приклади — GitHub Actions, AWS Lambda та Apache Airflow.

GitHub Actions — це безкоштовна CI/CD платформа, яка може запускати ваші скрипти для скрапінгу на серверах GitHub, забезпечуючи їх виконання навіть коли ваш локальний комп'ютер вимкнено.

AWS Lambda — це високомасштабований та економічно ефективний варіант для запуску скраперів у хмарі, просто завантаживши код у його середовище виконання та запустивши його.

Apache Airflow — це платформа з відкритим кодом для програмного створення, планування та моніторингу робочих процесів, підходить для складних конвеєрів даних.

Ці платформи особливо добре підходять для спільного доступу та командної роботи, коли кілька розробників працюють над одним проєктом, використовуючи будь-який з цих інструментів.

Зведена таблиця платформ для веб-скрапінгу та планування

Давайте узагальнимо ці платформи для скрапінгу та планування на основі принципів їх використання, прикладів та того, для чого вони найкраще підходять.

Тип платформи | Приклади | Найкраще для | Кодування |

Інструменти парсингу без коду | Octoparse, Browse AI, Apify | Не-розробники, моніторинг | Ні |

Бібліотеки Python | Scrapy, Playwright, BS4 | Повний контроль, власна логіка | Так |

Платформи автоматизації | n8n, Zapier, Airflow | Інтеграція робочих процесів | Низький/опціональний |

Хмарні планувальники | GitHub Actions, AWS Lambda | Безсерверні, постійно активні запуски | Помірний |

Планувальники ОС | Cron (Unix), Task Scheduler (Windows) | Локальне планування скриптів | Мінімальний |

Налаштування автоматизованого веб-скрапера: найкращі практики

Тепер давайте розглянемо найкращі практики для запуску інструменту веб-скрапінгу.

Перевірте robots.txt

Веб-сайти зазвичай мають спеціалізований файл під назвою robots.txt , який визначає, який контент можна, а який не можна сканувати. Зазвичай веб-сайти захищають свої сторінки входу, панель управління користувача та інші сторінки з конфіденційною інформацією. Щоб отримати до нього доступ, просто додайте його назву до кореня веб-сайту (наприклад, app.cyberyozh.com/robots.txt), і тут ви побачите правила скрапінгу вебсайту. Не збирайте дані, які заборонені до збору.

Ротуйте свій IP за допомогою проксі

Ротуйте IP-адреси, використовуючи проксі-сервіси, щоб уникнути обмеження швидкості та блокування IP під час масштабного скрапінгу. Переконайтеся, що перевірили якість IP перед ротацією на нього. За допомогою перевірки CyberYozh це можна автоматизувати, використовуючи CyberYozh API, тому ротація відбуватиметься лише якщо цільовий IP має низький показник шахрайства.

Впроваджуйте випадкові затримки

Додавайте випадкові затримки між запитами, щоб уникнути перевантаження цільового сервера або блокування вашої IP-адреси. Переконайтеся, що ви не порушуєте Умови використання вебсайту, роблячи занадто багато запитів, оскільки це може порушити роботу вебсайту та призвести до конфлікту з платформою.

Дізнайтеся більше про стан IP-адреси у статті цикл управління проксі від CyberYozh.

Обробляйте помилки автоматично

Впроваджуйте блоки try-catch або подібні механізми обробки помилок для вирішення потенційних проблем, таких як мережеві помилки або зміни структури вебсайту. Це забезпечить підрахунок і звітування про потенційні помилки перед початком скрапінгу, щоб ви могли відреагувати належним чином, заощадити трафік і запобігти проблемам.

Використовуйте безголовий браузинг

Щоб заощадити трафік, що є критичним у веб-скрапінгу, ви можете використовувати метод безголового браузингу, коли ваш скрапер отримує доступ лише до потрібних вам даних (ціни, витрати, результати пошуку, списки, коментарі користувачів тощо) без UI. Оскільки ротаційні проксі зазвичай стягують плату за обсяг трафіку, це також буде економічно ефективним.

Найкращі практики веб-скрапінгу: Підсумок

Автоматизація веб-скрапінгу поєднує правильний інструмент для скрапінгу, надійний планувальник і ротаційні проксі в єдиний автономний конвеєр даних. Незалежно від того, чи ви маркетолог, який використовує Octoparse, чи розробник, який створює конвеєри Scrapy, основи залишаються незмінними: розподіляйте свої запити через чисті IP, дотримуйтесь правил платформи та проактивно обробляйте помилки. Резидентські та мобільні проксі CyberYozh у поєднанні з його API перевірки IP надають вам інфраструктуру для запуску скраперів у масштабі без блокувань чи збоїв.

Поширені запитання про автоматизацію веб-скрапінгу

Що таке автоматизація веб-скрапінгу?

Програмований процес, який автоматично витягує веб-дані за розкладом, без ручної роботи, виводячи результати у форматі CSV, JSON або базу даних.

Чи потрібні мені навички програмування для автоматизації веб-скрапінгу?

Платформи без коду, такі як Octoparse і Browse.ai , обробляють все візуально. Програмування відкриває більше можливостей і гнучкості у масштабі.

Чому скрапери блокуються?

Вебсайти виявляють повторювані запити з однієї IP-адреси та позначають поведінку, схожу на ботів. Слідують обмеження швидкості, CAPTCHA та блокування IP.

Що таке ротація IP і чому це важливо?

Ротація IP надсилає кожен запит з іншої IP-адреси, запобігаючи обмеженню швидкості та роблячи сесії скрапінгу схожими на справжніх користувачів.

Яка різниця між резидентськими та мобільними проксі для скрапінгу?

Мобільні проксі мають найвищий рівень довіри і рідко блокуються; резидентські проксі пропонують більший пул і підходять для більшості загальних завдань скрапінгу.

Що таке cron job у веб-скрапінгу?

Системний планувальник на основі Unix, який автоматично запускає скрипт скрапінгу через визначені часові інтервали, наприклад щодня або щогодини.

Чи можу я запускати скрапери в хмарі безкоштовно?

Так. GitHub Actions пропонує безкоштовне хмарне виконання скриптів скрапінгу за розкладом, навіть коли ваш локальний комп'ютер вимкнено.

Що таке robots.txt і чи слід мені його дотримуватися?

Файл, що оголошує, які сторінки сайт дозволяє сканувати. Його дотримання робить ваш скрапер етичним і зменшує юридичні ризики.

Що таке безголовий браузер і коли я маю його використовувати?

Браузер, який працює без UI, використовується для ефективного скрапінгу сторінок, відрендерених JavaScript, споживаючи при цьому менше пропускної здатності та трафіку проксі.

Як перевірити, чи чистий мій проксі IP перед його використанням?

Використовуйте IP Checker від CyberYozh, щоб отримати Fraud Score для будь-якої IP-адреси; це можна автоматизувати через CyberYozh API.