Що означає парсити дані: скрейпери, парсери та проксі

Коли користувачі запитують, що означає парсити дані, вони цікавляться систематичним перетворенням необробленого веб-коду на структуровані дані. Тут ми дослідимо цей процес, і, як завжди, я підготую максимально чітку та продуману відповідь, підкріплену відгуками користувачів та коментарями спеціалістів.

Коротко

Парсинг даних — це процес перетворення необробленого зібраного HTML на чисті, структуровані дані, і для надійного виконання цього завдання потрібна правильна стратегія роботи скрапера, парсера та ротації проксі.

Скрапери збирають необроблений вміст сторінок; парсери витягують лише потрібні поля (ціни, назви, відгуки) у форматі JSON або CSV

Проксі та ротація IP запобігають блокуванням, але слід обрати правильну стратегію: на кожен запит для масових завдань, «липкі» сесії для входів, часову для запланованого моніторингу

Вибір фреймворку має значення: Scrapy для статичного масштабування, Playwright для сайтів з інтенсивним JavaScript, BeautifulSoup для легкого парсингу

Ключові випадки використання включають моніторинг цін, створення датасетів для ШІ, агрегацію подорожей, відстеження відгуків та генерацію лідів

Open Scraper від CyberYozh (безкоштовний, на базі Playwright), плюс пул із понад 50 млн резидентських IP та IP Checker для забезпечення якості, охоплює весь конвеєр від збору до чистих даних

Значення парсингу даних: Основні визначення

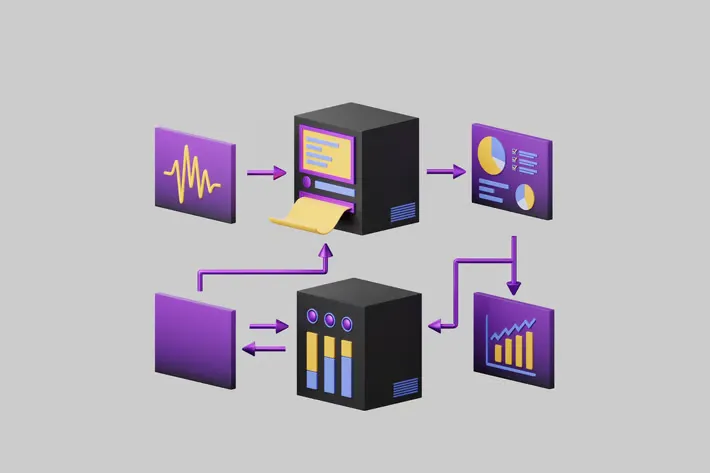

Значення парсингу даних у найпростішому вигляді: це процес організації необроблених, неструктурованих даних (зазвичай зібраного HTML) та витягування з них сенсу шляхом перетворення у чистий, придатний для запитів формат, як-от JSON або CSV. Якщо вас цікавить, що означає парсинг даних на практиці, уявіть це як трирівневу операцію:

Скрапер збирає необроблений вміст сторінок з цільових вебсайтів

Парсер читає ці сторінки, застосовує логіку та виділяє значення, які вам дійсно потрібні

Проксі гарантує, що весь процес не буде заблоковано на півдорозі цільовим сервером.

Без розуміння повного робочого процесу парсингу даних автоматизований збір даних майже завжди або дає неповні результати, або блокується захистом від ботів. Значення розпарсених даних у бізнес-контексті — це чистий, структурований вихід, який можна завантажити в електронну таблицю, базу даних або модель ШІ. Давайте розглянемо конкретні інструменти для цього

Що таке скрапери даних

Скрапер даних — це автоматизована програма, яка переходить по веб-сторінках та завантажує їхній необроблений вміст, зазвичай у вигляді вихідного коду HTML, JSON-відповідей або API-пейлоадів. Скрапери можуть варіюватися від Python-скрипта , що використовує бібліотеку requests для отримання статичної сторінки, до безголового браузера Chromium, який імітує рух миші, прокручування та надсилання форм для розблокування динамічно згенерованого вмісту.

Докладніше про веб-скрапінг у глосарії CyberYozh.

Обсяг того, що можуть зібрати скрапери, величезний:

списки товарів

вакансії

заголовки новин

контент соціальних мереж

ціни на нерухомість

розклади подорожей

Все, що публічно видиме в браузері, в принципі може бути зібране. Їхнє основне обмеження полягає в тому, що вони повертають всю сторінку як є, включаючи весь шаблонний код, навігаційні меню, рекламу та шум. Саме тому парсинг є критичним кроком, який слідує далі.

Приклад використання: Стартап з аналітики електронної комерції запускає скрейпер на основі Scrapy для сканування 50 магазинів конкурентів кожні 6 годин. Скрейпер завантажує повні сторінки товарів масово, зберігає необроблений HTML локально та передає набір даних до конвеєра парсингу. Без парсера на виході необроблений HTML є комерційно безцінним.

Що таке парсери даних

Значення парсера даних — це програма, яка бере необроблений HTML, зібраний скрейпером, і витягує лише релевантні точки даних та організовує їх у структурований формат:

назви товарів

ціни товарів

кількість відгуків

статус наявності

конкретні публікації в соцмережах

Парсери працюють, застосовуючи правила вибору: CSS-селектори (наприклад, div.price) або XPath-вирази, які точно визначають, де в DOM знаходиться значення. Кінцевий результат роботи парсера — це те, що насправді означають оброблені дані у виробництві: чистий, типізований, дедуплікований набір даних, який можна вставити в таблицю PostgreSQL, передати до API або використати для навчання моделі машинного навчання.

Читайте більше про що таке чекери та парсери!

Приклад використання: Агрегатор подорожей збирає необроблені сторінки списків готелів з 12 платформ бронювання та передає їх парсеру, який витягує ціну заїзду, рейтинг, тип номера та політику скасування. Парсер нормалізує валюти та формати дат, а потім записує результат до уніфікованої бази даних, що забезпечує порівняння цін у реальному часі.

Необроблені веб-дані самі по собі не можуть бути запитані, візуалізовані або передані в алгоритми: спочатку їм потрібна структура. Бізнес покладається на парсинг даних для різних цілей, які я трохи далі оглянув. У кожному з цих випадків парсинг — це крок, який перетворює HTML-файл на інсайт.

Проксі для парсингу даних та ротація IP

Запуск скрейпера без проксі — це короткочасний експеримент. Вебсайти відстежують повторювані запити з однієї IP-адреси та відповідають обмеженнями швидкості, CAPTCHA, помилками HTTP 429 або прямими банами.

👉 Дізнайтеся більше про

Ротація IP — це практика розподілу запитів через кілька IP-адрес, щоб платформні захисти бачили розподілений, природний трафік замість одного автоматизованого джерела.

Подивіться гайд з ротації IPвід CyberYozh, який визначає чотири основні стратегії залежно від завдання:

Випадкова ротація: IP змінюється випадково з пулу через змінний інтервал (наприклад, 5–40 хвилин), імітуючи патерни трафіку реальних користувачів. Найкраще підходить для парсингу середньої частоти, де важлива емуляція природної поведінки.

Ротація на кожен запит: Кожен HTTP-запит використовує новий IP з пулу. Це основна стратегія для високооб'ємного парсингу пошукових систем, каталогів товарів і великих баз даних, де швидкість має найбільше значення.

Часова (запрограмована) ротація: IP змінюється раз на встановлений період часу, незалежно від кількості запитів. Ідеально підходить для моніторингу цін, що виконується за розкладом і потребує передбачуваної поведінки з низьким слідом.

«Липкі» сесії: Той самий IP зберігається протягом усієї сесії, а потім змінюється після її закриття. Необхідно для робочих процесів, що передбачають вхід в акаунти, оскільки зміна IP посеред сесії викликає прапорці шахрайства та анулювання сесії.

Багато налаштувань не працюють, тому що змішують ці підходи — ротують занадто швидко або покладаються на низькоякісні IP, які вже несуть сигнали ризику.

—Гайд CyberYozh з ротації IP

Вибір неправильної стратегії ротації — одна з найпоширеніших причин збоїв парсингу, які насправді не пов'язані з самим кодом парсера. Розгляньмо, як застосувати це для конкретних реальних завдань.

Стратегії парсингу даних і випадки використання

Завдання

Відстежувати ціни на товари конкурентів на 20 платформах електронної комерції у реальному часі в різних регіонах.

Стратегія парсингу даних

Використовуйте Scrapy для високооб'ємного краулінгу з етапом парсингу через BeautifulSoup для нормалізації цін і валют. Застосуйте ротацію IP на кожен запит з резидентськими проксі CyberYozh, з геотаргетингом на цільовий ринок продавця. Виведення в базу даних зі щоденними сповіщеннями про виявлення змін.

Завдання

Агрегувати дані про ціни на авіаквитки та готелі з десятків платформ бронювання подорожей для сервісу порівняння цін.

Стратегія парсингу даних

Використовуйте Playwright для рендерингу сторінок бронювання з великою кількістю JavaScript і витягування динамічних цін. Застосуйте часову ротацію з резидентськими IP у цільовій країні, імітуючи реальні сесії перегляду користувачів. Парсіть структуровані поля цін і передавайте в порівняльний движок.

Завдання

Створити багатомовний текстовий датасет для навчання великої мовної моделі з новинних статей, форумів і блогів у 30 країнах.

Стратегія парсингу даних

Використовуйте Scrapy для краулінгу з ротацією IP на кожен запит через широкий пул резидентських IP, що охоплює цільові мови та регіони. Парсіть статті за допомогою CSS-селекторів для витягування заголовка, тіла, дати та мовного тегу. Зберігайте в структурованій базі корпусу, готовій до токенізації.

Завдання

Збирати та аналізувати відгуки клієнтів про ваш бренд і конкурентів з Amazon, Trustpilot, App Store і G2 у 15 країнах.

Стратегія парсингу даних

Використовуйте Python Requests + BeautifulSoup для статичних сторінок з відгуками; переходьте на Playwright для віджетів відгуків, що рендеряться через JavaScript. Застосовуйте випадкову ротацію з резидентськими IP-адресами з кожної цільової країни для доступу до регіональних версій відгуків. Передавайте розпарсені дані про настрої до NLP-конвеєра.

Завдання

Автоматизувати генерацію лідів шляхом витягування контактних даних компаній з галузевих каталогів та професійних мереж.

Стратегія парсингу даних

Використовуйте Playwright для багатокрокової навігації та взаємодії з формами. Застосовуйте «липкі» сесії для кожного цільового профілю, щоб підтримувати послідовну поведінку сесії. Парсіть поля імені, посади, електронної пошти та компанії у CSV-формат, готовий для CRM.

Фреймворки для парсингу даних: Scrapy, Playwright та інші

Вибір неправильного фреймворка може коштувати новим проєктам скрейпінгу тижнів інженерного часу. Кожен основний інструмент у 2026 році має чітку роль у конвеєрі, і найкращі налаштування рідко покладаються на один інструмент.

Як обрати найкращий фреймворк для парсингу

Ключове питання: чи ваш цільовий сайт рендерить контент за допомогою JavaScript, чи дані доступні у статичному HTML? Статичні сайти вимагають легких, швидких інструментів; динамічні SPA потребують справжнього браузерного движка. Ось розбивка основних фреймворків:

Scrapy: Промисловий Python-фреймворк для краулінгу з вбудованими конвеєрами, middleware, чергуванням запитів та плануванням. Найкращий для масштабних, статичних або напівстатичних краулів, де пріоритетом є пропускна здатність. Не є браузером; не виконує JavaScript нативно.

Playwright: Сучасна бібліотека автоматизації браузера від Microsoft з підтримкою Chromium, Firefox та WebKit для Python, Node.js, Java та C#. Має вбудоване автоочікування, перехоплення мережі, емуляцію пристроїв та керування кількома вкладками. Найкращий вибір для динамічних сайтів з великою кількістю JavaScript у 2026 році.

Selenium: Ветеранський фреймворк автоматизації браузера з найширшою підтримкою мов та браузерів (Java, Python, C#, Ruby тощо). Важчий і повільніший за Playwright, але неперевершений у застарілих середовищах та поліглотних інженерних командах з існуючою інфраструктурою Selenium Grid.

Puppeteer: Розроблена Google бібліотека Node.js для керування Chromium через Chrome DevTools Protocol. Чудово підходить для завдань, специфічних для Chrome, аналізу продуктивності та генерації PDF. Поступається Playwright у мультибраузерних та багатомовних проєктах.

BeautifulSoup + Requests: Найшвидший спосіб створити прототип парсера для статичного HTML. Це Python-бібліотеки, які просто парсять завантажений HTML. Ідеальні для легких завдань парсингу та як шар парсингу в конвеєрі Scrapy.

Таблиця порівняння фреймворків:

Фреймворк | Ключові особливості | Типові випадки використання |

Scrapy | Вбудовані конвеєри, middleware, асинхронний краулінг, планування | Високооб'ємний краулінг статичних сайтів, збір великих наборів даних |

Selenium | Багатомовність, Selenium Grid, широка підтримка браузерів | Застарілі системи, великі команди, розподілений скрапінг |

Playwright | Автоочікування, мультибраузерність, перехоплення мережі, емуляція пристроїв | Оцінка динамічних сервісів, сайти з великою кількістю JS, потоки входу, нескінченна прокрутка |

Puppeteer | Chrome DevTools Protocol, детальний контроль Chrome | Скрапінг специфічний для Chrome, рендеринг PDF, моніторинг продуктивності |

BeautifulSoup | Простий парсинг HTML/XML, CSS-селектори, XPath | Парсинг статичних сторінок, легкі проєкти, швидке прототипування |

Ці фреймворки не є взаємовиключними і часто комбінуються. Поширена високопродуктивна конфігурація поєднує Scrapy як оркестратор сканування з Playwright для обробки запитів з великою кількістю JavaScript через проміжне програмне забезпечення scrapy-playwright.

Найкращі практики парсингу даних

Розділяйте логіку скрапінгу та парсингу. Зберігайте сирий HTML перед його парсингом. Це дозволяє повторно запускати парсер з оновленими селекторами без повторного сканування всього сайту: величезна економія часу, коли макети цільових сторінок несподівано змінюються.

Підбирайте стратегію ротації відповідно до завдання. Використовуйте ротацію на кожен запит для масового скрапінгу, «липкі» сесії для робочих процесів на основі акаунтів і ротацію за часом для запланованих завдань моніторингу. Надто агресивна ротація порушує сесії; надто повільна ротація позначає IP.

Завжди перевіряйте репутацію IP перед розгортанням. Низькоякісні або раніше зловживані IP гарантують погані результати незалежно від вашої логіки ротації. Використовуйте IP Checker від CyberYozh для оцінки ваших IP перед додаванням їх до будь-якого активного робочого процесу.

Рандомізуйте шаблони запитів. Використовуйте змінні затримки, рандомізовані user agentsта реалістичні заголовки браузера, щоб уникнути спрацювання систем поведінкового виявлення. Однакова затримка в 1 секунду між кожним запитом так само підозріла, як і відсутність затримки взагалі.

Використовуйте безголовий браузер лише за необхідності. Playwright і Selenium є ресурсомісткими. Використовуйте BeautifulSoup + Requests для статичних сторінок і залишайте автоматизацію браузера для сторінок, які дійсно потребують рендерингу JavaScript.

Open Scraper від CyberYozh: безкоштовний інструмент для скрапінгу даних для всіх

CyberYozh підтримує Open Scraper — безкоштовний інструментарій для скрапінгу з відкритим вихідним кодом, побудований на Playwright, розроблений для зниження порогу входу для розробників, які хочуть професійного вилучення даних без побудови інфраструктури з нуля. Він обробляє найскладніші частини робочого процесу скрапінгу з коробки:

Легке встановлення: Встановіть Open Scraper за допомогою Docker за 15-20 хвилин і використовуйте його з мінімальними знаннями програмування

Асинхронна черга завдань: запускайте кілька завдань скрапінгу паралельно з вашого локального додатка Open Scraper

Пакетний скрапінг: обробляйте великі списки URL у структурованих пакетах

Нативна інтеграція проксі: підключається безпосередньо до проксі-мереж CyberYozh для безшовної ротації

Як платформа, CyberYozh розширює можливості Open Scraper завдяки повноцінній проксі-інфраструктурі. Користувачі отримують доступ до пулу понад 50 мільйонів резидентських IP-адрес у понад 100 країнах, зі стабільно низькою глобальною затримкою, що підходить для чутливих до часу завдань зі скрейпінгу та моніторингу. Вбудований IP Checker дозволяє перевірити рівень довіри до IP та сигнали ризику шахрайства перед тим, як використовувати їх у будь-якому робочому процесі, а CyberYozh API спрощує автоматизацію як планування ротації IP, так і програмної перевірки репутації, легко інтегруючись зі Scrapy, Playwright, Selenium, Puppeteer та Postman.

Налаштуйте свою проксі-інфраструктуру. Зареєструйтеся в CyberYozh і почніть зараз!

Останні нагадування про парсинг даних

Парсинг даних — це міст між необробленим веб-контентом і практичною аналітикою. Робочий процес завжди однаковий: скрейпте за допомогою правильного фреймворку, парсіть потрібні дані та захищайте конвеєр якісними проксі та розумною стратегією ротації. Опануйте ці три рівні, і ви зможете витягувати структуровані дані практично з будь-якого публічного джерела.

Перегляньте каталог проксі CyberYozh і виберіть потрібний варіант.