如何抓取 Google Trends 数据:完整实用指南(2026)

为什么有人会想在2026年抓取Google Trends数据?在写下第一行代码之前,这个«为什么»值得思考片刻。

Google Trends是互联网上真正罕见的东西:

一个实时的、公开可访问的窗口,能够洞察数百万人正在积极思考、搜索和关注的内容。

不是调查问卷。

不是自我报告的行为。

而是真实的搜索查询,经过汇总并索引为相对兴趣信号,持续更新。

这是一个非凡的数据源。问题在于其界面。

Google Trends的网站是为随意探索而构建的。你可以输入一个关键词,查看图表,对兴趣变化趋势形成粗略印象。

但你无法通过网站做到的是:同时提取200个关键词的每周兴趣数据、监控新兴话题何时开始激增、比较40个市场的地理需求,或将Trends信号整合到自动化的内容或商业智能管道中。

抓取 恰好解决了这个缺口。它将一个为个人好奇心设计的工具转变为可扩展的数据基础设施。

简而言之:

2026年抓取Google Trends数据最可靠的方法是使用pytrends,这是一个非官方的Python库,可以与Google内部的Trends API对接,无需API密钥。

对于更大规模的抓取或更复杂的需求,通过Playwright进行浏览器自动化可以提供更多灵活性。

这两种方法都需要在有意义的规模上轮换 住宅代理 以避免基于IP的速率限制。

Google Trends数据是公开可用的,可合法访问用于分析,并且每天被全球的SEO专业人士、内容营销人员、研究人员和金融分析师使用。

谁在大规模使用这个:

一位 Shopify 店主通过Google Trends注意到,对«Stanley cup tumbler»的兴趣在2022年10月开始急剧上升,大约在它成为文化现象前六周。

她以成本价将配件库存增加了两倍。她的竞争对手手动跟踪同一趋势,在搜索峰值已经达到顶点六周后才做出反应。她抓住了需求激增;他们只是在追赶。

这就是程序化Google Trends访问对真实用户的实际作用。同样的逻辑适用于 SEO 关键词优先级排序、编辑内容日历、金融情绪分析、学术研究和竞争情报。

数据就在那里。问题是你是系统性地访问它还是偶然地访问它。

抓取Google Trends合法吗

直接回答: 根据美国、欧盟、英国或大多数其他主要司法管辖区的法律,抓取Google Trends并不违法。这可能与Google的服务条款相冲突,服务条款广泛禁止自动化访问,但这是合同考量,而非刑事问题,而且对个人研究人员或分析师的执法实际上不存在。

让我们把这个问题放在具体语境中,而不是含糊其辞:

美国的 计算机欺诈和滥用法案 、英国的计算机滥用法案以及欧盟的GDPR都涉及未经授权的系统访问和个人数据保护。

抓取Google Trends上公开可用的、匿名化的汇总数据并不真正涉及这些框架中的任何一个。

2022年美国第九巡回法院在HiQ Labs诉LinkedIn案中的裁决确立,抓取公开可访问的数据——无需登录或身份验证即可查看的数据——不违反CFAA。

Google的服务条款 是另一个考量因素。它们是你与Google之间的合同,而非法律。违反它们可能导致IP封禁或服务终止——这是技术后果,而非法律后果。

专业人士使用的实用框架:

限制请求频率。不要每分钟发送数百个请求。合理的自动化访问应模仿人类行为。

仅抓取分析所需的数据。不要毫无目的地归档整个数据集。

不要商业性地重新分发原始抓取数据。这正是许可问题变得真实的地方。

将数据用于洞察。内容策略、研究和商业智能是 Google Trends 旨在提供信息支持的目的。

绝大多数 SEO 专业人士、记者、学术研究人员和数据分析师每天抓取 Google Trends 数据都没有遇到任何问题。理论上风险确实存在,但对于合法使用场景而言,实际风险微乎其微。

了解 Google Trends 数据是什么

在编写代码之前,理解你要提取的内容很重要,因为 Google Trends 数据有一个让初学者困惑、让中级用户沮丧的特性。

Google Trends 不显示绝对搜索量:

它显示相对热度,分数从 0 到 100,其中 100 代表你选择的时间范围和地理位置内的峰值热度。

50 表示峰值的一半。

0 表示数据不足以显示。

这是经过刻意标准化的数据。

Google 不通过 Trends 发布原始搜索量数据。

这在实践中意味着:

如果你提取«电动汽车»5 年的数据,峰值周的分数是 100。

其他每一周的分数都相对于该峰值。

如果你随后在同一时期单独查询«太阳能电池板»,其峰值 也 得分 100,即使«太阳能电池板»的绝对搜索量只有«电动汽车»的十分之一。

这就是标准化问题。它使单次数据提取中的跨查询比较有意义,但在 不同 数据提取之间则不可靠。

解决方案: 始终在同一个 pytrends build_payload() 调用中比较关键词。在每个批次中包含一个一致的«锚点»关键词(一个搜索量稳定、易于理解的关键词),可以让你在多次提取中标准化数据。

例如,在每个批次中包含«天气»这个搜索量一致且可预测的关键词作为锚点,可以让你在不同请求之间以可比较的方式校准相对热度。

方法比较:哪种抓取方法适合你

在深入了解每种方法之前,这里有一个决策表:

方法 | 难度 | 可靠性 | 速度 | 最佳使用场景 | 主要限制 |

pytrends(Python 库) | 初学者 | 高 | 快 | 大多数标准用例 | 大量请求时的速率限制 |

直接 HTTP 请求 | 中级 | 中等- 高 | 快速 | 自定义参数、批处理 | 需要 header /cookie 管理 |

浏览器自动化(Playwright) | 高级 | 非常高 | 慢 | 复杂页面、避免验证码 | 资源 密集型 |

无代码平台(Apify 等) | 初级 | 中等 | 可变 | 非开发人员、快速导出 | 持续订阅成本 |

手动 CSV 导出 | 无 | 完美 | 非常慢 | 一次性小数据集 | 不可扩展 |

从 pytrends 开始。仅当 pytrends 在你的特定用例中持续失败时,才转向浏览器自动化。

方法 1:Pytrends

直接答案: pytrends 是一个非官方的 Python 库 ,它与 Google Trends 的内部数据 API通信。它不需要 API 密钥,几秒钟即可安装,并且用最少的代码处理最常见的数据提取任务。它几乎是每个人的正确起点。

Pytrends 是什么

pytrends(最初由用户 GeneralMills 编写,现在由开源社区维护)在 GitHub 和 PyPI 上都可以找到。

它将 Google 内部的 Trends 端点抽象为简洁的 Python 函数调用,自动处理身份验证 cookie、请求格式化和响应解析。

这不是 Google 的官方产品。Google 不为其背书。

但它在绝大多数标准用例中都能可靠运行,自 2015 年以来一直在积极使用,并通过社区维护持续到 2026 年。

安装 pytrends: bash

pip install pytrends

需要 Python 3.7 或更高版本。安装就这么简单。

首次数据拉取

此脚本检索过去 12 个月内单个关键词的每周兴趣数据:

from pytrends.request import TrendReq

# Initialize — hl sets the language, tz sets the timezone offset

pytrends = TrendReq(hl='en-US', tz=360)

# Build the payload — specify up to 5 keywords here

pytrends.build_payload(

kw_list=['artificial intelligence'],

timeframe='today 12-m',

geo='' # Empty string = worldwide

)

# Pull interest over time

data = pytrends.interest_over_time()

print(data.head(10))运行此代码,你将获得一个 pandas DataFrame,这是一个以日期为行索引、每周兴趣分数(0–100)为值的表格。isPartial 列表示尚未完全索引的周;将其过滤掉以进行清晰分析:

data = data[data['isPartial'] == False]比较多个关键词

pytrends 最强大的功能之一是直接关键词比较,最多可同时比较五个关键词,并归一化到相同的 100 分制:

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

kw_list=['ChatGPT', 'Gemini', 'Claude AI', 'Copilot'],

timeframe='today 12-m',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Which platform has the highest average interest?

print(data[['ChatGPT', 'Gemini', 'Claude AI', 'Copilot']].mean())这种比较数据具有真正的战略意义。如果你在 AI 工具领域创建内容,了解哪个平台的搜索兴趣正在增长而哪个正在趋于平稳,可以告诉你受众注意力正在积极迁移的方向,而这种变化在任何其他数据源中都尚未显现。

地理兴趣数据

世界上哪里的兴趣最集中?这将拉取国家级数据:

pytrends.build_payload(

kw_list=['electric vehicles'],

timeframe='today 12-m'

)

# Country-level interest

by_country = pytrends.interest_by_region(resolution='COUNTRY', inc_low_vol=True)

# Sort by interest descending

print(by_country.sort_values('electric vehicles', ascending=False).head(20))

对于单个国家内的区域分辨率(美国各州、英国地区),调整 resolution 参数:

by_state = pytrends.interest_by_region(resolution='REGION', geo='US')这对于做出地理扩张决策的企业或分配区域预算的广告商来说非常宝贵。

上升相关查询:最未被充分利用的功能

这就是 Google Trends 成为真正内容情报工具的地方:

python

pytrends.build_payload(

kw_list=['remote work tools'],

timeframe='today 3-m'

)

related = pytrends.related_queries()

# Rising queries — growing fastest relative to their usual volume

print(related['remote work tools']['rising'])

# Top queries — highest absolute interest

print(related['remote work tools']['top'])上升相关查询显示人们正在搜索什么 与你的关键词相关,且增长速度最快。对于内容营销人员来说,这是三到六周的先发关键词情报。在上升相关查询达到峰值兴趣之前发布内容,你的内容就能顺应需求曲线,而不是追赶它。

实时热门搜索

监控当前热门内容:

trending_today = pytrends.trending_searches(pn='united_states')

print(trending_today.head(20))这将返回请求时指定国家/地区的前 20 个热门搜索。适用于新闻监控、内容响应策略和社交媒体趋势识别。

方法 2:直接 HTTP 请求

直接回答: 直接 HTTP 请求让你能够精细控制 pytrends 抽象掉的查询参数、标头和会话管理。这适用于需要自定义时间范围格式、精确类别过滤或大批量请求管理的高级用户。

在底层,pytrends 向 Google 的内部 Trends 端点发出 GET 请求,主要是:

https://trends.google.com/trends/api/widgetdata/multiline

https://trends.google.com/trends/api/explore

这些端点返回前面带有保护前缀()]}')的 JSON 数据,必须在解析之前将其剥离。

它们还需要 Google 服务器验证的特定会话 cookie 和标头。

以下是使用 requests 库的可用模式:

import requests

import json

session = requests.Session()

# First, establish a session by visiting the main Trends page

session.get('https://trends.google.com/')

# The explore endpoint generates widget tokens for data requests

params = {

'hl': 'en-US',

'tz': '-360',

'req': json.dumps({

"comparisonItem": [

{"keyword": "python programming", "geo": "", "time": "today 12-m"}

],

"category": 0,

"property": ""

}),

'token': '',

'user_type': ''

}

response = session.get(

'https://trends.google.com/trends/api/explore',

params=params

)

# Strip the protection prefix before parsing

clean_response = response.text.lstrip(")}']\n")

data = json.loads(clean_response)这比 PyTrends 更复杂,但能让你精确控制请求的每个方面。大多数用户不需要这种级别的控制,但对于具有特定批处理要求或非标准时间范围格式的生产管道来说,这是合适的方法。

方法 3:使用 Playwright 进行浏览器自动化

直接回答: Playwright 自动化真实浏览器,使你的抓取行为几乎无法与真实的人类浏览区分开来。这是避免速率限制和验证码的最稳健方法,但与基于 API 的方法相比,速度明显更慢且资源消耗更大。

何时使用 Playwright 而不是 pytrends:

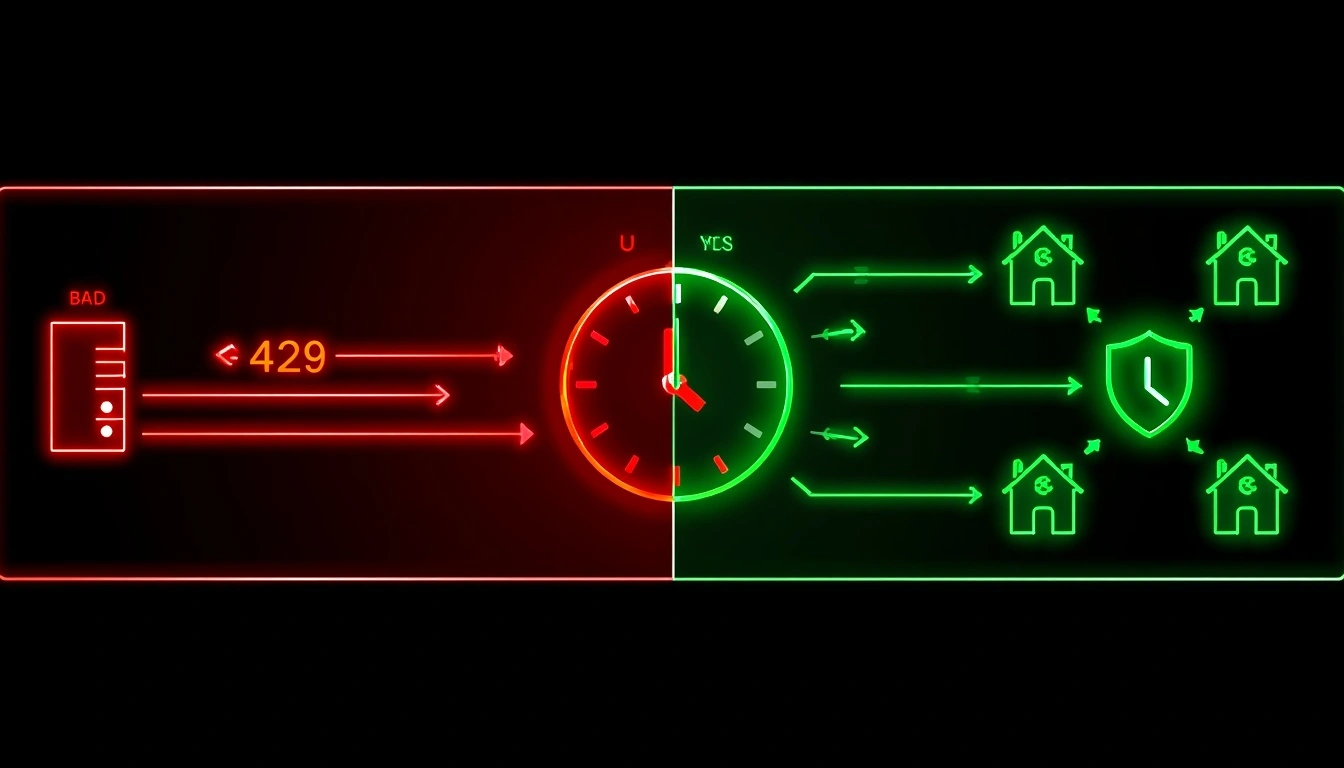

pytrends 持续返回 429 错误,即使使用代理和延迟也是如此

你需要捕获 API 未公开的可视化或交互式页面元素

你需要处理验证码挑战(使用适当的第三方解决方案)

你正在抓取具有复杂导航模式的小众趋势页面

可靠的 Playwright 设置:

from playwright.sync_api import sync_playwright

import time

with sync_playwright() as p:

# Launch browser — headless=False for debugging, True for production

browser = p.chromium.launch(headless=True)

# Create a context with realistic browser settings

context = browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36',

viewport={'width': 1280, 'height': 800}

)

page = context.new_page()

# Navigate to Trends

page.goto('https://trends.google.com/trends/explore?q=python+programming&date=today+12-m&geo=US')

# Wait for the data chart to render

page fully

.wait_for_selector('[class*="widget"]', timeout=10000)

# Add human-like delay

time.sleep(3)

# Extract page content for parsing

content = page.content()

# Alternatively, intercept the API response directly

# This is more reliable than parsing HTML

browser.close()

print("Data extracted successfully")更复杂的方法是拦截 Playwright 在加载页面时发出的网络请求,直接捕获 API 响应而不是解析渲染的 HTML。这结合了浏览器自动化的隐蔽优势和 API 响应的更清晰数据格式。[阅读 playwright Python 文档]

为什么会出现速率限制以及如何处理

这是大多数教程省略的部分,也是初学者在前几次成功请求后遇到困难的原因。

Google Trends 有基于 IP 的速率限制。在短时间内从单个 IP 地址发送过多请求,你将开始收到 429 错误(请求过多)。在某些配置下,你会收到验证码挑战。这两种情况都不意味着你的代码有问题;这意味着你触发了 Google 的自动流量管理。

解决方案 1:添加请求延迟

最简单的修复方法。在请求之间调用 time.sleep() 可以让 Google 的系统重置其每个 IP 的计数器:

import time

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

keywords = [

'content marketing', 'SEO strategy', 'link building',

'technical SEO', 'keyword research', 'on-page SEO'

]

results = {}

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m')

results[keyword] = pytrends.interest_over_time()

print(f"✓ {keyword}")

time.sleep(15) # 15 seconds between requests

print("All keywords retrieved.")对于每次会话最多 50 个关键词的批处理作业,10-15 秒的延迟通常就足够了。对于更大的批次,增加到 30-60 秒并分成多个会话。

解决方案 2:轮换住宅代理

对于更大量的自动化,IP 轮换是正确的架构解决方案。每个请求通过不同的 IP 地址路由,因此没有单个 IP 地址会累积足够的请求来触发速率限制。

并非所有代理对此用例都是平等的。

Google 维护着大量数据中心 IP 范围列表:AWS、Google Cloud、DigitalOcean、Vultr,并且对来自这些来源的流量进行速率限制的力度远比来自住宅地址的流量更激进。

使用数据中心代理进行 Google 抓取通常根本无法提供任何有意义的保护。

住宅代理 通过分配给真实 ISP 客户、家庭互联网连接和移动设备的 IP 地址路由流量。

对于 Google 的系统来说,这种流量与真实用户无法区分。

使用 CyberYozh 代理进行稳定的 Google Trends 抓取

直接回答: 住宅代理通过将请求分散到数千个不同的住宅 IP 地址来防止 Google Trends 速率限制。CyberYozh 提供具有地理定位功能的轮换住宅和 移动代理 ,特别适合 Google Trends 自动化。

将 CyberYozh 代理集成到 pytrends 工作流程中:

from pytrends.request import TrendReq

import time

import random

# CyberYozh proxy configuration

proxy_config = {

'https': 'https://USERNAME:PASSWORD@gate.cyberyozh.com:PORT'

}

# Initialize pytrends with proxy support

pytrends = TrendReq(

hl='en-US',

tz=360,

requests_args={

'proxies': proxy_config,

'verify': True

}

)

keywords = ['machine learning', 'deep learning', 'neural networks',

'computer vision', 'natural language processing']

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m', geo='US')

data = pytrends.interest_over_time()

print(f"Retrieved: {keyword} — {len(data)} weeks of data")

time.sleep(random.uniform(8, 20)) # Randomize delays to mimic human behaviorrandom .uniform(8, 20) 延迟随机化很重要;可预测的均匀间隔(每次恰好10秒)本身可能被复杂的流量分析识别为自动化行为。

Trends数据的地理定位:

代理地理定位的一个常被忽视的应用是获取反映真实本地搜索行为的Trends数据。

Google Trends在某些配置下会根据请求的地理位置校准相对兴趣度。

美国住宅IP请求美国地理参数的数据,比非美国IP产生的结果更一致。

CyberYozh的国家级IP定位原生支持此用例,对于运行多市场Trends分析的机构或需要地理代表性数据的研究人员非常有用。

查看 CyberYozh代理目录 ,获取全球最实惠且可信赖的IP。

对于基于Playwright的抓取,代理配置略有不同:

python

from playwright.sync_api import sync_playwright

with sync_playwright() as p:

browser = p.chromium.launch(

headless=True,

proxy={

"server": "https://gate.cyberyozh.com:PORT",

"username": "USERNAME",

"password": "PASSWORD"

}

)

# ... rest of automation code归一化问题:如何比较多次拉取的数据

这是最让中级用户困扰的问题,而竞争对手的教程很少解释这一点。

Google Trends在每次查询中对数据进行归一化。

在您指定的时间范围内,兴趣度最高的点始终为100。

这对于可视化单个关键词的轨迹很有意义。

但当您想比较在不同请求中拉取的两个关键词时,就会产生问题。

场景: 您拉取«关键词A»的数据,在3月获得100的峰值。然后您单独拉取«关键词B»的数据,也在3月获得100的峰值。这是否意味着它们的搜索量相等?几乎肯定不是。它们只是恰好都处于各自的峰值。

锚点关键词归一化技术:

在每批数据中包含一个稳定的参考关键词,一个具有易于理解、一致搜索量的关键词。常用的锚点包括«Facebook»、«YouTube»或«weather»,这些关键词月度搜索兴趣相对稳定。

from pytrends.request import TrendReq

import pandas as pd

import time

pytrends = TrendReq(hl='en-US', tz=360)

# Batch 1: Compare keyword sets against anchor

batch_1 = ['Facebook', 'content marketing', 'email marketing', 'social media marketing']

batch_2 = ['Facebook', 'SEO', 'PPC advertising', 'influencer marketing']

pytrends.build_payload(batch_1, timeframe='today 12-m', geo='US')

data_1 = pytrends.interest_over_time()[batch_1]

time.sleep(15)

pytrends.build_payload(batch_2, timeframe='today 12-m', geo='US')

data_2 = pytrends.interest_over_time()[batch_2]

# Now normalize both datasets against the anchor (facebook)

# The anchor's values are comparable across batches because they were in both

anchor = 'facebook'

data_1_normalized = data_1.div(data_1[anchor], axis=0)

data_2_normalized = data_2.div(data_2[anchor], axis=0)

# Now you can meaningfully compare any keyword from batch 1 with any from batch 2

print("Normalized comparison:")

print(pd.concat([

data_1_normalized.drop(columns=[anchor]),

data_2_normalized.drop(columns=[anchor])

], axis=1).mean())

专业数据分析师使用这种技术,但入门教程很少记录。它能够让您跨多个批次请求比较数十个关键词,并获得有意义、可比较的结果。

实际用例:您实际如何使用这些数据

没有应用的数据只是一张有趣的电子表格。以下是实践中有意义的Google Trends分析示例:

内容日历优化

每周为您的核心主题集群拉取上升的相关查询。

当相关关键词在0-100量表上超过40并继续攀升时,立即发布针对该主题的重点内容。

瞄准增长曲线,而非峰值。

季节性库存和广告支出规划

五年的周度兴趣数据以显著的可靠性揭示季节性模式。

销售户外家具的零售商可以精确看到目标市场的春季兴趣何时开始攀升,通常在购买行为峰值前4-6周,并据此安排付费广告活动。

SEO关键词优先级排序

在为目标关键词投资内容营销活动之前,验证其轨迹。

月搜索量30,000且Trends轨迹上升的关键词,比月搜索量50,000但轨迹下降的关键词更值得投资。

您是在投资一个增长的市场,而非萎缩的市场。

竞争品牌情报

追踪竞争对手品牌搜索兴趣随时间的变化。

竞争对手品牌搜索的持续增长是一个预警信号,比他们公布的指标更具参考价值,且可实时获取。

金融情绪指标

对«房贷再融资»«经济衰退»«裁员»和«副业»等类别的搜索兴趣可作为消费者情绪的领先指标。

大型对冲基金和经济研究机构将谷歌趋势作为更广泛经济预测模型的输入之一。

学术和新闻研究

量化公众对新闻事件、政策变化、公众人物和文化时刻的关注度随时间的变化,提供了可验证、可引用的集体兴趣模式证据,比编辑判断更加客观。

导出和可视化谷歌趋势数据

获得数据后,最常见的后续步骤是导出和可视化:

from pytrends.request import TrendReq

import matplotlib.pyplot as plt

import pandas as pd

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

['AI tools', 'automation software'],

timeframe='today 5-y',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Export to CSV for spreadsheet analysis

data.to_csv('google_trends_export.csv')

print("CSV exported successfully.")

# Create a clean visualization

fig, ax = plt.subplots(figsize=(14, 6))

data['AI tools'].plot(ax=ax, label='AI Tools', color='#2563EB', linewidth=2)

data['automation software'].plot(ax=ax, label='Automation Software', color='#7C3AED', linewidth=2)

ax.set_title('Search Interest Comparison: AI Tools vs Automation Software (5 Years, US)',

fontsize=14, fontweight='bold', pad=20)

ax.set_ylabel('Interest Score (0–100)', fontsize=11)

ax.set_xlabel('')

ax.legend(fontsize=11)

ax.grid(True, alpha=0.3)

ax.set_ylim(0, 110)

plt.tight_layout()

plt.savefig('trends_comparison.png', dpi=150, bbox_inches='tight')

plt.show()对于偏好使用电子表格而非 Python 的团队,CSV 导出完全兼容 Excel 和 Google Sheets。pandas DataFrame 结构可以清晰地映射到表格格式,日期位于 A 列,关键词兴趣值位于后续列中。

最常见错误的故障排除及修复方法

错误:429 请求过多 您已超出谷歌的单 IP 速率限制。在请求之间添加或增加 time.sleep() 延迟(从 15-30 秒开始)。如果在任何延迟级别下仍持续出现 429 错误,请实施 轮换住宅代理。

错误:ResponseError 500。 通常是谷歌端的临时服务器问题。等待 5-10 分钟后重试。偶尔由格式错误的负载参数触发,请仔细检查您的时间范围字符串格式('today 12-m', 'today 3-m', '2022-01-01 2023-12-31')。

返回空 DataFrame。 您的关键词在指定地理位置或时间范围内的搜索量不足。尝试扩大 geo 参数设置为空(空字符串表示全球)或延长时间范围。某些高度特定的长尾关键词数据量不足,无法返回结果。

触发验证码挑战, 谷歌怀疑自动化访问。切换到住宅代理,大幅增加延迟,并减少每个会话的请求量。使用 Playwright 的浏览器自动化比直接 API 请求更能抵抗验证码触发。

pytrends 安装失败。确保已安装 Python 3.7+: python --version。首先尝试升级 pip: pip install --upgrade pip,然后 pip install pytrends。

仅部分数据(大多数行 isPartial = True)。 趋势数据的最近 2-3 天始终是部分数据;谷歌尚未完全索引它们。过滤掉这些行: data = data[data['isPartial'] == False]。

跨批次归一化会产生不一致的结果。 参见上文的锚定关键词归一化部分。始终在每个批次中包含一个稳定的参考关键词,以实现有意义的跨批次比较。 [详细了解 错误 499 和 错误 520]

精选 GitHub 资源

与其说«在 GitHub 上搜索就能找到有用的东西»,不如说以下是值得收藏的具体资源:

pytrends 官方仓库:方法文档、已知问题和更新日志的权威参考。Issues 标签页包含了绝大多数边缘情况错误的解决方案。

热门搜索仪表板项目:多个社区维护的仓库基于 pytrends 构建实时热门关键词仪表板。在 GitHub 上搜索«pytrends dashboard»可找到最近维护的选项。

趋势数据归一化工具:专门解决上文讨论的跨批次归一化问题的仓库。搜索«Google Trends normalization Python»可找到获星最多的选项。

Apify Google Trends 抓取器:对于无需编写代码就需要 Google Trends 数据的非开发人员,Apify 维护的 Google Trends actor 提供了无代码界面,支持定时运行和数据导出。费用因使用量而异。

一次构建管道,永久使用

Google Trends 是为数不多真正免费、真正强大的数据源之一,而大多数人仅发挥了其 10% 的潜力。一次性投入建立 pytrends 管道,即使是按计划每周运行的基础版本,也能为你提供一个持续的早期预警系统,用于监测上升话题、受众兴趣变化和新兴竞争动态。

今天就建立基础架构。随着数据量增长再添加代理基础设施。开始将公共搜索行为视为真正的战略情报资产,而不是想起来时才手动查看的东西。

数据持续更新。你是否关注它,是你唯一能控制的变量。