Automação de Web Scraping: Como executar raspadores em um cronograma

Aqui, vamos fazer uma visão geral das peculiaridades técnicas da automação de web scraping, um processo no qual muitos negócios confiam para obter dados de alta qualidade, seja pesquisa de mercado, informações de SEO/SERP ou sentimentos de clientes. Uma parte importante do processo é que a maioria dos serviços sinaliza rapidamente e limita múltiplas solicitações em curtos períodos de tempo, o que é inevitável durante a raspagem automatizada, portanto é essencial distribuir a carga de solicitações entre múltiplos IPs usando proxies rotativos.

O que é automação de web scraping

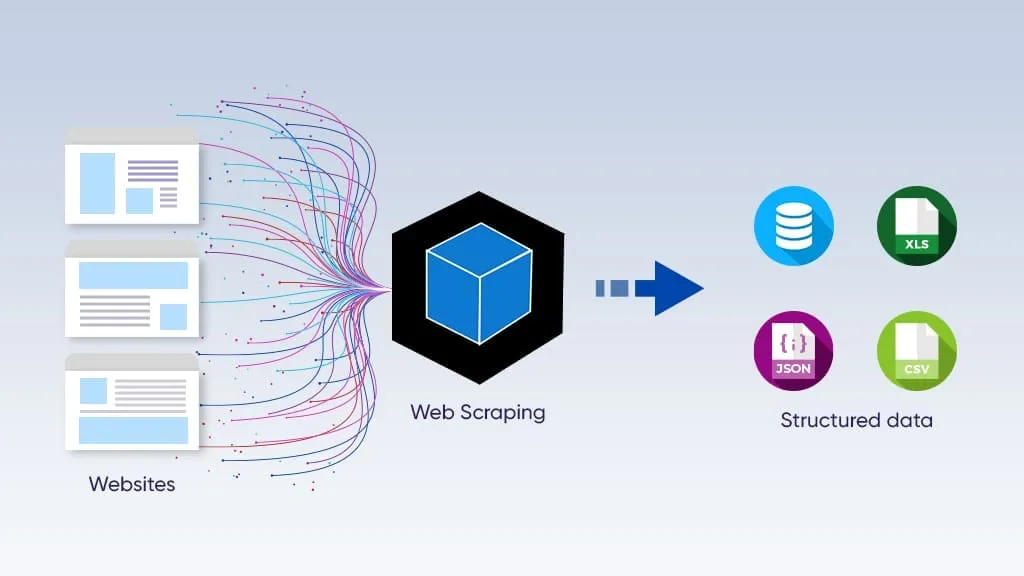

A automação de web scraping é um processo programável de conexão com servidores web e extração de dados deles sem trabalho manual. Tudo o que é necessário é configurar um web scraper e criar instruções para ele. Depois disso, ele completa todo o trabalho por conta própria. Geralmente, os arquivos resultantes são tabelas em formatos .csv ou .json, ou arquivos de banco de dados que podem ser processados com consultas SQL.

É crítico lembrar que a plataforma limita fluxos de solicitações em massa e automatizadas, típicos de web scraping. É por isso que proxies são essenciais para isso. Leia mais sobre serviços de rotação de IP e como usá-los para evitar banimentos e restrições

Abordagens para automatizar web scraping

Existem duas abordagens principais para automação de web scraping: usar plataformas de baixo código para configurá-la ou escrever scripts Python com bibliotecas e frameworks especializados.

Ferramentas sem código/baixo código

Esses instrumentos oferecem interfaces de apontar e clicar, frequentemente visuais, que podem ser usadas sem conhecimento de codificação. Pode ajudar, pois algumas dessas plataformas permitem personalização através de programação, mas não é necessário. Os usuários definem regras de raspagem clicando em elementos da página, configurando lógica de paginação e configurando formatos de saída como CSV ou JSON, tudo através de uma GUI.

Eles são fáceis de configurar, mas também têm muitas limitações:

Raspadores sem código quebram facilmente quando um site de destino muda seu layout.

Eles têm dificuldade com páginas dinâmicas, pesadas em JavaScript ou lógica comercial personalizada.

Eles se tornam caros em escala e é difícil personalizá-los.

Essas ferramentas são usadas principalmente por profissionais de marketing, analistas de negócios, gerentes de e-commerce e empreendedores. Ainda assim, soluções baseadas em programação são melhores para raspagem em larga escala.

Soluções baseadas em programação

Essas ferramentas são bibliotecas e frameworks, principalmente para Python, a linguagem de programação mais amplamente utilizada. A raspagem baseada em programação oferece aos desenvolvedores controle total e granular sobre cada aspecto do processo de extração, desde como as solicitações HTTP são enviadas até como os dados são analisados, armazenados e agendados.

A limitação principal é a barreira técnica: construir, manter e agendar raspadores de nível de produção requer habilidade de codificação, tempo de depuração e decisões de infraestrutura. Essa abordagem é usada por engenheiros de dados, desenvolvedores de backend, cientistas de dados e growth hackers que precisam de confiabilidade, personalização e programabilidade.

Proxies de automação web e por que são necessários

A maioria dos sites, excluindo grandes bancos de dados abertos (que geralmente são projetados para raspagem), limita o número de solicitações permitidas de um único IP. Quando um usuário excede esse limite, a plataforma limita as solicitações, desafiando o usuário com um CAPTCHA ou bloqueando-o. Além disso, as plataformas monitoram todas as solicitações, seus IPs e outras pegadas digitais (como dados do navegador) para encontrar inconsistências e comportamentos semelhantes aos de bots, e sinalizam endereços suspeitos mesmo que não excedam o limite. É por isso que pool de IP proxy e navegação antidetecção são necessários aqui: eles mitigam esses problemas.

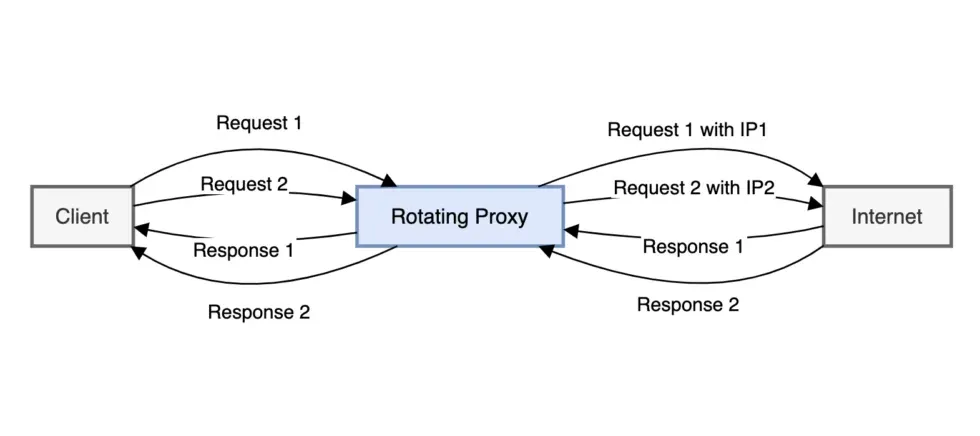

Rotação de proxy significa que cada solicitação (ou grupo de solicitações) é enviada de endereços IP diferentes. Na maioria das vezes, existem dois tipos:

Proxies móveis usam endereços IP de provedores de Internet móvel (LTE/5G) e têm o nível de confiança mais alto, pois as plataformas não os diferenciam dos usuários de Internet móvel. Eles são mais adequados para raspagem de dados sociais.

Proxies residenciais rotativos usam um pool de endereços IP residenciais e giram entre eles de acordo com um algoritmo predefinido. Seu nível de confiança é menor, mas ainda é bom para a maioria das plataformas, e são uma boa opção para a maioria das tarefas de web scraping.

Antes de usar qualquer endereço IP, sua qualidade deve ser avaliada usando o IP Checkerdo CyberYozh, que exibe sua Pontuação de Fraude.

Navegadores antidetecção aumentam ainda mais a segurança fornecendo um conjunto separado de impressões digitais para cada sessão. Combinado com um IP limpo, cada sessão agora parece ser uma identidade digital autêntica, e a probabilidade de banimentos e desafios de CAPTCHA diminui significativamente.

Leia mais sobre antideteção e como funciona.

Quais são os serviços de web scraping e automação mais confiáveis

Automatizar web scraping envolve usar várias ferramentas e técnicas para agendar e executar tarefas de extração sem intervenção manual. O melhor método depende do seu conhecimento de codificação, da complexidade do site de destino e da escala desejada da operação. Independentemente do método, é essencial combinar seu scraper com proxies rotativos para garantir que suas sessões não sejam banidas.

Plataformas dedicadas sem código

Plataformas de raspagem construídas especificamente combinam construtores de raspadores visuais com infraestrutura em nuvem, agendamento integrado, rotação de proxy e tratamento de CAPTCHA sem necessidade de codificação.

Octoparse é um construtor de scraper com clique e ponto, execução em nuvem, detecção automática de modelos e execuções agendadas para e-commerce e dados de leads.

Apify oferece um marketplace com mais de 1.500 «Actors» de scraping prontos para uso em sites populares, com hospedagem em nuvem e saída de API.

Browse.ai especializa-se em monitoramento de sites; detecta mudanças e dispara alertas sem reconfiguração manual.

Web Scraper é uma extensão baseada em navegador, amigável para iniciantes, com agendamento em nuvem para extração simples de dados estruturados.

Mais adequado para profissionais de marketing, analistas e equipes de negócios que precisam de coleta de dados recorrente sem recursos de desenvolvedor.

Plataformas de automação

Ferramentas de automação de uso geral conectam etapas de web scraping a fluxos de trabalho comerciais mais amplos, roteando dados extraídos para CRMs, planilhas ou ferramentas de mensagens.

Zapier conecta gatilhos de scraping a mais de 6.000 aplicativos; ideal para transferências de dados leves, como novos anúncios → Slack ou Google Sheets.

n8n é um construtor de fluxo de trabalho de código aberto e auto-hospedado com nós de solicitação HTTP, oferecendo mais controle e lógica personalizada do que o Zapier.

Essas plataformas são adequadas para equipes de operações e crescimento que desejam agir sobre dados raspados imediatamente: automatizando notificações, roteamento de leads ou pipelines de relatórios, em vez de apenas armazená-los.

Bibliotecas Python

As bibliotecas Python oferecem aos desenvolvedores controle programático total sobre lógica de scraping, agendamento e tratamento de dados, desde análise HTML simples até automação completa do navegador.

Scrapy é um framework de crawling de nível de produção com pipelines integrados, middlewares e agendamento para extração de dados em alto volume. Instale-o usando pip com o comando pip install scrapy

BeautifulSoup + Requests é uma combinação leve para análise de páginas HTML estáticas; é rápido de prototipar, mas limitado para sites dinâmicos.

Playwright/Puppeteer/Selenium são todas ferramentas de automação de navegador headless que lidam com renderização de JavaScript, interações do usuário e fluxos de login complexos.

A escolha preferida para desenvolvedores e engenheiros de dados que constroem pipelines personalizados e escaláveis que exigem controle preciso sobre proxies, tratamento de erros e processamento de dados downstream.

Executando um agendador para gerenciamento automático de scrapers

Depois que a ferramenta de scraping é configurada, sua atividade também deve ser automatizada. Um scraper automatiza a extração de dados da web, mas outra ferramenta, chamada agendador, automatiza quando o scraper deve ser executado e quando deve ficar inativo. Também é possível ligá-lo e desligá-lo manualmente, mas os agendadores permitem mais controle e precisão, o que, como já vimos, é crucial. Geralmente, dois tipos de agendadores são usados: nível de sistema e baseado em nuvem.

Leia mais sobre estratégias de rotação de IP para selecionar a que você precisa.

Agendadores de nível de sistema

Vamos começar com o primeiro tipo. Exemplos típicos são programas de agendamento padrão para sistemas operacionais Unix (incluindo macOS) e Windows.

Cron Jobs: O agendador de trabalhos baseado em tempo padrão para sistemas operacionais semelhantes ao Unix, ideal para executar scripts Python em um cronograma.

Agendador de Tarefas do Windows: O equivalente integrado do Windows para agendar programas ou scripts para serem executados em horários específicos.

Ambos os programas têm uma interface muito simples que permite aos usuários iniciar e parar outros programas dentro de um horário específico.

Soluções baseadas em nuvem

As plataformas de agendamento baseadas em nuvem implantam e executam scripts de scraping em seus ambientes digitais. Exemplos típicos são GitHub Actions, AWS Lambda e Apache Airflow.

GitHub Actions é uma plataforma CI/CD gratuita que pode executar seus scripts de scraping nos servidores do GitHub, garantindo que sejam executados mesmo quando sua máquina local estiver desligada.

AWS Lambda é uma opção altamente escalável e econômica para executar scrapers na nuvem, apenas postando o código em seu ambiente de tempo de execução e iniciando-o.

Apache Airflow é uma plataforma de código aberto para criar, agendar e monitorar fluxos de trabalho de forma programática, adequada para pipelines de dados complexos.

Essas plataformas são especialmente adequadas para acesso compartilhado e trabalho em equipe, quando vários desenvolvedores trabalham em um único projeto usando qualquer uma dessas ferramentas.

Tabela resumida das plataformas de web scraping e agendamento

Vamos resumir essas plataformas de scraping e agendamento com base em seus princípios de uso, exemplos e para o que são mais adequadas.

Tipo de Plataforma | Exemplos | Melhor Para | Codificação |

Ferramentas de análise sem código | Octoparse, Browse AI, Apify | Não-desenvolvedores, monitoramento | Não |

Bibliotecas Python | Scrapy, Playwright, BS4 | Controle total, lógica personalizada | Sim |

Plataformas de automação | n8n, Zapier, Airflow | Integração de fluxo de trabalho | Baixa/opcional |

Agendadores em nuvem | GitHub Actions, AWS Lambda | Execuções sem servidor, sempre ativas | Moderada |

Agendadores do SO | Cron (Unix), Task Scheduler (Windows) | Agendamento de script local | Mínima |

Configurando um web scraper automatizado: Melhores práticas

Agora, vamos explorar as melhores práticas para executar uma ferramenta de web scraping.

Verifique robots.txt

Os sites geralmente têm um arquivo especializado chamado robots.txt que especifica qual conteúdo pode e não pode ser rastreado. Normalmente, os sites protegem suas páginas de login, painel do usuário e outras páginas com informações sensíveis. Para acessá-lo, basta adicionar seu nome à raiz do site (ou seja, app.cyberyozh.com/robots.txt), e aqui você verá as regras de scraping do site. Não faça scraping dos dados que são desautorizados.

Rotacione seu IP com proxies

Rotacione endereços IP usando serviços de proxy para evitar limitação de taxa e banimentos de IP ao fazer scraping em larga escala. Certifique-se de verificar a qualidade do IP antes de rotacioná-lo. Com o verificador CyberYozh, isso pode ser automatizado usando o CyberYozh API, para que a rotação ocorra apenas se o IP de destino tiver uma pontuação de fraude baixa.

Implemente atrasos aleatórios

Adicione atrasos aleatórios entre solicitações para evitar sobrecarregar o servidor de destino ou ter seu endereço IP bloqueado. Certifique-se de não violar os Termos de Serviço do site fazendo muitas solicitações, pois isso pode interromper a operação do site e levar a conflitos com a plataforma.

Leia mais sobre a saúde do endereço IP no artigo ciclo de gerenciamento de proxy do CyberYozh.

Trate erros automaticamente

Implemente blocos try-catch ou mecanismos semelhantes de tratamento de erros para lidar com possíveis problemas, como erros de rede ou mudanças na estrutura do site. Isso garantirá que possíveis erros sejam contados e reportados antes do scraping começar, para que você possa responder apropriadamente, economizar seu tráfego e evitar problemas.

Use navegação sem interface

Para economizar tráfego, que é crucial em web scraping, você pode usar um método de navegação sem interface, quando seu scraper acessa apenas os dados que você precisa (preços, custos, resultados de busca, listagens, comentários de usuários e assim por diante) sem UI. Como proxies rotativos geralmente cobram pela quantidade de tráfego, também será econômico.

Melhores práticas de web scraping: Resumo

A automação de web scraping combina a ferramenta de scraping correta, um agendador confiável e proxies rotativos em um único pipeline de dados sem necessidade de intervenção. Seja você um profissional de marketing usando Octoparse ou um desenvolvedor construindo pipelines Scrapy, os fundamentos permanecem os mesmos: distribua suas solicitações entre IPs limpos, respeite as regras da plataforma e trate erros de forma proativa. Os proxies residenciais e móveis do CyberYozh, combinados com sua API de Verificação de IP, oferecem a infraestrutura para executar scrapers em larga escala sem banimentos ou interrupções.

Perguntas frequentes sobre automação de web scraping

O que é automação de web scraping?

Um processo programável que extrai dados da web automaticamente em um cronograma, sem trabalho manual, gerando resultados em CSV, JSON ou um banco de dados.

Preciso de habilidades de codificação para automatizar web scraping?

Plataformas sem código como Octoparse e Browse.ai lidam com tudo visualmente. Codificação desbloqueia mais poder e flexibilidade em larga escala.

Por que os scrapers são bloqueados?

Os sites detectam solicitações repetidas de um único IP e sinalizam comportamento semelhante ao de bots. Limites de taxa, CAPTCHA e banimentos de IP seguem.

O que é rotação de IP e por que é importante?

A rotação de IP envia cada solicitação de um endereço IP diferente, evitando limitação de taxa e fazendo sessões de scraping parecerem usuários reais.

Qual é a diferença entre proxies residenciais e móveis para scraping?

Proxies móveis têm o nível de confiança mais alto e raramente são bloqueados; proxies residenciais oferecem um pool maior e são adequados para a maioria das tarefas gerais de scraping.

O que é um cron job em web scraping?

Um agendador de sistema baseado em Unix que dispara um script de scraping automaticamente em intervalos de tempo definidos, como diariamente ou por hora.

Posso executar scrapers na nuvem gratuitamente?

Sim. GitHub Actions oferece execução em nuvem gratuita de scripts de scraping em um cronograma, mesmo quando sua máquina local está desligada.

O que é robots.txt e devo respeitá-lo?

Um arquivo que declara quais páginas um site permite que sejam rastreadas. Respeitá-lo mantém seu scraper ético e reduz o risco legal.

O que é um navegador sem interface e quando devo usá-lo?

Um navegador que funciona sem uma UI, usado para fazer scraping de páginas renderizadas por JavaScript de forma eficiente enquanto consome menos largura de banda e tráfego de proxy.

Como faço para verificar se meu IP de proxy está limpo antes de usá-lo?

Use CyberYozh's IP Checker to retrieve a Fraud Score for any IP; this can be automated via the CyberYozh API.

Útil?

Compartilhar artigo