Как парсить данные Google Trends: Полное практическое руководство (2026)

Зачем вообще кому-то нужно парсить Google Trends в 2026 году — прежде чем написать хоть одну строчку кода, стоит уделить минуту вопросу «зачем».

Google Trends — это нечто действительно редкое в интернете:

окно в реальном времени с публичным доступом к тому, о чём активно думают, что ищут и чему уделяют внимание миллионы людей.

Не опросы.

Не самоотчёты о поведении.

Реальные поисковые запросы, агрегированные и индексированные как сигналы относительного интереса, обновляются непрерывно.

Это экстраординарный источник данных. Проблема — в интерфейсе.

Сайт Google Trends создан для случайного исследования. Вы можете ввести ключевое слово, посмотреть на график и составить примерное представление о динамике интереса.

Чего вы не можете сделать через сайт — так это извлечь недельные данные об интересе по 200 ключевым словам одновременно, отследить, когда начинают резко расти новые темы, сравнить географический спрос по 40 рынкам или интегрировать сигналы Trends в автоматизированный контент-пайплайн или систему бизнес-аналитики.

Парсинг решает именно этот пробел. Он превращает инструмент, созданный для индивидуального любопытства, в масштабируемую инфраструктуру данных.

Коротко:

Самый надёжный способ парсить данные Google Trends в 2026 году — использовать pytrends, неофициальную библиотеку Python, которая взаимодействует с внутренним API Trends от Google, без необходимости в API-ключе.

Для парсинга большего объёма или более сложных требований автоматизация браузера через Playwright предлагает больше гибкости.

Оба метода требуют ротации резидентских прокси в значительном масштабе, чтобы избежать ограничения скорости на основе IP.

Данные Google Trends общедоступны, легально доступны для анализа и ежедневно используются SEO-специалистами, контент-маркетологами, исследователями и финансовыми аналитиками по всему миру.

Кто реально использует это в масштабе:

Владелица Shopify -магазина заметила через Google Trends, что интерес к «Stanley cup tumbler» начал резко расти в октябре 2022 года, примерно за шесть недель до того, как это стало культурным феноменом.

Она утроила запасы аксессуаров по себестоимости. Её конкуренты, отслеживая тот же тренд вручную, отреагировали через шесть недель после того, как пик поискового всплеска уже прошёл. Она поймала волну спроса; они гнались за ней.

Вот что на самом деле даёт программный доступ к Google Trends реальным людям. Та же логика применима к SEO -приоритизации ключевых слов, редакционным контент-календарям, анализу финансовых настроений, академическим исследованиям и конкурентной разведке.

Данные есть. Вопрос в том, получаете ли вы к ним доступ систематически или случайно.

Законно ли парсить Google Trends

Прямой ответ: Парсинг Google Trends не является незаконным по законам Соединённых Штатов, Европейского союза, Великобритании или большинства других крупных юрисдикций. Он может противоречить Условиям использования Google, которые в общем виде запрещают автоматизированный доступ, но это договорное соображение, а не уголовное, и применение санкций против отдельных исследователей или аналитиков фактически отсутствует.

Давайте поместим это в контекст, а не оставим расплывчатым:

Закон Computer Fraud and Abuse Act в США, Computer Misuse Act в Великобритании и GDPR в ЕС — все они касаются несанкционированного доступа к системам и защиты персональных данных.

Парсинг общедоступных, анонимизированных агрегированных данных из Google Trends не затрагивает ни одну из этих правовых рамок сколько-нибудь существенно.

Решение Девятого окружного суда США 2022 года по делу HiQ Labs против LinkedIn установило, что парсинг общедоступных данных — данных, для просмотра которых не требуется вход или аутентификация, — не является нарушением CFAA.

Условия использования Google — это отдельное соображение. Это договор между вами и Google, а не закон. Их нарушение может привести к блокировке IP или прекращению обслуживания — технические последствия, а не юридические.

Прагматичная схема, используемая профессионалами:

Ограничивайте количество запросов. Не отправляйте сотни запросов в минуту. Разумный автоматизированный доступ имитирует поведение человека.

Собирайте то, что нужно для анализа. Не архивируйте весь набор данных без цели.

Не распространяйте собранные данные в коммерческих целях. Именно здесь вопросы лицензирования становятся реальными.

Используйте данные для получения инсайтов. Контентная стратегия, исследования и бизнес-аналитика — это цели, для информирования которых был разработан Google Trends.

Подавляющее большинство SEO-специалистов, журналистов, научных исследователей и аналитиков данных, которые собирают данные Google Trends, делают это ежедневно без каких-либо инцидентов. Риск реален в теории, но незначителен на практике для легитимных сценариев использования.

Понимание данных Google Trends

Прежде чем писать код, важно понимать, что вы извлекаете, потому что данные Google Trends имеют особенность, которая сбивает с толку новичков и расстраивает пользователей среднего уровня.

Google Trends не показывает абсолютные объемы поиска:

Он показывает относительный интерес — оценку от 0 до 100, где 100 представляет пиковый интерес в выбранном вами временном диапазоне и географии.

50 означает половину от пика.

0 означает недостаточно данных для отображения.

Это намеренно нормализованные данные.

Google не публикует необработанные данные об объеме поиска через Trends.

Что это означает на практике:

Если вы извлекаете данные по запросу «электромобили» за 5 лет, оценка пиковой недели составляет 100.

Каждая другая неделя оценивается относительно этого пика.

Если затем вы извлечете отдельный запрос по «солнечным панелям» за тот же период, его пик также получит оценку 100, даже если абсолютный объем поиска по «солнечным панелям» составлял лишь десятую часть от «электромобилей».

Это проблема нормализации. Она делает сравнение запросов в рамках одного извлечения данных значимым, но ненадежным при отдельных извлечениях данных.

Решение: Всегда сравнивайте ключевые слова в рамках одного вызова pytrends build_payload(). Включение постоянного «якорного» ключевого слова (с стабильным, хорошо понятным объемом поиска) в каждую партию позволяет нормализовать данные при множественных извлечениях.

Например, включение «погода» — ключевого слова с постоянным, предсказуемым объемом поиска — в качестве якоря в каждую партию позволяет калибровать относительный интерес сопоставимым образом при отдельных запросах.

Сравнение методов: какой подход к сбору данных подходит вам

Прежде чем погрузиться в каждый метод, вот таблица для принятия решения:

Метод | Сложность | Надежность | Скорость | Лучший сценарий использования | Основное ограничение |

pytrends (библиотека Python) | Для начинающих | Высокая | Быстрая | Большинство стандартных случаев использования | Ограничения скорости при больших объёмах |

Прямые HTTP-запросы | Средний | Средняя– Высокая | Быстро | Пользовательские параметры, пакетная обработка | Требуется управление заголовками/куками |

Автоматизация браузера (Playwright) | Продвинутый | Очень высокая | Медленно | Сложные страницы, обход CAPTCHA | Ресурсо- затратный |

No-code платформы (Apify и др.) | Начальный | Средняя | Переменная | Для не-разработчиков, быстрый экспорт | Постоянная стоимость подписки |

Ручной экспорт в CSV | Отсутствует | Идеальная | Очень медленно | Разовый небольшой набор данных | Не масштабируется |

Начните с pytrends. Переходите к автоматизации браузера только когда pytrends стабильно не справляется с вашим конкретным случаем использования.

Метод 1: Pytrends

Прямой ответ: pytrends — это неофициальная библиотека Python , которая взаимодействует с внутренним APIданных Google Trends. Она не требует API-ключа, устанавливается за секунды и справляется с наиболее распространёнными задачами извлечения данных с минимальным количеством кода. Это правильная отправная точка практически для всех.

Что такое Pytrends

pytrends (изначально созданная пользователем GeneralMills, сейчас поддерживается open-source сообществом) доступна как на GitHub, так и на PyPI.

Он абстрагирует внутренние конечные точки Google Trends в чистые вызовы функций Python, автоматически обрабатывая куки аутентификации, форматирование запросов и парсинг ответов.

Это не официальный продукт Google. Google его не поддерживает.

Но он надёжно работает для подавляющего большинства стандартных случаев использования и активно применяется с 2015 года, с постоянной поддержкой сообщества до 2026 года.

Установка pytrends: bash

pip install pytrends

Требуется Python 3.7 или новее. Это всё, что нужно для установки.

Ваша первая выгрузка данных

Этот скрипт получает данные о недельном интересе для одного ключевого слова за последние 12 месяцев:

from pytrends.request import TrendReq

# Initialize — hl sets the language, tz sets the timezone offset

pytrends = TrendReq(hl='en-US', tz=360)

# Build the payload — specify up to 5 keywords here

pytrends.build_payload(

kw_list=['artificial intelligence'],

timeframe='today 12-m',

geo='' # Empty string = worldwide

)

# Pull interest over time

data = pytrends.interest_over_time()

print(data.head(10))Запустите его, и вы получите pandas DataFrame — таблицу с датами в качестве индекса строк и недельными показателями интереса (0–100) в качестве значений. Столбец isPartial указывает на недели, которые ещё не полностью проиндексированы; отфильтруйте его для чистого анализа:

data = data[data['isPartial'] == False]Сравнение нескольких ключевых слов

Одна из самых мощных функций pytrends — прямое сравнение ключевых слов, до пяти одновременно, нормализованных к одной шкале в 100 баллов:

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

kw_list=['ChatGPT', 'Gemini', 'Claude AI', 'Copilot'],

timeframe='today 12-m',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Which platform has the highest average interest?

print(data[['ChatGPT', 'Gemini', 'Claude AI', 'Copilot']].mean())Эти сравнительные данные действительно стратегически важны. Если вы создаёте контент в сфере AI-инструментов, знание того, какая платформа показывает рост поискового интереса, а какая стагнирует, подсказывает, куда активно смещается внимание аудитории — до того, как это изменение станет видно в любом другом источнике данных.

Географические данные об интересе

Где в мире сконцентрирован интерес? Это получает данные на уровне стран:

pytrends.build_payload(

kw_list=['electric vehicles'],

timeframe='today 12-m'

)

# Country-level interest

by_country = pytrends.interest_by_region(resolution='COUNTRY', inc_low_vol=True)

# Sort by interest descending

print(by_country.sort_values('electric vehicles', ascending=False).head(20))

Для региональной детализации внутри одной страны (штаты США, регионы Великобритании) настройте параметр resolution:

by_state = pytrends.interest_by_region(resolution='REGION', geo='US')Это бесценно для бизнеса, принимающего решения о географической экспансии, или для рекламодателей, распределяющих региональные бюджеты.

Растущие связанные запросы: самая недооценённая функция

Вот где Google Trends становится настоящим инструментом контент-аналитики:

python

pytrends.build_payload(

kw_list=['remote work tools'],

timeframe='today 3-m'

)

related = pytrends.related_queries()

# Rising queries — growing fastest relative to their usual volume

print(related['remote work tools']['rising'])

# Top queries — highest absolute interest

print(related['remote work tools']['top'])Растущие связанные запросы показывают, что люди ищут вместе с вашим ключевым словоми что растёт быстрее всего по объёму. Для контент-маркетологов это от трёх до шести недель опережающей информации о ключевых словах. Опубликуйте материал по растущему связанному запросу до того, как он достигнет пика интереса, и ваш контент окажется на кривой спроса, а не будет за ней гнаться.

Трендовые поиски в реальном времени

Для мониторинга того, что сейчас в тренде:

trending_today = pytrends.trending_searches(pn='united_states')

print(trending_today.head(20))Это возвращает топ-20 трендовых поисков в указанной стране на момент запроса. Полезно для мониторинга новостей, стратегий реактивного контента и выявления трендов в социальных сетях.

Метод 2: Прямые HTTP-запросы

Прямой ответ: Прямые HTTP-запросы дают вам детальный контроль над параметрами запроса, заголовками и управлением сессиями, которые pytrends абстрагирует. Это подходит для продвинутых пользователей, которым нужны кастомные форматы временных рамок, точная фильтрация по категориям или управление пакетными запросами большого объёма.

Под капотом pytrends делает GET-запросы к внутренним конечным точкам Google Trends, в основном:

https://trends.google.com/trends/api/widgetdata/multiline

https://trends.google.com/trends/api/explore

Эти конечные точки возвращают JSON-данные с защитным префиксом ()]}'), который необходимо удалить перед парсингом.

Они также требуют специфических куки сессии и заголовков, которые проверяет сервер Google.

Вот рабочий паттерн с использованием библиотеки requests:

import requests

import json

session = requests.Session()

# First, establish a session by visiting the main Trends page

session.get('https://trends.google.com/')

# The explore endpoint generates widget tokens for data requests

params = {

'hl': 'en-US',

'tz': '-360',

'req': json.dumps({

"comparisonItem": [

{"keyword": "python programming", "geo": "", "time": "today 12-m"}

],

"category": 0,

"property": ""

}),

'token': '',

'user_type': ''

}

response = session.get(

'https://trends.google.com/trends/api/explore',

params=params

)

# Strip the protection prefix before parsing

clean_response = response.text.lstrip(")}']\n")

data = json.loads(clean_response)Это сложнее, чем PyTrends, но даёт вам точный контроль над каждым аспектом запроса. Большинству пользователей не нужен такой уровень контроля, но для производственных конвейеров со специфическими требованиями к пакетной обработке или нестандартными форматами временных рамок это подходящий подход.

Метод 3: Автоматизация браузера с помощью Playwright

Прямой ответ: Playwright автоматизирует настоящий браузер, делая ваше поведение при скрейпинге практически неотличимым от подлинного просмотра человеком. Это наиболее надёжный метод для избежания лимитов запросов и CAPTCHA, но он значительно медленнее и более ресурсоёмкий, чем подходы на основе API.

Когда использовать Playwright вместо pytrends:

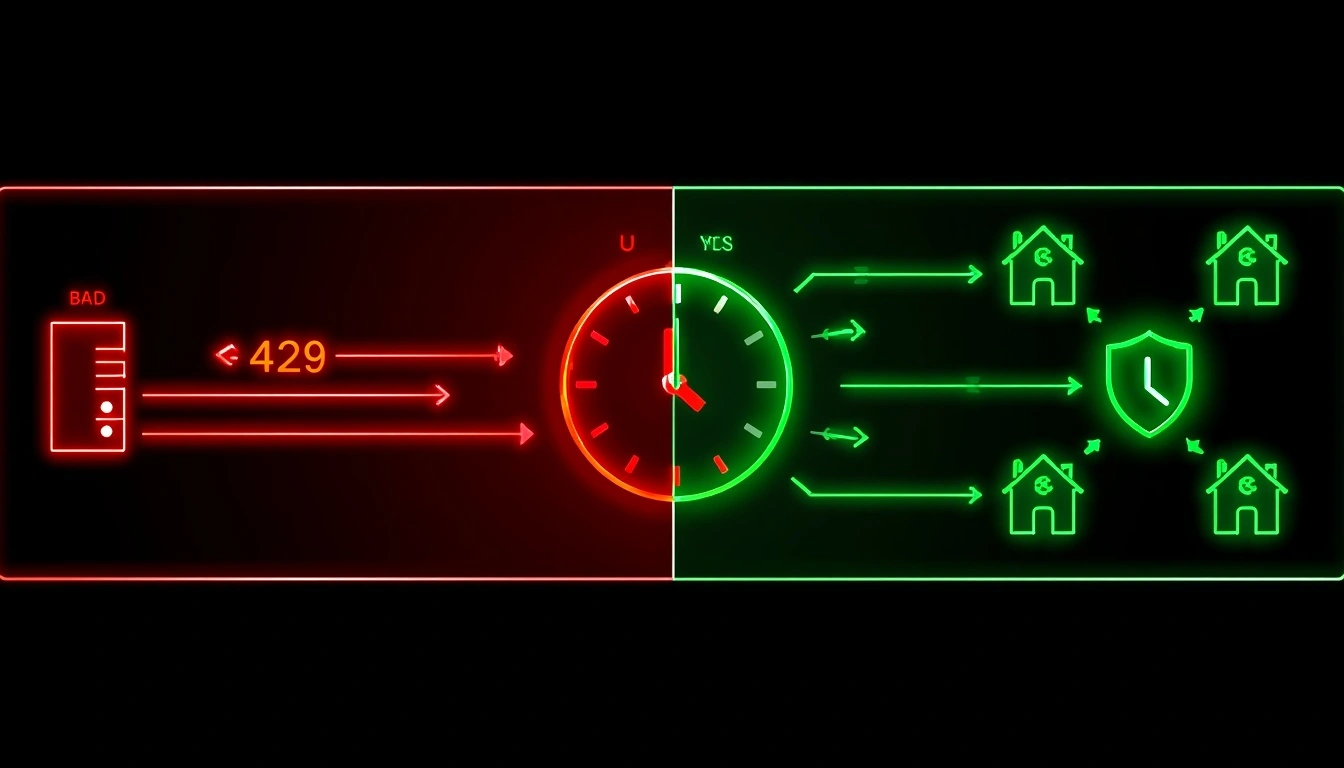

pytrends возвращает постоянные ошибки 429, даже с прокси и задержками

Вам нужно захватить визуальные или интерактивные элементы страницы, не доступные через API

Вам нужно обрабатывать вызовы CAPTCHA (с соответствующими сторонними решателями)

Вы скрейпите нишевые страницы Trends со сложными паттернами навигации

Надёжная настройка Playwright:

from playwright.sync_api import sync_playwright

import time

with sync_playwright() as p:

# Launch browser — headless=False for debugging, True for production

browser = p.chromium.launch(headless=True)

# Create a context with realistic browser settings

context = browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36',

viewport={'width': 1280, 'height': 800}

)

page = context.new_page()

# Navigate to Trends

page.goto('https://trends.google.com/trends/explore?q=python+programming&date=today+12-m&geo=US')

# Wait for the data chart to render

page fully

.wait_for_selector('[class*="widget"]', timeout=10000)

# Add human-like delay

time.sleep(3)

# Extract page content for parsing

content = page.content()

# Alternatively, intercept the API response directly

# This is more reliable than parsing HTML

browser.close()

print("Data extracted successfully")Более продвинутый подход перехватывает сетевые запросы, которые Playwright делает при загрузке страницы, захватывая ответ API напрямую, а не парсинг отрендеренного HTML. Это сочетает преимущества скрытности автоматизации браузера с более чистым форматом данных из ответов API. [Читайте о документации Playwright для Python]

Почему возникают лимиты запросов и как с ними справляться

Это раздел, который большинство руководств упускают, и именно поэтому новички застревают после первых нескольких успешных запросов.

Google Trends имеет ограничение по IP-адресам. Отправьте слишком много запросов за короткий промежуток времени с одного IP-адреса, и вы начнёте получать ошибки 429 (Слишком много запросов). В некоторых конфигурациях вместо этого вы получите вызов CAPTCHA. Ни то, ни другое не означает, что ваш код сломан; это означает, что вы активировали автоматическое управление трафиком Google.

Решение 1: Добавьте задержки между запросами

Самое простое решение. Вызов time.sleep() между запросами позволяет системам Google сбросить счётчик для каждого IP:

import time

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

keywords = [

'content marketing', 'SEO strategy', 'link building',

'technical SEO', 'keyword research', 'on-page SEO'

]

results = {}

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m')

results[keyword] = pytrends.interest_over_time()

print(f"✓ {keyword}")

time.sleep(15) # 15 seconds between requests

print("All keywords retrieved.")Для пакетных заданий с до 50 ключевых слов за сессию обычно достаточно задержек в 10–15 секунд. Для больших пакетов увеличьте до 30–60 секунд и разделите на несколько сессий.

Решение 2: Ротационные резидентские прокси

Для автоматизации большего объёма ротация IP — правильное архитектурное решение. Каждый запрос проходит через другой IP-адрес, поэтому ни один IP-адрес не накапливает достаточно запросов для активации ограничения.

Не все прокси одинаковы для этого случая использования.

Google поддерживает обширные списки диапазонов IP датацентров: AWS, Google Cloud, DigitalOcean, Vultr, и ограничивает трафик из этих источников гораздо агрессивнее, чем трафик с резидентских адресов.

Использование прокси датацентра для скрейпинга Google часто вообще не обеспечивает значимой защиты.

Резидентские прокси направляют трафик через IP-адреса, назначенные реальным клиентам провайдеров, домашним интернет-соединениям и мобильным устройствам.

Для систем Google этот трафик неотличим от настоящих пользователей.

Использование прокси CyberYozh для стабильного скрейпинга Google Trends

Прямой ответ: Резидентские прокси предотвращают ограничение запросов Google Trends, распределяя запросы по тысячам различных резидентских IP-адресов. CyberYozh предлагает ротационные резидентские и мобильные прокси с возможностями геотаргетинга, особенно хорошо подходящие для автоматизации Google Trends.

Интеграция прокси CyberYozh в рабочий процесс pytrends:

from pytrends.request import TrendReq

import time

import random

# CyberYozh proxy configuration

proxy_config = {

'https': 'https://USERNAME:PASSWORD@gate.cyberyozh.com:PORT'

}

# Initialize pytrends with proxy support

pytrends = TrendReq(

hl='en-US',

tz=360,

requests_args={

'proxies': proxy_config,

'verify': True

}

)

keywords = ['machine learning', 'deep learning', 'neural networks',

'computer vision', 'natural language processing']

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m', geo='US')

data = pytrends.interest_over_time()

print(f"Retrieved: {keyword} — {len(data)} weeks of data")

time.sleep(random.uniform(8, 20)) # Randomize delays to mimic human behaviorrandom .uniform(8, 20) рандомизация задержки важна; предсказуемо равномерные интервалы (ровно 10 секунд каждый раз) сами по себе могут быть идентифицированы как автоматизированное поведение при помощи продвинутого анализа трафика.

Географический таргетинг для данных Trends:

Одно из часто упускаемых из виду применений географического таргетинга прокси — это получение данных Trends, отражающих подлинное локальное поисковое поведение.

Google Trends калибрует относительный интерес на основе географии запроса в некоторых конфигурациях.

Резидентский IP из США, запрашивающий данные для географического параметра США, даёт более стабильные результаты, чем IP не из США.

Таргетинг IP на уровне страны от CyberYozh изначально поддерживает этот сценарий использования, что полезно для агентств, проводящих анализ Trends на нескольких рынках, или исследователей, которым нужны географически репрезентативные данные.

Ознакомьтесь с каталогом прокси CyberYozh , чтобы получить самые доступные и надёжные IP по всему миру.

Для скрейпинга на основе Playwright конфигурация прокси немного отличается:

python

from playwright.sync_api import sync_playwright

with sync_playwright() as p:

browser = p.chromium.launch(

headless=True,

proxy={

"server": "https://gate.cyberyozh.com:PORT",

"username": "USERNAME",

"password": "PASSWORD"

}

)

# ... rest of automation codeПроблема нормализации: как сравнивать данные из нескольких запросов

Это проблема, которая больше всего сбивает с толку пользователей среднего уровня, и её редко объясняют в руководствах конкурентов.

Google Trends нормализует данные в рамках каждого запроса.

Точка наивысшего интереса в указанном вами временном диапазоне всегда равна 100.

Это имеет смысл для визуализации траектории одного ключевого слова.

Но это создаёт проблему, когда вы хотите сравнить два ключевых слова, полученных в отдельных запросах.

Сценарий: Вы запрашиваете данные для «ключевого слова A» и получаете пик 100 в марте. Затем вы отдельно запрашиваете данные для «ключевого слова B» и также получаете пик 100 в марте. Означает ли это, что у них был одинаковый объём поиска? Почти наверняка нет. Просто так получилось, что они оба были на своих соответствующих пиках.

Техника нормализации с опорным ключевым словом:

Включайте стабильное эталонное ключевое слово в каждую партию — слово с хорошо понятным, стабильным объёмом поиска. Часто используемые опорные слова включают «Facebook», «YouTube» или «weather» — ключевые слова, которые поддерживают относительно стабильный поисковый интерес из месяца в месяц.

from pytrends.request import TrendReq

import pandas as pd

import time

pytrends = TrendReq(hl='en-US', tz=360)

# Batch 1: Compare keyword sets against anchor

batch_1 = ['Facebook', 'content marketing', 'email marketing', 'social media marketing']

batch_2 = ['Facebook', 'SEO', 'PPC advertising', 'influencer marketing']

pytrends.build_payload(batch_1, timeframe='today 12-m', geo='US')

data_1 = pytrends.interest_over_time()[batch_1]

time.sleep(15)

pytrends.build_payload(batch_2, timeframe='today 12-m', geo='US')

data_2 = pytrends.interest_over_time()[batch_2]

# Now normalize both datasets against the anchor (facebook)

# The anchor's values are comparable across batches because they were in both

anchor = 'facebook'

data_1_normalized = data_1.div(data_1[anchor], axis=0)

data_2_normalized = data_2.div(data_2[anchor], axis=0)

# Now you can meaningfully compare any keyword from batch 1 with any from batch 2

print("Normalized comparison:")

print(pd.concat([

data_1_normalized.drop(columns=[anchor]),

data_2_normalized.drop(columns=[anchor])

], axis=1).mean())

Профессиональные аналитики данных используют эту технику, и она редко документируется во вводных руководствах. Она открывает возможность сравнивать десятки ключевых слов из нескольких пакетных запросов с осмысленными, сопоставимыми результатами.

Реальные сценарии использования: что вы на самом деле делаете с этими данными

Данные без применения — это просто интересная таблица. Вот как выглядит осмысленный анализ Google Trends на практике:

Оптимизация контент-календаря

Еженедельно получайте растущие связанные запросы для ваших основных тематических кластеров.

Когда связанное ключевое слово пересекает отметку 40+ по шкале от 0 до 100 и продолжает расти, немедленно публикуйте целевой материал по этой теме.

Целитесь на кривую роста, а не на пик.

Планирование сезонных запасов и рекламных расходов

Пятилетние данные о еженедельном интересе выявляют сезонные паттерны с замечательной надёжностью.

Ритейлер, продающий садовую мебель, может точно увидеть, когда весенний интерес начинает расти на его целевых рынках, обычно за 4–6 недель до пика покупательского поведения, и соответственно планировать свои платные кампании.

Приоритизация SEO-ключевых слов

Перед инвестированием в контент-кампанию для целевого ключевого слова проверьте его траекторию.

Ключевое слово с 30 000 ежемесячных поисков и растущей траекторией в Trends — это лучшая инвестиция, чем слово с 50 000 поисков и падающей траекторией.

Вы вкладываетесь в растущий рынок, а не в сокращающийся.

Конкурентная разведка брендов

Отслеживайте интерес к брендовым поисковым запросам ваших конкурентов с течением времени.

Устойчивый рост брендовых запросов конкурента — это сигнал раннего предупреждения, более информативный, чем их опубликованные метрики, и доступный в режиме реального времени.

Индикаторы финансовых настроений

Поисковый интерес к категориям вроде «рефинансирование ипотеки», «рецессия», «увольнения» и «подработка» служит опережающим индикатором потребительских настроений.

Крупные хедж-фонды и институты экономических исследований используют Google Trends как один из входных параметров в более широких моделях экономического прогнозирования.

Академические исследования и журналистика

Количественная оценка общественного внимания к новостным событиям, изменениям в политике, публичным фигурам и культурным моментам с течением времени предоставляет проверяемые, цитируемые доказательства паттернов коллективного интереса, которые более объективны, чем редакторское суждение.

Экспорт и визуализация данных Google Trends

Получив данные, наиболее распространённые следующие шаги — это экспорт и визуализация:

from pytrends.request import TrendReq

import matplotlib.pyplot as plt

import pandas as pd

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

['AI tools', 'automation software'],

timeframe='today 5-y',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Export to CSV for spreadsheet analysis

data.to_csv('google_trends_export.csv')

print("CSV exported successfully.")

# Create a clean visualization

fig, ax = plt.subplots(figsize=(14, 6))

data['AI tools'].plot(ax=ax, label='AI Tools', color='#2563EB', linewidth=2)

data['automation software'].plot(ax=ax, label='Automation Software', color='#7C3AED', linewidth=2)

ax.set_title('Search Interest Comparison: AI Tools vs Automation Software (5 Years, US)',

fontsize=14, fontweight='bold', pad=20)

ax.set_ylabel('Interest Score (0–100)', fontsize=11)

ax.set_xlabel('')

ax.legend(fontsize=11)

ax.grid(True, alpha=0.3)

ax.set_ylim(0, 110)

plt.tight_layout()

plt.savefig('trends_comparison.png', dpi=150, bbox_inches='tight')

plt.show()Для команд, которые предпочитают электронные таблицы Python, экспорт CSV полностью совместим с Excel и Google Sheets. Структура pandas DataFrame чётко отображается в табличные форматы, с датами в столбце A и значениями интереса к ключевым словам в последующих столбцах.

Устранение наиболее распространённых ошибок и способы их исправления

Ошибка: 429 Too Many Requests Вы превысили лимит запросов Google на IP-адрес. Добавьте или увеличьте задержки time.sleep() между запросами (начните с 15–30 секунд). При постоянных ошибках 429 при любом уровне задержки внедрите ротационные резидентские прокси.

Ошибка: ResponseError 500. Обычно это временная проблема сервера со стороны Google. Подождите 5–10 минут и повторите попытку. Иногда вызывается некорректными параметрами payload, дважды проверьте формат строки временного диапазона ('today 12-m', 'today 3-m', '2022-01-01 2023-12-31').

Возвращён пустой DataFrame. У вашего ключевого слова недостаточный объём поиска для указанной географии или временного диапазона. Попробуйте расширить параметр geo, установив его в (пустую строку для всего мира) или расширив временной диапазон. Некоторые высокоспецифичные длиннохвостые ключевые слова просто не имеют достаточных данных для возврата результатов.

Вызван CAPTCHA-вызов, Google подозревает автоматизированный доступ. Переключитесь на резидентские прокси, существенно увеличьте задержки и сократите объём запросов за сессию. Автоматизация браузера с Playwright более устойчива к триггерам CAPTCHA, чем прямые API-запросы.

Установка pytrends не удалась. Убедитесь, что установлен Python 3.7+: python --version. Попробуйте сначала обновить pip: pip install --upgrade pip, затем pip install pytrends.

Только частичные данные (isPartial = True для большинства строк). Последние 2–3 дня данных Trends всегда частичные; Google ещё не полностью их проиндексировал. Отфильтруйте эти строки: data = data[data['isPartial'] == False].

Кросс-батч нормализация дает непоследовательные результаты. См. раздел о нормализации якорных ключевых слов выше. Всегда включайте стабильное опорное ключевое слово в каждый батч, чтобы обеспечить осмысленное сравнение между батчами. [Подробнее об ошибке 499 и ошибке 520]

Курируемые ресурсы на GitHub

Вместо того чтобы «искать на GitHub и найдете что-то полезное», вот конкретные ресурсы, которые стоит добавить в закладки:

Официальный репозиторий pytrends: Каноничный справочник по документации методов, известным проблемам и списку изменений. Вкладка Issues содержит решения для подавляющего большинства редких ошибок.

Проекты дашбордов трендовых поисковых запросов: несколько поддерживаемых сообществом репозиториев построены на основе pytrends для создания дашбордов трендовых ключевых слов в реальном времени. Ищите «pytrends dashboard» на GitHub для поиска наиболее актуальных вариантов.

Утилиты нормализации данных Trends: репозитории, специально посвященные проблеме кросс-батч нормализации, обсуждаемой выше. Ищите «Google Trends normalization Python», чтобы найти варианты с наибольшим количеством звезд.

Apify Google Trends скрапер: Для не-разработчиков, которым нужны данные Google Trends без написания кода, поддерживаемый Apify актор Google Trends предоставляет интерфейс без кода с запланированными запусками и экспортом данных. Стоимость варьируется в зависимости от объема использования.

Постройте пайплайн один раз, используйте его вечно

Google Trends — один из немногих действительно бесплатных, действительно мощных источников данных, который большинство людей использует лишь на 10% его потенциала. Разовые инвестиции в настройку пайплайна pytrends, даже базового, работающего еженедельно по расписанию, дают вам непрерывную систему раннего предупреждения о растущих темах, меняющихся интересах аудитории и возникающей конкурентной динамике.

Настройте основы сегодня. Добавьте прокси-инфраструктуру по мере роста объема. И начните относиться к публичному поисковому поведению как к стратегическому разведывательному активу, которым оно на самом деле является, а не как к чему-то, что вы проверяете вручную, когда вспомните.

Данные обновляются непрерывно. Обращаете ли вы на них внимание — единственная переменная, которую вы контролируете.