Автоматизация веб-скрейпинга: Как запускать скрейперы по расписанию

Здесь мы рассмотрим технические особенности автоматизации веб-скрапинга— процесса, на который полагаются многие компании для получения качественных данных, будь то исследование рынка, информация о SEO/SERP или мнения клиентов. Важная часть процесса заключается в том, что большинство сервисов быстро помечают и ограничивают множественные запросы за короткие промежутки времени, которые неизбежны при автоматизированном скрапинге, поэтому крайне важно распределять нагрузку запросов между несколькими IP-адресами с помощью ротационных прокси.

Что такое автоматизация веб-скрапинга

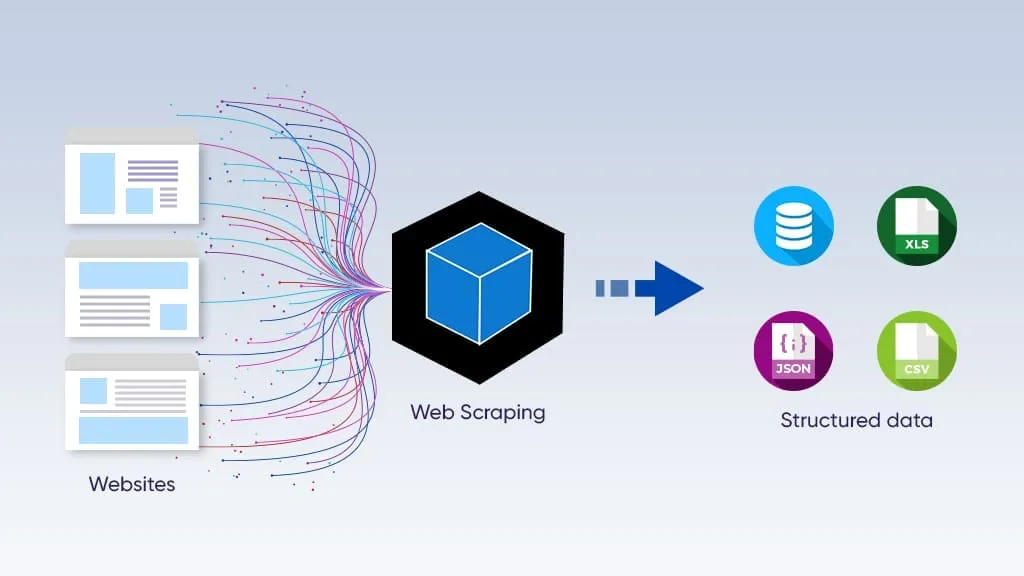

Автоматизация веб-скрапинга — это программируемый процесс подключения к веб-серверам и извлечения данных из них без ручной работы. Всё, что нужно, — это настроить веб-скрапер и создать для него инструкции. После этого он выполняет всю работу самостоятельно. Обычно результирующие файлы представляют собой таблицы в форматах .csv или .json, либо файлы баз данных, которые можно обрабатывать с помощью SQL-запросов.

Важно помнить, что платформы ограничивают массовые автоматизированные потоки запросов, типичные для веб-скрапинга. Именно поэтому прокси необходимы для этого процесса. Подробнее о сервисах ротации IP и о том, как использовать их для избежания блокировок и ограничений

Подходы к автоматизации веб-скрапинга

Существует два основных подхода к автоматизации веб-скрапинга: использование low-code платформ для его настройки или написание Python-скриптов с помощью специализированных библиотек и фреймворков.

No-code/low-code инструменты

Эти инструменты предлагают интерфейсы типа «укажи и щёлкни», часто визуальные, которые можно использовать без знания программирования. Это может помочь, поскольку некоторые из этих платформ позволяют настраивать через программирование, но это не обязательно. Пользователи определяют правила скрапинга, щёлкая по элементам страницы, настраивая логику пагинации и конфигурируя форматы вывода, такие как CSV или JSON, — всё это через графический интерфейс.

Их легко настроить, но у них также есть множество ограничений:

No-code скраперы легко ломаются, когда целевой сайт меняет свою структуру.

Они плохо справляются с динамическими страницами, насыщенными JavaScript, или с пользовательской бизнес-логикой.

Они становятся дорогими при масштабировании, и их сложно настраивать.

Эти инструменты в основном используются маркетологами, бизнес-аналитиками, менеджерами электронной коммерции и предпринимателями. Тем не менее, решения на основе программирования лучше подходят для крупномасштабного скрапинга.

Решения на основе программирования

Эти инструменты представляют собой библиотеки и фреймворки, в основном для Python — наиболее широко используемого языка программирования. Скрапинг на основе программирования даёт разработчикам полный, детальный контроль над каждым аспектом процесса извлечения данных: от того, как отправляются HTTP-запросы, до того, как данные парсятся, сохраняются и планируются.

Ключевое ограничение — это технический барьер: создание, поддержка и планирование промышленных скраперов требует навыков программирования, времени на отладку и решений по инфраструктуре. Этот подход используется инженерами данных, backend-разработчиками, специалистами по данным и growth-хакерами, которым нужны надёжность, настройка и программируемость.

Прокси для веб-автоматизации и почему они необходимы

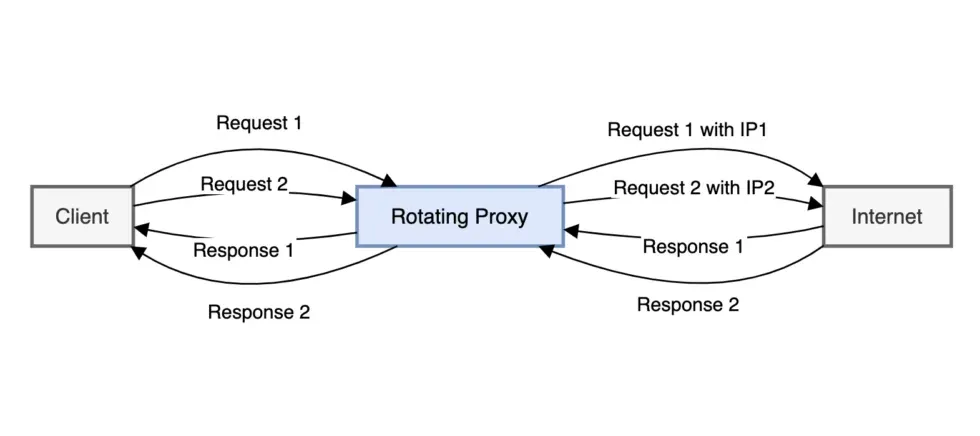

Большинство сайтов, за исключением крупных открытых баз данных (которые обычно предназначены для скрапинга), ограничивают количество запросов, разрешённых с одного IP-адреса. Когда пользователь превышает этот лимит, платформа ограничивает запросы, предлагая пользователю CAPTCHA или блокируя его. Кроме того, платформы отслеживают все запросы, их IP-адреса и другие следы (такие как данные браузера), чтобы найти несоответствия и поведение, характерное для ботов, и помечают подозрительные адреса, даже если они не превышают лимит. Вот почему здесь нужны пул прокси-IP и антидетект-браузинг: они смягчают эти проблемы.

Ротация прокси означает, что каждый запрос (или группа запросов) отправляется с разных IP-адресов. В основном существует два типа:

Мобильные прокси используют IP-адреса от мобильных интернет-провайдеров (LTE/5G) и имеют наивысший уровень доверия, поскольку платформы не отличают их от пользователей мобильного интернета. Они лучше всего подходят для скрапинга данных из социальных сетей.

Резидентские ротационные прокси используют пул резидентских IP-адресов и ротируют между ними согласно заданному алгоритму. Их уровень доверия ниже, но всё ещё хорош для большинства платформ, и они являются хорошим вариантом для большинства задач веб-скрапинга.

Перед использованием любого IP-адреса следует оценить его качество с помощью IP Checkerот CyberYozh, который отображает его Fraud Score.

Антидетект-браузеры дополнительно повышают безопасность, предоставляя отдельный набор цифровых отпечатков для каждой сессии. В сочетании с чистым IP каждая сессия теперь выглядит как подлинная цифровая личность, и вероятность блокировок и CAPTCHA-вызовов значительно снижается.

Подробнее об антидетекте и о том, как он работает.

Какие сервисы веб-скрапинга и автоматизации наиболее надёжны

Автоматизация веб-скрапинга включает использование различных инструментов и техник для планирования и выполнения задач извлечения данных без ручного вмешательства. Лучший метод зависит от ваших знаний программирования, сложности целевого сайта и желаемого масштаба операции. Независимо от метода, важно комбинировать ваш скрапер с ротационными прокси, чтобы гарантировать, что ваши сессии не будут заблокированы.

Специализированные no-code платформы

Специально созданные платформы для скрапинга объединяют визуальные конструкторы скраперов с облачной инфраструктурой, встроенным планированием, ротацией прокси и обработкой CAPTCHA без необходимости программирования.

Scrapeless предлагает специализированные scraping-акторы для платформ e-commerce (Amazon, Shopee), конкурентного мониторинга и отслеживания AI-видимости (ChatGPT, Gemini и др.). В арсенале платформы — облачный Scraping Browser, Universal Scraping API и AI-native Agent Browser с интеграциями MCP/CLI. Новые пользователи получают $10 в качестве пробных кредитов. Оптимальное решение для технических команд и AI-разработчиков, создающих масштабируемые пайплайны данных с бесшовной интеграцией в агентные воркфлоу.

Octoparse — это конструктор скраперов с интерфейсом «укажи и кликни», облачным выполнением, автоопределением шаблонов и запланированными запусками для электронной коммерции и сбора лидов.

Apify предлагает маркетплейс из более чем 1500 готовых скрейпинговых «Акторов» для популярных сайтов с облачным хостингом и выводом через API.

Browse.ai специализируется на мониторинге сайтов; он обнаруживает изменения и запускает оповещения без ручной переконфигурации.

Web Scraper — это браузерное расширение, дружелюбный для новичков скрапер с облачным планированием для простого извлечения структурированных данных.

Лучше всего подходит для маркетологов, аналитиков и бизнес-команд, которым нужен регулярный сбор данных без привлечения разработчиков.

Платформы автоматизации

Универсальные инструменты автоматизации связывают этапы веб-скрейпинга с более широкими бизнес-процессами, направляя извлечённые данные в CRM, таблицы или мессенджеры.

Zapier связывает триггеры скрейпинга с более чем 6000 приложений; идеален для лёгкой передачи данных, например новые объявления → Slack или Google Sheets.

n8n — это открытый, самостоятельно размещаемый конструктор рабочих процессов с узлами HTTP-запросов, предлагающий больше контроля и пользовательской логики, чем Zapier.

Эти платформы подходят операционным и ростовым командам, которые хотят немедленно действовать на основе собранных данных: автоматизировать уведомления, маршрутизацию лидов или отчётные конвейеры, а не просто хранить их.

Библиотеки Python

Библиотеки Python дают разработчикам полный программный контроль над логикой скрейпинга, планированием и обработкой данных — от простого парсинга HTML до полной автоматизации браузера.

Scrapy — это продакшн-готовый фреймворк для краулинга со встроенными конвейерами, промежуточным ПО и планированием для высокообъёмного извлечения данных. Установите его через pip командой pip install scrapy

BeautifulSoup + Requests — это лёгкая связка для парсинга статичных HTML-страниц; быстро прототипируется, но ограничена для динамических сайтов.

Playwright/Puppeteer/Selenium — все это инструменты автоматизации браузеров в безголовом режиме, которые обрабатывают рендеринг JavaScript, пользовательские взаимодействия и сложные потоки входа.

Выбор разработчиков и дата-инженеров, создающих кастомные масштабируемые конвейеры, требующие точного контроля над прокси, обработкой ошибок и последующей обработкой данных.

Запуск планировщика для автоматического управления скрапером

После настройки инструмента скрейпинга его активность также следует автоматизировать. Скрапер автоматизирует извлечение веб-данных, но другой инструмент, называемый планировщиком, автоматизирует, когда скрапер должен работать, а когда простаивать. Также возможно включать и выключать его вручную, но планировщики обеспечивают больше контроля и точности, что, как мы уже видели, критически важно. Обычно используются два типа планировщиков: системного уровня и облачные.

Читайте больше о стратегиях ротации IP , чтобы выбрать ту, которая вам нужна.

Планировщики системного уровня

Начнём с первого типа. Типичные примеры — стандартные программы планирования для Unix-подобных операционных систем (включая macOS) и Windows.

Cron Jobs: Стандартный планировщик задач на основе времени для Unix-подобных операционных систем, идеален для запуска Python-скриптов по расписанию.

Windows Task Scheduler: Встроенный Windows-эквивалент для планирования запуска программ или скриптов в определённое время.

Обе программы имеют очень простой интерфейс, позволяющий пользователям запускать и останавливать другие программы в определённое время.

Облачные решения

Облачные платформы планирования развёртывают и запускают скрейпинговые скрипты в своих цифровых средах. Типичные примеры — GitHub Actions, AWS Lambda и Apache Airflow.

GitHub Actions — это бесплатная платформа CI/CD, которая может запускать ваши скрипты для скрейпинга на серверах GitHub, обеспечивая их выполнение даже когда ваш локальный компьютер выключен.

AWS Lambda — это высокомасштабируемый и экономически эффективный вариант для запуска скрейперов в облаке, просто загрузив код в среду выполнения и запустив его.

Apache Airflow — это платформа с открытым исходным кодом для программного создания, планирования и мониторинга рабочих процессов, подходящая для сложных конвейеров данных.

Эти платформы особенно хорошо подходят для совместного доступа и командной работы, когда несколько разработчиков работают над одним проектом, используя любой из этих инструментов.

Сводная таблица платформ для веб-скрейпинга и планирования

Давайте обобщим эти платформы для скрейпинга и планирования на основе принципов их использования, примеров и того, для чего они лучше всего подходят.

Тип платформы | Примеры | Лучше всего для | Кодирование |

Инструменты парсинга без кода | Octoparse, Browse AI, Apify | Не-разработчики, мониторинг | Нет |

Библиотеки Python | Scrapy, Playwright, BS4 | Полный контроль, пользовательская логика | Да |

Платформы автоматизации | n8n, Zapier, Airflow | Интеграция рабочих процессов | Низкий/опциональный |

Облачные планировщики | GitHub Actions, AWS Lambda | Бессерверные, постоянно работающие запуски | Умеренный |

Планировщики ОС | Cron (Unix), Планировщик заданий (Windows) | Локальное планирование скриптов | Минимальный |

Настройка автоматизированного веб-скрейпера: лучшие практики

Теперь давайте рассмотрим лучшие практики для запуска инструмента веб-скрейпинга.

Проверьте robots.txt

У веб-сайтов обычно есть специализированный файл под названием robots.txt , который указывает, какой контент можно, а какой нельзя сканировать. Обычно веб-сайты защищают свои страницы входа, пользовательскую панель управления и другие страницы с конфиденциальной информацией. Чтобы получить к нему доступ, просто добавьте его имя к корню веб-сайта (например, app.cyberyozh.com/robots.txt), и здесь вы увидите правила скрейпинга сайта. Не собирайте данные, которые запрещены к сбору.

Ротируйте IP с помощью прокси

Ротируйте IP-адреса, используя прокси-сервисы, чтобы избежать ограничения скорости и блокировки IP при масштабном скрейпинге. Обязательно проверяйте качество IP перед ротацией. С помощью чекера CyberYozh это можно автоматизировать, используя CyberYozh API, чтобы ротация происходила только в том случае, если целевой IP имеет низкий показатель мошенничества.

Внедрите случайные задержки

Добавляйте случайные задержки между запросами, чтобы избежать перегрузки целевого сервера или блокировки вашего IP-адреса. Убедитесь, что вы не нарушаете Условия использования сайта, делая слишком много запросов, так как это может нарушить работу сайта и привести к конфликту с платформой.

Узнайте больше о здоровье IP-адресов в статье цикл управления прокси от CyberYozh.

Обрабатывайте ошибки автоматически

Внедрите блоки try-catch или аналогичные механизмы обработки ошибок для решения потенциальных проблем, таких как сетевые ошибки или изменения структуры сайта. Это обеспечит подсчёт и отчётность о потенциальных ошибках до начала скрейпинга, чтобы вы могли адекватно отреагировать, сэкономить трафик и предотвратить проблемы.

Используйте безголовый браузинг

Чтобы сэкономить трафик, что критично при веб-скрейпинге, вы можете использовать метод безголового браузинга, когда ваш скрейпер получает доступ только к нужным вам данным (цены, стоимость, результаты поиска, листинги, комментарии пользователей и так далее) без пользовательского интерфейса. Поскольку Ротационные прокси обычно взимают плату за объём трафика, это также будет экономически эффективно.

Лучшие практики веб-скрейпинга: Резюме

Автоматизация веб-скрейпинга объединяет правильный инструмент для скрейпинга, надёжный планировщик и Ротационные прокси в единый, автономный конвейер данных. Независимо от того, являетесь ли вы маркетологом, использующим Octoparse, или разработчиком, создающим конвейеры Scrapy, основы остаются неизменными: распределяйте запросы по чистым IP, соблюдайте правила платформы и проактивно обрабатывайте ошибки. Резидентские прокси и Мобильные прокси CyberYozh в сочетании с его API для проверки IP предоставляют вам инфраструктуру для масштабного запуска скрейперов без блокировок и сбоев.

FAQ об автоматизации веб-скрейпинга

Что такое автоматизация веб-скрейпинга?

Программируемый процесс, который автоматически извлекает веб-данные по расписанию, без ручной работы, выводя результаты в CSV, JSON или базу данных.

Нужны ли мне навыки программирования для автоматизации веб-скрейпинга?

Платформы без кода, такие как Octoparse и Browse.ai , обрабатывают всё визуально. Программирование открывает больше возможностей и гибкости при масштабировании.

Почему скрейперы блокируются?

Сайты обнаруживают повторяющиеся запросы с одного IP и помечают поведение, похожее на бота. Следуют ограничения скорости, CAPTCHA и блокировки IP.

Что такое ротация IP и почему это важно?

Ротация IP отправляет каждый запрос с другого IP-адреса, предотвращая ограничение скорости и делая сессии скрейпинга похожими на реальных пользователей.

В чём разница между резидентскими и мобильными прокси для скрейпинга?

Мобильные прокси имеют наивысший уровень доверия и редко блокируются; Резидентские прокси предлагают больший пул и подходят для большинства общих задач скрейпинга.

Что такое cron job в веб-скрейпинге?

Системный планировщик на базе Unix, который автоматически запускает скрипт скрейпинга через определённые интервалы времени, например, ежедневно или ежечасно.

Могу ли я запускать скрейперы в облаке бесплатно?

Да. GitHub Actions предлагает бесплатное облачное выполнение скриптов скрейпинга по расписанию, даже когда ваш локальный компьютер выключен.

Что такое robots.txt и следует ли мне его соблюдать?

Файл, объявляющий, какие страницы сайт разрешает сканировать. Его соблюдение делает ваш скрейпер этичным и снижает юридические риски.

Что такое безголовый браузер и когда его следует использовать?

Браузер, который работает без пользовательского интерфейса, используется для эффективного скрейпинга страниц, отрендеренных JavaScript, при этом потребляя меньше пропускной способности и прокси-трафика.

Как проверить, чист ли мой прокси-IP перед использованием?

Используйте IP Checker от CyberYozh для получения показателя мошенничества (Fraud Score) для любого IP-адреса; это можно автоматизировать через CyberYozh API.