Что значит парсить данные: скрейперы, парсеры и прокси

Когда пользователи спрашивают, что означает парсинг данных, они интересуются систематическим преобразованием необработанного веб-кода в структурированные данные. Здесь мы рассмотрим этот процесс, и, как всегда, я постараюсь дать максимально ясный и продуманный ответ, подкреплённый отзывами пользователей и комментариями специалистов.

Коротко

Парсинг данных — это процесс преобразования необработанного HTML в чистые структурированные данные, и для надёжного выполнения этой задачи необходимо, чтобы правильный скрейпер, парсер и стратегия ротации прокси работали вместе.

Скрейперы собирают необработанное содержимое страниц; парсеры извлекают только нужные вам поля (цены, названия, отзывы) в формат JSON или CSV

Прокси и ротация IP предотвращают блокировки, но следует выбрать правильную стратегию: на каждый запрос для массовых задач, «липкие» сессии для входа в систему, временная ротация для планового мониторинга

Выбор фреймворка имеет значение: Scrapy для статичного масштабирования, Playwright для сайтов с большим количеством JavaScript, BeautifulSoup для лёгкого парсинга

Ключевые сценарии использования включают мониторинг цен, создание датасетов для ИИ, агрегацию туристических данных, отслеживание отзывов и генерацию лидов

Open Scraper от CyberYozh (бесплатный, на базе Playwright), а также пул из более чем 50 млн резидентских IP и IP Checker для обеспечения качества — покрывают весь процесс от сбора до чистых данных

Значение парсинга данных: основные определения

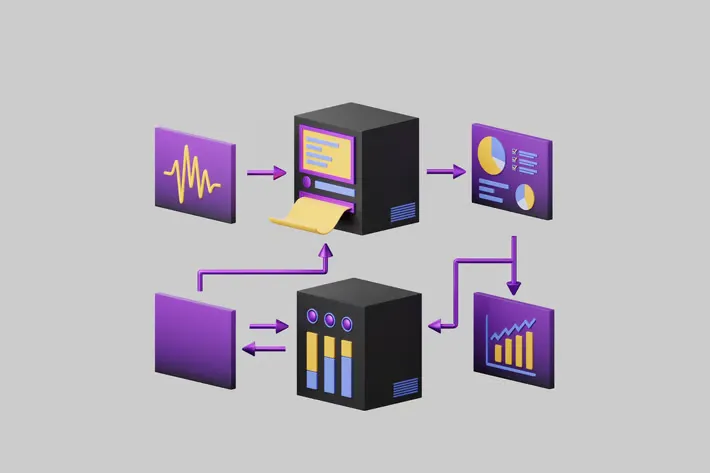

Значение парсинга данных в самом простом виде: это процесс организации необработанной неструктурированной информации (обычно спарсенного HTML) и извлечения из неё смысла путём преобразования в чистый, пригодный для запросов формат, такой как JSON или CSV. Если вы задаётесь вопросом, что означает парсинг данных на практике, представьте его как трёхуровневую операцию:

Скрейпер собирает необработанное содержимое страниц с целевых сайтов

Парсер читает эти страницы, применяет логику и выделяет именно те значения, которые вам нужны

Прокси гарантирует, что весь процесс не будет заблокирован на полпути целевым сервером.

Без понимания полного рабочего процесса парсинга данных автоматизированный сбор данных почти всегда либо даёт неполные результаты, либо блокируется антибот-защитой. Значение распарсенных данных в бизнес-контексте — это чистый структурированный вывод, который можно загрузить в таблицу, базу данных или модель ИИ. Давайте рассмотрим конкретные инструменты для этого

Что такое скрейперы данных

Скрейпер данных — это автоматизированная программа, которая перемещается по веб-страницам и загружает их необработанное содержимое, обычно в виде исходного кода HTML, JSON-ответов или API-пейлоадов. Скрейперы могут варьироваться от Python-скрипта , использующего библиотеку requests для получения статичной страницы, до headless-браузера Chromium, имитирующего движение мыши, прокрутку и отправку форм для разблокировки динамически отрисованного контента.

Подробнее о веб-скрейпинге в глоссарии CyberYozh.

Объём того, что могут собирать скрейперы, огромен:

списки товаров

вакансии

новостные заголовки

контент социальных сетей

цены на недвижимость

расписания путешествий

Всё, что публично видно в браузере, в принципе может быть собрано. Их основное ограничение в том, что они возвращают всю страницу как есть, включая весь шаблонный код, навигационные меню, рекламу и шум. Именно поэтому парсинг — это критически важный шаг, который следует далее.

Пример использования: Стартап по аналитике электронной коммерции запускает скрапер на базе Scrapy для обхода 50 магазинов конкурентов каждые 6 часов. Скрапер массово загружает полные страницы товаров, сохраняет сырой HTML локально и передаёт набор данных в конвейер парсинга. Без парсера на выходе сырой HTML коммерчески бесполезен.

Что такое парсеры данных

Парсер данных — это программа, которая берёт сырой HTML, собранный скрапером, и извлекает только релевантные точки данных, организуя их в структурированный формат:

названия товаров

цены товаров

количество отзывов

статус доступности

конкретные посты в соцсетях

Парсеры работают, применяя правила выборки: CSS-селекторы (например, div.price) или XPath-выражения, которые точно указывают, где в DOM находится значение. Конечный результат работы парсера — это то, что означают распарсенные данные в продакшене: чистый, типизированный, дедуплицированный набор данных, который можно вставить в таблицу PostgreSQL, отправить в API или использовать для обучения модели машинного обучения.

Узнайте больше о том, что такое чекеры и парсеры!

Пример использования: Агрегатор путешествий собирает сырые страницы списков отелей с 12 платформ бронирования и передаёт их парсеру, который извлекает цену заезда, рейтинг, тип номера и политику отмены. Парсер нормализует валюты и форматы дат, затем записывает результат в единую базу данных, обеспечивающую сравнение цен в реальном времени.

Сырые веб-данные сами по себе не могут быть запрошены, визуализированы или переданы в алгоритмы: им сначала требуется структура. Бизнес полагается на парсинг данных для множества применений, которые я рассмотрю немного далее. В каждом из этих случаев парсинг — это шаг, который превращает HTML-файл в инсайт.

Прокси для парсинга данных и ротация IP

Запуск скрапера без прокси — это недолговечный эксперимент. Веб-сайты отслеживают повторяющиеся запросы с одного IP-адреса и отвечают ограничениями скорости, CAPTCHA, HTTP 429 ошибками или прямыми банами.

👉 Узнайте больше о

Ротация IP — это практика распределения запросов по нескольким IP-адресам, чтобы защитные механизмы платформ видели распределённый, естественно выглядящий трафик вместо одного автоматизированного источника.

Посмотрите гайд по ротации IP от CyberYozh, который определяет четыре основные стратегии в зависимости от задачи:

Случайная ротация: IP-адрес случайным образом переключается из пула через переменный интервал (например, 5–40 минут), имитируя паттерны трафика реальных пользователей. Оптимально для парсинга средней интенсивности, где важна эмуляция естественного поведения.

Ротация на каждый запрос: Каждый HTTP-запрос использует новый IP-адрес из пула. Это основная стратегия для высокообъёмного парсинга поисковых систем, товарных каталогов и крупных баз данных, где скорость имеет первостепенное значение.

Ротация по времени (запрограммированная): IP-адрес меняется один раз за установленный период времени, независимо от количества запросов. Идеально подходит для задач мониторинга цен, которые выполняются по расписанию и требуют предсказуемого поведения с низким следом.

«Липкие» сессии: Один и тот же IP-адрес сохраняется на протяжении всей сессии, затем меняется при её завершении. Критически важно для сценариев, связанных с входом в аккаунты, поскольку смена IP в середине сессии вызывает срабатывание антифрод-систем и аннулирование сессии.

Многие конфигурации терпят неудачу из-за смешивания этих подходов — слишком быстрой ротации или использования низкокачественных IP-адресов, которые уже несут сигналы риска.

—Гайд CyberYozh по ротации IP

Выбор неправильной стратегии ротации — одна из самых распространённых причин сбоев парсинга, которые на самом деле не связаны с кодом самого парсера. Давайте рассмотрим, как применять это для конкретных реальных задач.

Стратегии парсинга данных и сценарии использования

Задача

Мониторинг цен конкурентов на товары на 20 платформах электронной коммерции в режиме реального времени в нескольких регионах.

Стратегия парсинга данных

Использовать Scrapy для высокообъёмного краулинга с этапом парсинга через BeautifulSoup для нормализации цен и валют. Применить ротацию IP на каждый запрос с резидентскими прокси CyberYozh с геотаргетингом на целевой рынок продавца. Вывод в базу данных с оповещениями об изменениях за день.

Задача

Агрегация данных о ценах на авиабилеты и отели с десятков платформ бронирования путешествий для сервиса сравнения цен.

Стратегия парсинга данных

Использовать Playwright для рендеринга страниц бронирования с большим количеством JavaScript и извлечения динамических цен. Применить ротацию по времени с резидентскими IP в целевой стране, имитируя реальные пользовательские сессии просмотра. Парсить структурированные поля цен и передавать в движок сравнения.

Задача

Создание многоязычного текстового датасета для обучения большой языковой модели из новостных статей, форумов и блогов в 30 странах.

Стратегия парсинга данных

Использовать Scrapy для краулинга с ротацией IP на каждый запрос через широкий пул резидентских IP, охватывающий целевые языки и регионы. Парсить статьи с помощью CSS-селекторов для извлечения заголовка, текста, даты и языковой метки. Хранить в структурированной базе корпуса, готовой для токенизации.

Задача

Сбор и анализ отзывов клиентов о вашем бренде и конкурентах с Amazon, Trustpilot, App Store и G2 в 15 странах.

Стратегия парсинга данных

Используйте Python Requests + BeautifulSoup для статичных страниц с отзывами; переключайтесь на Playwright для виджетов отзывов, отрисованных JavaScript. Применяйте случайную ротацию с резидентскими IP из каждой целевой страны для доступа к региональным версиям отзывов. Передавайте распарсенные данные о тональности в NLP-конвейер.

Задача

Автоматизировать генерацию лидов путём извлечения контактных данных компаний из отраслевых справочников и профессиональных сетей.

Стратегия парсинга данных

Используйте Playwright для многошаговой навигации и взаимодействия с формами. Применяйте «липкие» сессии для каждого целевого профиля, чтобы поддерживать согласованное поведение сессии. Парсите имя, должность, email и поля компании в CSV-формат, готовый для CRM.

Фреймворки для парсинга данных: Scrapy, Playwright и другие

Неправильный выбор фреймворка может стоить новым проектам по скрейпингу недель инженерного времени. Каждый крупный инструмент в 2026 году имеет свою роль в конвейере, и лучшие решения редко полагаются на один инструмент.

Как выбрать лучший фреймворк для парсинга

Ключевой вопрос: отрисовывает ли ваш целевой сайт контент с помощью JavaScript, или данные доступны в статичном HTML? Статичные сайты требуют лёгких, быстрых инструментов; динамичные SPA требуют настоящего браузерного движка. Вот обзор основных фреймворков:

Scrapy: Промышленный фреймворк для краулинга на Python со встроенными конвейерами, middleware, очередью запросов и планировщиком. Лучший выбор для масштабного краулинга статичных или полустатичных сайтов, где приоритетом является пропускная способность. Не является браузером; не выполняет JavaScript нативно.

Playwright: Современная библиотека для автоматизации браузеров от Microsoft с поддержкой Chromium, Firefox и WebKit для Python, Node.js, Java и C#. Имеет встроенное автоожидание, перехват сетевых запросов, эмуляцию устройств и управление несколькими вкладками. Лучший выбор для динамичных сайтов с интенсивным использованием JavaScript в 2026 году.

Selenium: Ветеран среди фреймворков для автоматизации браузеров с самой широкой поддержкой языков и браузеров (Java, Python, C#, Ruby и другие). Тяжелее и медленнее Playwright, но непревзойдён в устаревших окружениях и полиглотных инженерных командах с существующей инфраструктурой Selenium Grid.

Puppeteer: Разработанная Google библиотека Node.js для управления Chromium через Chrome DevTools Protocol. Отлично подходит для задач, специфичных для Chrome, анализа производительности и генерации PDF. Уступает Playwright в мультибраузерных и мультиязычных проектах.

BeautifulSoup + Requests: Самый быстрый способ прототипировать парсер для статичного HTML. Это библиотеки Python, которые просто парсят загруженный HTML. Идеальны для лёгких задач парсинга и в качестве слоя парсинга в конвейере Scrapy.

Таблица сравнения фреймворков:

Фреймворк | Ключевые особенности | Типичные сценарии использования |

Scrapy | Встроенные конвейеры, middleware, асинхронный краулинг, планирование | Высокообъёмный краулинг статичных сайтов, сбор больших наборов данных |

Selenium | Мультиязычность, Selenium Grid, широкая поддержка браузеров | Устаревшие системы, крупные команды, распределённый скрейпинг |

Playwright | Автоматическое ожидание, мультибраузерность, перехват сетевых запросов, эмуляция устройств | Оценка динамических сервисов, сайты с большим количеством JS, процессы входа в систему, бесконечная прокрутка |

Puppeteer | Chrome DevTools Protocol, детальное управление Chrome | Скрейпинг специфичный для Chrome, рендеринг PDF, мониторинг производительности |

BeautifulSoup | Простой парсинг HTML/XML, CSS-селекторы, XPath | Парсинг статических страниц, лёгкие проекты, быстрое прототипирование |

Эти фреймворки не являются взаимоисключающими и часто комбинируются. Распространённая высокопроизводительная конфигурация объединяет Scrapy в качестве оркестратора краулинга с Playwright для обработки запросов с большим количеством JavaScript через промежуточное ПО scrapy-playwright.

Лучшие практики парсинга данных

Разделяйте логику скрейпинга и парсинга. Сохраняйте исходный HTML перед его парсингом. Это позволит вам перезапустить парсер с обновлёнными селекторами без повторного краулинга всего сайта — огромная экономия времени, когда структура целевого сайта неожиданно меняется.

Подбирайте стратегию ротации под задачу. Используйте ротацию на каждый запрос для массового скрейпинга, «липкие» сессии для работы с аккаунтами и временную ротацию для запланированных задач мониторинга. Слишком агрессивная ротация нарушает сессии; слишком медленная — помечает IP.

Всегда проверяйте репутацию IP перед развёртыванием. Низкокачественные или ранее скомпрометированные IP гарантируют плохие результаты независимо от вашей логики ротации. Используйте IP Checker от CyberYozh для оценки ваших IP перед добавлением их в любой активный рабочий процесс.

Рандомизируйте паттерны запросов. Используйте переменные задержки, рандомизированные user-agent'ыи реалистичные заголовки браузера, чтобы избежать срабатывания систем поведенческого обнаружения. Единообразная задержка в 1 секунду между каждым запросом так же подозрительна, как и полное отсутствие задержки.

Используйте headless-браузер только при необходимости. Playwright и Selenium требуют значительных ресурсов. Используйте BeautifulSoup + Requests для статических страниц и оставьте автоматизацию браузера для страниц, которые действительно требуют рендеринга JavaScript.

Open Scraper от CyberYozh: бесплатный инструмент для скрейпинга данных для всех

CyberYozh поддерживает Open Scraper — бесплатный инструментарий для скрейпинга с открытым исходным кодом, построенный на Playwright и предназначенный для снижения порога входа для разработчиков, которые хотят извлекать данные профессионального уровня без создания инфраструктуры с нуля. Он решает наиболее сложные части рабочего процесса скрейпинга из коробки:

Простая установка: Установите Open Scraper с помощью Docker за 15-20 минут и используйте его с минимальными знаниями программирования

Асинхронная очередь задач: Запускайте несколько задач скрейпинга параллельно из вашего локального приложения Open Scraper

Пакетный скрейпинг: обрабатывайте большие списки URL в структурированных пакетах

Встроенная интеграция прокси: Подключается напрямую к прокси-сетям CyberYozh для бесшовной ротации

Как платформа, CyberYozh расширяет возможности Open Scraper своей полноценной прокси-инфраструктурой. Пользователи получают доступ к пулу из более чем 50 миллионов резидентских IP-адресов, охватывающему свыше 100 стран, с неизменно низкой глобальной задержкой, подходящей для критичных по времени задач парсинга и мониторинга. Встроенный IP Checker позволяет проверить показатели доверия IP и сигналы мошеннического риска перед тем, как использовать их в любом производственном процессе, а CyberYozh API упрощает автоматизацию как планирования ротации IP, так и программных проверок репутации, легко интегрируясь со Scrapy, Playwright, Selenium, Puppeteer и Postman.

Настройте свою прокси-инфраструктуру. Зарегистрируйтесь в CyberYozh и начните прямо сейчас!

Заключительные напоминания о парсинге данных

Парсинг данных — это мост между необработанным веб-контентом и практически применимой информацией. Рабочий процесс всегда одинаков: парсите с помощью подходящего фреймворка, извлекайте нужные данные и защищайте конвейер качественными прокси и грамотной стратегией ротации. Освойте эти три уровня, и вы сможете извлекать структурированные данные практически из любого публичного источника.

Ознакомьтесь с каталогом прокси CyberYozh и выберите наиболее подходящий вариант.