Tự động hóa Web Scraping: Cách chạy scrapers theo lịch trình

Ở đây, chúng ta sẽ tổng quan về các đặc điểm kỹ thuật của tự động hóa thu thập dữ liệu web, một quy trình mà nhiều doanh nghiệp dựa vào để có được dữ liệu chất lượng cao, cho dù đó là nghiên cứu thị trường, thông tin SEO/SERP, hay cảm nhận của khách hàng. Một phần quan trọng của quy trình này là hầu hết các dịch vụ nhanh chóng gắn cờ và giới hạn nhiều yêu cầu trong khoảng thời gian ngắn, điều không thể tránh khỏi trong quá trình thu thập dữ liệu tự động, vì vậy điều cần thiết là phải phân phối tải yêu cầu giữa nhiều IP bằng cách sử dụng proxy luân phiên.

Tự động hóa thu thập dữ liệu web là gì

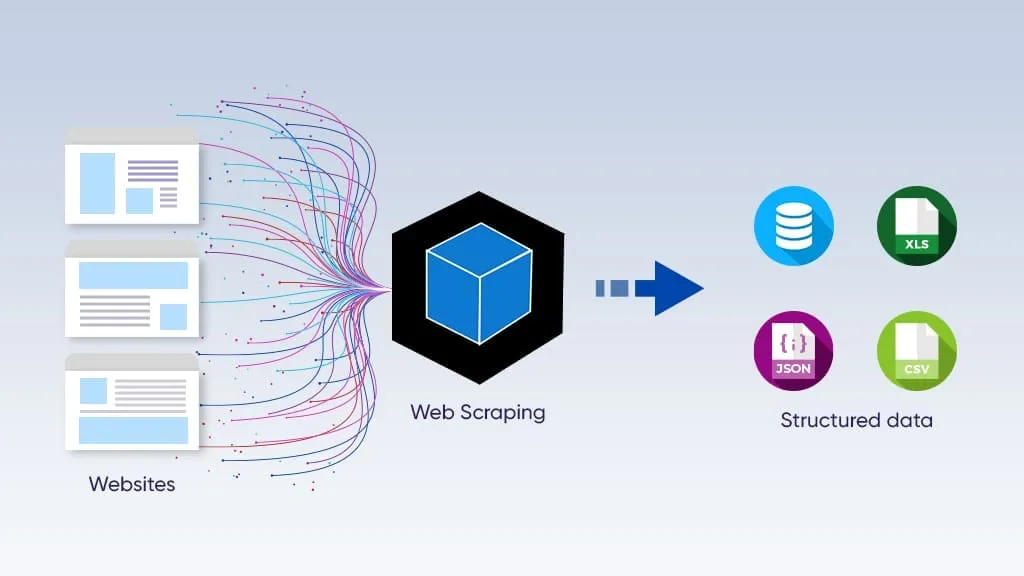

Tự động hóa thu thập dữ liệu web là một quy trình có thể lập trình để kết nối với các máy chủ web và trích xuất dữ liệu từ chúng mà không cần làm việc thủ công. Tất cả những gì cần thiết là thiết lập một công cụ thu thập dữ liệu web và tạo hướng dẫn cho nó. Sau đó, nó hoàn thành tất cả công việc một cách tự động. Thông thường, các tệp kết quả là các bảng ở định dạng .csv hoặc .json, hoặc các tệp cơ sở dữ liệu có thể được xử lý bằng các truy vấn SQL.

Điều quan trọng cần nhớ là nền tảng giới hạn các luồng yêu cầu hàng loạt, tự động, điển hình cho việc thu thập dữ liệu web. Đó là lý do tại sao proxy rất cần thiết cho nó. Đọc thêm về dịch vụ luân phiên IP và cách sử dụng chúng để tránh bị cấm và hạn chế

Các phương pháp tự động hóa thu thập dữ liệu web

Có hai phương pháp chính để tự động hóa thu thập dữ liệu web: sử dụng các nền tảng low-code để thiết lập, hoặc viết các script Python với các thư viện và framework chuyên dụng.

Công cụ no-code/low-code

Các công cụ này cung cấp giao diện trỏ và nhấp, thường là trực quan, có thể được sử dụng mà không cần kiến thức lập trình. Nó có thể hữu ích, vì một số nền tảng này cho phép tùy chỉnh thông qua lập trình, nhưng không bắt buộc. Người dùng xác định các quy tắc thu thập dữ liệu bằng cách nhấp vào các phần tử trang, thiết lập logic phân trang và cấu hình các định dạng đầu ra như CSV hoặc JSON, tất cả thông qua GUI.

Chúng dễ thiết lập, nhưng cũng có nhiều hạn chế:

Các công cụ thu thập dữ liệu no-code dễ bị lỗi khi trang web mục tiêu thay đổi bố cục.

Chúng gặp khó khăn với các trang động, nhiều JavaScript hoặc logic kinh doanh tùy chỉnh.

Chúng trở nên đắt đỏ ở quy mô lớn và khó tùy chỉnh.

Các công cụ này chủ yếu được sử dụng bởi các nhà tiếp thị, nhà phân tích kinh doanh, quản lý thương mại điện tử và doanh nhân. Tuy nhiên, các giải pháp dựa trên lập trình tốt hơn cho việc thu thập dữ liệu quy mô lớn.

Giải pháp dựa trên lập trình

Các công cụ này là các thư viện và framework, chủ yếu cho Python, ngôn ngữ lập trình được sử dụng rộng rãi nhất. Thu thập dữ liệu dựa trên lập trình cung cấp cho các nhà phát triển quyền kiểm soát đầy đủ, chi tiết đối với mọi khía cạnh của quy trình trích xuất, từ cách gửi yêu cầu HTTP đến cách phân tích, lưu trữ và lên lịch dữ liệu.

Hạn chế chính là rào cản kỹ thuật: xây dựng, bảo trì và lên lịch các công cụ thu thập dữ liệu cấp độ sản xuất đòi hỏi kỹ năng lập trình, thời gian gỡ lỗi và các quyết định về cơ sở hạ tầng. Phương pháp này được sử dụng bởi các kỹ sư dữ liệu, nhà phát triển backend, nhà khoa học dữ liệu và growth hacker cần độ tin cậy, tùy chỉnh và khả năng lập trình.

Proxy tự động hóa web và tại sao chúng cần thiết

Hầu hết các trang web, ngoại trừ các cơ sở dữ liệu mở lớn (thường được thiết kế để thu thập dữ liệu), giới hạn số lượng yêu cầu được phép từ một IP duy nhất. Khi người dùng vượt quá giới hạn này, nền tảng sẽ giới hạn yêu cầu, thách thức người dùng bằng CAPTCHA hoặc chặn họ. Ngoài ra, các nền tảng giám sát tất cả các yêu cầu, IP của chúng và các dấu vết khác (như dữ liệu trình duyệt) để tìm sự không nhất quán và hành vi giống bot, và gắn cờ các địa chỉ đáng ngờ ngay cả khi chúng không vượt quá giới hạn. Đó là lý do tại sao nhóm IP proxy và duyệt web chống phát hiện là cần thiết ở đây: chúng giảm thiểu các vấn đề này.

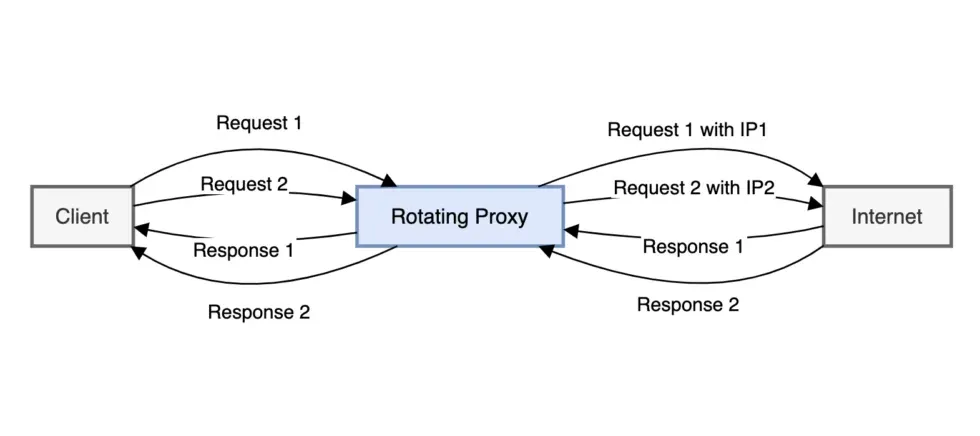

Luân phiên proxy có nghĩa là mỗi yêu cầu (hoặc nhóm yêu cầu) được gửi từ các địa chỉ IP khác nhau. Chủ yếu, có hai loại:

Proxy di động sử dụng các địa chỉ IP từ các nhà cung cấp Internet di động (LTE/5G) và có mức độ tin cậy cao nhất, vì các nền tảng không phân biệt chúng với người dùng Internet di động. Chúng phù hợp nhất cho việc thu thập dữ liệu xã hội.

Proxy luân phiên dân cư sử dụng một nhóm các địa chỉ IP dân cư và luân phiên giữa chúng theo một thuật toán được thiết lập trước. Mức độ tin cậy của chúng thấp hơn nhưng vẫn tốt cho hầu hết các nền tảng, và chúng là một lựa chọn tốt cho hầu hết các tác vụ thu thập dữ liệu web.

Trước khi sử dụng bất kỳ địa chỉ IP nào, chất lượng của nó nên được đánh giá bằng cách sử dụng IP Checkercủa CyberYozh, công cụ hiển thị Điểm Gian lận của nó.

Trình duyệt chống phát hiện còn tăng cường an toàn hơn nữa bằng cách cung cấp một bộ dấu vân tay kỹ thuật số riêng biệt cho mỗi phiên. Kết hợp với một IP sạch, mỗi phiên bây giờ xuất hiện như một danh tính kỹ thuật số xác thực, và khả năng bị cấm và thách thức CAPTCHA giảm đáng kể.

Đọc thêm về chống phát hiện và cách nó hoạt động.

Các dịch vụ thu thập dữ liệu và tự động hóa web đáng tin cậy nhất là gì

Tự động hóa thu thập dữ liệu web bao gồm việc sử dụng các công cụ và kỹ thuật khác nhau để lên lịch và chạy các tác vụ trích xuất mà không cần can thiệp thủ công. Phương pháp tốt nhất phụ thuộc vào kiến thức lập trình của bạn, độ phức tạp của trang web mục tiêu và quy mô mong muốn của hoạt động. Bất kể phương pháp nào, điều cần thiết là kết hợp công cụ thu thập dữ liệu của bạn với proxy luân phiên để đảm bảo các phiên của bạn sẽ không bị cấm.

Nền tảng no-code chuyên dụng

Các nền tảng thu thập dữ liệu được xây dựng chuyên biệt kết hợp các công cụ xây dựng thu thập dữ liệu trực quan với cơ sở hạ tầng đám mây, lên lịch tích hợp, luân phiên proxy và xử lý CAPTCHA mà không cần lập trình.

Scrapeless cung cấp các actor scraping chuyên biệt cho các nền tảng thương mại điện tử (Amazon, Shopee), giám sát cạnh tranh, theo dõi khả năng hiển thị AI (ChatGPT, Gemini, v.v.), với Scraping Browser đám mây, Universal Scraping API và AI-native Agent Browser tích hợp MCP/CLI — người dùng mới nhận $10 tín dụng dùng thử miễn phí. Phù hợp nhất cho các nhóm kỹ thuật và nhà phát triển AI xây dựng các pipeline dữ liệu có khả năng mở rộng với tích hợp quy trình làm việc của agent liền mạch.

Octoparse là công cụ xây dựng scraper kiểu point-and-click với thực thi đám mây, tự động phát hiện template và lịch chạy định kỳ cho dữ liệu thương mại điện tử và khách hàng tiềm năng.

Apify cung cấp marketplace với hơn 1.500 scraping ‹Actors› sẵn có cho các trang web phổ biến, kèm cloud hosting và API output.

Browse.ai chuyên về giám sát website; phát hiện thay đổi và kích hoạt cảnh báo mà không cần cấu hình lại thủ công.

Web Scraper extension là scraper dựa trên trình duyệt, thân thiện với người mới bắt đầu, có lịch trình đám mây cho việc trích xuất dữ liệu có cấu trúc đơn giản.

Phù hợp nhất cho các nhóm marketing, phân tích và kinh doanh cần thu thập dữ liệu định kỳ mà không cần nguồn lực phát triển.

Nền tảng tự động hóa

Các công cụ tự động hóa đa năng kết nối các bước web scraping với quy trình làm việc kinh doanh rộng hơn, chuyển dữ liệu đã trích xuất vào CRM, bảng tính hoặc công cụ nhắn tin.

Zapier kết nối các trigger scraping với hơn 6.000 ứng dụng; lý tưởng cho việc chuyển giao dữ liệu nhẹ như danh sách mới → Slack hoặc Google Sheets.

n8n là công cụ xây dựng workflow mã nguồn mở, tự lưu trữ với các HTTP request node, cung cấp nhiều quyền kiểm soát và logic tùy chỉnh hơn Zapier.

Các nền tảng này phù hợp với các nhóm vận hành và phát triển muốn hành động ngay lập tức với dữ liệu đã scrape: tự động hóa thông báo, định tuyến khách hàng tiềm năng hoặc pipeline báo cáo, thay vì chỉ lưu trữ.

Thư viện Python

Các thư viện Python cung cấp cho nhà phát triển quyền kiểm soát lập trình đầy đủ đối với logic scraping, lịch trình và xử lý dữ liệu, từ phân tích HTML đơn giản đến tự động hóa trình duyệt đầy đủ.

Scrapy là framework crawling cấp production với pipeline, middleware và lịch trình tích hợp sẵn cho việc trích xuất dữ liệu khối lượng lớn. Cài đặt bằng pip với lệnh pip install scrapy

BeautifulSoup + Requests là combo nhẹ để phân tích các trang HTML tĩnh; nhanh để tạo prototype nhưng hạn chế cho các trang động.

Playwright/Puppeteer/Selenium đều là công cụ tự động hóa trình duyệt headless xử lý việc render JavaScript, tương tác người dùng và luồng đăng nhập phức tạp.

Lựa chọn hàng đầu cho các nhà phát triển và kỹ sư dữ liệu xây dựng pipeline tùy chỉnh, có khả năng mở rộng, yêu cầu kiểm soát chính xác đối với proxy, xử lý lỗi và xử lý dữ liệu downstream.

Chạy scheduler để quản lý scraper tự động

Sau khi công cụ scraping được thiết lập, hoạt động của nó cũng nên được tự động hóa. Scraper tự động hóa việc trích xuất dữ liệu web, nhưng một công cụ khác gọi là scheduler sẽ tự động hóa thời điểm scraper nên chạy và khi nào nên nghỉ. Cũng có thể bật tắt thủ công, nhưng scheduler cho phép kiểm soát và độ chính xác cao hơn, điều mà như chúng ta đã thấy, rất quan trọng. Thông thường, hai loại scheduler được sử dụng: cấp hệ thống và dựa trên đám mây.

Đọc thêm về chiến lược luân chuyển IP để chọn loại bạn cần.

Scheduler cấp hệ thống

Hãy bắt đầu với loại đầu tiên. Ví dụ điển hình là các chương trình lập lịch chuẩn cho hệ điều hành Unix (bao gồm macOS) và Windows.

Cron Jobs: Trình lập lịch công việc dựa trên thời gian chuẩn cho các hệ điều hành giống Unix, lý tưởng để chạy các script Python theo lịch trình.

Windows Task Scheduler: Công cụ tương đương tích hợp sẵn của Windows để lập lịch chạy các chương trình hoặc script vào thời điểm cụ thể.

Cả hai chương trình đều có giao diện rất đơn giản cho phép người dùng khởi chạy và dừng các chương trình khác trong khoảng thời gian cụ thể.

Các giải pháp dựa trên đám mây

Các nền tảng lập lịch dựa trên đám mây triển khai và chạy các script scraping trong môi trường kỹ thuật số của họ. Các ví dụ điển hình là GitHub Actions, AWS Lambda và Apache Airflow.

GitHub Actions là một nền tảng CI/CD miễn phí có thể chạy các script scraping của bạn trên máy chủ GitHub, đảm bảo chúng thực thi ngay cả khi máy cục bộ của bạn đang tắt.

AWS Lambda là một lựa chọn có khả năng mở rộng cao và tiết kiệm chi phí để chạy các scraper trên đám mây, chỉ bằng cách đăng code lên môi trường runtime của nó và khởi chạy.

Apache Airflow là một nền tảng mã nguồn mở để tạo, lập lịch và giám sát các quy trình làm việc theo cách lập trình, phù hợp cho các pipeline dữ liệu phức tạp.

Các nền tảng này đặc biệt phù hợp cho truy cập chia sẻ và làm việc nhóm, khi nhiều nhà phát triển làm việc trên một dự án duy nhất sử dụng bất kỳ công cụ nào trong số này.

Bảng tóm tắt các nền tảng web scraping và lập lịch

Hãy tóm tắt các nền tảng scraping và lập lịch này dựa trên nguyên tắc sử dụng, ví dụ và những gì chúng phù hợp nhất.

Loại nền tảng | Ví dụ | Phù hợp nhất cho | Lập trình |

Công cụ phân tích không cần code | Octoparse, Browse AI, Apify | Người không phải lập trình viên, giám sát | Không |

Thư viện Python | Scrapy, Playwright, BS4 | Kiểm soát hoàn toàn, logic tùy chỉnh | Có |

Nền tảng tự động hóa | n8n, Zapier, Airflow | Tích hợp quy trình làm việc | Thấp/tùy chọn |

Bộ lập lịch đám mây | GitHub Actions, AWS Lambda | Serverless, chạy luôn bật | Trung bình |

Bộ lập lịch hệ điều hành | Cron (Unix), Task Scheduler (Windows) | Lập lịch script cục bộ | Tối thiểu |

Thiết lập một web scraper tự động: Các phương pháp hay nhất

Bây giờ, hãy khám phá các phương pháp hay nhất để chạy một công cụ web scraping.

Kiểm tra robots.txt

Các trang web thường có một tệp chuyên biệt gọi là robots.txt chỉ định nội dung nào có thể và không thể được thu thập. Thông thường, các trang web bảo vệ trang đăng nhập, bảng điều khiển người dùng và các trang khác có thông tin nhạy cảm. Để truy cập nó, chỉ cần thêm tên của nó vào thư mục gốc của trang web (ví dụ: app.cyberyozh.com/robots.txt), và ở đây bạn sẽ thấy các quy tắc thu thập dữ liệu của trang web. Đừng thu thập dữ liệu bị cấm từ đó.

Xoay vòng IP của bạn bằng proxy

Xoay vòng địa chỉ IP bằng các dịch vụ proxy để tránh giới hạn tốc độ và bị cấm IP khi thu thập dữ liệu quy mô lớn. Đảm bảo kiểm tra chất lượng IP trước khi xoay vòng. Với trình kiểm tra CyberYozh, điều này có thể được tự động hóa bằng cách sử dụng CyberYozh API, do đó việc xoay vòng sẽ chỉ xảy ra nếu IP đích có Điểm gian lận thấp.

Triển khai độ trễ ngẫu nhiên

Thêm độ trễ ngẫu nhiên giữa các yêu cầu để tránh làm quá tải máy chủ đích hoặc bị chặn địa chỉ IP của bạn. Đảm bảo bạn không vi phạm Điều khoản dịch vụ của trang web bằng cách thực hiện quá nhiều yêu cầu, vì điều này có thể làm gián đoạn hoạt động của trang web và dẫn đến xung đột với nền tảng.

Đọc thêm về tình trạng địa chỉ IP trong bài viết chu trình quản lý proxy từ CyberYozh.

Xử lý lỗi tự động

Triển khai các khối try-catch hoặc các cơ chế xử lý lỗi tương tự để xử lý các vấn đề tiềm ẩn như lỗi mạng hoặc thay đổi cấu trúc trang web. Điều này sẽ đảm bảo rằng các lỗi tiềm ẩn được đếm và báo cáo trước khi bắt đầu thu thập dữ liệu, để bạn có thể phản ứng phù hợp, tiết kiệm lưu lượng truy cập và ngăn ngừa sự cố.

Sử dụng duyệt web không giao diện

Để tiết kiệm lưu lượng truy cập, điều quan trọng trong thu thập dữ liệu web, bạn có thể sử dụng phương pháp duyệt web không giao diện, khi trình thu thập của bạn chỉ truy cập dữ liệu bạn cần (giá cả, chi phí, kết quả tìm kiếm, danh sách, bình luận người dùng, v.v.) mà không có giao diện người dùng. Vì các proxy xoay vòng thường tính phí theo lượng lưu lượng, nó cũng sẽ tiết kiệm chi phí.

Tóm tắt các phương pháp thu thập dữ liệu web tốt nhất

Tự động hóa thu thập dữ liệu web kết hợp công cụ thu thập phù hợp, bộ lập lịch đáng tin cậy và proxy xoay vòng thành một quy trình dữ liệu tự động hoàn toàn. Cho dù bạn là nhà tiếp thị sử dụng Octoparse hay nhà phát triển xây dựng quy trình Scrapy, các nguyên tắc cơ bản vẫn giống nhau: phân phối yêu cầu của bạn qua các IP sạch, tôn trọng quy tắc nền tảng và xử lý lỗi chủ động. Các proxy dân cư và di động của CyberYozh, kết hợp với API kiểm tra IP, cung cấp cho bạn cơ sở hạ tầng để chạy trình thu thập dữ liệu quy mô lớn mà không bị cấm hoặc gián đoạn.

Câu hỏi thường gặp về tự động hóa thu thập dữ liệu web

Tự động hóa thu thập dữ liệu web là gì?

Một quy trình có thể lập trình tự động trích xuất dữ liệu web theo lịch trình, không cần thao tác thủ công, xuất kết quả ra CSV, JSON hoặc cơ sở dữ liệu.

Tôi có cần kỹ năng lập trình để tự động hóa thu thập dữ liệu web không?

Các nền tảng không cần mã như Octoparse và Browse.ai xử lý mọi thứ một cách trực quan. Lập trình mở khóa nhiều sức mạnh và tính linh hoạt hơn ở quy mô lớn.

Tại sao trình thu thập dữ liệu bị chặn?

Các trang web phát hiện các yêu cầu lặp lại từ một IP duy nhất và gắn cờ hành vi giống bot. Giới hạn tốc độ, CAPTCHA và cấm IP theo sau.

Xoay vòng IP là gì và tại sao nó quan trọng?

Xoay vòng IP gửi mỗi yêu cầu từ một địa chỉ IP khác nhau, ngăn chặn giới hạn tốc độ và làm cho các phiên thu thập dữ liệu trông giống như người dùng thực.

Sự khác biệt giữa proxy dân cư và proxy di động để thu thập dữ liệu là gì?

Proxy di động có mức độ tin cậy cao nhất và hiếm khi bị chặn; proxy dân cư cung cấp nhóm lớn hơn và phù hợp với hầu hết các tác vụ thu thập dữ liệu chung.

Cron job trong thu thập dữ liệu web là gì?

Một bộ lập lịch hệ thống dựa trên Unix tự động kích hoạt script thu thập dữ liệu theo khoảng thời gian xác định, như hàng ngày hoặc hàng giờ.

Tôi có thể chạy trình thu thập dữ liệu trên đám mây miễn phí không?

Có. GitHub Actions cung cấp thực thi đám mây miễn phí các script thu thập dữ liệu theo lịch trình, ngay cả khi máy cục bộ của bạn đang tắt.

robots.txt là gì và tôi có nên tuân theo nó không?

Một tệp khai báo những trang nào một trang web cho phép được thu thập. Tôn trọng nó giữ cho trình thu thập dữ liệu của bạn có đạo đức và giảm rủi ro pháp lý.

Trình duyệt không giao diện là gì và khi nào tôi nên sử dụng nó?

Một trình duyệt chạy không có giao diện người dùng, được sử dụng để thu thập dữ liệu từ các trang web được render bằng JavaScript một cách hiệu quả trong khi tiêu thụ ít băng thông và lưu lượng proxy hơn.

Làm thế nào để kiểm tra xem IP proxy của tôi có sạch trước khi sử dụng không?

Sử dụng IP Checker của CyberYozh để lấy Điểm Gian lận cho bất kỳ IP nào; điều này có thể được tự động hóa thông qua CyberYozh API.