Error HTTP 499: Qué es, por qué Nginx lo registra y cómo solucionarlo (2026)

Revisaste tus registros de Nginx y viste una avalancha de errores 499. Buenas noticias: en la mayoría de los casos, esto no significa que tu servidor esté fallando. Es tu servidor registrando el hecho de que alguien más se rindió. Aquí te explicamos qué significa, por qué sucede y cómo solucionarlo, ya seas desarrollador o simplemente alguien tratando de mantener un sitio web saludable.

Respuesta rápida: Un error 499 significa que el cliente, un navegador, aplicación móvil o API, cerró la conexión antes de que Nginx terminara de responder. Nginx inventó este código para distinguir entre «fallé» (5xx) y «el cliente se fue antes de que pudiera responder» (499). No existe en el estándar HTTP oficial (RFC 9110). No es un subtipo de 502. La causa casi siempre es un backend lento o un desajuste de tiempo de espera, no un servidor roto.

TLDR

499 = el cliente cerró la conexión antes de que Nginx respondiera, específico de Nginx, no está en el estándar HTTP

Causa más común: el servidor upstream (base de datos, API, aplicación) tarda demasiado

La solución depende de la causa: optimizar el backend, ajustar proxy_read_timeout o corregir la alineación de tiempos de espera del CDN/proxy

499 ≠ 504. En un 504, el proxy se rindió; en un 499, el cliente se rindió primero

Unos pocos 499 al día es normal; un pico sostenido en un endpoint es una señal real

Los proxies añaden saltos de latencia; un proxy lento o con IP marcada empuja solicitudes límite al territorio 499

Qué es el error 499: Explicación simple + definición técnica

La analogía de la espera telefónica es la forma más clara de entender esto. Llamas a servicio al cliente. Estás en espera. Después de dos minutos, cuelgas. Desde el sistema de la empresa, la llamada se conectó y un agente estaba trabajando en tu caso, pero te desconectaste antes de que pudieran responder. Eso es un 499.

Nginx registra esto porque necesita una forma de decir «estaba trabajando en esto y el cliente se fue», lo cual es diferente de «fallé al procesar la solicitud». El servidor estaba bien. El cliente dejó de esperar.

Tres cosas que hacen único al 499:

Es exclusivo de Nginx:

Apache, IIS y otros servidores no usan este código.

Si alguien te dice que busques errores 499 en un servidor Apache, está equivocado.

La lista oficial de códigos de estado HTTP de MDN no incluye el 499 porque nunca fue estandarizado; Nginx lo creó internamente con fines de registro.

No es un 502:

Otras guías llaman al 499 «un caso especial de 502 Bad Gateway».

Esto es factualmente incorrecto.

Un 502 significa que Nginx obtuvo una respuesta inválida del upstream.

Un 499 significa que el cliente se desconectó antes de que se enviara cualquier respuesta.

Tratarlos igual te lleva a la solución incorrecta.

Generalmente es un síntoma, no la causa:

El 499 en tu registro es el evento.

La causa es lo que hizo que la respuesta fuera demasiado lenta: una consulta a la base de datos, una llamada a una API externa o un proxy con demasiada latencia.

499 vs 504 vs 408: De un vistazo

Código | Quién se rindió | Significado | ¿En el estándar HTTP? |

499 | El cliente | El cliente cerró la conexión antes de que el servidor respondiera | No, solo Nginx |

504 | El proxy/gateway | El proxy agotó el tiempo de espera esperando al upstream | Sí |

408 | El servidor | El cliente fue demasiado lento al enviar la solicitud | Sí |

Si ves un 504 en el navegador, tu upstream es demasiado lento y tu proxy se rindió. Si ves 499 en los registros del servidor, el cliente se rindió antes que tu proxy. Mismo upstream lento, diferencia en quién se desconectó primero. [Lee sobre el error 520 aquí.]

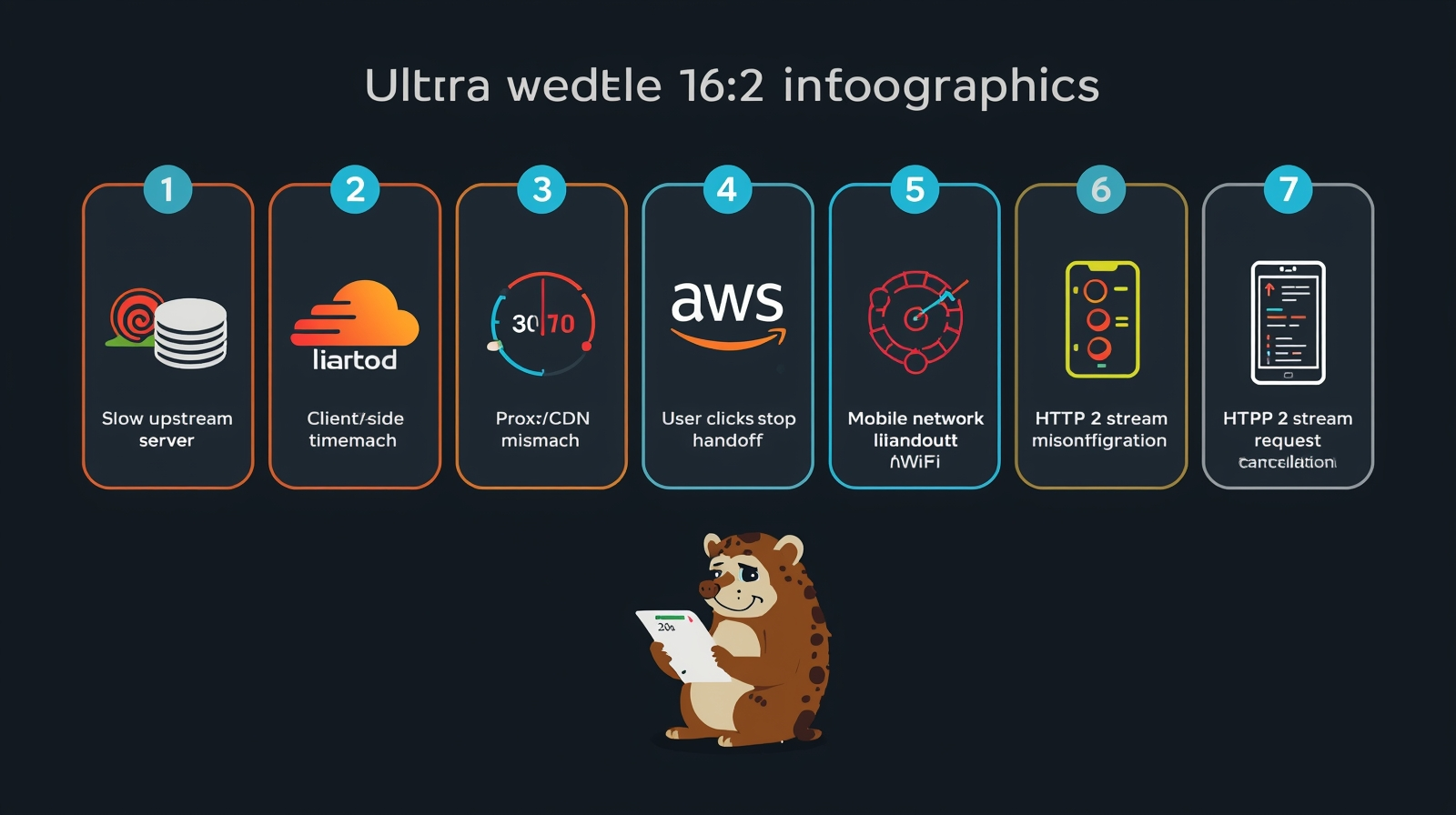

7 razones reales por las que ves errores 499

Aquí hay un resumen de las razones más comunes por las que puede aparecer el error 499:

1. Servidor upstream lento

Nginx redirige la solicitud a tu aplicación backend, base de datos o API. El backend es lento.

El cliente alcanza su propio tiempo de espera y cierra la conexión. Nginx registra 499.

El backend puede seguir ejecutando la consulta; simplemente no tiene a nadie a quien enviarle el resultado.

Esto está detrás de la mayoría de los picos de 499 en producción.

2. Configuración de tiempo de espera del lado del cliente

Cada cliente HTTP tiene su propio reloj de tiempo de espera. [Lee sobre HTTP vs. SOCKS]

Los valores predeterminados del navegador son generosos (Chrome permite varios minutos para la carga de páginas). Pero los clientes API, Axios, Fetch, Python Requests y Curl a menudo tienen valores predeterminados de 30 segundos o menos.

Una solicitud que tarda 35 segundos fallará de manera confiable debido a un tiempo de espera del lado del cliente.

Las aplicaciones móviles son particularmente agresivas. Muchas implementan tiempos de espera de 10–15 segundos para ahorrar batería.

Esto genera errores 499 en los registros de la API que parecen ser problemas del servidor pero en realidad son problemas de configuración del cliente.

3. Desajuste de tiempo de espera del proxy o CDN

Cada capa en tu cadena de solicitudes tiene su propia ventana de tiempo de espera.

La documentación de Cloudflare señala específicamente que si el tiempo de espera de un cliente es menor a 38 segundos, Cloudflare registra un código de estado 499, incluso si el servidor upstream está perfectamente saludable.

Los ALB de AWS tienen sus propios valores predeterminados de tiempo de espera inactivo (60 segundos por defecto) que pueden causar el mismo falso positivo.

Estos son 499 falsos; el error aparece en tus registros, el servidor está bien, pero una capa de proxy registró la impaciencia del cliente.

4. El usuario hace clic en detener o actualiza

Alguien accede a una página lenta, hace clic en detener o presiona F5.

Nginx registra un 499. De forma aislada, esto no tiene sentido.

Docenas por hora en un solo endpoint significa que los usuarios están abandonando repetidamente esa página, lo cual vale la pena corregir, pero por razones de UX, no por razones de error del servidor.

5. Cambio de red móvil

Un usuario cambia de LTE a WiFi a mitad de la solicitud.

La conexión TCP se cae. Nginx registra un 499.

A medida que aumenta la adopción de HTTP/3 (QUIC), esto se está volviendo menos común. Las conexiones QUIC sobreviven mejor a los cambios de red que TCP porque su estado de conexión está vinculado a un ID de conexión en lugar de una dirección IP.

Pero si estás viendo 499 inexplicables de usuarios móviles en endpoints HTTP/1.1 o HTTP/2, esta es una causa real.

6. Configuración incorrecta de directivas de tiempo de espera de Nginx

Las cuatro directivas de tiempo de espera más relevantes para los 499:

nginx

client_header_timeout 60s; # Wait for client to send request headers

client_body_timeout 60s; # Wait for client to send request body

proxy_read_timeout 60s; # Wait for upstream server response

fastcgi_read_timeout 60s; # Wait for PHP-FPM to respondEl valor predeterminado de proxy_read_timeout es 60 segundos según la documentación del módulo proxy de Nginx.

Si tu backend tarda regularmente 90 segundos para operaciones específicas, exportaciones grandes, informes complejos, trabajos por lotes, verás 499 sistemáticos en esos endpoints hasta que ajustes el tiempo de espera para esa ubicación específica.

7. Cancelación de flujo HTTP/2

HTTP/2 multiplexa múltiples solicitudes sobre una sola conexión TCP usando flujos.

Si un cliente restablece un flujo específico, respuesta lenta o navegación del usuario, Nginx registra un 499 para ese flujo mientras otras solicitudes concurrentes en la misma conexión tienen éxito.

Esto crea patrones de 499 inconsistentes que parecen aleatorios pero en realidad son cancelaciones a nivel de flujo.

Un pico repentino después de habilitar HTTP/2 no es una coincidencia.

Cómo corregir el error 499: Desde soluciones rápidas hasta avanzadas

Para no desarrolladores:

Si eres propietario de un sitio y ves errores 499, el primer paso más práctico es identificar si están concentrados en una página o distribuidos en todo el sitio.

Si es un sitio de una sola página, esa página tiene un problema de rendimiento. Si es en todo el sitio, tu entorno de alojamiento puede tener recursos insuficientes para tu carga de tráfico.

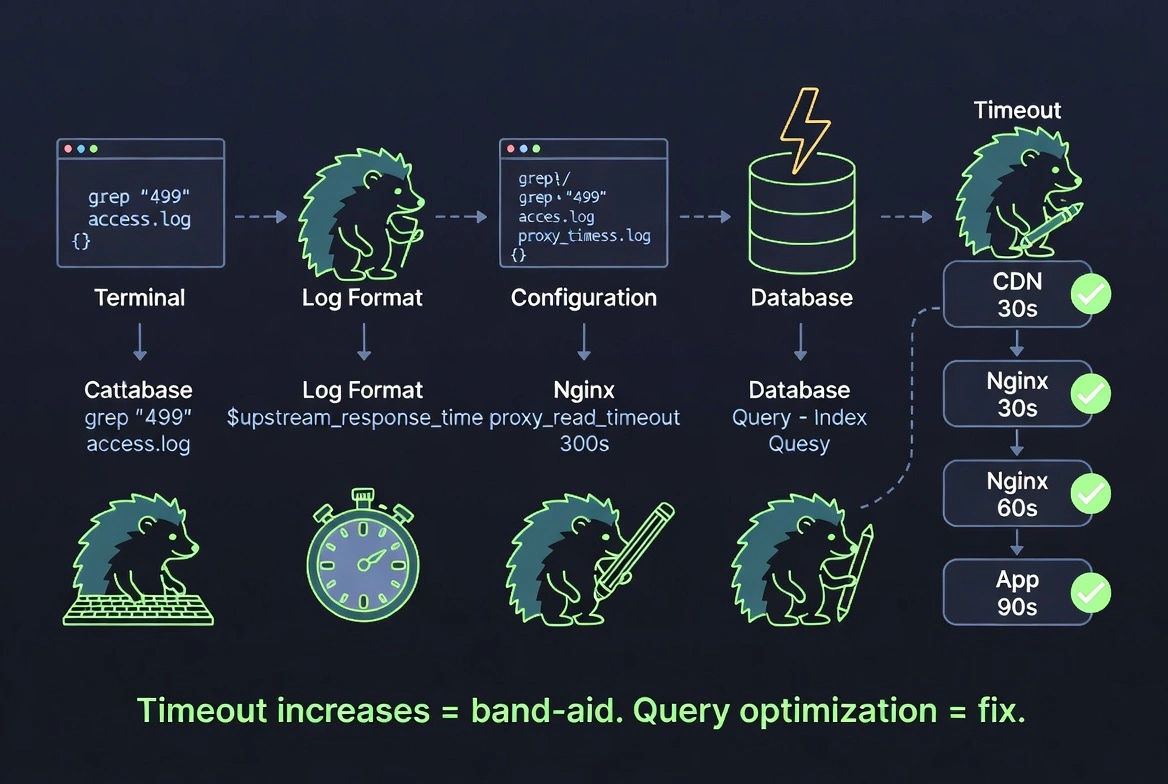

Para desarrolladores:

Paso 1: Identifica qué URLs están generando errores 499:

bash

grep ' 499 ' /var/log/nginx/access.log | awk '{print $7}' | sort | uniq -c | sort -rn | head -20Paso 2: Mide el tiempo de respuesta del upstream.

Añade $upstream_response_time a tu formato de log de Nginx.

Si las respuestas cercanas a tu valor de proxy_read_timeout están generando errores 499, tu upstream necesita optimización, no solo un aumento del timeout.

Paso 3: Aumenta el timeout solo para endpoints lentos específicos:

nginx

location /api/export {

proxy_read_timeout 300s;

proxy_pass http://backend;

}No aumentes globalmente, eso enmascara el problema real.

Paso 4: Corrige el upstream.

Consultas lentas a la base de datos, búsquedas sin índices y llamadas síncronas a API externas son las causas reales.

Los aumentos de timeout son parches temporales.

La optimización de consultas, el almacenamiento en caché y el procesamiento asíncrono son las soluciones.

Paso 5: Alinea los timeouts de la cadena de proxies.

Tu cadena de timeouts debe ser incremental: aplicación upstream < Nginx < balanceador de carga < CDN.

Si tu CDN expira a los 30 segundos y Nginx permite 60 segundos, el CDN generará errores 499 falsos antes de que Nginx tenga oportunidad de responder.

Audita cada capa.

Paso 6: Para flujos de trabajo de automatización;

Establece timeouts de cliente explícitos que coincidan con la ventana de respuesta real del servidor.

Un script de Playwright o Puppeteer que usa un valor predeterminado de 30 segundos y accede a un endpoint de 45 segundos fallará siempre.

Cómo los proxies de CyberYozh te ayudan a evitar errores 499 falsos

Cuando los proxies están en tu cadena de solicitudes, para scraping, automatización o flujos de trabajo con múltiples cuentas, se convierten en una fuente adicional de latencia. Un proxy con mala reputación de IP, alta contención en el pool compartido o desajuste geográfico con el servidor de destino añade latencia a cada salto.

Para solicitudes que ya están cerca del umbral de timeout del cliente, la latencia añadida es lo que empuja una solicitud límite por encima del umbral hacia un error 499. Esta es la contribución de la capa de proxy a los errores 499 falsos, y es completamente evitable.

Conexiones consistentes y de baja latencia

Los proxies residenciales de CyberYozh, mobile proxyy proxies de datacenter mantienen tiempos de conexión estables con los servidores upstream.

Los picos de latencia por «vecino ruidoso» comunes en pools de proxies compartidos de alta densidad, donde el tráfico de un usuario abusivo degrada los tiempos de respuesta de todos los demás, se eliminan en los proxies dedicados.

Verificación previa de reputación de IP antes de conectar

Una IP marcada o limitada añade sobrecarga antes de que tu solicitud siquiera llegue al destino.

CyberYozhde CyberYozh verifica la reputación de IP antes de que enrutes el tráfico de producción a través de ella.

Una IP que ya está siendo limitada por el objetivo devolverá respuestas más lentas, empujando las solicitudes marginales al territorio 499.

Coincidencia geográfica de proxy

Enrutar una solicitud de objetivo con base en EE.UU. a través de un proxy residencial europeo añade latencia innecesaria.

Las ubicaciones globales de CyberYozh te permiten hacer coincidir la región del proxy con la región del servidor objetivo, minimizando el tiempo de ida y vuelta.

Configuración de timeout compatible con automatización

La API de CyberYozh se integra con Playwright, Puppeteer y Selenium.

Configuras los timeouts a nivel de solicitud para que coincidan con las ventanas de respuesta reales del servidor, no con los valores predeterminados de las herramientas establecidos sin tener en cuenta tu objetivo específico.

Lo que los proxies no pueden solucionar:

Un servidor upstream genuinamente lento.

Si el backend tarda 120 segundos y el timeout del cliente es de 60, ningún proxy soluciona eso.

CyberYozh elimina la contribución de la capa de proxy a los 499. La lógica de aplicación lenta es un problema separado.

Conclusión final: ¿Deberías preocuparte por los errores 499?

Un puñado por día: normal. No investigues.

Un pico concentrado en un endpoint: señal real. Algo se volvió más lento: una consulta de base de datos, una llamada a API externa o un despliegue reciente. Encuéntralo con $upstream_response_time y soluciona la causa en lugar de aumentar el timeout.

Un pico en todo el sitio: revisa tu infraestructura. Hosting bajo carga, servicios upstream degradándose o una configuración incorrecta de timeout de CDN está causando 499 falsos en todos los ámbitos.

Para cualquiera que ejecute proxies en su flujo de trabajo, la capa de proxy a menudo se pasa por alto. Un proxy lento, marcado o geográficamente no coincidente empuja silenciosamente las solicitudes límite al territorio 499.

Una infraestructura de proxy limpia, dedicada y geográficamente apropiada elimina esa variable por completo, así que cuando veas un 499, sabes que es un problema real de backend y no un artefacto de proxy. Regístrate con CyberYozh para una infraestructura realista.

bash

grep ' 499 ' /var/log/nginx/access.log | awk '{print $7}' | sort | uniq -c | sort -rn | head -20