Automatización de Web Scraping: Cómo ejecutar raspadores según cronograma

Aquí vamos a repasar las particularidades técnicas de la automatización del web scraping, un proceso del que muchas empresas dependen para obtener datos de alta calidad, ya sea para investigación de mercado, información SEO/SERP o análisis de sentimientos de clientes. Una parte importante del proceso es que la mayoría de los servicios marcan y limitan rápidamente las solicitudes múltiples durante períodos cortos de tiempo, que son inevitables durante el scraping automatizado, por lo que es esencial distribuir la carga de solicitudes entre múltiples IPs utilizando proxies rotatorios.

Qué es la automatización del web scraping

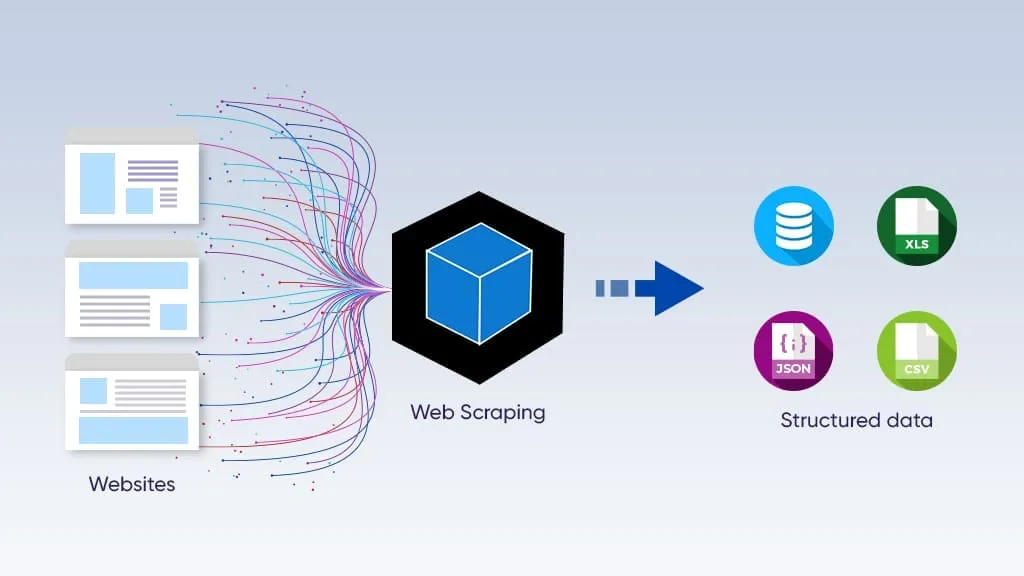

La automatización del web scraping es un proceso programable de conexión a servidores web y extracción de datos de ellos sin trabajo manual. Todo lo que se necesita es configurar un web scraper y crear instrucciones para él. Después de eso, completa todo el trabajo por sí solo. Normalmente, los archivos resultantes son tablas en formatos .csv o .json, o archivos de base de datos que pueden procesarse con consultas SQL.

Es fundamental recordar que la plataforma limita los flujos de solicitudes masivas y automatizadas, típicos del web scraping. Por eso los proxies son esenciales para ello. Lee más sobre los servicios de rotación de IP y cómo utilizarlos para evitar prohibiciones y restricciones

Enfoques para automatizar el web scraping

Existen dos enfoques principales para la automatización del web scraping: usar plataformas de bajo código para configurarlo, o escribir scripts de Python con bibliotecas y frameworks especializados.

Herramientas sin código/de bajo código

Estos instrumentos ofrecen interfaces de apuntar y hacer clic, a menudo visuales, que pueden usarse sin conocimientos de programación. Puede ayudar, ya que algunas de estas plataformas permiten personalización mediante programación, pero no es obligatorio. Los usuarios definen reglas de scraping haciendo clic en elementos de la página, configurando la lógica de paginación y estableciendo formatos de salida como CSV o JSON, todo a través de una interfaz gráfica.

Son fáciles de configurar, pero también tienen muchas limitaciones:

Los scrapers sin código se rompen fácilmente cuando un sitio web objetivo cambia su diseño.

Tienen dificultades con páginas dinámicas con mucho JavaScript o lógica empresarial personalizada.

Se vuelven costosos a gran escala y es difícil personalizarlos.

Estas herramientas son utilizadas principalmente por especialistas en marketing, analistas de negocios, gerentes de comercio electrónico y emprendedores. Aun así, las soluciones basadas en programación son mejores para el scraping a gran escala.

Soluciones basadas en programación

Estas herramientas son bibliotecas y frameworks, principalmente para Python, el lenguaje de programación más utilizado. El scraping basado en programación brinda a los desarrolladores un control total y granular sobre cada aspecto del proceso de extracción, desde cómo se envían las solicitudes HTTP hasta cómo se analizan, almacenan y programan los datos.

La limitación clave es la barrera técnica: construir, mantener y programar scrapers de nivel de producción requiere habilidades de codificación, tiempo de depuración y decisiones de infraestructura. Este enfoque es utilizado por ingenieros de datos, desarrolladores backend, científicos de datos y growth hackers que necesitan confiabilidad, personalización y programabilidad.

Proxies de automatización web y por qué son necesarios

La mayoría de los sitios web, excluyendo grandes bases de datos abiertas (que generalmente están diseñadas para scraping), limitan el número de solicitudes permitidas desde una sola IP. Cuando un usuario excede este límite, la plataforma limita las solicitudes, desafiando al usuario con un CAPTCHA o bloqueándolo. Además, las plataformas monitorean todas las solicitudes, sus IPs y otras huellas (como datos del navegador) para encontrar inconsistencias y comportamientos similares a bots, y marcan direcciones sospechosas incluso si no exceden el límite. Por eso el pool de IPs proxy y la navegación antidetección son necesarios aquí: mitigan estos problemas.

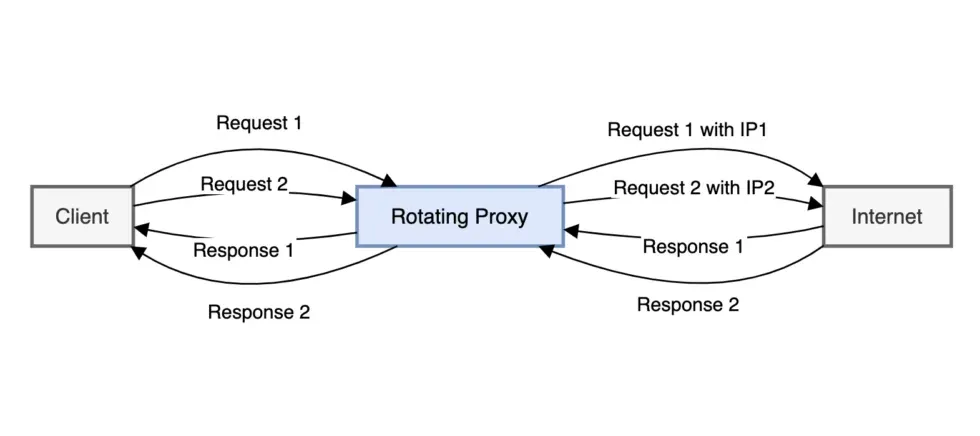

La rotación de proxies significa que cada solicitud (o grupo de solicitudes) se envía desde diferentes direcciones IP. Principalmente, hay dos tipos:

Proxies móviles utilizan las direcciones IP de proveedores de Internet móvil (LTE/5G) y tienen el nivel de confianza más alto, ya que las plataformas no los distinguen de los usuarios de Internet móvil. Son los más adecuados para el scraping de datos sociales.

Proxies residenciales rotatorios utilizan un pool de direcciones IP residenciales y rotan entre ellas según un algoritmo preestablecido. Su nivel de confianza es menor pero aún bueno para la mayoría de las plataformas, y son una buena opción para la mayoría de las tareas de web scraping.

Antes de usar cualquier dirección IP, su calidad debe evaluarse utilizando el IP Checkerde CyberYozh, que muestra su Fraud Score.

Los navegadores antidetección mejoran aún más la seguridad al proporcionar un conjunto separado de huellas digitales para cada sesión. Combinado con una IP limpia, cada sesión ahora parece ser una identidad digital auténtica, y la probabilidad de prohibiciones y desafíos CAPTCHA disminuye significativamente.

Lee más sobre antidetección y cómo funciona.

Cuáles son los servicios de web scraping y automatización más confiables

Automatizar el web scraping implica usar varias herramientas y técnicas para programar y ejecutar tareas de extracción sin intervención manual. El mejor método depende de tus conocimientos de programación, la complejidad del sitio web objetivo y la escala deseada de la operación. Independientemente del método, es esencial combinar tu scraper con proxies rotatorios para garantizar que tus sesiones no sean prohibidas.

Plataformas dedicadas sin código

Las plataformas de scraping especialmente diseñadas combinan constructores visuales de scrapers con infraestructura en la nube, programación integrada, rotación de proxies y manejo de CAPTCHA sin necesidad de codificación.

Scrapeless proporciona actores de scraping especializados para plataformas de comercio electrónico (Amazon, Shopee), monitoreo competitivo, seguimiento de visibilidad de IA (ChatGPT, Gemini, etc.), con navegador de scraping en la nube, API de scraping universal y navegador de agentes nativo de IA con integraciones MCP/CLI — los nuevos usuarios obtienen $10 en créditos de prueba gratuitos. Ideal para equipos técnicos y desarrolladores de IA que construyen pipelines de datos escalables con integración fluida de flujos de trabajo de agentes.

Octoparse es un constructor de scrapers de apuntar y hacer clic con ejecución en la nube, detección automática de plantillas y ejecuciones programadas para datos de comercio electrónico y leads.

Apify ofrece un mercado de más de 1,500 «Actors» de scraping listos para usar para sitios populares, con alojamiento en la nube y salida API.

Browse.ai se especializa en monitoreo de sitios web; detecta cambios y activa alertas sin reconfiguración manual.

Web Scraper es una extensión basada en navegador, fácil de usar para principiantes, con programación en la nube para extracción simple de datos estructurados.

Ideal para equipos de marketing, analistas y negocios que necesitan recopilación recurrente de datos sin recursos de desarrolladores.

Plataformas de automatización

Las herramientas de automatización de propósito general conectan pasos de web scraping a flujos de trabajo empresariales más amplios, dirigiendo los datos extraídos hacia CRMs, hojas de cálculo o herramientas de mensajería.

Zapier conecta activadores de scraping a más de 6,000 aplicaciones; ideal para transferencias ligeras de datos como nuevos listados → Slack o Google Sheets.

n8n es un constructor de flujos de trabajo de código abierto y autoalojado con nodos de solicitud HTTP, que ofrece más control y lógica personalizada que Zapier.

Estas plataformas son adecuadas para equipos de operaciones y crecimiento que desean actuar sobre los datos extraídos de inmediato: automatizando notificaciones, enrutamiento de leads o pipelines de informes, en lugar de simplemente almacenarlos.

Bibliotecas de Python

Las bibliotecas de Python brindan a los desarrolladores control programático completo sobre la lógica de scraping, programación y manejo de datos, desde análisis simple de HTML hasta automatización completa del navegador.

Scrapy es un framework de rastreo de nivel de producción con pipelines integrados, middlewares y programación para extracción de datos de alto volumen. Instálalo usando pip con el comando pip install scrapy

BeautifulSoup + Requests es una combinación ligera para analizar páginas HTML estáticas; es rápida para prototipar pero limitada para sitios dinámicos.

Playwright/Puppeteer/Selenium son todas herramientas de automatización de navegadores sin interfaz gráfica que manejan renderizado de JavaScript, interacciones de usuario y flujos de inicio de sesión complejos.

La opción preferida para desarrolladores e ingenieros de datos que construyen pipelines personalizados y escalables que requieren control preciso sobre proxies, manejo de errores y procesamiento de datos posteriores.

Ejecutar un programador para gestión automática de scrapers

Una vez configurada la herramienta de scraping, su actividad también debe automatizarse. Un scraper automatiza la extracción de datos web, pero otra herramienta, llamada programador, automatiza cuándo debe ejecutarse el scraper y cuándo debe estar inactivo. También es posible encenderlo y apagarlo manualmente, pero los programadores permiten más control y precisión, lo cual, como ya hemos visto, es crucial. Usualmente, se utilizan dos tipos de programadores: a nivel de sistema y basados en la nube.

Lee más sobre estrategias de rotación de IP para seleccionar la que necesitas.

Programadores a nivel de sistema

Comencemos con el primer tipo. Ejemplos típicos son los programas de programación estándar para sistemas operativos Unix (incluido macOS) y Windows.

Cron Jobs: El programador de trabajos basado en tiempo estándar para sistemas operativos tipo Unix, ideal para ejecutar scripts de Python de forma programada.

Programador de tareas de Windows: El equivalente integrado de Windows para programar programas o scripts para que se ejecuten en momentos específicos.

Ambos programas tienen una interfaz muy simple que permite a los usuarios iniciar y detener otros programas dentro de un tiempo específico.

Soluciones basadas en la nube

Las plataformas de programación basadas en la nube despliegan y ejecutan scripts de scraping en sus entornos digitales. Ejemplos típicos son GitHub Actions, AWS Lambda y Apache Airflow.

GitHub Actions es una plataforma CI/CD gratuita que puede ejecutar tus scripts de scraping en los servidores de GitHub, asegurando que se ejecuten incluso cuando tu máquina local esté apagada.

AWS Lambda es una opción altamente escalable y rentable para ejecutar scrapers en la nube, simplemente publicando el código en su entorno de ejecución y lanzándolo.

Apache Airflow es una plataforma de código abierto para crear, programar y monitorear flujos de trabajo de forma programática, adecuada para pipelines de datos complejos.

Estas plataformas son especialmente adecuadas para el acceso compartido y el trabajo en equipo, cuando varios desarrolladores trabajan en un mismo proyecto utilizando cualquiera de estas herramientas.

Tabla resumen de las plataformas de web scraping y programación

Resumamos estas plataformas de scraping y programación según sus principios de uso, ejemplos y para qué son mejores.

Tipo de plataforma | Ejemplos | Mejor para | Codificación |

Herramientas de análisis sin código | Octoparse, Browse AI, Apify | No desarrolladores, monitoreo | No |

Bibliotecas Python | Scrapy, Playwright, BS4 | Control total, lógica personalizada | Sí |

Plataformas de automatización | n8n, Zapier, Airflow | Integración de flujos de trabajo | Baja/opcional |

Programadores en la nube | GitHub Actions, AWS Lambda | Sin servidor, ejecuciones permanentes | Moderada |

Programadores del sistema operativo | Cron (Unix), Programador de tareas (Windows) | Programación de scripts locales | Mínima |

Configuración de un web scraper automatizado: Mejores prácticas

Ahora, exploremos las mejores prácticas para ejecutar una herramienta de web scraping.

Verificar robots.txt

Los sitios web suelen tener un archivo especializado llamado robots.txt que especifica qué contenido puede y no puede ser rastreado. Por lo general, los sitios web protegen sus páginas de inicio de sesión, panel de usuario y otras páginas con información sensible. Para acceder a él, simplemente añade su nombre a la raíz del sitio web (es decir, app.cyberyozh.com/robots.txt), y aquí verás las reglas de scraping del sitio web. No extraigas los datos que estén prohibidos en él.

Rota tu IP con proxies

Rota las direcciones IP utilizando servicios proxy para evitar la limitación de velocidad y el bloqueo de IP al hacer scraping a gran escala. Asegúrate de verificar la calidad de la IP antes de rotarla. Con el verificador de CyberYozh, esto puede automatizarse usando la API de CyberYozh, de modo que la rotación solo ocurrirá si la IP objetivo tiene una puntuación de fraude baja.

Implementa retrasos aleatorios

Añade retrasos aleatorios entre solicitudes para evitar sobrecargar el servidor objetivo o que tu dirección IP sea bloqueada. Asegúrate de no infringir los Términos de Servicio del sitio web haciendo demasiadas solicitudes, ya que esto puede interrumpir el funcionamiento del sitio y generar conflictos con la plataforma.

Lee más sobre la salud de las direcciones IP en el artículo sobre el ciclo de gestión de proxies de CyberYozh.

Maneja errores automáticamente

Implementa bloques try-catch o mecanismos similares de manejo de errores para gestionar problemas potenciales como errores de red o cambios en la estructura del sitio web. Esto garantizará que los errores potenciales se contabilicen y reporten antes de que comience el scraping, para que puedas responder adecuadamente, ahorrar tu tráfico y prevenir problemas.

Usa navegación sin interfaz gráfica

Para ahorrar tráfico, algo crucial en el web scraping, puedes usar un método de navegación sin interfaz gráfica, cuando tu scraper accede solo a los datos que necesitas (precios, costos, resultados de búsqueda, listados, comentarios de usuarios, etc.) sin interfaz de usuario. Como los proxies rotativos generalmente cobran por la cantidad de tráfico, esto también será rentable.

Mejores prácticas de web scraping: Resumen

La automatización del web scraping combina la herramienta de scraping adecuada, un programador confiable y proxies rotativos en un único flujo de datos sin intervención manual. Ya seas un especialista en marketing usando Octoparse o un desarrollador construyendo pipelines con Scrapy, los fundamentos siguen siendo los mismos: distribuye tus solicitudes a través de IPs limpias, respeta las reglas de la plataforma y maneja los errores de forma proactiva. Los proxies residenciales y móviles de CyberYozh, combinados con su API de verificación de IP, te brindan la infraestructura para ejecutar scrapers a gran escala sin bloqueos ni interrupciones.

Preguntas frecuentes sobre automatización de web scraping

¿Qué es la automatización de web scraping?

Un proceso programable que extrae datos web automáticamente según un calendario, sin trabajo manual, generando resultados en CSV, JSON o una base de datos.

¿Necesito conocimientos de programación para automatizar el web scraping?

Las plataformas sin código como Octoparse y Browse.ai manejan todo visualmente. La programación desbloquea más poder y flexibilidad a gran escala.

¿Por qué se bloquean los scrapers?

Los sitios web detectan solicitudes repetidas desde una sola IP y marcan el comportamiento similar al de un bot. Siguen límites de velocidad, CAPTCHA y bloqueos de IP.

¿Qué es la rotación de IP y por qué es importante?

La rotación de IP envía cada solicitud desde una dirección IP diferente, previniendo la limitación de velocidad y haciendo que las sesiones de scraping parezcan usuarios reales.

¿Cuál es la diferencia entre proxies residenciales y móviles para scraping?

Los proxies móviles tienen el nivel de confianza más alto y rara vez son bloqueados; los proxies residenciales ofrecen un grupo más grande y se adaptan a la mayoría de las tareas generales de scraping.

¿Qué es un cron job en web scraping?

Un programador de sistema basado en Unix que activa un script de scraping automáticamente en intervalos de tiempo definidos, como diariamente o cada hora.

¿Puedo ejecutar scrapers en la nube gratis?

Sí. GitHub Actions ofrece ejecución gratuita en la nube de scripts de scraping según un calendario, incluso cuando tu máquina local está apagada.

¿Qué es robots.txt y debo respetarlo?

Un archivo que declara qué páginas permite un sitio que sean rastreadas. Respetarlo mantiene tu scraper ético y reduce el riesgo legal.

¿Qué es un navegador sin interfaz gráfica y cuándo debo usarlo?

Un navegador que funciona sin interfaz de usuario, utilizado para extraer páginas renderizadas con JavaScript de manera eficiente, consumiendo menos ancho de banda y tráfico de proxy.

¿Cómo puedo verificar si mi IP de proxy está limpia antes de usarla?

Utiliza el verificador de IP de CyberYozh para obtener una puntuación de fraude para cualquier IP; esto se puede automatizar a través de la API de CyberYozh.