Como extrair dados do Google Trends: O guia prático completo (2026)

Por que alguém iria querer fazer scraping do Google Trends em 2026? Antes de uma única linha de código, o «porquê» merece um momento.

O Google Trends é algo genuinamente raro na internet:

uma janela em tempo real e publicamente acessível sobre o que milhões de pessoas estão ativamente pensando, procurando e prestando atenção.

Não são pesquisas de opinião.

Não é comportamento autorrelatado.

São consultas de pesquisa reais, agregadas e indexadas como sinais de interesse relativo, atualizadas continuamente.

Isso é uma fonte de dados extraordinária. O problema é a interface.

O site do Google Trends foi criado para exploração casual. Você pode digitar uma palavra-chave, olhar um gráfico e formar uma impressão aproximada de como o interesse se moveu.

O que você não pode fazer, não através do site, é extrair dados de interesse semanais de 200 palavras-chave simultaneamente, monitorar quando tópicos emergentes começam a disparar, comparar demanda geográfica em 40 mercados ou integrar sinais do Trends num pipeline automatizado de conteúdo ou inteligência de negócios.

O scraping resolve exatamente essa lacuna. Ele transforma uma ferramenta projetada para curiosidade individual numa infraestrutura de dados escalável.

Resumo:

A forma mais confiável de fazer scraping de dados do Google Trends em 2026 é com o pytrends, uma biblioteca Python não oficial que se conecta à API interna do Trends do Google, sem necessidade de chave de API.

Para scraping de maior volume ou requisitos mais complexos, a automação de navegador via Playwright oferece mais flexibilidade.

Ambos os métodos requerem rotação de proxies residenciais em escala significativa para evitar limitação de taxa baseada em IP.

Os dados do Google Trends são publicamente disponíveis, legalmente acessíveis para análise e usados diariamente por profissionais de SEO, profissionais de marketing de conteúdo, pesquisadores e analistas financeiros em todo o mundo.

Quem realmente usa isso em escala:

Uma proprietária de loja Shopify percebeu através do Google Trends que o interesse em «Stanley cup tumbler» começou a subir acentuadamente em outubro de 2022, cerca de seis semanas antes de se tornar um fenómeno cultural.

Ela triplicou o seu inventário de acessórios ao custo. As suas concorrentes, rastreando manualmente a mesma tendência, responderam seis semanas depois que o pico de pesquisa já havia passado. Ela capturou o aumento da demanda; elas correram atrás.

É isso que o acesso programático ao Google Trends realmente faz por pessoas reais. A mesma lógica aplica-se à priorização de palavras-chave de SEO , calendários editoriais de conteúdo, análise de sentimento financeiro, pesquisa académica e inteligência competitiva.

Os dados estão lá. A questão é se você os está acessando sistematicamente ou incidentalmente.

É legal fazer scraping do Google Trends

Resposta direta: Fazer scraping do Google Trends não é ilegal sob as leis dos Estados Unidos, União Europeia, Reino Unido ou da maioria das outras jurisdições principais. Pode entrar em conflito com os Termos de Serviço do Google, que proíbem amplamente o acesso automatizado, mas esta é uma consideração contratual, não criminal, e a aplicação contra pesquisadores ou analistas individuais é efetivamente inexistente.

Vamos colocar isso em contexto em vez de deixar vago:

O Computer Fraud and Abuse Act nos EUA, o Computer Misuse Act no Reino Unido e o RGPD na UE abordam todos o acesso não autorizado a sistemas e a proteção de dados pessoais.

Fazer scraping de dados agregados anónimos publicamente disponíveis do Google Trends não implica significativamente nenhum desses enquadramentos.

Uma decisão do Nono Circuito dos EUA de 2022 em HiQ Labs v. LinkedIn estabeleceu que fazer scraping de dados publicamente acessíveis, dados que não requerem login ou autenticação para visualizar, não é uma violação do CFAA.

Os Termos de Serviço do Google são uma consideração separada. São um contrato entre você e o Google, não uma lei. Violá-los pode resultar em bloqueio de IP ou encerramento de serviço, consequências técnicas, não legais.

O enquadramento pragmático usado por profissionais:

Limite as requisições. Não envie centenas de requisições por minuto. O acesso automatizado razoável imita o comportamento humano.

Extraia o que você precisa para análise. Não arquive todo o conjunto de dados sem um propósito.

Não redistribua dados brutos extraídos comercialmente. É aqui que as questões de licenciamento se tornam reais.

Use os dados para obter insights. Estratégia de conteúdo, pesquisa e inteligência de negócios são os propósitos para os quais o Google Trends foi projetado para informar.

A grande maioria dos profissionais de SEO, jornalistas, pesquisadores académicos e analistas de dados que extraem dados do Google Trends fazem isso todos os dias sem incidentes. O risco é real na teoria, negligenciável na prática para casos de uso legítimos.

Compreender o que são os dados do Google Trends

Antes de escrever código, entender o que você está a extrair é importante porque os dados do Google Trends têm uma peculiaridade que confunde iniciantes e frustra utilizadores intermediários igualmente.

O Google Trends não mostra volumes de pesquisa absolutos:

Ele mostra interesse relativo, uma pontuação de 0 a 100 onde 100 representa o pico de interesse dentro do período temporal e geografia selecionados.

50 significa metade do pico.

0 significa dados insuficientes para exibir.

Estes são dados deliberadamente normalizados.

A Google não divulga contagens brutas de volume de pesquisa através do Trends.

O que isto significa na prática:

Se você extrair dados para «veículos elétricos» ao longo de 5 anos, a pontuação da semana de pico é 100.

Todas as outras semanas pontuam relativamente a esse pico.

Se você então extrair uma consulta separada para «painéis solares» durante o mesmo período, o seu pico também pontua 100, mesmo que o volume de pesquisa absoluto para «painéis solares» tenha sido apenas um décimo do de «veículos elétricos».

Este é o problema da normalização. Torna as comparações entre consultas dentro de uma única extração de dados significativas, mas não confiáveis entre extrações de dados separadas .

A solução: Compare sempre palavras-chave dentro da mesma chamada build_payload() do pytrends. Incluir uma palavra-chave «âncora» consistente (uma com volume de pesquisa estável e bem compreendido) em cada lote permite normalizar dados entre múltiplas extrações.

Por exemplo, incluir «tempo», uma palavra-chave com volume de pesquisa consistente e previsível, como âncora em cada lote permite calibrar o interesse relativo de forma comparável entre requisições separadas.

Comparação de métodos: Qual abordagem de extração é a certa para si

Antes de mergulhar em cada método, aqui está a tabela de decisão:

Método | Dificuldade | Confiabilidade | Velocidade | Melhor Caso de Uso | Limitação Principal |

pytrends (biblioteca Python) | Iniciante | Alta | Rápida | Casos de uso padrão mais comuns | Limites de taxa em volume |

Requisições HTTP diretas | Intermediário | Médio- Alto | Rápido | Parâmetros personalizados, processamento em lote | Requer gerenciamento de cabeçalho/cookie |

Automação de navegador (Playwright) | Avançado | Muito Alto | Lento | Páginas complexas, evitar CAPTCHA | Uso intensivo de recursos |

Plataformas sem código (Apify, etc.) | Iniciante | Médio | Variável | Não-desenvolvedores, exportações rápidas | Custo contínuo de assinatura |

Exportação manual CSV | Nenhum | Perfeito | Muito Lento | Conjunto de dados pequeno único | Não escalável |

Comece com pytrends. Migre para automação de navegador apenas quando pytrends falhar consistentemente para o seu caso de uso específico.

Método 1: Pytrends

Resposta direta: pytrends é uma biblioteca Python não oficial que se comunica com a APIde dados interna do Google Trends. Não requer chave de API, instala em segundos e lida com as tarefas de extração de dados mais comuns com código mínimo. É o ponto de partida correto para praticamente todos.

O que é Pytrends

pytrends (originalmente criado pelo usuário GeneralMills, agora mantido pela comunidade de código aberto) está disponível tanto no GitHub quanto no PyPI.

Abstrai os endpoints internos do Trends da Google em chamadas de função Python limpas, lidando automaticamente com cookies de autenticação, formatação de requisições e análise de respostas.

Não é um produto oficial da Google. A Google não o endossa.

Mas funciona de forma confiável para a grande maioria dos casos de uso padrão e está em uso ativo desde 2015, com manutenção consistente da comunidade até 2026.

Instalando o pytrends: bash

pip install pytrends

É necessário Python 3.7 ou posterior. Esta é a instalação completa.

Sua primeira extração de dados

Este script recupera dados de interesse semanal para uma única palavra-chave nos últimos 12 meses:

from pytrends.request import TrendReq

# Initialize — hl sets the language, tz sets the timezone offset

pytrends = TrendReq(hl='en-US', tz=360)

# Build the payload — specify up to 5 keywords here

pytrends.build_payload(

kw_list=['artificial intelligence'],

timeframe='today 12-m',

geo='' # Empty string = worldwide

)

# Pull interest over time

data = pytrends.interest_over_time()

print(data.head(10))Execute isto e receberá um DataFrame do pandas, uma tabela com datas como índice de linhas e pontuações de interesse semanais (0–100) como valores. A coluna isPartial indica semanas ainda não totalmente indexadas; filtre-a para uma análise limpa:

data = data[data['isPartial'] == False]Comparando múltiplas palavras-chave

Uma das funcionalidades mais poderosas do pytrends é a comparação direta de palavras-chave, até cinco palavras-chave simultaneamente, normalizadas na mesma escala de 100 pontos:

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

kw_list=['ChatGPT', 'Gemini', 'Claude AI', 'Copilot'],

timeframe='today 12-m',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Which platform has the highest average interest?

print(data[['ChatGPT', 'Gemini', 'Claude AI', 'Copilot']].mean())Estes dados comparativos são genuinamente estratégicos. Se está a criar conteúdo no espaço de ferramentas de IA, saber qual plataforma tem interesse de pesquisa crescente versus estagnado indica-lhe para onde a atenção da audiência está ativamente a migrar, antes dessa mudança ser visível em qualquer outra fonte de dados.

Dados de interesse geográfico

Onde no mundo está concentrado o interesse? Isto extrai dados ao nível de país:

pytrends.build_payload(

kw_list=['electric vehicles'],

timeframe='today 12-m'

)

# Country-level interest

by_country = pytrends.interest_by_region(resolution='COUNTRY', inc_low_vol=True)

# Sort by interest descending

print(by_country.sort_values('electric vehicles', ascending=False).head(20))

Para resolução regional dentro de um único país (estados dos EUA, regiões do Reino Unido), ajuste o parâmetro de resolução:

by_state = pytrends.interest_by_region(resolution='REGION', geo='US')Isto é inestimável para empresas que tomam decisões de expansão geográfica ou anunciantes que alocam orçamentos regionais.

Consultas relacionadas em ascensão: A funcionalidade mais subutilizada

É aqui que o Google Trends se torna uma verdadeira ferramenta de inteligência de conteúdo:

python

pytrends.build_payload(

kw_list=['remote work tools'],

timeframe='today 3-m'

)

related = pytrends.related_queries()

# Rising queries — growing fastest relative to their usual volume

print(related['remote work tools']['rising'])

# Top queries — highest absolute interest

print(related['remote work tools']['top'])Consultas relacionadas em ascensão mostram o que as pessoas estão a pesquisar juntamente com a sua palavra-chave, que está a crescer mais rapidamente em volume. Para profissionais de marketing de conteúdo, isto representa três a seis semanas de inteligência de palavras-chave antecipada. Publique sobre uma consulta relacionada em ascensão antes de atingir o pico de interesse, e o seu conteúdo estará posicionado para a curva de procura em vez de a perseguir.

Pesquisas em tendência em tempo real

Para monitorizar o que está em tendência agora:

trending_today = pytrends.trending_searches(pn='united_states')

print(trending_today.head(20))Isto retorna as 20 principais pesquisas em tendência no país especificado no momento da requisição. Útil para monitorização de notícias, estratégias de reatividade de conteúdo e identificação de tendências nas redes sociais.

Método 2: Requisições HTTP diretas

Resposta direta: Requisições HTTP diretas dão-lhe controlo granular sobre parâmetros de consulta, cabeçalhos e gestão de sessão que o pytrends abstrai. Isto é apropriado para utilizadores avançados que necessitam de formatos de intervalo de tempo personalizados, filtragem precisa de categorias ou gestão de requisições em lote de alto volume.

Nos bastidores, o pytrends faz requisições GET aos endpoints internos do Trends da Google, principalmente:

https://trends.google.com/trends/api/widgetdata/multiline

https://trends.google.com/trends/api/explore

Estes endpoints retornam dados JSON precedidos por um prefixo de proteção ()]}') que deve ser removido antes da análise.

Também requerem cookies de sessão e cabeçalhos específicos que o servidor da Google valida.

Aqui está um padrão funcional usando a biblioteca requests:

import requests

import json

session = requests.Session()

# First, establish a session by visiting the main Trends page

session.get('https://trends.google.com/')

# The explore endpoint generates widget tokens for data requests

params = {

'hl': 'en-US',

'tz': '-360',

'req': json.dumps({

"comparisonItem": [

{"keyword": "python programming", "geo": "", "time": "today 12-m"}

],

"category": 0,

"property": ""

}),

'token': '',

'user_type': ''

}

response = session.get(

'https://trends.google.com/trends/api/explore',

params=params

)

# Strip the protection prefix before parsing

clean_response = response.text.lstrip(")}']\n")

data = json.loads(clean_response)Isto é mais complexo que o PyTrends, mas dá-lhe controlo preciso sobre cada aspeto do pedido. A maioria dos utilizadores não precisa deste nível de controlo, mas para pipelines de produção com requisitos específicos de loteamento ou formatos de período temporal não padronizados, é a abordagem apropriada.

Método 3: Automação de navegador com Playwright

Resposta direta: O Playwright automatiza um navegador real, tornando o seu comportamento de scraping virtualmente indistinguível de navegação humana genuína. É o método mais robusto para evitar limites de taxa e CAPTCHA, mas é significativamente mais lento e consome mais recursos do que abordagens baseadas em API.

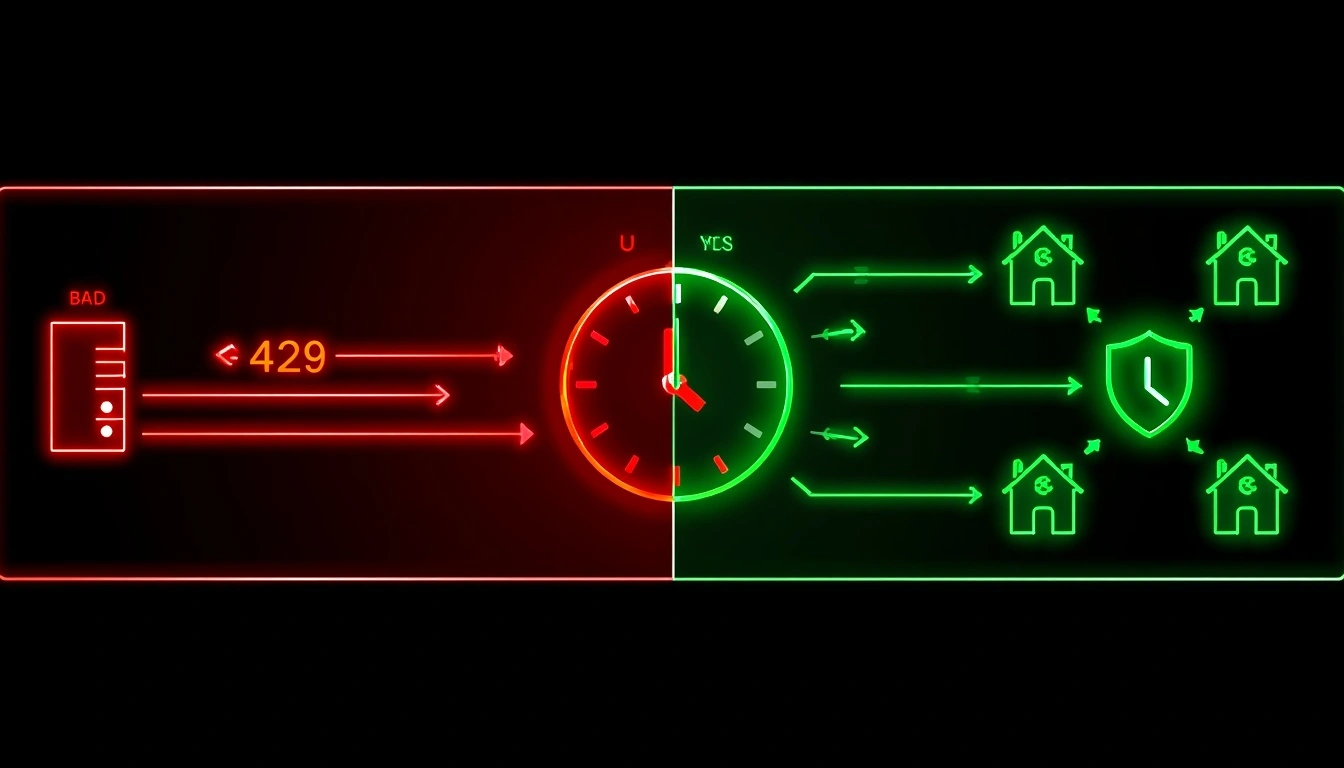

Quando usar Playwright em vez de pytrends:

O pytrends está a retornar erros 429 consistentes, mesmo com proxies e atrasos

Precisa de capturar elementos visuais ou interativos da página não expostos pela API

Precisa de lidar com desafios CAPTCHA (com solucionadores de terceiros apropriados)

Está a fazer scraping de páginas de Trends de nicho com padrões de navegação complexos

Uma configuração Playwright confiável:

from playwright.sync_api import sync_playwright

import time

with sync_playwright() as p:

# Launch browser — headless=False for debugging, True for production

browser = p.chromium.launch(headless=True)

# Create a context with realistic browser settings

context = browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36',

viewport={'width': 1280, 'height': 800}

)

page = context.new_page()

# Navigate to Trends

page.goto('https://trends.google.com/trends/explore?q=python+programming&date=today+12-m&geo=US')

# Wait for the data chart to render

page fully

.wait_for_selector('[class*="widget"]', timeout=10000)

# Add human-like delay

time.sleep(3)

# Extract page content for parsing

content = page.content()

# Alternatively, intercept the API response directly

# This is more reliable than parsing HTML

browser.close()

print("Data extracted successfully")Uma abordagem mais sofisticada interceta os pedidos de rede que o Playwright faz ao carregar a página, capturando a resposta da API diretamente em vez de analisar HTML renderizado. Isto combina as vantagens de discrição da automação de navegador com o formato de dados mais limpo das respostas de API. [Leia sobre documentação Python do playwright]

Por que os limites de taxa acontecem e como lidar com eles

Esta é a secção que a maioria dos tutoriais omite, e é por isso que os principiantes ficam presos após os primeiros pedidos bem-sucedidos.

O Google Trends tem limitação de taxa baseada em IP. Envie demasiados pedidos num curto período de tempo a partir de um único endereço IP, e começará a receber erros 429 (Demasiados Pedidos). Em algumas configurações, receberá um desafio CAPTCHA em vez disso. Nenhum dos casos significa que o seu código está quebrado; significa que acionou a gestão de tráfego automatizada do Google.

Solução 1: Adicionar atrasos entre pedidos

A correção mais simples. Uma chamada time.sleep() entre pedidos permite que os sistemas do Google reiniciem o seu contador por IP:

import time

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

keywords = [

'content marketing', 'SEO strategy', 'link building',

'technical SEO', 'keyword research', 'on-page SEO'

]

results = {}

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m')

results[keyword] = pytrends.interest_over_time()

print(f"✓ {keyword}")

time.sleep(15) # 15 seconds between requests

print("All keywords retrieved.")Para trabalhos em lote com até 50 palavras-chave por sessão, atrasos de 10–15 segundos são tipicamente suficientes. Para lotes maiores, aumente para 30–60 segundos e divida em várias sessões.

Solução 2: Proxies residenciais rotativos

Para automação de maior volume, a rotação de IP é a solução arquitetural correta. Cada pedido é encaminhado através de um endereço IP diferente, portanto nenhum endereço IP único acumula pedidos suficientes para acionar a limitação de taxa.

Nem todos os proxies são iguais para este caso de uso.

O Google mantém listas extensivas de intervalos de IP de centros de dados: AWS, Google Cloud, DigitalOcean, Vultr, e limita o tráfego destas fontes de forma muito mais agressiva do que o tráfego de endereços residenciais.

Usar um proxy de centro de dados para scraping do Google frequentemente não fornece proteção significativa alguma.

Proxies residenciais encaminham o tráfego através de endereços IP atribuídos a clientes reais de ISP, conexões de internet domésticas e dispositivos móveis.

Para os sistemas do Google, este tráfego é indistinguível de utilizadores genuínos.

Usar proxies CyberYozh para scraping estável do Google Trends

Resposta direta: Proxies residenciais previnem a limitação de taxa do Google Trends ao distribuir pedidos através de milhares de endereços IP residenciais diferentes. CyberYozh oferece proxies residenciais rotativos e proxies móveis com capacidades de geo-targeting, particularmente adequados para automação do Google Trends.

Integrar proxies CyberYozh num fluxo de trabalho pytrends:

from pytrends.request import TrendReq

import time

import random

# CyberYozh proxy configuration

proxy_config = {

'https': 'https://USERNAME:PASSWORD@gate.cyberyozh.com:PORT'

}

# Initialize pytrends with proxy support

pytrends = TrendReq(

hl='en-US',

tz=360,

requests_args={

'proxies': proxy_config,

'verify': True

}

)

keywords = ['machine learning', 'deep learning', 'neural networks',

'computer vision', 'natural language processing']

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m', geo='US')

data = pytrends.interest_over_time()

print(f"Retrieved: {keyword} — {len(data)} weeks of data")

time.sleep(random.uniform(8, 20)) # Randomize delays to mimic human behaviorA random .uniform(8, 20) aleatorização do atraso é importante; intervalos uniformes previsíveis (exatamente 10 segundos todas as vezes) podem, por si só, ser identificados como comportamento automatizado por análises de tráfego sofisticadas.

Segmentação geográfica para dados do Trends:

Uma aplicação frequentemente negligenciada da segmentação geográfica por proxy é obter dados do Trends que refletem o comportamento de pesquisa local genuíno.

O Google Trends calibra o interesse relativo com base na geografia solicitante em algumas configurações.

Um IP residencial dos EUA solicitando dados para um parâmetro geográfico dos EUA produz resultados mais consistentes do que um IP não americano.

A segmentação de IP por país da CyberYozh suporta este caso de uso nativamente, útil para agências que executam análises de Trends em múltiplos mercados ou pesquisadores que necessitam de dados geograficamente representativos.

Confira o catálogo de proxies da CyberYozh para os IPs mais acessíveis e confiáveis globalmente.

Para scraping baseado em Playwright, a configuração do proxy é ligeiramente diferente:

python

from playwright.sync_api import sync_playwright

with sync_playwright() as p:

browser = p.chromium.launch(

headless=True,

proxy={

"server": "https://gate.cyberyozh.com:PORT",

"username": "USERNAME",

"password": "PASSWORD"

}

)

# ... rest of automation codeO problema da normalização: Como comparar dados entre múltiplas extrações

Este é o problema que mais confunde usuários intermediários, e raramente é explicado em tutoriais da concorrência.

O Google Trends normaliza os dados dentro de cada consulta.

O ponto de maior interesse no seu período especificado é sempre 100.

Isso faz sentido para visualizar a trajetória de uma única palavra-chave.

Cria um problema quando você deseja comparar duas palavras-chave que foram extraídas em solicitações separadas.

Cenário: Você extrai dados para «palavra-chave A» e obtém um pico de 100 em março. Em seguida, extrai dados para «palavra-chave B» separadamente, e também obtém um pico de 100 em março. Isso significa que tiveram volume de pesquisa igual? Quase certamente não. Elas apenas estavam em seus respectivos picos.

A técnica de normalização por palavra-chave âncora:

Inclua uma palavra-chave de referência estável em cada lote, uma com volume de pesquisa bem compreendido e consistente. Âncoras comumente usadas incluem «Facebook», «YouTube» ou «clima», palavras-chave que mantêm interesse de pesquisa relativamente estável mês a mês.

from pytrends.request import TrendReq

import pandas as pd

import time

pytrends = TrendReq(hl='en-US', tz=360)

# Batch 1: Compare keyword sets against anchor

batch_1 = ['Facebook', 'content marketing', 'email marketing', 'social media marketing']

batch_2 = ['Facebook', 'SEO', 'PPC advertising', 'influencer marketing']

pytrends.build_payload(batch_1, timeframe='today 12-m', geo='US')

data_1 = pytrends.interest_over_time()[batch_1]

time.sleep(15)

pytrends.build_payload(batch_2, timeframe='today 12-m', geo='US')

data_2 = pytrends.interest_over_time()[batch_2]

# Now normalize both datasets against the anchor (facebook)

# The anchor's values are comparable across batches because they were in both

anchor = 'facebook'

data_1_normalized = data_1.div(data_1[anchor], axis=0)

data_2_normalized = data_2.div(data_2[anchor], axis=0)

# Now you can meaningfully compare any keyword from batch 1 with any from batch 2

print("Normalized comparison:")

print(pd.concat([

data_1_normalized.drop(columns=[anchor]),

data_2_normalized.drop(columns=[anchor])

], axis=1).mean())

Analistas de dados profissionais usam esta técnica, e ela raramente é documentada em tutoriais introdutórios. Ela desbloqueia a capacidade de comparar dezenas de palavras-chave em múltiplas solicitações em lote com resultados significativos e comparáveis.

Casos de uso do mundo real: O que você realmente faz com esses dados

Dados sem aplicação são apenas uma planilha interessante. Veja como é uma análise significativa do Google Trends na prática:

Otimização do calendário de conteúdo

Extraia consultas relacionadas em ascensão semanalmente para seus principais grupos de tópicos.

Quando uma palavra-chave relacionada ultrapassar 40+ na escala de 0–100 e continuar subindo, publique imediatamente uma peça focada nesse tópico.

Mire na curva de crescimento, não no pico.

Planejamento de inventário sazonal e gastos com anúncios

Cinco anos de dados semanais de interesse revelam padrões sazonais com confiabilidade notável.

Um varejista que vende móveis para áreas externas pode ver precisamente quando o interesse da primavera começa a subir em seus mercados-alvo, tipicamente 4–6 semanas antes do pico de comportamento de compra, e programar suas campanhas pagas de acordo.

Priorização de palavras-chave para SEO

Antes de investir em uma campanha de conteúdo para uma palavra-chave alvo, verifique sua trajetória.

Uma palavra-chave com 30.000 pesquisas mensais e uma trajetória ascendente no Trends é um investimento melhor do que uma com 50.000 pesquisas e uma trajetória descendente.

Você está investindo em um mercado em crescimento em vez de um em declínio.

Inteligência competitiva de marca

Acompanhe o interesse de pesquisa de marca dos seus concorrentes ao longo do tempo.

O crescimento sustentado nas pesquisas de marca de um concorrente é um sinal de alerta precoce, mais informativo do que as métricas publicadas por eles e disponível em tempo real.

Indicadores de sentimento financeiro

O interesse de pesquisa em categorias como «refinanciamento de hipoteca», «recessão», «demissões» e «trabalho extra» serve como um indicador antecedente do sentimento do consumidor.

Grandes fundos de hedge e instituições de pesquisa económica usam o Google Trends como uma das entradas em modelos mais amplos de previsão económica.

Pesquisa académica e jornalística

Quantificar a atenção pública a eventos noticiosos, mudanças de políticas, figuras públicas e momentos culturais ao longo do tempo fornece evidências verificáveis e citáveis de padrões de interesse coletivo que são mais objetivas do que o julgamento editorial.

Exportar e visualizar dados do Google Trends

Depois de ter os dados, os próximos passos mais comuns são exportação e visualização:

from pytrends.request import TrendReq

import matplotlib.pyplot as plt

import pandas as pd

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

['AI tools', 'automation software'],

timeframe='today 5-y',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Export to CSV for spreadsheet analysis

data.to_csv('google_trends_export.csv')

print("CSV exported successfully.")

# Create a clean visualization

fig, ax = plt.subplots(figsize=(14, 6))

data['AI tools'].plot(ax=ax, label='AI Tools', color='#2563EB', linewidth=2)

data['automation software'].plot(ax=ax, label='Automation Software', color='#7C3AED', linewidth=2)

ax.set_title('Search Interest Comparison: AI Tools vs Automation Software (5 Years, US)',

fontsize=14, fontweight='bold', pad=20)

ax.set_ylabel('Interest Score (0–100)', fontsize=11)

ax.set_xlabel('')

ax.legend(fontsize=11)

ax.grid(True, alpha=0.3)

ax.set_ylim(0, 110)

plt.tight_layout()

plt.savefig('trends_comparison.png', dpi=150, bbox_inches='tight')

plt.show()Para equipas que preferem planilhas ao Python, a exportação CSV é totalmente compatível com Excel e Google Sheets. A estrutura DataFrame do pandas mapeia-se de forma clara para formatos tabulares, com datas na coluna A e valores de interesse por palavra-chave nas colunas subsequentes.

Resolução dos erros mais comuns e como corrigi-los

Erro: 429 Too Many Requests Você excedeu o limite de taxa por IP do Google. Adicione ou aumente os atrasos time.sleep() entre as solicitações (comece com 15–30 segundos). Para erros 429 persistentes em qualquer nível de atraso, implemente proxies residenciais rotativos.

Erro: ResponseError 500. Geralmente, é um problema temporário de servidor do lado do Google. Aguarde 5–10 minutos e tente novamente. Ocasionalmente desencadeado por parâmetros de payload malformados, verifique duas vezes o formato da string de período ('today 12-m', 'today 3-m', '2022-01-01 2023-12-31').

DataFrame vazio retornado. Sua palavra-chave tem volume de pesquisa insuficiente para a geografia ou período especificado. Tente ampliar o parâmetro geo definindo-o como (string vazia para mundial) ou estendendo o período. Algumas palavras-chave de cauda longa altamente específicas simplesmente não têm dados suficientes para retornar resultados.

Desafio CAPTCHA acionado, O Google suspeita de acesso automatizado. Mude para proxies residenciais, aumente substancialmente os atrasos e reduza o volume de solicitações por sessão. A automação de navegador com Playwright é mais resistente a acionamentos de CAPTCHA do que solicitações diretas de API.

Falha na instalação do pytrends. Certifique-se de que o Python 3.7+ está instalado: python --version. Tente atualizar o pip primeiro: pip install --upgrade pip, depois pip install pytrends.

Apenas dados parciais (isPartial = True para a maioria das linhas). Os 2–3 dias mais recentes de dados do Trends são sempre parciais; o Google ainda não os indexou completamente. Filtre essas linhas: data = data[data['isPartial'] == False].

A normalização entre lotes gera resultados inconsistentes. Consulte a secção de normalização de palavras-chave âncora acima. Inclua sempre uma palavra-chave de referência estável em cada lote para permitir uma comparação significativa entre lotes. [Leia mais sobre erro 499 e erro 520]

Recursos selecionados do GitHub

Em vez de «procure no GitHub e encontrará algo útil», aqui estão recursos específicos que vale a pena guardar nos favoritos:

repositório oficial do pytrends: A referência canónica para documentação de métodos, problemas conhecidos e registo de alterações. O separador Issues contém soluções para a grande maioria dos erros de casos extremos.

Projetos de painéis de pesquisas em tendência: vários repositórios mantidos pela comunidade baseiam-se no pytrends para criar painéis de palavras-chave em tendência em tempo real. Procure «pytrends dashboard» no GitHub para encontrar as opções mantidas mais recentemente.

Utilitários de normalização de dados do Trends: repositórios que abordam especificamente o problema de normalização entre lotes discutido acima. Procure «Google Trends normalization Python» para encontrar as opções com mais estrelas.

Scraper do Google Trends da Apify: Para não programadores que precisam de dados do Google Trends sem escrever código, o actor mantido do Google Trends da Apify fornece uma interface sem código com execuções agendadas e exportação de dados. Os custos variam conforme o volume de utilização.

Construa o pipeline uma vez, use-o para sempre

O Google Trends é uma das poucas fontes de dados genuinamente gratuitas e genuinamente poderosas que a maioria das pessoas utiliza apenas a 10% do seu potencial. Um investimento único na configuração de um pipeline pytrends, mesmo um básico executado semanalmente de forma agendada, fornece-lhe um sistema de alerta precoce contínuo para tópicos em ascensão, mudanças no interesse do público e dinâmicas competitivas emergentes.

Configure o básico hoje. Adicione infraestrutura de proxy à medida que o seu volume cresce. E comece a tratar o comportamento de pesquisa pública como o ativo de inteligência estratégica que realmente é, em vez de algo que verifica manualmente quando se lembra.

Os dados atualizam-se continuamente. Se está ou não a prestar-lhes atenção é a única variável que controla.