Phân tích dữ liệu có nghĩa là gì: Scrapers, Parsers và Proxies

Khi người dùng hỏi phân tích dữ liệu nghĩa là gì, họ đang tìm hiểu về quá trình chuyển đổi có hệ thống mã web thô thành dữ liệu có cấu trúc. Ở đây, chúng ta sẽ khám phá quy trình này, và như mọi khi, tôi sẽ chuẩn bị một câu trả lời rõ ràng và chu đáo nhất có thể, được hỗ trợ bởi đánh giá của người dùng và nhận xét của chuyên gia.

TÓM TẮT

Phân tích dữ liệu là quá trình chuyển đổi HTML thô đã thu thập thành dữ liệu sạch, có cấu trúc, và để thực hiện điều này một cách đáng tin cậy cần có công cụ scraper, parser và chiến lược xoay vòng proxy phù hợp hoạt động cùng nhau.

Scraper thu thập nội dung trang thô; parser trích xuất chỉ những trường bạn cần (giá, tên, đánh giá) thành JSON hoặc CSV

Proxy và xoay vòng IP ngăn chặn lệnh cấm, nhưng bạn nên chọn chiến lược phù hợp: theo yêu cầu cho công việc hàng loạt, phiên cố định cho đăng nhập, theo thời gian cho giám sát theo lịch trình

Lựa chọn framework quan trọng: Scrapy cho quy mô tĩnh, Playwright cho các trang nhiều JavaScript, BeautifulSoup cho phân tích nhẹ

Các trường hợp sử dụng chính bao gồm giám sát giá, xây dựng tập dữ liệu AI, tổng hợp du lịch, theo dõi đánh giá và tạo khách hàng tiềm năng

Open Scraper của CyberYozh (miễn phí, dựa trên Playwright), cộng với nhóm IP dân cư 50M+ và IP Checker để đảm bảo chất lượng, bao phủ toàn bộ quy trình từ thu thập đến dữ liệu sạch

Ý nghĩa phân tích dữ liệu: Định nghĩa cốt lõi

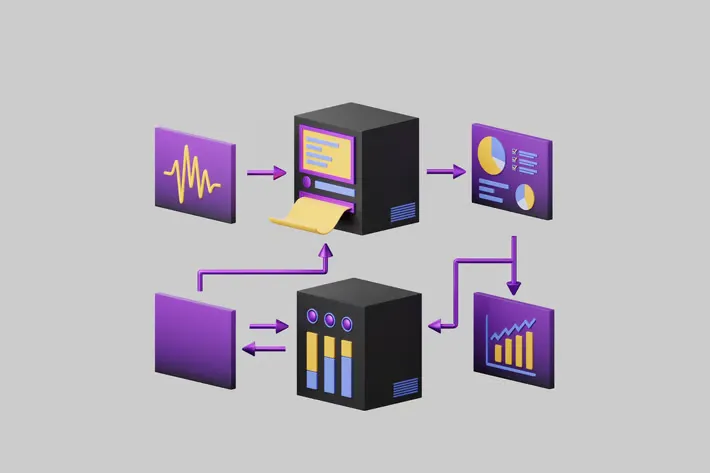

Ý nghĩa phân tích dữ liệu ở dạng đơn giản nhất: đó là quá trình tổ chức thông tin thô, không có cấu trúc (thường là HTML đã thu thập) và trích xuất ý nghĩa từ nó bằng cách chuyển đổi thành định dạng sạch, có thể truy vấn như JSON hoặc CSV. Nếu bạn đang thắc mắc phân tích dữ liệu có nghĩa là gì trong thực tế, hãy nghĩ về nó như một hoạt động ba lớp:

Scraper thu thập nội dung trang thô từ các trang web mục tiêu

Parser đọc các trang đó, áp dụng logic và cô lập các giá trị bạn thực sự cần

Proxy đảm bảo toàn bộ quá trình không bị chặn giữa chừng bởi máy chủ mục tiêu.

Nếu không hiểu đầy đủ quy trình phân tích dữ liệu , việc thu thập dữ liệu tự động hầu như luôn tạo ra kết quả không đầy đủ hoặc bị tắt bởi các biện pháp phòng thủ chống bot. Ý nghĩa của dữ liệu đã phân tích trong bối cảnh kinh doanh là đầu ra sạch, có cấu trúc mà bạn có thể đưa vào bảng tính, cơ sở dữ liệu hoặc mô hình AI. Hãy khám phá các công cụ cụ thể cho việc đó

Data scraper là gì

Data scraper là một chương trình tự động điều hướng các trang web và tải xuống nội dung thô của chúng, thường ở dạng mã nguồn HTML, phản hồi JSON hoặc tải trọng API. Scraper có thể từ một script Python sử dụng thư viện requests để lấy một trang tĩnh đến trình duyệt Chromium không giao diện mô phỏng chuyển động chuột, cuộn và gửi biểu mẫu để mở khóa nội dung được hiển thị động.

Đọc thêm về web scraping trong bảng thuật ngữ của CyberYozh.

Phạm vi mà scraper có thể thu thập là rất lớn:

danh sách sản phẩm

tin tuyển dụng

tiêu đề tin tức

nội dung mạng xã hội

giá bất động sản

lịch trình du lịch

Bất cứ thứ gì hiển thị công khai trên trình duyệt đều có thể được scrape về nguyên tắc. Hạn chế cốt lõi của chúng là trả về toàn bộ trang web như hiện trạng, bao gồm tất cả các thành phần mẫu, menu điều hướng, quảng cáo và nhiễu. Đó chính là lý do tại sao parsing là bước quan trọng tiếp theo.

Ví dụ trường hợp sử dụng: Một startup phân tích thương mại điện tử chạy scraper dựa trên Scrapy để thu thập dữ liệu từ 50 cửa hàng đối thủ cạnh tranh mỗi 6 giờ. Scraper tải xuống hàng loạt trang sản phẩm đầy đủ, lưu trữ HTML thô cục bộ và chuyển tập dữ liệu cho quy trình parsing. Nếu không có parser ở phía sau, HTML thô không có giá trị thương mại.

Data parser là gì

Ý nghĩa của data parser là chương trình nhận HTML thô được thu thập bởi scraper và chỉ trích xuất các điểm dữ liệu liên quan, tổ chức chúng thành định dạng có cấu trúc:

tên sản phẩm

giá sản phẩm

số lượng đánh giá

trạng thái còn hàng

bài đăng mạng xã hội cụ thể

Parser hoạt động bằng cách áp dụng các quy tắc lựa chọn: CSS selector (ví dụ: div.price) hoặc biểu thức XPath xác định chính xác vị trí của giá trị trong DOM. Đầu ra cuối cùng của parser chính là ý nghĩa thực tế của parsed data trong sản xuất: một tập dữ liệu sạch, có kiểu dữ liệu, đã loại bỏ trùng lặp, có thể được chèn vào bảng PostgreSQL, đẩy lên API hoặc sử dụng để huấn luyện mô hình machine learning.

Đọc thêm về checker và parser là gì!

Ví dụ trường hợp sử dụng: Một nền tảng tổng hợp du lịch scrape các trang danh sách khách sạn thô từ 12 nền tảng đặt phòng và chuyển chúng cho parser trích xuất giá nhận phòng, xếp hạng, loại phòng và chính sách hủy. Parser chuẩn hóa tiền tệ và định dạng ngày tháng, sau đó ghi kết quả vào cơ sở dữ liệu thống nhất hỗ trợ so sánh giá theo thời gian thực.

Dữ liệu web thô, tự nó, không thể được truy vấn, trực quan hóa hoặc đưa vào thuật toán: nó cần cấu trúc trước tiên. Doanh nghiệp dựa vào data parsing cho nhiều mục đích sử dụng, mà tôi sẽ tổng quan thêm một chút. Trong mỗi trường hợp này, parsing là bước chuyển đổi tệp HTML thành thông tin chi tiết.

Proxy parsing dữ liệu và xoay vòng IP

Chạy scraper mà không có proxy là một thử nghiệm ngắn hạn. Các trang web theo dõi các yêu cầu lặp lại từ một địa chỉ IP duy nhất và phản hồi bằng giới hạn tốc độ, CAPTCHA, lỗi HTTP 429 hoặc cấm hoàn toàn.

👉 Tìm hiểu thêm về

Xoay vòng IP là thực hành phân phối các yêu cầu qua nhiều địa chỉ IP để các hệ thống phòng thủ của nền tảng thấy lưu lượng truy cập phân tán, trông tự nhiên thay vì một nguồn tự động duy nhất.

Xem hướng dẫn xoay vòng IPcủa CyberYozh, xác định bốn chiến lược cốt lõi dựa trên nhiệm vụ cụ thể:

Xoay vòng ngẫu nhiên: IP chuyển đổi ngẫu nhiên từ nhóm sau một khoảng thời gian biến đổi (ví dụ: 5–40 phút), hòa trộn với các mẫu lưu lượng người dùng thực. Tốt nhất cho việc thu thập dữ liệu tần suất trung bình khi việc mô phỏng hành vi tự nhiên quan trọng.

Xoay vòng theo từng yêu cầu: Mỗi yêu cầu HTTP sử dụng một IP mới từ nhóm. Đây là chiến lược ưu tiên cho việc thu thập dữ liệu khối lượng lớn từ các công cụ tìm kiếm, danh mục sản phẩm và cơ sở dữ liệu lớn khi tốc độ là yếu tố quan trọng nhất.

Xoay vòng theo thời gian (được lập trình trước): IP thay đổi một lần mỗi khoảng thời gian cố định, bất kể số lượng yêu cầu. Lý tưởng cho các công việc giám sát giá chạy theo lịch trình và yêu cầu hành vi có thể dự đoán, dấu vết thấp.

Phiên cố định: Cùng một IP được duy trì trong suốt phiên làm việc, sau đó xoay vòng khi phiên kết thúc. Thiết yếu cho các quy trình làm việc liên quan đến đăng nhập tài khoản, vì việc thay đổi IP giữa phiên sẽ kích hoạt cảnh báo gian lận và vô hiệu hóa phiên.

Nhiều cấu hình thất bại vì họ trộn lẫn các phương pháp này — xoay vòng quá nhanh, hoặc dựa vào các IP chất lượng thấp đã mang tín hiệu rủi ro.

—Hướng dẫn Xoay vòng IP của CyberYozh

Việc chọn sai chiến lược xoay vòng là một trong những nguyên nhân phổ biến nhất gây thất bại thu thập dữ liệu mà thực tế không liên quan đến mã scraper. Hãy cùng khám phá cách áp dụng điều đó cho các nhiệm vụ thực tế cụ thể.

Chiến lược phân tích dữ liệu và các trường hợp sử dụng

Nhiệm vụ

Giám sát giá sản phẩm đối thủ cạnh tranh trên 20 nền tảng thương mại điện tử theo thời gian thực, trên nhiều khu vực.

Chiến lược phân tích dữ liệu

Sử dụng Scrapy cho việc thu thập khối lượng lớn với bước phân tích BeautifulSoup để chuẩn hóa giá và tiền tệ. Áp dụng xoay vòng IP theo từng yêu cầu với proxy dân cư CyberYozh, với định vị địa lý được đặt theo thị trường mục tiêu của người bán. Xuất ra cơ sở dữ liệu với cảnh báo phát hiện thay đổi hàng ngày.

Nhiệm vụ

Tổng hợp dữ liệu giá vé máy bay và khách sạn từ hàng chục nền tảng đặt phòng du lịch cho dịch vụ so sánh giá.

Chiến lược phân tích dữ liệu

Sử dụng Playwright để hiển thị các trang đặt phòng nặng JavaScript và trích xuất giá động. Áp dụng xoay vòng theo thời gian với IP dân cư ở quốc gia mục tiêu, mô phỏng các phiên duyệt web của người dùng thực. Phân tích các trường giá có cấu trúc và đẩy vào công cụ so sánh.

Nhiệm vụ

Xây dựng bộ dữ liệu văn bản đa ngôn ngữ để huấn luyện mô hình ngôn ngữ lớn từ các bài báo, diễn đàn và blog trên 30 quốc gia.

Chiến lược phân tích dữ liệu

Sử dụng Scrapy cho việc thu thập với xoay vòng theo từng yêu cầu trên nhóm IP dân cư rộng bao phủ các ngôn ngữ và khu vực mục tiêu. Phân tích các bài viết bằng bộ chọn CSS để trích xuất tiêu đề, nội dung, ngày tháng và thẻ ngôn ngữ. Lưu trữ trong cơ sở dữ liệu kho ngữ liệu có cấu trúc sẵn sàng cho việc token hóa.

Nhiệm vụ

Thu thập và phân tích đánh giá của khách hàng về thương hiệu của bạn và đối thủ cạnh tranh từ Amazon, Trustpilot, App Store và G2 trên 15 quốc gia.

Chiến lược phân tích dữ liệu

Sử dụng Python Requests + BeautifulSoup cho các trang đánh giá tĩnh; chuyển sang Playwright cho các widget đánh giá được render bằng JavaScript. Áp dụng xoay vòng ngẫu nhiên với IP dân cư từ mỗi quốc gia mục tiêu để truy cập các phiên bản đánh giá theo khu vực. Đưa dữ liệu cảm xúc đã phân tích vào pipeline NLP.

Nhiệm vụ

Tự động hóa tạo khách hàng tiềm năng bằng cách trích xuất thông tin liên hệ doanh nghiệp từ các thư mục ngành và mạng lưới chuyên nghiệp.

Chiến lược phân tích dữ liệu

Sử dụng Playwright cho điều hướng đa bước và tương tác biểu mẫu. Áp dụng phiên dính cho mỗi hồ sơ mục tiêu để duy trì hành vi phiên nhất quán. Phân tích các trường tên, chức danh, email và công ty thành định dạng CSV sẵn sàng cho CRM.

Các framework phân tích dữ liệu: Scrapy, Playwright và nhiều hơn nữa

Việc chọn sai framework có thể khiến các dự án scraping mới tốn hàng tuần thời gian kỹ thuật. Mỗi công cụ chính năm 2026 đều có vai trò riêng biệt trong pipeline, và các thiết lập tốt nhất hiếm khi chỉ dựa vào một công cụ duy nhất.

Cách chọn framework phân tích tốt nhất

Câu hỏi cốt lõi là: trang web mục tiêu của bạn có render nội dung bằng JavaScript hay dữ liệu có sẵn trong HTML tĩnh? Các trang tĩnh yêu cầu công cụ nhẹ, nhanh; các SPA động đòi hỏi engine trình duyệt thực. Dưới đây là phân tích các framework chính:

Scrapy: Một framework crawling Python cấp production với pipeline tích hợp, middleware, hàng đợi request và lập lịch. Tốt nhất cho các crawl tĩnh hoặc bán tĩnh quy mô lớn khi thông lượng là ưu tiên. Không phải trình duyệt; không thực thi JavaScript gốc.

Playwright: Một thư viện tự động hóa trình duyệt hiện đại của Microsoft hỗ trợ Chromium, Firefox và WebKit trên Python, Node.js, Java và C#. Có tính năng tự động chờ tích hợp, chặn mạng, mô phỏng thiết bị và quản lý đa tab. Lựa chọn hàng đầu cho các trang động, nhiều JavaScript năm 2026.

Selenium: Framework tự động hóa trình duyệt kỳ cựu với hỗ trợ ngôn ngữ và trình duyệt rộng nhất (Java, Python, C#, Ruby và nhiều hơn). Nặng hơn và chậm hơn Playwright, nhưng vô song trong các môi trường legacy và các đội kỹ thuật đa ngôn ngữ với cơ sở hạ tầng Selenium Grid hiện có.

Puppeteer: Một thư viện Node.js do Google phát triển điều khiển Chromium qua Chrome DevTools Protocol. Xuất sắc cho các tác vụ đặc thù Chrome, phân tích hiệu suất và tạo PDF. Bị Playwright vượt trội trong các dự án đa trình duyệt và đa ngôn ngữ.

BeautifulSoup + Requests: Cách nhanh nhất để tạo prototype parser cho HTML tĩnh. Đây là các thư viện Python đơn giản phân tích HTML đã tải xuống. Lý tưởng cho các tác vụ phân tích nhẹ và làm lớp phân tích trong pipeline Scrapy.

Bảng so sánh framework:

Framework | Tính năng chính | Các trường hợp sử dụng điển hình |

Scrapy | Pipeline tích hợp, middleware, crawling async, lập lịch | Crawling trang tĩnh khối lượng lớn, thu thập tập dữ liệu lớn |

Selenium | Đa ngôn ngữ, Selenium Grid, hỗ trợ rộng rãi các trình duyệt | Hệ thống cũ, đội ngũ quy mô lớn, scraping phân tán |

Playwright | Tự động chờ, đa trình duyệt, chặn mạng, mô phỏng thiết bị | Đánh giá dịch vụ động, trang web nặng JS, luồng đăng nhập, cuộn vô hạn |

Puppeteer | Chrome DevTools Protocol, kiểm soát Chrome chi tiết | Scraping dành riêng cho Chrome, render PDF, giám sát hiệu suất |

BeautifulSoup | Phân tích HTML/XML đơn giản, bộ chọn CSS, XPath | Phân tích trang tĩnh, dự án nhẹ, tạo mẫu nhanh |

Các framework này không loại trừ lẫn nhau và thường được kết hợp với nhau. Một thiết lập hiệu suất cao phổ biến là kết hợp Scrapy làm bộ điều phối crawl với Playwright xử lý các yêu cầu nặng JavaScript thông qua middleware scrapy-playwright.

Các phương pháp tốt nhất để phân tích dữ liệu

Tách biệt logic scraping và parsing của bạn. Lưu trữ HTML thô trước khi phân tích nó. Điều này cho phép bạn chạy lại parser với các selector đã cập nhật mà không cần crawl lại toàn bộ trang web: tiết kiệm thời gian rất lớn khi bố cục mục tiêu thay đổi bất ngờ.

Khớp chiến lược rotation của bạn với nhiệm vụ. Sử dụng rotation theo từng yêu cầu cho scraping hàng loạt, phiên cố định cho quy trình làm việc dựa trên tài khoản, và rotation theo thời gian cho các công việc giám sát theo lịch trình. Rotation quá tích cực sẽ phá vỡ phiên; rotation quá chậm sẽ đánh dấu IP.

Luôn kiểm tra danh tiếng IP trước khi triển khai. IP chất lượng thấp hoặc đã bị lạm dụng trước đó đảm bảo kết quả kém bất kể logic rotation của bạn. Sử dụng IP Checker của CyberYozh để chấm điểm IP của bạn trước khi thêm chúng vào bất kỳ quy trình làm việc đang hoạt động nào.

Ngẫu nhiên hóa các mẫu yêu cầu của bạn. Sử dụng độ trễ thay đổi, user agent ngẫu nhiên, và header trình duyệt thực tế để tránh kích hoạt hệ thống phát hiện hành vi. Độ trễ đồng nhất 1 giây giữa mỗi yêu cầu cũng đáng ngờ như không có độ trễ nào cả.

Chỉ sử dụng trình duyệt headless khi cần thiết. Playwright và Selenium tốn nhiều tài nguyên. Sử dụng BeautifulSoup + Requests cho các trang tĩnh và dành tự động hóa trình duyệt cho các trang thực sự yêu cầu render JavaScript.

Open Scraper của CyberYozh: Công cụ scraping dữ liệu miễn phí cho mọi người

CyberYozh duy trì Open Scraper, một bộ công cụ scraping miễn phí và mã nguồn mở được xây dựng trên Playwright, được thiết kế để giảm rào cản gia nhập cho các nhà phát triển muốn trích xuất dữ liệu cấp chuyên nghiệp mà không cần xây dựng cơ sở hạ tầng từ đầu. Nó xử lý các phần đòi hỏi nhất của quy trình scraping ngay từ đầu:

Cài đặt dễ dàng: Cài đặt Open Scraper với Docker trong 15-20 phút và sử dụng nó với kiến thức lập trình tối thiểu

Xếp hàng công việc bất đồng bộ: Chạy nhiều công việc scraping song song từ ứng dụng Open Scraper cục bộ của bạn

Scraping hàng loạt: xử lý danh sách URL lớn theo các lô có cấu trúc

Tích hợp proxy gốc: Kết nối trực tiếp với mạng proxy của CyberYozh để rotation liền mạch

Là một nền tảng, CyberYozh mở rộng khả năng của Open Scraper với cơ sở hạ tầng proxy đầy đủ. Người dùng có quyền truy cập vào nhóm IP dân cư hơn 50 triệu trải dài trên hơn 100 quốc gia, với độ trễ toàn cầu thấp ổn định phù hợp cho các công việc scraping và giám sát nhạy cảm về thời gian. Công cụ Kiểm Tra IP tích hợp cho phép bạn xác minh điểm tin cậy IP và tín hiệu rủi ro gian lận trước khi đưa chúng vào bất kỳ quy trình sản xuất nào, và CyberYozh API giúp dễ dàng tự động hóa cả lịch trình luân chuyển IP và kiểm tra danh tiếng theo chương trình, tích hợp mượt mà với Scrapy, Playwright, Selenium, Puppeteer và Postman.

Thiết lập cơ sở hạ tầng proxy của bạn. Đăng ký CyberYozh và bắt đầu ngay!

Lưu ý cuối cùng về phân tích dữ liệu

Phân tích dữ liệu là cầu nối giữa nội dung web thô và thông tin hành động. Quy trình luôn giống nhau: scrape với framework phù hợp, phân tích dữ liệu bạn cần và bảo vệ pipeline bằng proxy chất lượng và chiến lược luân chuyển thông minh. Nắm vững ba lớp này, bạn có thể trích xuất thông tin có cấu trúc từ hầu hết mọi nguồn dữ liệu công khai.

Kiểm tra danh mục proxy của CyberYozh và chọn tùy chọn bạn cần nhất.