Cómo extraer datos de Google Trends: La guía práctica completa (2026)

Por qué alguien querría extraer datos de Google Trends en 2026, antes de escribir una sola línea de código, el «por qué» merece un momento.

Google Trends es algo genuinamente raro en internet:

una ventana en tiempo real y de acceso público hacia lo que millones de personas están pensando activamente, buscando y a lo que están prestando atención.

No encuestas.

No comportamiento autorreportado.

Consultas de búsqueda reales, agregadas e indexadas como señales de interés relativo, actualizadas continuamente.

Esa es una fuente de datos extraordinaria. El problema es la interfaz.

El sitio web de Google Trends está diseñado para exploración casual. Puedes escribir una palabra clave, ver un gráfico y formarte una impresión aproximada de cómo se ha movido el interés.

Lo que no puedes hacer, no a través del sitio web, es extraer datos de interés semanal de 200 palabras clave simultáneamente, monitorear cuándo los temas emergentes empiezan a dispararse, comparar la demanda geográfica en 40 mercados o integrar señales de Trends en un pipeline automatizado de contenido o inteligencia de negocios.

El scraping resuelve exactamente esta brecha. Toma una herramienta diseñada para la curiosidad individual y la transforma en una infraestructura de datos escalable.

En resumen:

La forma más confiable de extraer datos de Google Trends en 2026 es con pytrends, una biblioteca no oficial de Python que se conecta con la API interna de Trends de Google, sin necesidad de clave API.

Para scraping de mayor volumen o requisitos más complejos, la automatización de navegador mediante Playwright ofrece más flexibilidad.

Ambos métodos requieren rotar proxies residenciales a una escala significativa para evitar la limitación de velocidad basada en IP.

Los datos de Google Trends están disponibles públicamente, son legalmente accesibles para análisis y son utilizados diariamente por profesionales de SEO, especialistas en marketing de contenidos, investigadores y analistas financieros en todo el mundo.

Quién realmente usa esto a escala:

Una propietaria de tienda de Shopify notó a través de Google Trends que el interés en «Stanley cup tumbler» comenzó a subir pronunciadamente en octubre de 2022, unas seis semanas antes de que se convirtiera en un fenómeno cultural.

Triplicó su inventario de accesorios al costo. Sus competidores, rastreando manualmente la misma tendencia, respondieron seis semanas después de que el pico de búsqueda ya había alcanzado su máximo. Ella capturó el aumento en la demanda; ellos lo persiguieron.

Eso es lo que el acceso programático a Google Trends realmente hace por personas reales. La misma lógica se aplica a la priorización de palabras clave de SEO , calendarios editoriales de contenido, análisis de sentimiento financiero, investigación académica e inteligencia competitiva.

Los datos están ahí. La pregunta es si los estás accediendo de manera sistemática o incidental.

¿Es legal extraer datos de Google Trends?

Respuesta directa: Extraer datos de Google Trends no es ilegal según las leyes de Estados Unidos, la Unión Europea, el Reino Unido o la mayoría de las demás jurisdicciones importantes. Puede entrar en conflicto con los Términos de Servicio de Google, que prohíben ampliamente el acceso automatizado, pero esto es una consideración contractual, no criminal, y la aplicación contra investigadores o analistas individuales es efectivamente inexistente.

Pongamos esto en contexto en lugar de dejarlo vago:

La Computer Fraud and Abuse Act en EE. UU., la Computer Misuse Act en el Reino Unido y el GDPR en la UE abordan el acceso no autorizado a sistemas y la protección de datos personales.

Extraer datos agregados anónimos y disponibles públicamente de Google Trends no implica significativamente ninguno de estos marcos.

Un fallo del Noveno Circuito de EE. UU. de 2022 en HiQ Labs v. LinkedIn estableció que extraer datos de acceso público, datos que no requieren inicio de sesión o autenticación para ver, no es una violación de la CFAA.

Los Términos de Servicio de Google son una consideración separada. Son un contrato entre tú y Google, no una ley. Violarlos puede resultar en bloqueo de IP o terminación del servicio, consecuencias técnicas, no legales.

El marco pragmático utilizado por profesionales:

Limita las solicitudes. No envíes cientos de peticiones por minuto. El acceso automatizado razonable imita el comportamiento humano.

Extrae lo que necesites para análisis. No archives todo el conjunto de datos sin un propósito.

No redistribuyas datos extraídos en bruto con fines comerciales. Aquí es donde las cuestiones de licencia se vuelven reales.

Utiliza los datos para obtener información. Estrategia de contenido, investigación e inteligencia empresarial son los propósitos para los que Google Trends fue diseñado para informar.

La abrumadora mayoría de profesionales SEO, periodistas, investigadores académicos y analistas de datos que extraen datos de Google Trends lo hacen todos los días sin incidentes. El riesgo es real en teoría, insignificante en la práctica para casos de uso legítimos.

Entendiendo qué son los datos de Google Trends

Antes de escribir código, entender lo que estás extrayendo importa porque los datos de Google Trends tienen una peculiaridad que confunde a los principiantes y frustra por igual a los usuarios intermedios.

Google Trends no muestra volúmenes de búsqueda absolutos:

Muestra interés relativo, una puntuación de 0 a 100 donde 100 representa el pico de interés dentro del período de tiempo y geografía seleccionados.

50 significa la mitad del pico.

0 significa datos insuficientes para mostrar.

Estos son datos deliberadamente normalizados.

Google no publica recuentos de volumen de búsqueda en bruto a través de Trends.

Lo que esto significa en la práctica:

Si extraes datos para «vehículos eléctricos» durante 5 años, la puntuación de la semana pico es 100.

Todas las demás semanas puntúan en relación con ese pico.

Si luego extraes una consulta separada para «paneles solares» durante el mismo período, su pico también puntúa 100, aunque el volumen de búsqueda absoluto para «paneles solares» fuera solo una décima parte del de «vehículos eléctricos».

Este es el problema de normalización. Hace que las comparaciones entre consultas dentro de una sola extracción de datos sean significativas, pero poco fiables entre extracciones de datos separadas .

La solución: Siempre compara palabras clave dentro de la misma llamada build_payload() de pytrends. Incluir una palabra clave «ancla» consistente (una con volumen de búsqueda estable y bien entendido) en cada lote te permite normalizar datos a través de múltiples extracciones.

Por ejemplo, incluir «clima», una palabra clave con volumen de búsqueda consistente y predecible, como ancla en cada lote te permite calibrar el interés relativo de manera comparable entre solicitudes separadas.

Comparación de métodos: Qué enfoque de extracción es el adecuado para ti

Antes de profundizar en cada método, aquí está la tabla de decisión:

Método | Dificultad | Fiabilidad | Velocidad | Mejor Caso de Uso | Limitación Principal |

pytrends (biblioteca Python) | Principiante | Alta | Rápida | La mayoría de casos de uso estándar | Límites de tasa en volumen |

Solicitudes HTTP directas | Intermedio | Medio- Alto | Rápido | Parámetros personalizados, procesamiento por lotes | Requiere gestión de encabezados/cookies |

Automatización de navegador (Playwright) | Avanzado | Muy Alto | Lento | Páginas complejas, evitar CAPTCHA | Uso intensivo de recursos |

Plataformas sin código (Apify, etc.) | Principiante | Medio | Variable | No desarrolladores, exportaciones rápidas | Costo de suscripción continuo |

Exportación manual a CSV | Ninguno | Perfecto | Muy Lento | Conjunto de datos pequeño único | No escalable |

Comienza con pytrends. Pasa a la automatización de navegador solo cuando pytrends falle consistentemente para tu caso de uso específico.

Método 1: Pytrends

Respuesta directa: pytrends es una biblioteca de Python no oficial que se comunica con la APIde datos interna de Google Trends. No requiere clave de API, se instala en segundos y maneja las tareas de extracción de datos más comunes con código mínimo. Es el punto de partida correcto para prácticamente todos.

Qué es Pytrends

pytrends (originalmente creado por el usuario GeneralMills, ahora mantenido por la comunidad de código abierto) está disponible tanto en GitHub como en PyPI.

Abstrae los endpoints internos de Trends de Google en llamadas de función Python limpias, gestionando automáticamente las cookies de autenticación, el formato de solicitudes y el análisis de respuestas.

No es un producto oficial de Google. Google no lo respalda.

Pero funciona de manera confiable para la gran mayoría de casos de uso estándar y ha estado en uso activo desde 2015, con mantenimiento comunitario constante hasta 2026.

Instalación de pytrends: bash

pip install pytrends

Se requiere Python 3.7 o posterior. Esa es la instalación completa.

Tu primera extracción de datos

Este script recupera datos de interés semanal para una sola palabra clave durante los últimos 12 meses:

from pytrends.request import TrendReq

# Initialize — hl sets the language, tz sets the timezone offset

pytrends = TrendReq(hl='en-US', tz=360)

# Build the payload — specify up to 5 keywords here

pytrends.build_payload(

kw_list=['artificial intelligence'],

timeframe='today 12-m',

geo='' # Empty string = worldwide

)

# Pull interest over time

data = pytrends.interest_over_time()

print(data.head(10))Ejecuta esto y recibirás un DataFrame de pandas, una tabla con fechas como índice de fila y puntuaciones de interés semanal (0–100) como valores. La columna isPartial indica semanas que aún no están completamente indexadas; fíltrala para un análisis limpio:

data = data[data['isPartial'] == False]Comparación de múltiples palabras clave

Una de las características más poderosas de pytrends es la comparación directa de palabras clave, hasta cinco palabras clave simultáneamente, normalizadas a la misma escala de 100 puntos:

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

kw_list=['ChatGPT', 'Gemini', 'Claude AI', 'Copilot'],

timeframe='today 12-m',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Which platform has the highest average interest?

print(data[['ChatGPT', 'Gemini', 'Claude AI', 'Copilot']].mean())Estos datos comparativos son genuinamente estratégicos. Si estás creando contenido en el espacio de herramientas de IA, saber qué plataforma tiene un interés de búsqueda creciente versus estancado te indica hacia dónde se está migrando activamente la atención de la audiencia, antes de que ese cambio sea visible en cualquier otra fuente de datos.

Datos de interés geográfico

¿Dónde en el mundo se concentra el interés? Esto extrae datos a nivel de país:

pytrends.build_payload(

kw_list=['electric vehicles'],

timeframe='today 12-m'

)

# Country-level interest

by_country = pytrends.interest_by_region(resolution='COUNTRY', inc_low_vol=True)

# Sort by interest descending

print(by_country.sort_values('electric vehicles', ascending=False).head(20))

Para resolución regional dentro de un solo país (estados de EE. UU., regiones del Reino Unido), ajusta el parámetro de resolución:

by_state = pytrends.interest_by_region(resolution='REGION', geo='US')Esto es invaluable para empresas que toman decisiones de expansión geográfica o anunciantes que asignan presupuestos regionales.

Consultas relacionadas en aumento: La característica más infrautilizada

Aquí es donde Google Trends se convierte en una genuina herramienta de inteligencia de contenido:

python

pytrends.build_payload(

kw_list=['remote work tools'],

timeframe='today 3-m'

)

related = pytrends.related_queries()

# Rising queries — growing fastest relative to their usual volume

print(related['remote work tools']['rising'])

# Top queries — highest absolute interest

print(related['remote work tools']['top'])Las consultas relacionadas en aumento muestran lo que la gente está buscando junto con tu palabra clave, que está creciendo más rápido en volumen. Para los especialistas en marketing de contenidos, esto representa de tres a seis semanas de inteligencia de palabras clave con ventaja inicial. Publica sobre una consulta relacionada en aumento antes de que alcance su pico de interés, y tu contenido estará posicionado para la curva de demanda en lugar de perseguirla.

Búsquedas en tendencia en tiempo real

Para monitorear lo que está en tendencia ahora mismo:

trending_today = pytrends.trending_searches(pn='united_states')

print(trending_today.head(20))Esto devuelve las 20 búsquedas más populares en el país especificado en el momento de la solicitud. Útil para monitoreo de noticias, estrategias de reactividad de contenido e identificación de tendencias en redes sociales.

Método 2: Solicitudes HTTP directas

Respuesta directa: Las solicitudes HTTP directas te dan control granular sobre parámetros de consulta, encabezados y gestión de sesiones que pytrends abstrae. Esto es apropiado para usuarios avanzados que necesitan formatos de marcos temporales personalizados, filtrado preciso de categorías o gestión de solicitudes por lotes de alto volumen.

Internamente, pytrends realiza solicitudes GET a los endpoints internos de Trends de Google, principalmente:

https://trends.google.com/trends/api/widgetdata/multiline

https://trends.google.com/trends/api/explore

Estos endpoints devuelven datos JSON precedidos por un prefijo de protección ()]}') que debe eliminarse antes del análisis.

También requieren cookies de sesión y encabezados específicos que el servidor de Google valida.

Aquí hay un patrón funcional usando la biblioteca requests:

import requests

import json

session = requests.Session()

# First, establish a session by visiting the main Trends page

session.get('https://trends.google.com/')

# The explore endpoint generates widget tokens for data requests

params = {

'hl': 'en-US',

'tz': '-360',

'req': json.dumps({

"comparisonItem": [

{"keyword": "python programming", "geo": "", "time": "today 12-m"}

],

"category": 0,

"property": ""

}),

'token': '',

'user_type': ''

}

response = session.get(

'https://trends.google.com/trends/api/explore',

params=params

)

# Strip the protection prefix before parsing

clean_response = response.text.lstrip(")}']\n")

data = json.loads(clean_response)Esto es más complejo que PyTrends, pero te da control preciso sobre cada aspecto de la solicitud. La mayoría de los usuarios no necesitan este nivel de control, pero para pipelines de producción con requisitos específicos de procesamiento por lotes o formatos de marco temporal no estándar, es el enfoque apropiado.

Método 3: Automatización del navegador con Playwright

Respuesta directa: Playwright automatiza un navegador real, haciendo que tu comportamiento de scraping sea virtualmente indistinguible de la navegación humana genuina. Es el método más robusto para evitar límites de tasa y CAPTCHA, pero es significativamente más lento y consume más recursos que los enfoques basados en API.

Cuándo usar Playwright en lugar de pytrends:

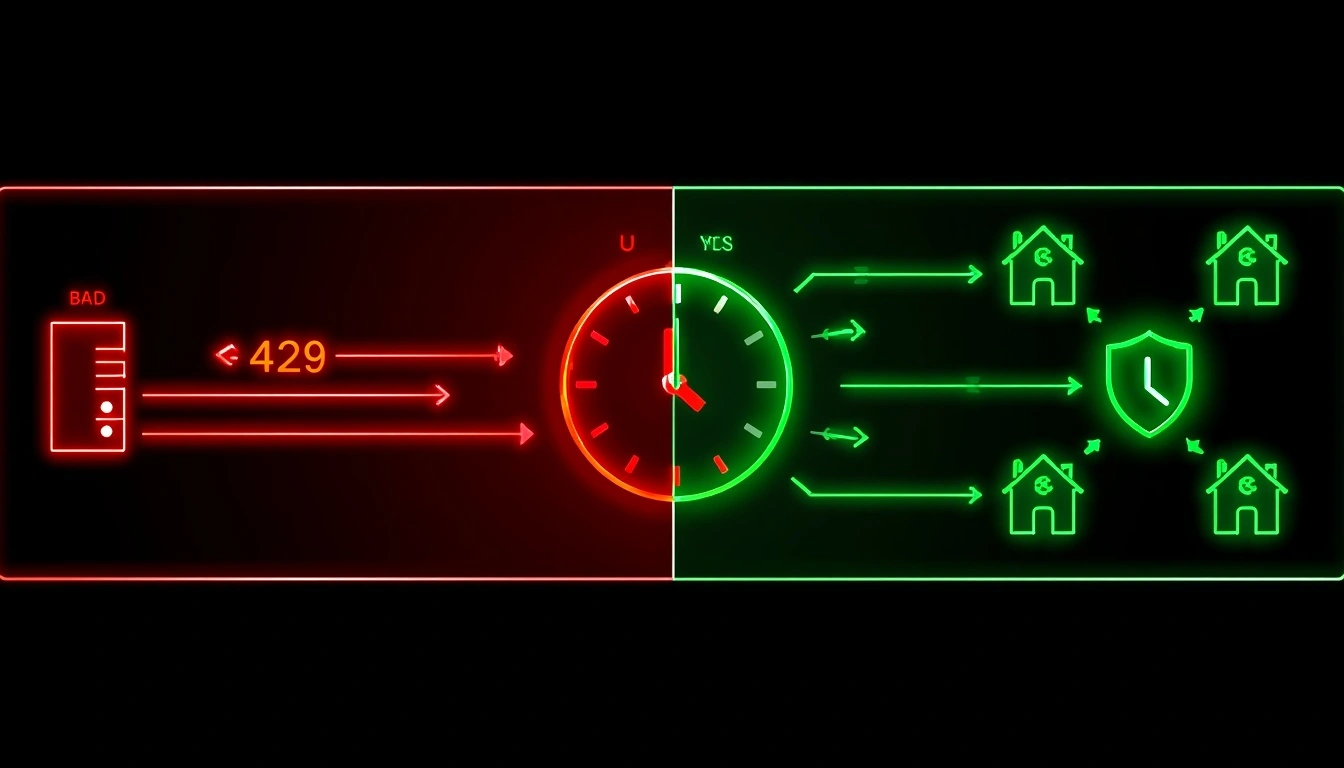

pytrends está devolviendo errores 429 consistentes, incluso con proxies y retrasos

Necesitas capturar elementos visuales o interactivos de la página que no están expuestos por la API

Necesitas manejar desafíos CAPTCHA (con solucionadores de terceros apropiados)

Estás haciendo scraping de páginas de Trends de nicho con patrones de navegación complejos

Una configuración confiable de Playwright:

from playwright.sync_api import sync_playwright

import time

with sync_playwright() as p:

# Launch browser — headless=False for debugging, True for production

browser = p.chromium.launch(headless=True)

# Create a context with realistic browser settings

context = browser.new_context(

user_agent='Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36',

viewport={'width': 1280, 'height': 800}

)

page = context.new_page()

# Navigate to Trends

page.goto('https://trends.google.com/trends/explore?q=python+programming&date=today+12-m&geo=US')

# Wait for the data chart to render

page fully

.wait_for_selector('[class*="widget"]', timeout=10000)

# Add human-like delay

time.sleep(3)

# Extract page content for parsing

content = page.content()

# Alternatively, intercept the API response directly

# This is more reliable than parsing HTML

browser.close()

print("Data extracted successfully")Un enfoque más sofisticado intercepta las solicitudes de red que Playwright realiza mientras carga la página, capturando la respuesta de la API directamente en lugar de analizar el HTML renderizado. Esto combina las ventajas de sigilo de la automatización del navegador con el formato de datos más limpio de las respuestas de API. [Lee sobre documentación de Playwright Python]

Por qué ocurren los límites de tasa y cómo manejarlos

Esta es la sección que la mayoría de los tutoriales omiten, y es por eso que los principiantes se quedan atascados después de sus primeras solicitudes exitosas.

Google Trends tiene limitación de tasa basada en IP. Envía demasiadas solicitudes en un corto período de tiempo desde una sola dirección IP, y comenzarás a recibir errores 429 (Demasiadas Solicitudes). En algunas configuraciones, recibirás un desafío CAPTCHA en su lugar. Ninguno significa que tu código esté roto; significa que has activado la gestión de tráfico automatizada de Google.

Solución 1: Agregar retrasos entre solicitudes

La solución más simple. Una llamada a time.sleep() entre solicitudes permite que los sistemas de Google restablezcan su contador por IP:

import time

from pytrends.request import TrendReq

pytrends = TrendReq(hl='en-US', tz=360)

keywords = [

'content marketing', 'SEO strategy', 'link building',

'technical SEO', 'keyword research', 'on-page SEO'

]

results = {}

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m')

results[keyword] = pytrends.interest_over_time()

print(f"✓ {keyword}")

time.sleep(15) # 15 seconds between requests

print("All keywords retrieved.")Para trabajos por lotes con hasta 50 palabras clave por sesión, los retrasos de 10–15 segundos suelen ser suficientes. Para lotes más grandes, aumenta a 30–60 segundos y divide en múltiples sesiones.

Solución 2: Proxies residenciales rotativos

Para automatización de mayor volumen, la rotación de IP es la solución arquitectónica correcta. Cada solicitud se enruta a través de una dirección IP diferente, por lo que ninguna dirección IP individual acumula suficientes solicitudes para activar la limitación de tasa.

No todos los proxies son iguales para este caso de uso.

Google mantiene listas extensas de rangos de IP de centros de datos: AWS, Google Cloud, DigitalOcean, Vultr, y limita el tráfico de estas fuentes mucho más agresivamente que el tráfico de direcciones residenciales.

Usar un proxy de centro de datos para scraping de Google a menudo no proporciona ninguna protección significativa en absoluto.

Los proxies residenciales enrutan el tráfico a través de direcciones IP asignadas a clientes reales de ISP, conexiones de internet domésticas y dispositivos móviles.

Para los sistemas de Google, este tráfico es indistinguible de usuarios genuinos.

Usar proxies de CyberYozh para scraping estable de Google Trends

Respuesta directa: Los proxies residenciales previenen la limitación de tasa de Google Trends al distribuir las solicitudes a través de miles de direcciones IP residenciales diferentes. CyberYozh ofrece proxies residenciales rotativos y proxies móviles con capacidades de geo-targeting, particularmente adecuados para la automatización de Google Trends.

Integrar proxies de CyberYozh en un flujo de trabajo de pytrends:

from pytrends.request import TrendReq

import time

import random

# CyberYozh proxy configuration

proxy_config = {

'https': 'https://USERNAME:PASSWORD@gate.cyberyozh.com:PORT'

}

# Initialize pytrends with proxy support

pytrends = TrendReq(

hl='en-US',

tz=360,

requests_args={

'proxies': proxy_config,

'verify': True

}

)

keywords = ['machine learning', 'deep learning', 'neural networks',

'computer vision', 'natural language processing']

for keyword in keywords:

pytrends.build_payload([keyword], timeframe='today 12-m', geo='US')

data = pytrends.interest_over_time()

print(f"Retrieved: {keyword} — {len(data)} weeks of data")

time.sleep(random.uniform(8, 20)) # Randomize delays to mimic human behaviorLa random .uniform(8, 20) aleatorización del retraso es importante; los intervalos predeciblemente uniformes (exactamente 10 segundos cada vez) pueden ser identificados como comportamiento automatizado por análisis de tráfico sofisticados.

Segmentación geográfica para datos de Trends:

Una aplicación frecuentemente pasada por alto de la segmentación geográfica por proxy es la extracción de datos de Trends que reflejan el comportamiento de búsqueda local genuino.

Google Trends calibra el interés relativo basándose en la geografía solicitante en algunas configuraciones.

Una IP residencial de EE. UU. que solicita datos para un parámetro geográfico de EE. UU. produce resultados más consistentes que una IP no estadounidense.

La segmentación de IP a nivel de país de CyberYozh soporta este caso de uso de forma nativa, útil para agencias que ejecutan análisis de Trends multimercado o investigadores que necesitan datos geográficamente representativos.

Consulta el catálogo de proxies de CyberYozh para las IPs más asequibles y confiables a nivel global.

Para el scraping basado en Playwright, la configuración del proxy es ligeramente diferente:

python

from playwright.sync_api import sync_playwright

with sync_playwright() as p:

browser = p.chromium.launch(

headless=True,

proxy={

"server": "https://gate.cyberyozh.com:PORT",

"username": "USERNAME",

"password": "PASSWORD"

}

)

# ... rest of automation codeEl problema de la normalización: Cómo comparar datos entre múltiples extracciones

Este es el problema que más confunde a los usuarios intermedios, y rara vez se explica en tutoriales de la competencia.

Google Trends normaliza los datos dentro de cada consulta.

El punto de mayor interés en tu marco temporal especificado siempre es 100.

Esto tiene sentido para visualizar la trayectoria de una sola palabra clave.

Crea un problema cuando quieres comparar dos palabras clave que fueron extraídas en solicitudes separadas.

Escenario: Extraes datos para «palabra clave A» y obtienes un pico de 100 en marzo. Luego extraes datos para «palabra clave B» por separado, y también obtienes un pico de 100 en marzo. ¿Significa eso que tuvieron igual volumen de búsqueda? Casi con certeza no. Simplemente estaban en sus respectivos picos.

La técnica de normalización por palabra clave ancla:

Incluye una palabra clave de referencia estable en cada lote, una con volumen de búsqueda consistente y bien comprendido. Los anclas comúnmente utilizados incluyen «Facebook», «YouTube» o «weather» (clima), palabras clave que mantienen un interés de búsqueda relativamente estable mes a mes.

from pytrends.request import TrendReq

import pandas as pd

import time

pytrends = TrendReq(hl='en-US', tz=360)

# Batch 1: Compare keyword sets against anchor

batch_1 = ['Facebook', 'content marketing', 'email marketing', 'social media marketing']

batch_2 = ['Facebook', 'SEO', 'PPC advertising', 'influencer marketing']

pytrends.build_payload(batch_1, timeframe='today 12-m', geo='US')

data_1 = pytrends.interest_over_time()[batch_1]

time.sleep(15)

pytrends.build_payload(batch_2, timeframe='today 12-m', geo='US')

data_2 = pytrends.interest_over_time()[batch_2]

# Now normalize both datasets against the anchor (facebook)

# The anchor's values are comparable across batches because they were in both

anchor = 'facebook'

data_1_normalized = data_1.div(data_1[anchor], axis=0)

data_2_normalized = data_2.div(data_2[anchor], axis=0)

# Now you can meaningfully compare any keyword from batch 1 with any from batch 2

print("Normalized comparison:")

print(pd.concat([

data_1_normalized.drop(columns=[anchor]),

data_2_normalized.drop(columns=[anchor])

], axis=1).mean())

Los analistas de datos profesionales utilizan esta técnica, y rara vez está documentada en tutoriales introductorios. Desbloquea la capacidad de comparar docenas de palabras clave a través de múltiples solicitudes por lotes con resultados significativos y comparables.

Casos de uso del mundo real: Qué hacer realmente con estos datos

Los datos sin aplicación son solo una hoja de cálculo interesante. Así es como se ve en la práctica un análisis significativo de Google Trends:

Optimización del calendario de contenidos

Extrae consultas relacionadas en ascenso semanalmente para tus grupos temáticos principales.

Cuando una palabra clave relacionada cruza el 40+ en la escala de 0–100 y continúa subiendo, publica inmediatamente una pieza enfocada en ese tema.

Apunta a la curva de crecimiento, no al pico.

Planificación de inventario estacional y gasto publicitario

Cinco años de datos de interés semanal revelan patrones estacionales con notable fiabilidad.

Un minorista que vende muebles de exterior puede ver precisamente cuándo el interés primaveral comienza a subir en sus mercados objetivo, típicamente 4–6 semanas antes de que el comportamiento de compra alcance su pico, y programar sus campañas pagadas en consecuencia.

Priorización de palabras clave SEO

Antes de invertir en una campaña de contenido para una palabra clave objetivo, verifica su trayectoria.

Una palabra clave con 30,000 búsquedas mensuales y una trayectoria ascendente en Trends es una mejor inversión que una con 50,000 búsquedas y una trayectoria descendente.

Estás invirtiendo en un mercado en crecimiento en lugar de uno en declive.

Inteligencia competitiva de marca

Rastrea el interés de búsqueda de marca de tus competidores a lo largo del tiempo.

El crecimiento sostenido en las búsquedas de marca de un competidor es una señal de alerta temprana, más informativa que sus métricas publicadas y disponible en tiempo real.

Indicadores de sentimiento financiero

El interés de búsqueda en categorías como «refinanciación de hipoteca», «recesión», «despidos» y «trabajo adicional» sirve como indicador adelantado del sentimiento del consumidor.

Los principales fondos de cobertura e instituciones de investigación económica utilizan Google Trends como una entrada en modelos más amplios de pronóstico económico.

Investigación académica y periodística

Cuantificar la atención pública a eventos noticiosos, cambios de políticas, figuras públicas y momentos culturales a lo largo del tiempo proporciona evidencia verificable y citable de patrones de interés colectivo que es más objetiva que el juicio editorial.

Exportar y visualizar datos de Google Trends

Una vez que tienes los datos, los siguientes pasos más comunes son exportar y visualizar:

from pytrends.request import TrendReq

import matplotlib.pyplot as plt

import pandas as pd

pytrends = TrendReq(hl='en-US', tz=360)

pytrends.build_payload(

['AI tools', 'automation software'],

timeframe='today 5-y',

geo='US'

)

data = pytrends.interest_over_time()

data = data[data['isPartial'] == False]

# Export to CSV for spreadsheet analysis

data.to_csv('google_trends_export.csv')

print("CSV exported successfully.")

# Create a clean visualization

fig, ax = plt.subplots(figsize=(14, 6))

data['AI tools'].plot(ax=ax, label='AI Tools', color='#2563EB', linewidth=2)

data['automation software'].plot(ax=ax, label='Automation Software', color='#7C3AED', linewidth=2)

ax.set_title('Search Interest Comparison: AI Tools vs Automation Software (5 Years, US)',

fontsize=14, fontweight='bold', pad=20)

ax.set_ylabel('Interest Score (0–100)', fontsize=11)

ax.set_xlabel('')

ax.legend(fontsize=11)

ax.grid(True, alpha=0.3)

ax.set_ylim(0, 110)

plt.tight_layout()

plt.savefig('trends_comparison.png', dpi=150, bbox_inches='tight')

plt.show()Para equipos que prefieren hojas de cálculo a Python, la exportación CSV es totalmente compatible con Excel y Google Sheets. La estructura DataFrame de pandas se mapea limpiamente a formatos tabulares, con fechas en la columna A y valores de interés de palabras clave en columnas subsiguientes.

Solución de los errores más comunes y cómo corregirlos

Error: 429 Too Many Requests Has excedido el límite de tasa por IP de Google. Agrega o aumenta los retrasos de time.sleep() entre solicitudes (comienza con 15–30 segundos). Para errores 429 persistentes en cualquier nivel de retraso, implementa proxies residenciales rotativos.

Error: ResponseError 500. Generalmente, es un problema temporal del servidor de Google. Espera 5–10 minutos y reintenta. Ocasionalmente desencadenado por parámetros de carga útil mal formados, verifica dos veces el formato de tu cadena de período de tiempo ('today 12-m', 'today 3-m', '2022-01-01 2023-12-31').

DataFrame vacío devuelto. Tu palabra clave tiene volumen de búsqueda insuficiente para la geografía o período de tiempo especificado. Intenta ampliar el parámetro geo establecido en (cadena vacía para todo el mundo) o extendiendo el período de tiempo. Algunas palabras clave de cola larga altamente específicas simplemente tienen datos insuficientes para devolver resultados.

Desafío CAPTCHA activado, Google sospecha acceso automatizado. Cambia a proxies residenciales, aumenta sustancialmente los retrasos y reduce el volumen de solicitudes por sesión. La automatización del navegador con Playwright es más resistente a los activadores de CAPTCHA que las solicitudes directas de API.

La instalación de pytrends falla. Asegúrate de que Python 3.7+ esté instalado: python --version. Intenta actualizar pip primero: pip install --upgrade pip, luego pip install pytrends.

Solo datos parciales (isPartial = True para la mayoría de las filas). Los 2–3 días más recientes de datos de Trends siempre son parciales; Google aún no los ha indexado completamente. Filtra estas filas: data = data[data['isPartial'] == False].

La normalización entre lotes da resultados inconsistentes. Consulta la sección de normalización de palabras clave ancla anterior. Incluye siempre una palabra clave de referencia estable en cada lote para permitir una comparación significativa entre lotes. [Más información sobre error 499 y error 520]

Recursos seleccionados de GitHub

En lugar de «busca en GitHub y encontrarás algo útil», aquí hay recursos específicos que vale la pena guardar:

repositorio oficial de pytrends: La referencia canónica para documentación de métodos, problemas conocidos y registro de cambios. La pestaña Issues contiene soluciones a la gran mayoría de errores de casos extremos.

Proyectos de panel de búsquedas en tendencia: varios repositorios mantenidos por la comunidad se basan en pytrends para crear paneles de palabras clave en tendencia en tiempo real. Busca «pytrends dashboard» en GitHub para las opciones mantenidas más recientemente.

Utilidades de normalización de datos de Trends: repositorios que abordan específicamente el problema de normalización entre lotes discutido anteriormente. Busca «Google Trends normalization Python» para encontrar las opciones con más estrellas.

Scraper de Google Trends de Apify: Para no desarrolladores que necesitan datos de Google Trends sin escribir código, el actor de Google Trends mantenido por Apify proporciona una interfaz sin código con ejecuciones programadas y exportación de datos. Los costos varían según el volumen de uso.

Construye el pipeline una vez, úsalo para siempre

Google Trends es una de las pocas fuentes de datos genuinamente gratuitas y genuinamente poderosas que la mayoría de las personas usa solo al 10% de su potencial. Una inversión única en configurar un pipeline de pytrends, incluso uno básico que se ejecute semanalmente de forma programada, te brinda un sistema de alerta temprana continuo para temas en ascenso, cambios en el interés de la audiencia y dinámicas competitivas emergentes.

Configura lo básico hoy. Añade infraestructura de proxy a medida que crezca tu volumen. Y comienza a tratar el comportamiento de búsqueda pública como el activo de inteligencia estratégica que realmente es, en lugar de algo que verificas manualmente cuando te acuerdas.

Los datos se actualizan continuamente. Si les prestas atención o no es la única variable que controlas.