Qué significa parsear datos: scrapers, parsers y proxies

Cuando los usuarios preguntan qué significa analizar datos, están preguntando sobre la traducción sistemática de código web sin procesar en datos estructurados. Aquí vamos a explorar este proceso, y como siempre, voy a preparar una respuesta tan clara y reflexiva como pueda, respaldada por reseñas de usuarios y comentarios de especialistas.

TL;DR

El análisis de datos es el proceso de convertir HTML extraído sin procesar en datos limpios y estructurados, y hacerlo de manera confiable requiere que el scraper, el analizador y la estrategia de rotación de proxies adecuados trabajen juntos.

Los scrapers recopilan contenido de página sin procesar; los analizadores extraen solo los campos que necesitas (precios, nombres, reseñas) en JSON o CSV

Los proxies y la rotación de IP previenen bloqueos, pero debes seleccionar la estrategia correcta: por solicitud para trabajos masivos, sesiones persistentes para inicios de sesión, basada en tiempo para monitoreo programado

La elección del framework importa: Scrapy para escala estática, Playwright para sitios con mucho JavaScript, BeautifulSoup para análisis ligero

Casos de uso clave incluyen monitoreo de precios, construcción de conjuntos de datos para IA, agregación de viajes, seguimiento de reseñas y generación de leads

El Open Scraper de CyberYozh (gratuito, basado en Playwright), más un pool de más de 50M de IPs residenciales y el IP Checker para asegurar calidad, cubre todo el proceso desde el rastreo hasta los datos limpios

Significado del análisis de datos: Definiciones centrales

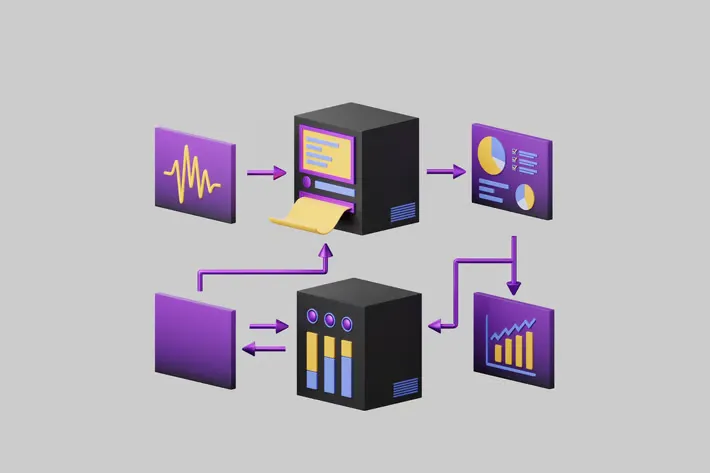

El significado del análisis de datos en su forma más simple: es el proceso de organizar información sin procesar y no estructurada (típicamente HTML extraído) y extraer significado de ella convirtiéndola en un formato limpio y consultable como JSON o CSV. Si te preguntas qué significa el análisis de datos en la práctica, piénsalo como una operación de tres capas:

Un scraper recopila contenido de página sin procesar de sitios web objetivo

Un analizador lee esas páginas, aplica lógica y aísla los valores que realmente necesitas

Un proxy asegura que todo el proceso no sea bloqueado a mitad de camino por el servidor objetivo.

Sin entender el flujo de trabajo completo del análisis de datos , la recopilación automatizada de datos casi siempre produce resultados incompletos o es cerrada por las defensas anti-bot. El significado de los datos analizados en un contexto empresarial es la salida limpia y estructurada que puedes alimentar en una hoja de cálculo, una base de datos o un modelo de IA. Exploremos herramientas específicas para eso

Qué son los data scrapers

Un data scraper es un programa automatizado que navega páginas web y descarga su contenido sin procesar, generalmente en forma de código fuente HTML, respuestas JSON o cargas útiles de API. Los scrapers pueden variar desde un script de Python usando la biblioteca requests para obtener una página estática hasta un navegador Chromium sin interfaz gráfica que simula movimiento del mouse, desplazamiento y envíos de formularios para desbloquear contenido renderizado dinámicamente.

Lee más sobre web scraping en el glosario de CyberYozh App.

El alcance de lo que los scrapers pueden recopilar es enorme:

listados de productos

ofertas de empleo

titulares de noticias

contenido de redes sociales

precios de bienes raíces

horarios de viaje

Cualquier cosa visible públicamente en un navegador puede, en principio, ser extraída mediante scraping. Su limitación principal es que devuelven la página completa tal como está, incluyendo todo el código repetitivo, menús de navegación, anuncios y ruido. Precisamente por eso el análisis sintáctico es el paso crítico que sigue a continuación.

Ejemplo de caso de uso: Una startup de analítica de comercio electrónico ejecuta un scraper basado en Scrapy para rastrear 50 tiendas competidoras cada 6 horas. El scraper descarga páginas completas de productos en masa, almacena el HTML sin procesar localmente y entrega el conjunto de datos a un pipeline de análisis sintáctico. Sin el analizador sintáctico posterior, el HTML sin procesar carece de valor comercial.

Qué son los analizadores sintácticos de datos

El significado de analizador sintáctico de datos es el programa que toma el HTML sin procesar recopilado por un scraper y extrae únicamente los puntos de datos relevantes y los organiza en un formato estructurado:

nombres de productos

precios de productos

conteos de reseñas

estado de disponibilidad

publicaciones sociales específicas

Los analizadores sintácticos funcionan aplicando reglas de selección: selectores CSS (por ejemplo, div.price) o expresiones XPath que señalan exactamente dónde en el DOM vive un valor. El resultado final de un analizador sintáctico es lo que los datos analizados realmente significan en producción: un conjunto de datos limpio, tipado y deduplicado que puede insertarse en una tabla PostgreSQL, enviarse a una API o usarse para entrenar un modelo de aprendizaje automático.

Lee más sobre qué son los verificadores y analizadores sintácticos!

Ejemplo de caso de uso: Un agregador de viajes extrae mediante scraping páginas sin procesar de listados de hoteles de 12 plataformas de reservas y las pasa a un analizador sintáctico que extrae el precio de check-in, calificación, tipo de habitación y política de cancelación. El analizador sintáctico normaliza monedas y formatos de fecha, luego escribe el resultado en una base de datos unificada que impulsa la comparación de precios en tiempo real.

Los datos web sin procesar, por sí solos, no pueden consultarse, visualizarse ni alimentarse a algoritmos: requieren estructura primero. Las empresas dependen del análisis sintáctico de datos para múltiples usos, que voy a revisar un poco más adelante. En cada uno de estos casos, el análisis sintáctico es el paso que convierte un archivo HTML en una perspectiva útil.

Proxies de análisis sintáctico de datos y rotación de IP

Ejecutar un scraper sin proxies es un experimento de corta duración. Los sitios web rastrean solicitudes repetidas desde una sola dirección IP y responden con límites de tasa, CAPTCHA, errores HTTP 429 o prohibiciones directas.

👉 Aprende más sobre

La rotación de IP es la práctica de distribuir solicitudes a través de múltiples direcciones IP para que las defensas de la plataforma vean tráfico distribuido de aspecto natural en lugar de una sola fuente automatizada.

Consulta la guía de rotación de IPde CyberYozh, que identifica cuatro estrategias principales según la tarea en cuestión:

Rotación aleatoria: La IP cambia aleatoriamente desde un grupo después de un intervalo variable (por ejemplo, 5–40 minutos), mezclándose con los patrones de tráfico de usuarios reales. Ideal para scraping de frecuencia media donde importa la emulación de comportamiento natural.

Rotación por solicitud: Cada solicitud HTTP utiliza una IP nueva del grupo. Esta es la estrategia preferida para scraping de alto volumen de motores de búsqueda, catálogos de productos y grandes bases de datos donde la velocidad es lo más importante.

Rotación basada en tiempo (preprogramada): La IP cambia una vez por período de tiempo establecido, independientemente del número de solicitudes. Ideal para trabajos de monitoreo de precios que se ejecutan según un horario y requieren un comportamiento predecible y de baja huella.

Sesiones persistentes: Se mantiene la misma IP durante toda la sesión, y luego rota cuando la sesión se cierra. Esencial para flujos de trabajo que implican iniciar sesión en cuentas, ya que los cambios de IP a mitad de sesión activan alertas de fraude e invalidación de sesión.

Muchas configuraciones fallan porque mezclan estos enfoques: rotan demasiado rápido o dependen de IPs de baja calidad que ya llevan señales de riesgo.

—Guía de Rotación de IP de CyberYozh

Elegir la estrategia de rotación incorrecta es una de las causas más comunes de fallos de scraping que en realidad no están relacionados con el código del scraper en sí. Exploremos cómo aplicar esto para tareas específicas del mundo real.

Estrategias de análisis de datos y casos de uso

Tarea

Monitorear precios de productos de la competencia en 20 plataformas de comercio electrónico en tiempo real, en múltiples regiones.

Estrategia de análisis de datos

Usar Scrapy para rastreo de alto volumen con un paso de análisis de BeautifulSoup para normalizar precios y monedas. Aplicar rotación de IP por solicitud con proxies residenciales de CyberYozh, con geolocalización configurada al mercado objetivo del vendedor. Salida a una base de datos con alertas de detección de cambios diarios.

Tarea

Agregar datos de precios de vuelos y hoteles de docenas de plataformas de reservas de viajes para un servicio de comparación de precios.

Estrategia de análisis de datos

Usar Playwright para renderizar páginas de reservas con mucho JavaScript y extraer precios dinámicos. Aplicar rotación basada en tiempo con IPs residenciales en el país objetivo, imitando sesiones de navegación de usuarios reales. Analizar campos de precios estructurados y enviar a un motor de comparación.

Tarea

Construir un conjunto de datos de texto multilingüe para entrenar un modelo de lenguaje grande a partir de artículos de noticias, foros y blogs de 30 países.

Estrategia de análisis de datos

Usar Scrapy para rastreo con rotación por solicitud a través de un amplio grupo de IPs residenciales que abarque idiomas y regiones objetivo. Analizar artículos con selectores CSS para extraer título, cuerpo, fecha y etiqueta de idioma. Almacenar en una base de datos de corpus estructurado lista para tokenización.

Tarea

Recopilar y analizar reseñas de clientes de tu marca y competidores de Amazon, Trustpilot, App Store y G2 en 15 países.

Estrategia de análisis de datos

Utilizar Python Requests + BeautifulSoup para páginas de reseñas estáticas; cambiar a Playwright para widgets de reseñas renderizados con JavaScript. Aplicar rotación aleatoria con IPs residenciales de cada país objetivo para acceder a versiones de reseñas específicas de cada región. Alimentar los datos de sentimiento analizados a un pipeline de NLP.

Tarea

Automatizar la generación de leads extrayendo detalles de contacto empresarial de directorios industriales y redes profesionales.

Estrategia de análisis de datos

Utilizar Playwright para navegación de múltiples pasos e interacción con formularios. Aplicar sesiones persistentes por perfil objetivo para mantener un comportamiento de sesión consistente. Analizar campos de nombre, título, correo electrónico y empresa en formato CSV listo para CRM.

Frameworks de análisis de datos: Scrapy, Playwright y más

Elegir el framework incorrecto puede costar semanas de tiempo de ingeniería en nuevos proyectos de scraping. Cada herramienta principal en 2026 tiene un rol distinto en el pipeline, y las mejores configuraciones rara vez dependen de una sola herramienta.

Cómo seleccionar el mejor framework de análisis

La pregunta central es: ¿tu sitio objetivo renderiza contenido con JavaScript, o los datos están disponibles en HTML estático? Los sitios estáticos requieren herramientas ligeras y rápidas; las SPAs dinámicas demandan un motor de navegador real. Aquí hay un desglose de los principales frameworks:

Scrapy: Un framework de rastreo Python de nivel de producción con pipelines integrados, middleware, cola de solicitudes y programación. Ideal para rastreos estáticos o semi-estáticos a gran escala donde el rendimiento es la prioridad. No es un navegador; no ejecuta JavaScript de forma nativa.

Playwright: Una biblioteca moderna de automatización de navegadores desarrollada por Microsoft que soporta Chromium, Firefox y WebKit en Python, Node.js, Java y C#. Cuenta con espera automática integrada, intercepción de red, emulación de dispositivos y gestión de múltiples pestañas. La mejor opción para sitios dinámicos con JavaScript intensivo en 2026.

Selenium: El framework veterano de automatización de navegadores con el soporte más amplio de lenguajes y navegadores (Java, Python, C#, Ruby y más). Más pesado y lento que Playwright, pero inigualable en entornos legacy y equipos de ingeniería políglotas con infraestructura Selenium Grid existente.

Puppeteer: Una biblioteca Node.js desarrollada por Google que controla Chromium a través del Chrome DevTools Protocol. Excelente para tareas específicas de Chrome, análisis de rendimiento y generación de PDF. Superada por Playwright en proyectos multi-navegador y multi-lenguaje.

BeautifulSoup + Requests: La forma más rápida de prototipar un analizador para HTML estático. Son bibliotecas Python que simplemente analizan HTML descargado. Ideal para tareas de análisis ligeras y como capa de análisis en un pipeline de Scrapy.

Tabla comparativa de frameworks:

Framework | Características clave | Casos de uso típicos |

Scrapy | Pipelines integrados, middleware, rastreo asíncrono, programación | Rastreo de sitios estáticos de alto volumen, recopilación de grandes conjuntos de datos |

Selenium | Multilenguaje, Selenium Grid, amplio soporte de navegadores | Sistemas heredados, equipos a gran escala, scraping distribuido |

Playwright | Espera automática, multi-navegador, interceptación de red, emulación de dispositivos | Evaluación de servicios dinámicos, sitios con mucho JS, flujos de inicio de sesión, scroll infinito |

Puppeteer | Chrome DevTools Protocol, control granular de Chrome | Scraping específico de Chrome, renderizado de PDF, monitoreo de rendimiento |

BeautifulSoup | Análisis simple de HTML/XML, selectores CSS, XPath | Análisis de páginas estáticas, proyectos ligeros, prototipado rápido |

Estos frameworks no son mutuamente excluyentes y a menudo se combinan. Una configuración común de alto rendimiento combina Scrapy como orquestador de rastreo con Playwright manejando solicitudes con mucho JavaScript mediante el middleware scrapy-playwright.

Mejores prácticas para analizar datos

Separa tu lógica de scraping y análisis. Almacena el HTML sin procesar antes de analizarlo. Esto te permite volver a ejecutar tu analizador con selectores actualizados sin tener que rastrear todo el sitio nuevamente: un gran ahorro de tiempo cuando los diseños objetivo cambian inesperadamente.

Ajusta tu estrategia de rotación a la tarea. Usa rotación por solicitud para scraping masivo, sesiones persistentes para flujos de trabajo basados en cuentas y rotación basada en tiempo para trabajos de monitoreo programados. Rotar demasiado agresivamente rompe las sesiones; rotar demasiado lentamente marca la IP.

Siempre verifica la reputación de la IP antes de implementar. Las IPs de baja calidad o previamente abusadas garantizan malos resultados independientemente de tu lógica de rotación. Usa el Verificador de IP de CyberYozh para calificar tus IPs antes de agregarlas a cualquier flujo de trabajo activo.

Aleatoriza tus patrones de solicitud. Usa retrasos variables, user agents aleatoriosy encabezados de navegador realistas para evitar activar sistemas de detección de comportamiento. Un retraso uniforme de 1 segundo entre cada solicitud es tan sospechoso como ningún retraso.

Solo usa un navegador sin interfaz cuando sea necesario. Playwright y Selenium consumen muchos recursos. Usa BeautifulSoup + Requests para páginas estáticas y reserva la automatización del navegador para páginas que realmente requieran renderizado de JavaScript.

Open Scraper de CyberYozh: Una herramienta gratuita de scraping de datos para todos

CyberYozh mantiene Open Scraper, un kit de herramientas de scraping gratuito y de código abierto construido sobre Playwright, diseñado para reducir la barrera de entrada para desarrolladores que desean extracción de datos de nivel profesional sin construir infraestructura desde cero. Maneja las partes más exigentes del flujo de trabajo de scraping de forma predeterminada:

Instalación fácil: Instala Open Scraper con Docker en 15-20 minutos y úsalo con conocimientos mínimos de programación

Cola de trabajos asíncrona: Ejecuta múltiples trabajos de scraping en paralelo desde tu aplicación local de Open Scraper

Scraping por lotes: procesa grandes listas de URL en lotes estructurados

Integración nativa de proxy: Se conecta directamente a las redes de proxy de CyberYozh para rotación fluida

Como plataforma, CyberYozh amplía las capacidades de Open Scraper con su infraestructura completa de proxies. Los usuarios obtienen acceso a un pool de más de 50 millones de IPs residenciales que abarcan más de 100 países, con una latencia global consistentemente baja adecuada para trabajos de scraping y monitoreo sensibles al tiempo. El Verificador de IP integrado te permite verificar las puntuaciones de confianza de IP y las señales de riesgo de fraude antes de comprometerlas en cualquier flujo de trabajo de producción, y la API de CyberYozh facilita la automatización tanto de la programación de rotación de IP como de las verificaciones de reputación de manera programática, integrándose limpiamente con Scrapy, Playwright, Selenium, Puppeteer y Postman.

Configura tu infraestructura de proxies. Regístrate en CyberYozh y comienza ahora!

Recordatorios finales sobre el análisis de datos

El análisis de datos es el puente entre el contenido web sin procesar y la inteligencia accionable. El flujo de trabajo es siempre el mismo: extrae con el framework adecuado, analiza los datos que necesitas y protege el pipeline con proxies de calidad y una estrategia de rotación inteligente. Domina estas tres capas y podrás extraer información estructurada de prácticamente cualquier fuente de datos pública.

Consulta el catálogo de proxies de CyberYozh y selecciona la opción que más necesites.