What Does It Mean to Parse Data: Scrapers, Parsers, and Proxies

When users ask what does it mean to parse data, they are inquiring about the systematic translation of raw web code into structured data. Here, we’re going to explore this process, and as always, I’m going to prepare an answer as clear and thoughtful as I can, supported by user reviews and specialist comments.

TL;DR

Data parsing is the process of converting raw scraped HTML into clean, structured data, and doing it reliably requires the right scraper, parser, and proxy rotation strategy working together.

Scrapers collect raw page content; parsers extract only the fields you need (prices, names, reviews) into JSON or CSV

Proxies and IP rotation prevent bans, but you should select the right strategy: per-request for bulk jobs, sticky sessions for logins, time-based for scheduled monitoring

Framework choice matters: Scrapy for static scale, Playwright for JavaScript-heavy sites, BeautifulSoup for lightweight parsing

Key use cases include price monitoring, AI dataset building, travel aggregation, review tracking, and lead generation

CyberYozh's Open Scraper (free, Playwright-based), plus a 50M+ residential IP pool and IP Checker for ensuring quality, covers the full pipeline from crawl to clean data

Data parsing meaning: Core definitions

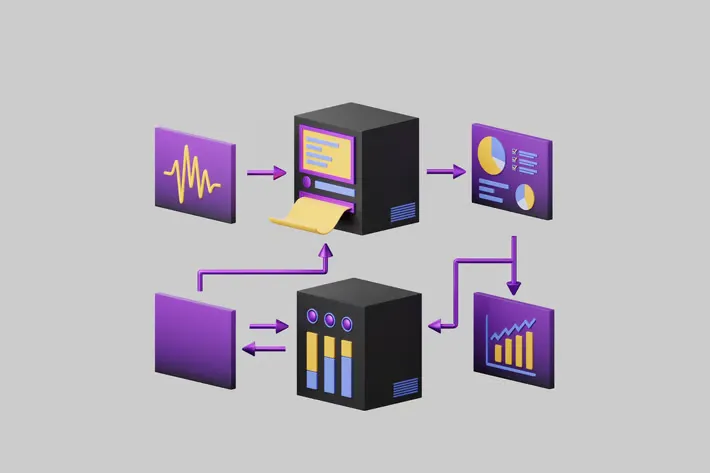

Data parsing meaning at its simplest: it is the process of organizing raw, unstructured information (typically scraped HTML) and extracting meaning from it by converting it into a clean, queryable format like JSON or CSV. If you're wondering what does data parsing mean in practice, think of it as a three-layer operation:

A scraper collects raw page content from target websites

A parser reads those pages, applies logic, and isolates the values you actually need

A proxy makes sure the entire process isn't blocked halfway through by the target server.

Without understanding the full data-parsing workflow, automated data collection almost always either produces incomplete results or gets shut down by anti-bot defenses. The parsed data's meaning in a business context is the clean, structured output you can feed into a spreadsheet, a database, or an AI model. Let’s explore specific tools for that

What are data scrapers

A data scraper is an automated program that navigates web pages and downloads their raw content, usually in the form of HTML source code, JSON responses, or API payloads. Scrapers can range from a Python script using the requests library to fetch a static page to a headless Chromium browser simulating mouse movement, scrolling, and form submissions to unlock dynamically rendered content.

Read more about web scraping in CyberYozh’s glossary.

The scope of what scrapers can collect is enormous:

product listings

job postings

news headlines

social media content

real estate prices

travel schedules

Anything publicly visible in a browser can, in principle, be scraped. Their core limitation is that they return the entire page as is, including all the boilerplate, navigation menus, ads, and noise. That’s exactly why parsing is the critical step that follows.

Use case example: An e-commerce analytics startup runs a Scrapy-based scraper to crawl 50 competitor stores every 6 hours. The scraper downloads full product pages in bulk, stores raw HTML locally, and hands the dataset off to a parsing pipeline. Without the parser downstream, the raw HTML is commercially worthless.

What are data parsers

Data parser meaning is the program that takes the raw HTML gathered by a scraper and extracts only the relevant data points and organizes them into a structured format:

product names

product prices

review counts

availability status

specific social posts

Parsers work by applying selection rules: CSS selectors (e.g., div.price) or XPath expressions that pinpoint exactly where in the DOM a value lives.The final output of a parser is what parsed data actually means in production: a clean, typed, deduplicated dataset that can be inserted into a PostgreSQL table, pushed to an API, or used to train a machine learning model.

Read more about what are checkers and parsers!

Use case example: A travel aggregator scrapes raw hotel listing pages from 12 booking platforms and passes them to a parser that extracts check-in price, rating, room type, and cancellation policy. The parser normalizes currencies and date formats, then writes the result to a unified database powering real-time price comparison.

Raw web data, on its own, cannot be queried, visualized, or fed into algorithms: it requires structure first. Businesses rely on data parsing for multiple usages, which I’m going to overview a bit further. In each of these cases, parsing is the step that converts an HTML file into an insight.

Data parsing proxies and IP rotation

Running a scraper without proxies is a short-lived experiment. Websites track repeated requests from a single IP address and respond with rate limits, CAPTCHA, HTTP 429 errors, or outright bans.

👉 Learn more about

IP rotation is the practice of distributing requests across multiple IP addresses so that platform defenses see distributed, natural-looking traffic instead of a single automated source.

Look at CyberYozh's IP rotation guide, which identifies four core strategies based on the task at hand:

Random rotation: The IP switches randomly from a pool after a variable interval (e.g., 5–40 minutes), blending with real user traffic patterns. Best for medium-frequency scraping where natural behavior emulation matters.

Per-request rotation: Each HTTP request uses a fresh IP from the pool. This is the go-to strategy for high-volume scraping of search engines, product catalogs, and large databases where speed matters most.

Time-based (preprogrammed) rotation: The IP changes once per set time period, regardless of request count. Ideal for price monitoring jobs that run on a schedule and require predictable, low-footprint behavior.

Sticky sessions: The same IP is maintained for an entire session, then rotated when the session closes. Essential for workflows that involve logging into accounts, since mid-session IP changes trigger fraud flags and session invalidation.

Many setups fail because they mix these approaches — rotating too fast, or relying on low-quality IPs that already carry risk signals.

—CyberYozh IP Rotation Guide

Choosing the wrong rotation strategy is one of the most common causes of scraping failures that aren't actually related to the scraper code itself. Let’s explore how to apply that for specific real-world tasks.

Data parsing strategies and usage cases

Task

Monitor competitor product prices across 20 e-commerce platforms in real time, across multiple regions.

Data parsing strategy

Use Scrapy for high-volume crawling with a BeautifulSoup parsing step to normalize prices and currencies. Apply per-request IP rotation with CyberYozh residential proxies, with geo-targeting set to the seller's target market. Output to a database with daily change detection alerts.

Task

Aggregate flight and hotel pricing data from dozens of travel booking platforms for a price comparison service.

Data parsing strategy

Use Playwright to render JavaScript-heavy booking pages and extract dynamic pricing. Apply time-based rotation with residential IPs in the target country, mimicking real user browsing sessions. Parse structured pricing fields and push to a comparison engine.

Task

Build a multilingual text dataset for training a large language model from news articles, forums, and blogs across 30 countries.

Data parsing strategy

Use Scrapy for crawling with per-request rotation across a wide residential IP pool spanning target languages and regions. Parse articles with CSS selectors to extract title, body, date, and language tag. Store in a structured corpus database ready for tokenization.

Task

Collect and analyze customer reviews of your brand and competitors from Amazon, Trustpilot, App Store, and G2 across 15 countries.

Data parsing strategy

Use Python Requests + BeautifulSoup for static review pages; switch to Playwright for JavaScript-rendered review widgets. Apply random rotation with residential IPs from each target country to access region-specific review versions. Feed parsed sentiment data to an NLP pipeline.

Task

Automate lead generation by extracting business contact details from industry directories and professional networks.

Data parsing strategy

Use Playwright for multi-step navigation and form interaction. Apply sticky sessions per target profile to maintain consistent session behavior. Parse name, title, email, and company fields into a CRM-ready CSV format.

Data parsing frameworks: Scrapy, Playwright, and more

Choosing the wrong framework can cost new scraping projects weeks of engineering time. Each major tool in 2026 has a distinct role in the pipeline, and the best setups rarely rely on a single tool.

How to select the best parsing framework

The core question is: does your target site render content with JavaScript, or is the data available in static HTML? Static sites call for lightweight, fast tools; dynamic SPAs demand a real browser engine. Here is a breakdown of the main frameworks:

Scrapy: A production-grade Python crawling framework with built-in pipelines, middleware, request queuing, and scheduling. Best for large-scale, static or semi-static crawls where throughput is the priority. Not a browser; it does not execute JavaScript natively.

Playwright: A modern browser automation library by Microsoft supporting Chromium, Firefox, and WebKit across Python, Node.js, Java, and C#. Features built-in auto-waiting, network interception, device emulation, and multi-tab management. The top choice for dynamic, JavaScript-heavy sites in 2026.

Selenium: The veteran browser automation framework with the broadest language and browser support (Java, Python, C#, Ruby, and more). Heavier and slower than Playwright, but unmatched in legacy environments and polyglot engineering teams with existing Selenium Grid infrastructure.

Puppeteer: A Google-developed Node.js library controlling Chromium via the Chrome DevTools Protocol. Excellent for Chrome-specific tasks, performance analysis, and PDF generation. Outperformed by Playwright on multi-browser and multi-language projects.

BeautifulSoup + Requests: The fastest way to prototype a parser for static HTML. These are Python libraries that simply parse downloaded HTML. Ideal for lightweight parsing tasks and as the parsing layer in a Scrapy pipeline.

Framework comparison table:

Framework | Key features | Typical use cases |

Scrapy | Built-in pipelines, middleware, async crawling, scheduling | High-volume static site crawling, large dataset collection |

Selenium | Multi-language, Selenium Grid, wide browser support | Legacy systems, large-scale teams, distributed scraping |

Playwright | Auto-wait, multi-browser, network interception, device emulation | Dynamic service assessment, JS-heavy sites, login flows, infinite scroll |

Puppeteer | Chrome DevTools Protocol, fine-grained Chrome control | Chrome-specific scraping, PDF rendering, performance monitoring |

BeautifulSoup | Simple HTML/XML parsing, CSS selectors, XPath | Static page parsing, lightweight projects, rapid prototyping |

These frameworks are not mutually exclusive and are often combined. A common high-performance setup pairs Scrapy as the crawl orchestrator with Playwright handling JavaScript-heavy requests via the scrapy-playwright middleware.

Best practices to parse data

Separate your scraping and parsing logic. Store raw HTML before parsing it. This lets you re-run your parser with updated selectors without re-crawling the entire site: a huge time-saver when target layouts change unexpectedly.

Match your rotation strategy to the task. Use per-request rotation for bulk scraping, sticky sessions for account-based workflows, and time-based rotation for scheduled monitoring jobs. Rotating too aggressively breaks sessions; rotating too slowly flags the IP.

Always check IP reputation before deploying. Low-quality or previously abused IPs guarantee poor results regardless of your rotation logic. Use CyberYozh's IP Checker to score your IPs before adding them to any active workflow.

Randomize your request patterns. Use variable delays, randomized user agents, and realistic browser headers to avoid triggering behavioral detection systems. A uniform 1-second delay between every request is just as suspicious as no delay at all.

Only use a headless browser when necessary. Playwright and Selenium are resource-intensive. Use BeautifulSoup + Requests for static pages and reserve browser automation for pages that actually require JavaScript rendering.

CyberYozh’s Open Scraper: A free data scraping tool for everyone

CyberYozh maintains Open Scraper, a free and open-source scraping toolkit built on Playwright, designed to lower the barrier of entry for developers who want professional-grade data extraction without building infrastructure from scratch. It handles the most demanding parts of the scraping workflow out of the box:

Easy installation: Install Open Scraper with Docker in 15-20 minutes and use it with minimal coding knowledge

Asynchronous job queuing: Run multiple scraping jobs in parallel from your local Open Scraper app

Batch scraping: process large URL lists in structured batches

Native proxy integration: Connects directly to CyberYozh's proxy networks for seamless rotation

As a platform, CyberYozh extends Open Scraper's capabilities with its full proxy infrastructure. Users get access to a 50M+ residential IP pool spanning 100+ countries, with consistently low global latency suited for time-sensitive scraping and monitoring jobs. The built-in IP Checker lets you verify IP trust scores and fraud risk signals before committing them to any production workflow, and the CyberYozh API makes it easy to automate both IP rotation scheduling and reputation checkups programmatically, integrating cleanly with Scrapy, Playwright, Selenium, Puppeteer, and Postman.

Set up your proxy infrastructure. Sign up to CyberYozh, and start now!

Final reminders about data parsing

Data parsing is the bridge between raw web content and actionable intelligence. The workflow is always the same: scrape with the right framework, parse the data you need, and protect the pipeline with quality proxies and a smart rotation strategy. Master these three layers, and you can extract structured insights from virtually any public data source.

Check CyberYozh’s proxy catalog and select the option you need most.